TensorFlow - Tối ưu hóa Gradient Descent

Tối ưu hóa gradient descent được coi là một khái niệm quan trọng trong khoa học dữ liệu.

Hãy xem xét các bước được hiển thị bên dưới để hiểu việc triển khai tối ưu hóa dốc gradient -

Bước 1

Bao gồm các mô-đun cần thiết và khai báo các biến x và y mà qua đó chúng ta sẽ xác định tối ưu hóa gradient descent.

import tensorflow as tf

x = tf.Variable(2, name = 'x', dtype = tf.float32)

log_x = tf.log(x)

log_x_squared = tf.square(log_x)

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(log_x_squared)Bước 2

Khởi tạo các biến cần thiết và gọi trình tối ưu hóa để xác định và gọi nó với chức năng tương ứng.

init = tf.initialize_all_variables()

def optimize():

with tf.Session() as session:

session.run(init)

print("starting at", "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

for step in range(10):

session.run(train)

print("step", step, "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

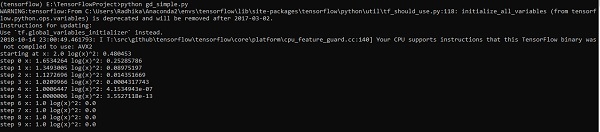

optimize()Dòng mã trên tạo ra một đầu ra như được hiển thị trong ảnh chụp màn hình bên dưới -

Chúng ta có thể thấy rằng các kỷ nguyên và số lần lặp cần thiết được tính toán như trong đầu ra.