DBMS Terdistribusi - Panduan Cepat

Untuk memfungsikan organisasi mana pun, ada kebutuhan akan database yang terpelihara dengan baik. Di masa lalu, database dulu bersifat sentralistik. Namun, dengan meningkatnya globalisasi, organisasi cenderung menjadi beragam di seluruh dunia. Mereka dapat memilih untuk mendistribusikan data melalui server lokal daripada database pusat. Maka, tibalah konsepDistributed Databases.

Bab ini memberikan gambaran umum tentang database dan Sistem Manajemen Database (DBMS). Database adalah kumpulan data terkait yang dipesan. DBMS adalah paket perangkat lunak untuk mengerjakan database. Sebuah studi rinci tentang DBMS tersedia dalam tutorial kami yang bernama "Belajar DBMS". Pada bab ini kami merevisi konsep utama agar pembelajaran DDBMS dapat dilakukan dengan mudah. Tiga topik yang dibahas adalah skema database, jenis database dan operasi pada database.

Sistem Manajemen Basis Data dan Basis Data

SEBUAH databaseadalah kumpulan data terkait yang disusun untuk tujuan tertentu. Database dapat diatur sebagai kumpulan beberapa tabel, di mana tabel mewakili elemen atau entitas dunia nyata. Setiap tabel memiliki beberapa bidang berbeda yang mewakili fitur karakteristik entitas.

Misalnya, database perusahaan dapat mencakup tabel untuk proyek, karyawan, departemen, produk, dan catatan keuangan. Bidang di tabel Karyawan mungkin Nama, ID_perusahaan, Tanggal_ Bergabung, dan sebagainya.

SEBUAH database management systemadalah kumpulan program yang memungkinkan pembuatan dan pemeliharaan database. DBMS tersedia sebagai paket perangkat lunak yang memfasilitasi definisi, konstruksi, manipulasi, dan berbagi data dalam database. Pengertian basis data meliputi uraian tentang struktur basis data. Pembangunan database melibatkan penyimpanan data yang sebenarnya dalam media penyimpanan apa pun. Manipulasi mengacu pada pengambilan informasi dari database, memperbarui database, dan menghasilkan laporan. Berbagi data memfasilitasi data untuk diakses oleh pengguna atau program yang berbeda.

Contoh Area Aplikasi DBMS

- Mesin Anjungan Tunai Mandiri

- Sistem Reservasi Kereta

- Sistem Manajemen Karyawan

- Sistem Informasi Mahasiswa

Contoh Paket DBMS

- MySQL

- Oracle

- SQL Server

- dBASE

- FoxPro

- PostgreSQL, dll.

Skema Database

Skema database adalah deskripsi dari database yang ditentukan selama desain database dan dapat mengalami perubahan yang jarang terjadi. Ini mendefinisikan organisasi data, hubungan di antara mereka, dan batasan yang terkait dengannya.

Database sering direpresentasikan melalui three-schema architecture atau ANSISPARC architecture. Tujuan dari arsitektur ini adalah untuk memisahkan aplikasi pengguna dari database fisik. Ketiga level tersebut adalah -

Internal Level having Internal Schema - Ini menjelaskan struktur fisik, rincian penyimpanan internal dan jalur akses untuk database.

Conceptual Level having Conceptual Schema- Ini menjelaskan struktur seluruh database sambil menyembunyikan detail penyimpanan fisik data. Ini menggambarkan entitas, atribut dengan tipe datanya dan batasannya, operasi pengguna dan hubungan.

External or View Level having External Schemas or Views - Ini menjelaskan bagian dari database yang relevan dengan pengguna tertentu atau sekelompok pengguna sambil menyembunyikan sisa database.

Jenis DBMS

Ada empat jenis DBMS.

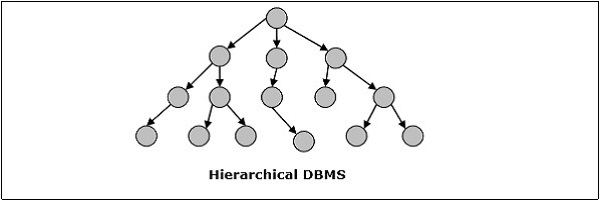

DBMS hierarkis

Dalam DBMS hierarki, hubungan antar data dalam database dibuat sedemikian rupa sehingga satu elemen data ada sebagai bawahan dari yang lain. Elemen data memiliki hubungan induk-anak dan dimodelkan menggunakan struktur data "pohon". Ini sangat cepat dan sederhana.

DBMS jaringan

Jaringan DBMS merupakan salah satu tempat hubungan antar data dalam database yang berjenis many-to-many dalam bentuk jaringan. Strukturnya umumnya rumit karena adanya banyak hubungan banyak-ke-banyak. DBMS jaringan dimodelkan menggunakan struktur data "grafik".

DBMS relasional

Dalam database relasional, database direpresentasikan dalam bentuk relasi. Setiap relasi memodelkan entitas dan direpresentasikan sebagai tabel nilai. Dalam relasi atau tabel, baris disebut tupel dan menunjukkan satu record. Kolom disebut bidang atau atribut dan menunjukkan properti karakteristik entitas. RDBMS adalah sistem manajemen database paling populer.

Misalnya - Hubungan Mahasiswa -

DBMS Berorientasi Objek

DBMS berorientasi objek diturunkan dari model paradigma pemrograman berorientasi objek. Mereka sangat membantu dalam merepresentasikan data yang konsisten seperti yang disimpan dalam database, serta data sementara, seperti yang ditemukan dalam menjalankan program. Mereka menggunakan elemen kecil yang dapat digunakan kembali yang disebut objek. Setiap objek berisi bagian data dan satu set operasi yang bekerja pada data tersebut. Objek dan atributnya diakses melalui pointer alih-alih disimpan dalam model tabel relasional.

Misalnya - Database berorientasi objek Rekening Bank yang disederhanakan -

DBMS terdistribusi

Database terdistribusi adalah sekumpulan database yang saling berhubungan yang didistribusikan melalui jaringan komputer atau internet. Sistem Manajemen Basis Data Terdistribusi (DDBMS) mengelola basis data terdistribusi dan menyediakan mekanisme untuk membuat basis data transparan bagi pengguna. Dalam sistem ini, data sengaja didistribusikan di antara beberapa node sehingga semua sumber daya komputasi organisasi dapat digunakan secara optimal.

Operasi di DBMS

Empat operasi dasar pada database adalah Buat, Ambil, Perbarui, dan Hapus.

CREATE struktur database dan mengisinya dengan data - Pembuatan relasi database melibatkan penentuan struktur data, tipe data dan batasan data yang akan disimpan.

Example - Perintah SQL untuk membuat tabel siswa -

CREATE TABLE STUDENT (

ROLL INTEGER PRIMARY KEY,

NAME VARCHAR2(25),

YEAR INTEGER,

STREAM VARCHAR2(10)

);Setelah format data ditentukan, data sebenarnya disimpan sesuai dengan format di beberapa media penyimpanan.

Example Perintah SQL untuk memasukkan satu tupel ke dalam tabel siswa -

INSERT INTO STUDENT ( ROLL, NAME, YEAR, STREAM)

VALUES ( 1, 'ANKIT JHA', 1, 'COMPUTER SCIENCE');RETRIEVEinformasi dari database - Mengambil informasi umumnya melibatkan pemilihan subset tabel atau menampilkan data dari tabel setelah beberapa perhitungan selesai. Ini dilakukan dengan query di atas tabel.

Example - Untuk mengambil nama semua siswa aliran Ilmu Komputer, kueri SQL berikut harus dijalankan -

SELECT NAME FROM STUDENT

WHERE STREAM = 'COMPUTER SCIENCE';UPDATE informasi yang disimpan dan memodifikasi struktur database - Memperbarui tabel melibatkan perubahan nilai lama di baris tabel yang ada dengan nilai baru.

Example - Perintah SQL untuk mengubah aliran dari Elektronik ke Elektronik dan Komunikasi -

UPDATE STUDENT

SET STREAM = 'ELECTRONICS AND COMMUNICATIONS'

WHERE STREAM = 'ELECTRONICS';Memodifikasi database berarti mengubah struktur tabel. Namun, modifikasi tabel tunduk pada sejumlah batasan.

Example - Untuk menambahkan bidang atau kolom baru, katakan alamat ke tabel Siswa, kami menggunakan perintah SQL berikut -

ALTER TABLE STUDENT

ADD ( ADDRESS VARCHAR2(50) );DELETE informasi yang disimpan atau menghapus tabel secara keseluruhan - Penghapusan informasi tertentu melibatkan penghapusan baris yang dipilih dari tabel yang memenuhi kondisi tertentu.

Example- Untuk menghapus semua siswa yang berada di tahun ke- 4 saat mereka pingsan, kami menggunakan perintah SQL -

DELETE FROM STUDENT

WHERE YEAR = 4;Alternatifnya, seluruh tabel dapat dihapus dari database.

Example - Untuk menghapus tabel siswa sepenuhnya, perintah SQL yang digunakan adalah -

DROP TABLE STUDENT;Bab ini memperkenalkan konsep DDBMS. Dalam database terdistribusi, terdapat sejumlah database yang mungkin tersebar secara geografis ke seluruh dunia. DBMS terdistribusi mengelola database terdistribusi sedemikian rupa sehingga database tersebut muncul sebagai satu database tunggal bagi pengguna. Di bagian selanjutnya dari bab ini, kita melanjutkan mempelajari faktor-faktor yang menyebabkan database terdistribusi, keuntungan dan kerugiannya.

SEBUAH distributed database adalah kumpulan dari beberapa database yang saling berhubungan, yang tersebar secara fisik di berbagai lokasi yang berkomunikasi melalui jaringan komputer.

fitur

Basis data dalam koleksi secara logis saling terkait satu sama lain. Seringkali mereka mewakili satu database logis.

Data disimpan secara fisik di beberapa situs. Data di setiap situs dapat dikelola oleh DBMS yang tidak bergantung pada situs lain.

Prosesor di situs terhubung melalui jaringan. Mereka tidak memiliki konfigurasi multiprosesor.

Database terdistribusi bukanlah sistem file yang terhubung secara longgar.

Basis data terdistribusi menggabungkan pemrosesan transaksi, tetapi itu tidak identik dengan sistem pemrosesan transaksi.

Sistem Manajemen Basis Data Terdistribusi

Sistem manajemen basis data terdistribusi (DDBMS) adalah sistem perangkat lunak terpusat yang mengelola basis data terdistribusi dengan cara seolah-olah semuanya disimpan di satu lokasi.

fitur

Ini digunakan untuk membuat, mengambil, memperbarui, dan menghapus database terdistribusi.

Ini menyinkronkan database secara berkala dan menyediakan mekanisme akses berdasarkan distribusi yang menjadi transparan bagi pengguna.

Ini memastikan bahwa data yang dimodifikasi di situs mana pun diperbarui secara universal.

Ini digunakan di area aplikasi di mana volume data yang besar diproses dan diakses oleh banyak pengguna secara bersamaan.

Ini dirancang untuk platform database yang heterogen.

Ini menjaga kerahasiaan dan integritas data dari database.

Faktor Pendorong DDBMS

Faktor berikut mendorong pindah ke DDBMS -

Distributed Nature of Organizational Units- Sebagian besar organisasi saat ini dibagi menjadi beberapa unit yang secara fisik didistribusikan ke seluruh dunia. Setiap unit membutuhkan kumpulan data lokalnya sendiri. Dengan demikian, keseluruhan database organisasi menjadi terdistribusi.

Need for Sharing of Data- Beberapa unit organisasi sering kali perlu berkomunikasi satu sama lain dan berbagi data serta sumber daya mereka. Ini menuntut database umum atau database yang direplikasi yang harus digunakan secara sinkron.

Support for Both OLTP and OLAP- Pemrosesan Transaksi Online (OLTP) dan Pemrosesan Analitik Online (OLAP) bekerja pada sistem yang beragam yang mungkin memiliki data umum. Sistem database terdistribusi membantu kedua pemrosesan ini dengan menyediakan data yang disinkronkan.

Database Recovery- Salah satu teknik umum yang digunakan dalam DDBMS adalah replikasi data di berbagai situs. Replikasi data secara otomatis membantu dalam pemulihan data jika database di situs mana pun rusak. Pengguna dapat mengakses data dari situs lain saat situs yang rusak sedang dibangun kembali. Dengan demikian, kegagalan database mungkin menjadi hampir tidak terlihat oleh pengguna.

Support for Multiple Application Software- Sebagian besar organisasi menggunakan berbagai perangkat lunak aplikasi, masing-masing dengan dukungan database spesifiknya. DDBMS menyediakan fungsionalitas yang seragam untuk menggunakan data yang sama di antara platform yang berbeda.

Keuntungan dari Database Terdistribusi

Berikut ini adalah keuntungan dari database terdistribusi dibandingkan database terpusat.

Modular Development- Jika sistem perlu diperluas ke lokasi baru atau unit baru, dalam sistem basis data terpusat, tindakan tersebut memerlukan upaya besar dan gangguan pada fungsi yang ada. Namun, dalam database terdistribusi, pekerjaan hanya memerlukan penambahan komputer baru dan data lokal ke situs baru dan akhirnya menghubungkannya ke sistem terdistribusi, tanpa gangguan pada fungsi saat ini.

More Reliable- Jika terjadi kegagalan database, sistem total dari database terpusat akan terhenti. Namun, dalam sistem terdistribusi, ketika komponen gagal, fungsi sistem terus berlanjut mungkin pada kinerja yang berkurang. Karenanya DDBMS lebih andal.

Better Response- Jika data didistribusikan secara efisien, maka permintaan pengguna dapat dipenuhi dari data lokal itu sendiri, sehingga memberikan respons yang lebih cepat. Di sisi lain, dalam sistem terpusat, semua kueri harus melewati komputer pusat untuk diproses, yang meningkatkan waktu respons.

Lower Communication Cost- Dalam sistem basis data terdistribusi, jika data ditempatkan secara lokal di mana data tersebut banyak digunakan, maka biaya komunikasi untuk manipulasi data dapat diminimalkan. Ini tidak mungkin dilakukan dalam sistem terpusat.

Kesulitan dari Database Terdistribusi

Berikut adalah beberapa masalah yang terkait dengan database terdistribusi.

Need for complex and expensive software - DDBMS menuntut perangkat lunak yang kompleks dan seringkali mahal untuk menyediakan transparansi dan koordinasi data di beberapa situs.

Processing overhead - Bahkan operasi sederhana mungkin memerlukan banyak komunikasi dan kalkulasi tambahan untuk memberikan keseragaman dalam data di seluruh situs.

Data integrity - Kebutuhan untuk memperbarui data di banyak situs menimbulkan masalah integritas data.

Overheads for improper data distribution- Responsivitas kueri sangat bergantung pada distribusi data yang tepat. Distribusi data yang tidak tepat sering kali menyebabkan respons yang sangat lambat terhadap permintaan pengguna.

Di bagian tutorial ini, kita akan mempelajari berbagai aspek yang membantu dalam merancang lingkungan database terdistribusi. Bab ini dimulai dengan jenis database terdistribusi. Basis data terdistribusi dapat diklasifikasikan ke dalam basis data homogen dan heterogen yang memiliki divisi lebih lanjut. Bagian selanjutnya dari bab ini membahas arsitektur terdistribusi yaitu client-server, peer-to-peer dan multi-DBMS. Akhirnya, alternatif desain yang berbeda seperti replikasi dan fragmentasi diperkenalkan.

Jenis Basis Data Terdistribusi

Database terdistribusi dapat secara luas diklasifikasikan ke dalam lingkungan database terdistribusi yang homogen dan heterogen, masing-masing dengan sub-divisi lebih lanjut, seperti yang ditunjukkan pada ilustrasi berikut.

Basis Data Terdistribusi Homogen

Dalam database terdistribusi homogen, semua situs menggunakan DBMS dan sistem operasi yang identik. Properti-propertinya adalah -

Situs tersebut menggunakan perangkat lunak yang sangat mirip.

Situs menggunakan DBMS atau DBMS yang identik dari vendor yang sama.

Setiap situs mengetahui semua situs lain dan bekerja sama dengan situs lain untuk memproses permintaan pengguna.

Basis data diakses melalui satu antarmuka seolah-olah itu adalah basis data tunggal.

Jenis Basis Data Terdistribusi Homogen

Ada dua jenis database terdistribusi homogen -

Autonomous- Setiap database independen yang berfungsi sendiri-sendiri. Mereka terintegrasi dengan aplikasi pengontrol dan menggunakan pengiriman pesan untuk berbagi pembaruan data.

Non-autonomous - Data didistribusikan di seluruh node homogen dan pusat atau master DBMS mengoordinasikan pembaruan data di seluruh situs.

Basis Data Terdistribusi Heterogen

Dalam database terdistribusi heterogen, situs yang berbeda memiliki sistem operasi, produk DBMS, dan model data yang berbeda. Properti-propertinya adalah -

Situs yang berbeda menggunakan skema dan perangkat lunak yang berbeda.

Sistem dapat terdiri dari berbagai DBMS seperti relasional, jaringan, hierarki atau berorientasi objek.

Pemrosesan kueri rumit karena skema yang berbeda.

Pemrosesan transaksi rumit karena perangkat lunak yang berbeda.

Sebuah situs mungkin tidak mengetahui situs lain sehingga ada kerja sama terbatas dalam memproses permintaan pengguna.

Jenis Basis Data Terdistribusi Heterogen

Federated - Sistem basis data yang heterogen bersifat independen dan terintegrasi bersama sehingga berfungsi sebagai sistem basis data tunggal.

Un-federated - Sistem database menggunakan modul koordinasi pusat di mana database diakses.

Arsitektur DBMS Terdistribusi

Arsitektur DDBMS umumnya dikembangkan tergantung pada tiga parameter -

Distribution - Ini menyatakan distribusi fisik data di berbagai situs.

Autonomy - Ini menunjukkan distribusi kendali sistem database dan sejauh mana setiap konstituen DBMS dapat beroperasi secara independen.

Heterogeneity - Ini mengacu pada keseragaman atau ketidaksamaan model data, komponen sistem, dan database.

Model Arsitektur

Beberapa model arsitektur yang umum adalah -

- Klien - Arsitektur Server untuk DDBMS

- Arsitektur Peer - to - Peer untuk DDBMS

- Arsitektur Multi-DBMS

Klien - Arsitektur Server untuk DDBMS

Ini adalah arsitektur dua tingkat yang fungsinya dibagi menjadi server dan klien. Fungsi server terutama mencakup manajemen data, pemrosesan kueri, pengoptimalan, dan manajemen transaksi. Fungsi klien terutama mencakup antarmuka pengguna. Namun, mereka memiliki beberapa fungsi seperti pemeriksaan konsistensi dan manajemen transaksi.

Dua klien yang berbeda - arsitektur server adalah -

- Server Tunggal Banyak Klien

- Beberapa Server Banyak Klien (ditampilkan dalam diagram berikut)

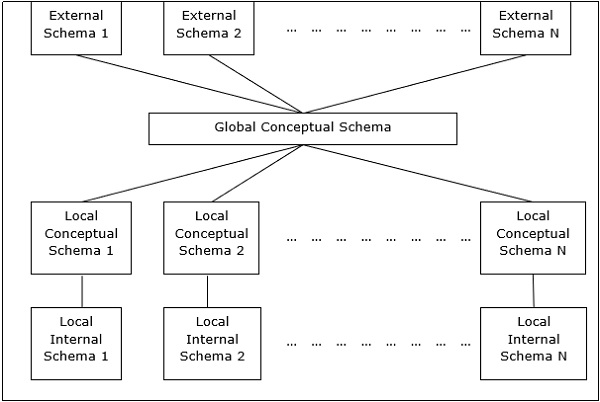

Arsitektur Peer-to-Peer untuk DDBMS

Dalam sistem ini, setiap rekan bertindak sebagai klien dan server untuk memberikan layanan database. Teman sebaya berbagi sumber daya mereka dengan rekan lain dan mengoordinasikan aktivitas mereka.

Arsitektur ini umumnya memiliki empat level skema -

Global Conceptual Schema - Menggambarkan pandangan logis global data.

Local Conceptual Schema - Menggambarkan organisasi data logis di setiap situs.

Local Internal Schema - Menggambarkan organisasi data fisik di setiap situs.

External Schema - Menggambarkan tampilan data pengguna.

Arsitektur Multi-DBMS

Ini adalah sistem basis data terintegrasi yang dibentuk oleh kumpulan dua atau lebih sistem basis data otonom.

Multi-DBMS dapat diekspresikan melalui enam level skema -

Multi-database View Level - Menggambarkan beberapa tampilan pengguna yang terdiri dari himpunan bagian dari database terdistribusi terintegrasi.

Multi-database Conceptual Level - Menggambarkan multi-database terintegrasi yang terdiri dari definisi struktur multi-database logis global.

Multi-database Internal Level - Menggambarkan distribusi data di berbagai situs dan multi-database ke pemetaan data lokal.

Local database View Level - Menggambarkan pandangan publik atas data lokal.

Local database Conceptual Level - Menggambarkan organisasi data lokal di setiap situs.

Local database Internal Level - Menggambarkan organisasi data fisik di setiap situs.

Ada dua alternatif desain untuk multi-DBMS -

- Model dengan level konseptual multi-database.

- Model tanpa level konseptual multi-database.

Alternatif Desain

Alternatif desain distribusi untuk tabel di DDBMS adalah sebagai berikut -

- Tidak direplikasi dan tidak terfragmentasi

- Direplikasi sepenuhnya

- Direplikasi sebagian

- Fragmented

- Mixed

Tidak direplikasi & tidak terfragmentasi

Dalam alternatif desain ini, tabel berbeda ditempatkan di lokasi berbeda. Data ditempatkan sedemikian rupa sehingga berada dekat dengan situs tempat data paling sering digunakan. Ini paling cocok untuk sistem database di mana persentase kueri yang diperlukan untuk menggabungkan informasi dalam tabel yang ditempatkan di situs berbeda rendah. Jika strategi distribusi yang tepat diterapkan, alternatif desain ini membantu mengurangi biaya komunikasi selama pemrosesan data.

Direplikasi Sepenuhnya

Dalam alternatif desain ini, di setiap situs, satu salinan dari semua tabel database disimpan. Karena, setiap situs memiliki salinan seluruh database sendiri, kueri sangat cepat sehingga memerlukan biaya komunikasi yang dapat diabaikan. Sebaliknya, redundansi besar-besaran dalam data membutuhkan biaya besar selama operasi pembaruan. Oleh karena itu, ini cocok untuk sistem di mana sejumlah besar kueri diperlukan untuk ditangani sedangkan jumlah pembaruan basis data rendah.

Direplikasi Sebagian

Salinan tabel atau bagian tabel disimpan di situs berbeda. Distribusi tabel dilakukan sesuai dengan frekuensi akses. Ini mempertimbangkan fakta bahwa frekuensi mengakses tabel sangat bervariasi dari situs ke situs. Jumlah salinan tabel (atau bagian) bergantung pada seberapa sering kueri akses dijalankan dan situs yang menghasilkan kueri akses.

Terfragmentasi

Dalam desain ini, tabel dibagi menjadi dua atau lebih bagian yang disebut sebagai fragmen atau partisi, dan setiap fragmen dapat disimpan di situs yang berbeda. Ini mempertimbangkan fakta bahwa jarang terjadi bahwa semua data yang disimpan dalam tabel diperlukan di situs tertentu. Selain itu, fragmentasi meningkatkan paralelisme dan memberikan pemulihan bencana yang lebih baik. Di sini, hanya ada satu salinan dari setiap fragmen dalam sistem, yaitu tidak ada data yang berlebihan.

Tiga teknik fragmentasi adalah -

- Fragmentasi vertikal

- Fragmentasi horizontal

- Fragmentasi hibrida

Distribusi Campuran

Ini adalah kombinasi dari fragmentasi dan replikasi parsial. Di sini, tabel awalnya terfragmentasi dalam bentuk apa pun (horizontal atau vertikal), dan kemudian fragmen ini direplikasi sebagian di lokasi yang berbeda sesuai dengan frekuensi mengakses fragmen.

Pada bab terakhir, kami telah memperkenalkan alternatif desain yang berbeda. Dalam bab ini, kita akan mempelajari strategi yang membantu dalam mengadopsi desain. Strategi secara luas dapat dibagi menjadi replikasi dan fragmentasi. Namun, dalam banyak kasus, kombinasi keduanya digunakan.

Replikasi Data

Replikasi data adalah proses menyimpan salinan terpisah dari database di dua atau lebih situs. Ini adalah teknik toleransi kesalahan yang populer dari database terdistribusi.

Keuntungan Replikasi Data

Reliability - Jika terjadi kegagalan situs mana pun, sistem basis data terus berfungsi karena salinan tersedia di situs lain.

Reduction in Network Load- Karena salinan data lokal tersedia, pemrosesan kueri dapat dilakukan dengan pengurangan penggunaan jaringan, terutama selama jam utama. Pembaruan data dapat dilakukan di luar jam utama.

Quicker Response - Ketersediaan salinan data lokal memastikan pemrosesan kueri yang cepat dan waktu respons yang cepat.

Simpler Transactions- Transaksi memerlukan lebih sedikit jumlah gabungan tabel yang terletak di situs berbeda dan koordinasi minimal di seluruh jaringan. Dengan demikian, mereka menjadi lebih sederhana.

Kekurangan Replikasi Data

Increased Storage Requirements- Memelihara banyak salinan data dikaitkan dengan peningkatan biaya penyimpanan. Ruang penyimpanan yang dibutuhkan dalam kelipatan dari penyimpanan yang dibutuhkan untuk sistem terpusat.

Increased Cost and Complexity of Data Updating- Setiap kali item data diperbarui, pembaruan perlu diterapkan pada semua salinan data di situs yang berbeda. Ini membutuhkan teknik dan protokol sinkronisasi yang kompleks.

Undesirable Application – Database coupling- Jika mekanisme pembaruan yang kompleks tidak digunakan, menghapus inkonsistensi data memerlukan koordinasi yang kompleks di tingkat aplikasi. Ini menghasilkan aplikasi yang tidak diinginkan - penggandengan basis data.

Beberapa teknik replikasi yang umum digunakan adalah -

- Replikasi snapshot

- Replikasi hampir secara real-time

- Tarik replikasi

Fragmentasi

Fragmentasi adalah tugas membagi tabel menjadi satu set tabel yang lebih kecil. Bagian dari tabel disebutfragments. Fragmentasi dapat terdiri dari tiga jenis: horizontal, vertikal, dan hibrida (kombinasi horizontal dan vertikal). Fragmentasi horizontal selanjutnya dapat diklasifikasikan menjadi dua teknik: fragmentasi horizontal primer dan fragmentasi horizontal turunan.

Fragmentasi harus dilakukan sedemikian rupa sehingga tabel asli dapat direkonstruksi dari fragmen. Ini diperlukan agar tabel asli dapat direkonstruksi dari fragmen kapan pun diperlukan. Persyaratan ini disebut "rekonstruktif".

Keuntungan Fragmentasi

Karena data disimpan dekat dengan lokasi penggunaan, efisiensi sistem database meningkat.

Teknik pengoptimalan kueri lokal sudah cukup untuk sebagian besar kueri karena data tersedia secara lokal.

Karena data yang tidak relevan tidak tersedia di situs, keamanan dan privasi sistem database dapat dipertahankan.

Kerugian dari Fragmentasi

Ketika data dari fragmen berbeda diperlukan, kecepatan akses mungkin sangat tinggi.

Dalam kasus fragmentasi rekursif, pekerjaan rekonstruksi membutuhkan teknik yang mahal.

Kurangnya salinan cadangan data di situs yang berbeda dapat membuat database tidak efektif jika terjadi kegagalan situs.

Fragmentasi Vertikal

Dalam fragmentasi vertikal, bidang atau kolom tabel dikelompokkan menjadi beberapa fragmen. Untuk menjaga rekonstruksi, setiap fragmen harus berisi bidang kunci utama pada tabel. Fragmentasi vertikal dapat digunakan untuk menegakkan privasi data.

Misalnya, mari kita pertimbangkan bahwa database Universitas menyimpan catatan semua siswa yang terdaftar dalam tabel Mahasiswa yang memiliki skema berikut.

SISWA

| Regd_No | Nama | Kursus | Alamat | Semester | Biaya | Tanda |

Sekarang, rincian biaya disimpan di bagian akun. Dalam kasus ini, desainer akan memecah database sebagai berikut -

CREATE TABLE STD_FEES AS

SELECT Regd_No, Fees

FROM STUDENT;Fragmentasi Horizontal

Fragmentasi horizontal mengelompokkan tupel tabel sesuai dengan nilai dari satu atau lebih bidang. Fragmentasi horizontal juga harus sesuai dengan aturan rekonstruksi. Setiap fragmen horizontal harus memiliki semua kolom dari tabel dasar asli.

Sebagai contoh, dalam skema kemahasiswaan, jika detail seluruh mahasiswa Mata Kuliah Ilmu Komputer perlu dipertahankan di Sekolah Ilmu Komputer, maka perancang akan memecah basis data secara horizontal sebagai berikut -

CREATE COMP_STD AS

SELECT * FROM STUDENT

WHERE COURSE = "Computer Science";Fragmentasi Hibrid

Dalam fragmentasi hibrid, kombinasi teknik fragmentasi horizontal dan vertikal digunakan. Ini adalah teknik fragmentasi paling fleksibel karena teknik ini menghasilkan fragmen dengan informasi asing yang minimal. Namun, rekonstruksi tabel asli seringkali merupakan tugas yang mahal.

Fragmentasi hibrida dapat dilakukan dengan dua cara alternatif -

Pertama, buat satu set fragmen horizontal; kemudian buat fragmen vertikal dari satu atau lebih fragmen horizontal.

Pertama, buat satu set fragmen vertikal; kemudian buat fragmen horizontal dari satu atau lebih fragmen vertikal.

Transparansi distribusi adalah properti dari basis data terdistribusi berdasarkan detail internal distribusi yang disembunyikan dari pengguna. Perancang DDBMS dapat memilih untuk memecah tabel, mereplikasi fragmen dan menyimpannya di situs yang berbeda. Namun, karena pengguna tidak menyadari detail ini, mereka merasa database terdistribusi mudah digunakan seperti database terpusat.

Tiga dimensi transparansi distribusi adalah -

- Transparansi lokasi

- Transparansi fragmentasi

- Transparansi replikasi

Transparansi Lokasi

Transparansi lokasi memastikan bahwa pengguna dapat membuat kueri pada tabel atau fragmen apa pun dari tabel seolah-olah disimpan secara lokal di situs pengguna. Fakta bahwa tabel atau fragmennya disimpan di situs jarak jauh dalam sistem database terdistribusi, harus sepenuhnya dilupakan oleh pengguna akhir. Alamat situs jarak jauh dan mekanisme akses sepenuhnya tersembunyi.

Untuk menerapkan transparansi lokasi, DDBMS harus memiliki akses ke kamus data dan direktori DDBMS yang diperbarui dan akurat yang berisi detail lokasi data.

Transparansi Fragmentasi

Transparansi fragmentasi memungkinkan pengguna untuk melakukan kueri di atas tabel mana pun seolah-olah tidak terfragmentasi. Jadi, ini menyembunyikan fakta bahwa tabel yang di-kueri pengguna sebenarnya adalah fragmen atau gabungan dari beberapa fragmen. Ini juga menyembunyikan fakta bahwa fragmen-fragmen tersebut berada di berbagai lokasi.

Ini agak mirip dengan pengguna tampilan SQL, di mana pengguna mungkin tidak tahu bahwa mereka menggunakan tampilan tabel dan bukan tabel itu sendiri.

Transparansi Replikasi

Transparansi replikasi memastikan bahwa replikasi database disembunyikan dari pengguna. Ini memungkinkan pengguna untuk melakukan kueri di atas tabel seolah-olah hanya ada satu salinan tabel.

Transparansi replikasi dikaitkan dengan transparansi konkurensi dan transparansi kegagalan. Setiap kali pengguna memperbarui item data, pembaruan tersebut tercermin di semua salinan tabel. Namun, operasi ini tidak boleh diketahui oleh pengguna. Ini adalah transparansi konkurensi. Selain itu, jika terjadi kegagalan situs, pengguna masih dapat melanjutkan permintaannya menggunakan salinan yang direplikasi tanpa mengetahui kegagalan. Ini adalah transparansi kegagalan.

Kombinasi Transparansi

Dalam sistem basis data terdistribusi, perancang harus memastikan bahwa semua transparansi yang dinyatakan dipertahankan sampai batas tertentu. Perancang dapat memilih untuk memecah tabel, mereplikasi dan menyimpannya di situs yang berbeda; semua tidak menyadari pengguna akhir. Namun, transparansi distribusi yang lengkap adalah tugas yang berat dan membutuhkan upaya desain yang cukup besar.

Kontrol database mengacu pada tugas menegakkan peraturan untuk memberikan data yang benar kepada pengguna dan aplikasi database yang otentik. Agar data yang benar tersedia bagi pengguna, semua data harus sesuai dengan batasan integritas yang ditentukan dalam database. Selain itu, data harus disaring jauh dari pengguna yang tidak sah untuk menjaga keamanan dan privasi database. Kontrol database adalah salah satu tugas utama administrator database (DBA).

Tiga dimensi kontrol database adalah -

- Authentication

- Hak akses

- Batasan integritas

Autentikasi

Dalam sistem database terdistribusi, otentikasi adalah proses di mana hanya pengguna yang sah yang dapat memperoleh akses ke sumber data.

Otentikasi dapat diterapkan dalam dua tingkat -

Controlling Access to Client Computer- Pada level ini, akses pengguna dibatasi saat login ke komputer klien yang menyediakan antarmuka pengguna ke server database. Metode yang paling umum adalah kombinasi nama pengguna / kata sandi. Namun, metode yang lebih canggih seperti otentikasi biometrik dapat digunakan untuk data dengan keamanan tinggi.

Controlling Access to the Database Software- Pada level ini, perangkat lunak / administrator database memberikan beberapa kredensial kepada pengguna. Pengguna mendapatkan akses ke database menggunakan kredensial ini. Salah satu caranya adalah dengan membuat akun login di dalam database server.

Hak akses

Hak akses pengguna mengacu pada hak istimewa yang diberikan pengguna terkait operasi DBMS seperti hak untuk membuat tabel, menjatuhkan tabel, menambah / menghapus / memperbarui tupel dalam tabel atau permintaan di atas tabel.

Dalam lingkungan terdistribusi, karena ada sejumlah besar tabel dan jumlah pengguna yang lebih banyak, tidaklah layak untuk menetapkan hak akses individu kepada pengguna. Jadi, DDBMS mendefinisikan peran tertentu. Peran adalah konstruksi dengan hak istimewa tertentu dalam sistem database. Setelah peran yang berbeda ditentukan, pengguna individu diberi salah satu peran ini. Seringkali hierarki peran didefinisikan sesuai dengan hierarki otoritas dan tanggung jawab organisasi.

Misalnya, pernyataan SQL berikut membuat peran "Akuntan" dan kemudian menetapkan peran ini ke pengguna "ABC".

CREATE ROLE ACCOUNTANT;

GRANT SELECT, INSERT, UPDATE ON EMP_SAL TO ACCOUNTANT;

GRANT INSERT, UPDATE, DELETE ON TENDER TO ACCOUNTANT;

GRANT INSERT, SELECT ON EXPENSE TO ACCOUNTANT;

COMMIT;

GRANT ACCOUNTANT TO ABC;

COMMIT;Kontrol Integritas Semantik

Kontrol integritas semantik mendefinisikan dan memberlakukan batasan integritas sistem database.

Batasan integritas adalah sebagai berikut -

- Batasan integritas tipe data

- Batasan integritas entitas

- Batasan integritas referensial

Batasan Integritas Jenis Data

Batasan tipe data membatasi rentang nilai dan tipe operasi yang dapat diterapkan ke bidang dengan tipe data yang ditentukan.

Misalnya, mari kita pertimbangkan bahwa tabel "HOSTEL" memiliki tiga bidang - nomor asrama, nama asrama, dan kapasitas. Nomor asrama harus dimulai dengan huruf kapital "H" dan tidak boleh NULL, dan kapasitas tidak boleh lebih dari 150. Perintah SQL berikut dapat digunakan untuk definisi data -

CREATE TABLE HOSTEL (

H_NO VARCHAR2(5) NOT NULL,

H_NAME VARCHAR2(15),

CAPACITY INTEGER,

CHECK ( H_NO LIKE 'H%'),

CHECK ( CAPACITY <= 150)

);Kontrol Integritas Entitas

Kontrol integritas entitas memberlakukan aturan sehingga setiap tupel dapat diidentifikasi secara unik dari tupel lain. Untuk ini kunci utama ditentukan. Kunci utama adalah sekumpulan bidang minimal yang dapat mengidentifikasi tupel secara unik. Batasan integritas entitas menyatakan bahwa tidak ada dua tupel dalam tabel yang dapat memiliki nilai identik untuk kunci primer dan tidak ada bidang yang merupakan bagian dari kunci primer yang dapat memiliki nilai NULL.

Misalnya, dalam tabel hostel di atas, nomor hostel dapat ditetapkan sebagai kunci utama melalui pernyataan SQL berikut (mengabaikan pemeriksaan) -

CREATE TABLE HOSTEL (

H_NO VARCHAR2(5) PRIMARY KEY,

H_NAME VARCHAR2(15),

CAPACITY INTEGER

);Batasan Integritas Referensial

Batasan integritas referensial menetapkan aturan kunci asing. Kunci asing adalah bidang dalam tabel data yang merupakan kunci utama dari tabel terkait. Batasan integritas referensial menetapkan aturan bahwa nilai bidang kunci asing harus berada di antara nilai kunci utama tabel yang direferensikan atau seluruhnya NULL.

Misalnya, mari kita pertimbangkan meja siswa di mana siswa dapat memilih untuk tinggal di asrama. Untuk memasukkan ini, kunci utama tabel asrama harus dimasukkan sebagai kunci asing di tabel siswa. Pernyataan SQL berikut menggabungkan ini -

CREATE TABLE STUDENT (

S_ROLL INTEGER PRIMARY KEY,

S_NAME VARCHAR2(25) NOT NULL,

S_COURSE VARCHAR2(10),

S_HOSTEL VARCHAR2(5) REFERENCES HOSTEL

);Saat kueri ditempatkan, kueri itu pertama kali dipindai, diurai, dan divalidasi. Representasi internal dari kueri kemudian dibuat seperti pohon kueri atau grafik kueri. Kemudian strategi eksekusi alternatif dirancang untuk mengambil hasil dari tabel database. Proses memilih strategi eksekusi yang paling tepat untuk pemrosesan kueri disebut optimasi kueri.

Masalah Optimasi Kueri di DDBMS

Di DDBMS, pengoptimalan kueri adalah tugas penting. Kompleksitasnya tinggi karena jumlah strategi alternatif dapat meningkat secara eksponensial karena faktor-faktor berikut -

- Kehadiran sejumlah fragmen.

- Distribusi fragmen atau tabel di berbagai situs.

- Kecepatan tautan komunikasi.

- Perbedaan dalam kemampuan pemrosesan lokal.

Oleh karena itu, dalam sistem terdistribusi, target sering kali menemukan strategi eksekusi yang baik untuk pemrosesan kueri daripada yang terbaik. Waktu untuk mengeksekusi kueri adalah jumlah dari berikut ini -

- Waktu untuk mengkomunikasikan pertanyaan ke database.

- Waktu untuk mengeksekusi fragmen kueri lokal.

- Saatnya mengumpulkan data dari situs yang berbeda.

- Saatnya menampilkan hasil ke aplikasi.

Pemrosesan Kueri

Pemrosesan kueri adalah sekumpulan semua aktivitas mulai dari penempatan kueri hingga menampilkan hasil kueri. Langkah-langkahnya seperti yang ditunjukkan pada diagram berikut -

Aljabar Relasional

Aljabar relasional mendefinisikan himpunan operasi dasar model database relasional. Urutan operasi aljabar relasional membentuk ekspresi aljabar relasional. Hasil ekspresi ini mewakili hasil query database.

Operasi dasarnya adalah -

- Projection

- Selection

- Union

- Intersection

- Minus

- Join

Proyeksi

Operasi proyeksi menampilkan subset bidang tabel. Ini memberikan partisi vertikal pada tabel.

Syntax in Relational Algebra

$$ \ pi _ {<{AttributeList}>} {(<{Table Name}>)} $$

Sebagai contoh, mari kita pertimbangkan database siswa berikut -

|

|

||||

| Roll_No | Name | Course | Semester | Gender |

| 2 | Amit Prasad | BCA | 1 | Pria |

| 4 | Varsha Tiwari | BCA | 1 | Perempuan |

| 5 | Asif Ali | MCA | 2 | Pria |

| 6 | Joe Wallace | MCA | 1 | Pria |

| 8 | Shivani Iyengar | BCA | 1 | Perempuan |

Jika kami ingin menampilkan nama dan mata kuliah semua siswa, kami akan menggunakan ekspresi aljabar relasional berikut -

$$\pi_{Name,Course}{(STUDENT)}$$

Pilihan

Operasi pemilihan menampilkan subset tupel tabel yang memenuhi kondisi tertentu. Ini memberikan partisi horizontal pada tabel.

Syntax in Relational Algebra

$$ \ sigma _ {<{Kondisi}>} {(<{Nama Tabel}>)} $$

Misalnya, dalam tabel Siswa, jika kami ingin menampilkan detail dari semua siswa yang telah memilih kursus MCA, kami akan menggunakan ekspresi aljabar relasional berikut -

$$\sigma_{Course} = {\small "BCA"}^{(STUDENT)}$$

Kombinasi Operasi Proyeksi dan Seleksi

Untuk sebagian besar kueri, kami memerlukan kombinasi operasi proyeksi dan pemilihan. Ada dua cara untuk menulis ekspresi ini -

- Menggunakan urutan operasi proyeksi dan pemilihan.

- Menggunakan operasi ganti nama untuk menghasilkan hasil antara.

Misalnya untuk menampilkan nama semua siswi mata kuliah BCA -

- Ekspresi aljabar relasional menggunakan urutan operasi proyeksi dan seleksi

$$\pi_{Name}(\sigma_{Gender = \small "Female" AND \: Course = \small "BCA"}{(STUDENT)})$$

- Ekspresi aljabar relasional menggunakan operasi ganti nama untuk menghasilkan hasil antara

$$FemaleBCAStudent \leftarrow \sigma_{Gender = \small "Female" AND \: Course = \small "BCA"} {(STUDENT)}$$

$$Result \leftarrow \pi_{Name}{(FemaleBCAStudent)}$$

Persatuan

Jika P adalah hasil dari operasi dan Q adalah hasil dari operasi lain, penyatuan P dan Q ($p \cup Q$) adalah himpunan semua tupel yang ada di P atau di Q atau di keduanya tanpa duplikat.

Misalnya untuk menampilkan semua mahasiswa baik yang sedang semester 1 maupun yang sedang kuliah di BCA -

$$Sem1Student \leftarrow \sigma_{Semester = 1}{(STUDENT)}$$

$$BCAStudent \leftarrow \sigma_{Course = \small "BCA"}{(STUDENT)}$$

$$Result \leftarrow Sem1Student \cup BCAStudent$$

Persimpangan

Jika P adalah hasil operasi dan Q adalah hasil operasi lain, perpotongan P dan Q ( $p \cap Q$ ) adalah himpunan dari semua tupel yang ada di P dan Q keduanya.

Misalnya, diberikan dua skema berikut -

EMPLOYEE

| EmpID | Nama | Kota | Departemen | Gaji |

PROJECT

| PId | Kota | Departemen | Status |

Untuk menampilkan nama semua kota tempat proyek berada dan juga karyawan tinggal -

$$CityEmp \leftarrow \pi_{City}{(EMPLOYEE)}$$

$$CityProject \leftarrow \pi_{City}{(PROJECT)}$$

$$Result \leftarrow CityEmp \cap CityProject$$

Minus

Jika P adalah hasil dari operasi dan Q adalah hasil dari operasi lain, P - Q adalah himpunan semua tupel yang ada di P dan bukan di Q.

Misalnya, untuk membuat daftar semua departemen yang tidak memiliki proyek yang sedang berjalan (proyek dengan status = sedang berlangsung) -

$$AllDept \leftarrow \pi_{Department}{(EMPLOYEE)}$$

$$ProjectDept \leftarrow \pi_{Department} (\sigma_{Status = \small "ongoing"}{(PROJECT)})$$

$$Result \leftarrow AllDept - ProjectDept$$

Ikuti

Operasi gabungan menggabungkan tupel terkait dari dua tabel berbeda (hasil kueri) ke dalam satu tabel.

Misalnya, pertimbangkan dua skema, Pelanggan dan Cabang dalam database Bank sebagai berikut -

CUSTOMER

| CustID | AccNo | TypeOfAc | BranchID | DateOfOpening |

BRANCH

| BranchID | Nama cabang | Kode IFSC | Alamat |

Untuk membuat daftar detail karyawan bersama dengan detail cabang -

$$Result \leftarrow CUSTOMER \bowtie_{Customer.BranchID=Branch.BranchID}{BRANCH}$$

Menerjemahkan Kueri SQL ke dalam Aljabar Relasional

Kueri SQL diterjemahkan ke dalam ekspresi aljabar relasional yang setara sebelum pengoptimalan. Kueri pada awalnya diuraikan menjadi blok kueri yang lebih kecil. Blok-blok ini diterjemahkan ke ekspresi aljabar relasional yang setara. Pengoptimalan mencakup pengoptimalan setiap blok dan kemudian pengoptimalan kueri secara keseluruhan.

Contoh

Mari kita pertimbangkan skema berikut -

KARYAWAN

| EmpID | Nama | Kota | Departemen | Gaji |

PROYEK

| PId | Kota | Departemen | Status |

KARYA

| EmpID | PID | Jam |

Contoh 1

Untuk menampilkan detail semua karyawan yang mendapatkan gaji KURANG dari gaji rata-rata, kami menulis kueri SQL -

SELECT * FROM EMPLOYEE

WHERE SALARY < ( SELECT AVERAGE(SALARY) FROM EMPLOYEE ) ;Kueri ini berisi satu sub-kueri bertingkat. Jadi, ini bisa dipecah menjadi dua blok.

Blok bagian dalam adalah -

SELECT AVERAGE(SALARY)FROM EMPLOYEE ;Jika hasil dari query ini adalah AvgSal, maka blok luar adalah -

SELECT * FROM EMPLOYEE WHERE SALARY < AvgSal;Ekspresi aljabar relasional untuk blok dalam -

$$AvgSal \leftarrow \Im_{AVERAGE(Salary)}{EMPLOYEE}$$

Ekspresi aljabar relasional untuk blok luar -

$$ \ sigma_ {Gaji <{AvgSal}>} {EMPLOYEE} $$

Contoh 2

Untuk menampilkan ID proyek dan status semua proyek karyawan 'Arun Kumar', kami menulis kueri SQL -

SELECT PID, STATUS FROM PROJECT

WHERE PID = ( SELECT FROM WORKS WHERE EMPID = ( SELECT EMPID FROM EMPLOYEE

WHERE NAME = 'ARUN KUMAR'));Kueri ini berisi dua sub-kueri bertingkat. Dengan demikian, dapat dipecah menjadi tiga blok, sebagai berikut -

SELECT EMPID FROM EMPLOYEE WHERE NAME = 'ARUN KUMAR';

SELECT PID FROM WORKS WHERE EMPID = ArunEmpID;

SELECT PID, STATUS FROM PROJECT WHERE PID = ArunPID;(Di sini ArunEmpID dan ArunPID adalah hasil dari kueri dalam)

Ekspresi aljabar relasional untuk ketiga blok tersebut adalah -

$$ArunEmpID \leftarrow \pi_{EmpID}(\sigma_{Name = \small "Arun Kumar"} {(EMPLOYEE)})$$

$$ArunPID \leftarrow \pi_{PID}(\sigma_{EmpID = \small "ArunEmpID"} {(WORKS)})$$

$$Result \leftarrow \pi_{PID, Status}(\sigma_{PID = \small "ArunPID"} {(PROJECT)})$$

Perhitungan Operator Aljabar Relasional

Perhitungan operator aljabar relasional dapat dilakukan dengan berbagai cara, dan setiap alternatif disebut an access path.

Alternatif komputasi bergantung pada tiga faktor utama -

- Jenis operator

- Memori yang tersedia

- Struktur disk

Waktu untuk melaksanakan operasi aljabar relasional adalah jumlah dari -

- Saatnya memproses tupel.

- Saatnya mengambil tupel tabel dari disk ke memori.

Karena waktu untuk memproses tupel jauh lebih kecil daripada waktu untuk mengambil tupel dari penyimpanan, terutama dalam sistem terdistribusi, akses disk sering kali dianggap sebagai metrik untuk menghitung biaya ekspresi relasional.

Perhitungan Seleksi

Perhitungan operasi pemilihan bergantung pada kompleksitas kondisi pemilihan dan ketersediaan indeks pada atribut tabel.

Berikut ini adalah alternatif komputasi tergantung pada indeks -

No Index- Jika tabel tidak diurutkan dan tidak memiliki indeks, maka proses pemilihan melibatkan pemindaian semua blok disk tabel. Setiap blok dibawa ke dalam memori dan setiap tupel di blok tersebut diperiksa untuk melihat apakah memenuhi kondisi pemilihan. Jika kondisinya terpenuhi, maka akan ditampilkan sebagai output. Ini adalah pendekatan yang paling mahal karena setiap tupel dibawa ke dalam memori dan setiap tupel diproses.

B+ Tree Index- Kebanyakan sistem database dibangun di atas indeks B + Tree. Jika kondisi pemilihan didasarkan pada bidang, yang merupakan kunci dari indeks Pohon B + ini, maka indeks ini digunakan untuk mengambil hasil. Namun, memproses pernyataan pemilihan dengan kondisi kompleks mungkin melibatkan lebih banyak akses blok disk dan dalam beberapa kasus pemindaian lengkap atas tabel.

Hash Index- Jika indeks hash digunakan dan bidang kuncinya digunakan dalam kondisi pemilihan, maka mengambil tupel menggunakan indeks hash menjadi proses yang sederhana. Indeks hash menggunakan fungsi hash untuk menemukan alamat bucket tempat nilai kunci yang sesuai dengan nilai hash disimpan. Untuk menemukan nilai kunci dalam indeks, fungsi hash dijalankan dan alamat keranjang ditemukan. Nilai kunci di keranjang dicari. Jika kecocokan ditemukan, tupel sebenarnya diambil dari blok disk ke dalam memori.

Perhitungan Gabungan

Ketika kita ingin menggabungkan dua tabel, katakanlah P dan Q, setiap tupel di P harus dibandingkan dengan setiap tupel di Q untuk menguji apakah kondisi penggabungan terpenuhi. Jika kondisinya terpenuhi, tupel yang sesuai akan digabungkan, menghilangkan bidang duplikat dan ditambahkan ke relasi hasil. Akibatnya, ini adalah operasi yang paling mahal.

Pendekatan umum untuk menghitung gabungan adalah -

Pendekatan Nested-loop

Ini adalah pendekatan gabungan konvensional. Ini dapat diilustrasikan melalui pseudocode berikut (Tabel P dan Q, dengan tuple tuple_p dan tuple_q dan bergabung dengan atribut a) -

For each tuple_p in P

For each tuple_q in Q

If tuple_p.a = tuple_q.a Then

Concatenate tuple_p and tuple_q and append to Result

End If

Next tuple_q

Next tuple-pPendekatan Sort-merge

Dalam pendekatan ini, dua tabel diurutkan secara individual berdasarkan atribut penggabungan dan kemudian tabel yang diurutkan digabungkan. Teknik penyortiran eksternal diadopsi karena jumlah record sangat tinggi dan tidak dapat diakomodasi dalam memori. Setelah tabel individu diurutkan, satu halaman setiap tabel yang diurutkan dibawa ke memori, digabungkan berdasarkan atribut join dan tupel yang digabungkan ditulis.

Pendekatan Hash-join

Pendekatan ini terdiri dari dua fase: fase partisi dan fase probing. Dalam fase pemartisian, tabel P dan Q dipecah menjadi dua set partisi yang saling terpisah. Fungsi hash umum diputuskan. Fungsi hash ini digunakan untuk menetapkan tupel ke partisi. Dalam fase probing, tupel dalam partisi P dibandingkan dengan tupel dari partisi Q yang sesuai. Jika cocok, maka tupel tersebut akan ditulis.

Setelah jalur akses alternatif untuk komputasi ekspresi aljabar relasional diturunkan, jalur akses optimal ditentukan. Pada bab ini, kita akan melihat optimasi query dalam sistem terpusat sedangkan pada bab berikutnya kita akan mempelajari optimasi query dalam sistem terdistribusi.

Dalam sistem terpusat, pemrosesan kueri dilakukan dengan tujuan berikut -

Meminimalkan waktu respons kueri (waktu yang dibutuhkan untuk menghasilkan hasil untuk kueri pengguna).

Maksimalkan throughput sistem (jumlah permintaan yang diproses dalam jangka waktu tertentu).

Kurangi jumlah memori dan penyimpanan yang diperlukan untuk pemrosesan.

Tingkatkan paralelisme.

Query Parsing dan Terjemahan

Awalnya, kueri SQL dipindai. Kemudian diurai untuk mencari kesalahan sintaksis dan ketepatan tipe data. Jika kueri melewati langkah ini, kueri diuraikan menjadi blok kueri yang lebih kecil. Setiap blok kemudian diterjemahkan ke ekspresi aljabar relasional yang setara.

Langkah-langkah untuk Pengoptimalan Kueri

Pengoptimalan kueri melibatkan tiga langkah, yaitu pembuatan pohon kueri, pembuatan rencana, dan pembuatan kode rencana kueri.

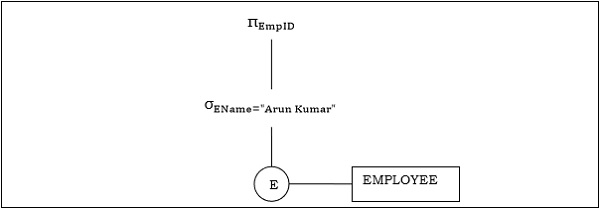

Step 1 − Query Tree Generation

Pohon kueri adalah struktur data pohon yang mewakili ekspresi aljabar relasional. Tabel kueri direpresentasikan sebagai node daun. Operasi aljabar relasional direpresentasikan sebagai node internal. Akar mewakili kueri secara keseluruhan.

Selama eksekusi, node internal dieksekusi setiap kali tabel operannya tersedia. Node tersebut kemudian diganti dengan tabel hasil. Proses ini berlanjut untuk semua node internal sampai node root dijalankan dan diganti dengan tabel hasil.

Sebagai contoh, mari kita pertimbangkan skema berikut -

KARYAWAN

| EmpID | EName | Gaji | DeptNo | Tanggal Bergabung |

DEPARTEMEN

| DNo | DName | Lokasi |

Contoh 1

Mari kita pertimbangkan kueri sebagai berikut.

$$\pi_{EmpID} (\sigma_{EName = \small "ArunKumar"} {(EMPLOYEE)})$$

Pohon kueri terkait akan menjadi -

Contoh 2

Mari kita pertimbangkan kueri lain yang melibatkan gabungan.

$\pi_{EName, Salary} (\sigma_{DName = \small "Marketing"} {(DEPARTMENT)}) \bowtie_{DNo=DeptNo}{(EMPLOYEE)}$

Berikut adalah pohon kueri untuk kueri di atas.

Step 2 − Query Plan Generation

Setelah pohon kueri dibuat, rencana kueri dibuat. Rencana kueri adalah pohon kueri yang diperluas yang menyertakan jalur akses untuk semua operasi di pohon kueri. Jalur akses menentukan bagaimana operasi relasional di pohon harus dilakukan. Misalnya, operasi pemilihan dapat memiliki jalur akses yang memberikan detail tentang penggunaan indeks pohon B + untuk pemilihan.

Selain itu, rencana kueri juga menyatakan bagaimana tabel perantara harus diteruskan dari satu operator ke operator berikutnya, bagaimana tabel sementara harus digunakan dan bagaimana operasi harus dialirkan / digabungkan.

Step 3− Code Generation

Pembuatan kode adalah langkah terakhir dalam pengoptimalan kueri. Ini adalah bentuk kueri yang dapat dieksekusi, yang bentuknya bergantung pada jenis sistem operasi yang mendasarinya. Setelah kode kueri dibuat, Manajer Eksekusi menjalankannya dan menghasilkan hasilnya.

Pendekatan untuk Pengoptimalan Kueri

Di antara pendekatan untuk pengoptimalan kueri, pencarian lengkap dan algoritme berbasis heuristik banyak digunakan.

Optimasi Pencarian Lengkap

Dalam teknik ini, untuk kueri, semua kemungkinan rencana kueri awalnya dibuat dan kemudian rencana terbaik dipilih. Meskipun teknik ini memberikan solusi terbaik, teknik ini memiliki kompleksitas ruang dan waktu eksponensial karena ruang solusi yang besar. Misalnya teknik pemrograman dinamis.

Optimasi Berbasis Heuristik

Pengoptimalan berbasis heuristik menggunakan pendekatan pengoptimalan berbasis aturan untuk pengoptimalan kueri. Algoritme ini memiliki kompleksitas ruang dan waktu polinomial, yang lebih rendah daripada kompleksitas eksponensial dari algoritme berbasis pencarian yang lengkap. Namun, algoritme ini tidak selalu menghasilkan rencana kueri terbaik.

Beberapa aturan heuristik yang umum adalah -

Lakukan operasi pilih dan proyek sebelum bergabung dengan operasi. Ini dilakukan dengan memindahkan operasi pilih dan proyek ke bawah pohon kueri. Ini mengurangi jumlah tupel yang tersedia untuk digabungkan.

Lakukan operasi pemilihan / proyek yang paling ketat pada awalnya sebelum operasi lainnya.

Hindari operasi produk silang karena menghasilkan tabel perantara berukuran sangat besar.

Bab ini membahas tentang optimasi query pada sistem database terdistribusi.

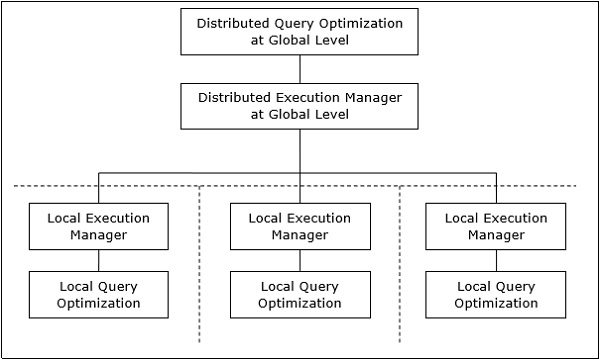

Arsitektur Pemrosesan Kueri Terdistribusi

Dalam sistem database terdistribusi, pemrosesan kueri terdiri dari pengoptimalan di tingkat global dan lokal. Kueri memasuki sistem database di klien atau situs pengendali. Di sini, pengguna divalidasi, kueri diperiksa, diterjemahkan, dan dioptimalkan di tingkat global.

Arsitekturnya dapat direpresentasikan sebagai -

Memetakan Kueri Global ke Kueri Lokal

Proses pemetaan kueri global ke kueri lokal dapat diwujudkan sebagai berikut -

Tabel yang diperlukan dalam kueri global memiliki fragmen yang didistribusikan ke beberapa situs. Basis data lokal memiliki informasi hanya tentang data lokal. Situs pengendali menggunakan kamus data global untuk mengumpulkan informasi tentang distribusi dan merekonstruksi tampilan global dari fragmen.

Jika tidak ada replikasi, pengoptimal global menjalankan kueri lokal di situs tempat fragmen disimpan. Jika ada replikasi, pengoptimal global memilih situs berdasarkan biaya komunikasi, beban kerja, dan kecepatan server.

Pengoptimal global menghasilkan rencana eksekusi terdistribusi sehingga jumlah transfer data paling sedikit terjadi di seluruh situs. Rencana tersebut menyatakan lokasi fragmen, urutan langkah-langkah kueri yang perlu dijalankan dan proses yang terlibat dalam mentransfer hasil antara.

Kueri lokal dioptimalkan oleh server database lokal. Akhirnya, hasil kueri lokal digabungkan bersama melalui operasi gabungan dalam kasus fragmen horizontal dan operasi gabungan untuk fragmen vertikal.

Sebagai contoh, mari kita pertimbangkan bahwa skema Proyek berikut ini terpecah-pecah secara horizontal menurut Kota, kota-kota tersebut adalah New Delhi, Kolkata, dan Hyderabad.

PROYEK

| PId | Kota | Departemen | Status |

Misalkan ada kueri untuk mengambil detail dari semua proyek yang statusnya "Sedang Berlangsung".

Kueri global akan menjadi & inus;

$$\sigma_{status} = {\small "ongoing"}^{(PROJECT)}$$

Permintaan di server New Delhi akan -

$$\sigma_{status} = {\small "ongoing"}^{({NewD}_-{PROJECT})}$$

Permintaan di server Kolkata akan -

$$\sigma_{status} = {\small "ongoing"}^{({Kol}_-{PROJECT})}$$

Permintaan di server Hyderabad akan -

$$\sigma_{status} = {\small "ongoing"}^{({Hyd}_-{PROJECT})}$$

Untuk mendapatkan hasil keseluruhan, kita perlu menggabungkan hasil dari tiga query sebagai berikut -

$\sigma_{status} = {\small "ongoing"}^{({NewD}_-{PROJECT})} \cup \sigma_{status} = {\small "ongoing"}^{({kol}_-{PROJECT})} \cup \sigma_{status} = {\small "ongoing"}^{({Hyd}_-{PROJECT})}$

Pengoptimalan Kueri Terdistribusi

Pengoptimalan kueri terdistribusi memerlukan evaluasi sejumlah besar pohon kueri yang masing-masing menghasilkan hasil kueri yang diperlukan. Ini terutama karena adanya sejumlah besar data yang direplikasi dan terfragmentasi. Oleh karena itu, targetnya adalah menemukan solusi optimal, bukan solusi terbaik.

Masalah utama untuk pengoptimalan kueri terdistribusi adalah -

- Pemanfaatan sumber daya secara optimal dalam sistem terdistribusi.

- Query trading.

- Pengurangan ruang solusi kueri.

Pemanfaatan Sumber Daya Secara Optimal dalam Sistem Terdistribusi

Sistem terdistribusi memiliki sejumlah server database di berbagai situs untuk melakukan operasi yang berkaitan dengan kueri. Berikut adalah pendekatan untuk pemanfaatan sumber daya yang optimal -

Operation Shipping- Dalam operasi pengiriman, operasi dijalankan di situs tempat data disimpan dan bukan di situs klien. Hasilnya kemudian ditransfer ke situs klien. Ini sesuai untuk operasi yang operandnya tersedia di lokasi yang sama. Contoh: Operasi Select dan Project.

Data Shipping- Dalam pengiriman data, fragmen data ditransfer ke server database, tempat operasi dijalankan. Ini digunakan dalam operasi di mana operan didistribusikan di situs yang berbeda. Ini juga sesuai dalam sistem di mana biaya komunikasinya rendah, dan prosesor lokal jauh lebih lambat daripada server klien.

Hybrid Shipping- Ini adalah kombinasi dari pengiriman data dan operasi. Di sini, fragmen data ditransfer ke prosesor berkecepatan tinggi, tempat operasi dijalankan. Hasilnya kemudian dikirim ke situs klien.

Query Trading

Dalam algoritme perdagangan kueri untuk sistem basis data terdistribusi, situs pengendali / klien untuk kueri terdistribusi disebut pembeli dan situs tempat kueri lokal dieksekusi disebut penjual. Pembeli merumuskan sejumlah alternatif untuk memilih penjual dan merekonstruksi hasil global. Target pembeli adalah mencapai biaya yang optimal.

Algoritme dimulai dengan pembeli menetapkan sub-kueri ke situs penjual. Rencana optimal dibuat dari rencana permintaan yang dioptimalkan secara lokal yang diusulkan oleh penjual dikombinasikan dengan biaya komunikasi untuk merekonstruksi hasil akhir. Setelah rencana optimal global dirumuskan, kueri dijalankan.

Pengurangan Ruang Solusi dari Query

Solusi optimal umumnya melibatkan pengurangan ruang solusi sehingga biaya kueri dan transfer data berkurang. Ini dapat dicapai melalui seperangkat aturan heuristik, seperti halnya heuristik dalam sistem terpusat.

Berikut adalah beberapa aturannya -

Lakukan operasi pemilihan dan proyeksi sedini mungkin. Ini mengurangi aliran data melalui jaringan komunikasi.

Sederhanakan operasi pada fragmen horizontal dengan menghilangkan kondisi pemilihan yang tidak relevan dengan lokasi tertentu.

Dalam kasus operasi gabungan dan gabungan yang terdiri dari fragmen yang terletak di beberapa lokasi, transfer data terfragmentasi ke situs di mana sebagian besar datanya ada dan lakukan operasi di sana.

Gunakan operasi semi-join untuk memenuhi syarat tupel yang akan digabungkan. Ini mengurangi jumlah transfer data yang pada akhirnya mengurangi biaya komunikasi.

Gabungkan daun dan sub-pohon umum dalam pohon kueri terdistribusi.

Bab ini membahas berbagai aspek pemrosesan transaksi. Kami juga akan mempelajari tugas tingkat rendah yang termasuk dalam transaksi, status transaksi, dan properti transaksi. Di bagian terakhir, kita akan melihat jadwal dan serialisasi jadwal.

Transaksi

Transaksi adalah program yang mencakup kumpulan operasi database, yang dijalankan sebagai unit logis dari pemrosesan data. Operasi yang dilakukan dalam transaksi mencakup satu atau beberapa operasi database seperti memasukkan, menghapus, memperbarui, atau mengambil data. Ini adalah proses atom yang dilakukan hingga selesai seluruhnya atau tidak dilakukan sama sekali. Transaksi yang hanya melibatkan pengambilan data tanpa pembaruan data apa pun disebut transaksi hanya baca.

Setiap operasi tingkat tinggi dapat dibagi menjadi sejumlah tugas atau operasi tingkat rendah. Misalnya, operasi pembaruan data dapat dibagi menjadi tiga tugas -

read_item() - membaca item data dari penyimpanan ke memori utama.

modify_item() - ubah nilai item di memori utama.

write_item() - tulis nilai yang diubah dari memori utama ke penyimpanan.

Akses database dibatasi untuk operasi read_item () dan write_item (). Demikian pula, untuk semua transaksi, membaca dan menulis membentuk operasi basis data dasar.

Operasi Transaksi

Operasi tingkat rendah yang dilakukan dalam transaksi adalah -

begin_transaction - Sebuah penanda yang menentukan awal dari eksekusi transaksi.

read_item or write_item - Operasi database yang dapat disisipkan dengan operasi memori utama sebagai bagian dari transaksi.

end_transaction - Penanda yang menentukan akhir transaksi.

commit - Sinyal untuk menentukan bahwa transaksi telah berhasil diselesaikan secara keseluruhan dan tidak akan dibatalkan.

rollback- Sinyal untuk menentukan bahwa transaksi tidak berhasil dan semua perubahan sementara dalam database dibatalkan. Transaksi yang berkomitmen tidak dapat dibatalkan.

Status Transaksi

Sebuah transaksi dapat melalui subset dari lima status, aktif, berkomitmen sebagian, berkomitmen, gagal, dan dibatalkan.

Active- Keadaan awal di mana transaksi masuk adalah keadaan aktif. Transaksi tetap dalam status ini saat menjalankan operasi baca, tulis, atau lainnya.

Partially Committed - Transaksi memasuki keadaan ini setelah pernyataan terakhir dari transaksi telah dieksekusi.

Committed - Transaksi memasuki keadaan ini setelah berhasil menyelesaikan transaksi dan pemeriksaan sistem telah mengeluarkan sinyal komit.

Failed - Transaksi beralih dari status sebagian berkomitmen atau status aktif ke status gagal ketika ditemukan bahwa eksekusi normal tidak dapat lagi dilanjutkan atau pemeriksaan sistem gagal.

Aborted - Ini adalah keadaan setelah transaksi dibatalkan setelah kegagalan dan database telah dikembalikan ke keadaan semula sebelum transaksi dimulai.

Diagram transisi status berikut menggambarkan status dalam transaksi dan operasi transaksi tingkat rendah yang menyebabkan perubahan status.

Properti Transaksi yang Diinginkan

Any transaction must maintain the ACID properties, viz. Atomicity, Consistency, Isolation, and Durability.

Atomicity − This property states that a transaction is an atomic unit of processing, that is, either it is performed in its entirety or not performed at all. No partial update should exist.

Consistency − A transaction should take the database from one consistent state to another consistent state. It should not adversely affect any data item in the database.

Isolation − A transaction should be executed as if it is the only one in the system. There should not be any interference from the other concurrent transactions that are simultaneously running.

Durability − If a committed transaction brings about a change, that change should be durable in the database and not lost in case of any failure.

Schedules and Conflicts

In a system with a number of simultaneous transactions, a schedule is the total order of execution of operations. Given a schedule S comprising of n transactions, say T1, T2, T3………..Tn; for any transaction Ti, the operations in Ti must execute as laid down in the schedule S.

Types of Schedules

There are two types of schedules −

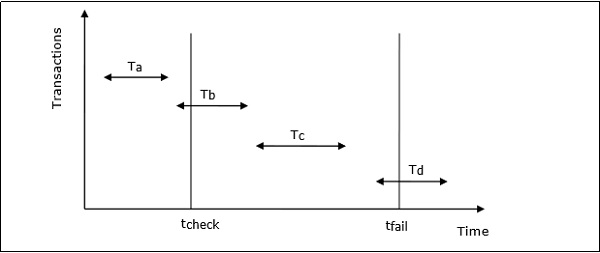

Serial Schedules − In a serial schedule, at any point of time, only one transaction is active, i.e. there is no overlapping of transactions. This is depicted in the following graph −

Parallel Schedules − In parallel schedules, more than one transactions are active simultaneously, i.e. the transactions contain operations that overlap at time. This is depicted in the following graph −

Conflicts in Schedules

In a schedule comprising of multiple transactions, a conflict occurs when two active transactions perform non-compatible operations. Two operations are said to be in conflict, when all of the following three conditions exists simultaneously −

The two operations are parts of different transactions.

Both the operations access the same data item.

At least one of the operations is a write_item() operation, i.e. it tries to modify the data item.

Serializability

A serializable schedule of ‘n’ transactions is a parallel schedule which is equivalent to a serial schedule comprising of the same ‘n’ transactions. A serializable schedule contains the correctness of serial schedule while ascertaining better CPU utilization of parallel schedule.

Equivalence of Schedules

Equivalence of two schedules can be of the following types −

Result equivalence − Two schedules producing identical results are said to be result equivalent.

View equivalence − Two schedules that perform similar action in a similar manner are said to be view equivalent.

Conflict equivalence − Two schedules are said to be conflict equivalent if both contain the same set of transactions and has the same order of conflicting pairs of operations.

Concurrency controlling techniques ensure that multiple transactions are executed simultaneously while maintaining the ACID properties of the transactions and serializability in the schedules.

In this chapter, we will study the various approaches for concurrency control.

Locking Based Concurrency Control Protocols

Locking-based concurrency control protocols use the concept of locking data items. A lock is a variable associated with a data item that determines whether read/write operations can be performed on that data item. Generally, a lock compatibility matrix is used which states whether a data item can be locked by two transactions at the same time.

Locking-based concurrency control systems can use either one-phase or two-phase locking protocols.

One-phase Locking Protocol

In this method, each transaction locks an item before use and releases the lock as soon as it has finished using it. This locking method provides for maximum concurrency but does not always enforce serializability.

Two-phase Locking Protocol

In this method, all locking operations precede the first lock-release or unlock operation. The transaction comprise of two phases. In the first phase, a transaction only acquires all the locks it needs and do not release any lock. This is called the expanding or the growing phase. In the second phase, the transaction releases the locks and cannot request any new locks. This is called the shrinking phase.

Every transaction that follows two-phase locking protocol is guaranteed to be serializable. However, this approach provides low parallelism between two conflicting transactions.

Timestamp Concurrency Control Algorithms

Timestamp-based concurrency control algorithms use a transaction’s timestamp to coordinate concurrent access to a data item to ensure serializability. A timestamp is a unique identifier given by DBMS to a transaction that represents the transaction’s start time.

These algorithms ensure that transactions commit in the order dictated by their timestamps. An older transaction should commit before a younger transaction, since the older transaction enters the system before the younger one.

Timestamp-based concurrency control techniques generate serializable schedules such that the equivalent serial schedule is arranged in order of the age of the participating transactions.

Some of timestamp based concurrency control algorithms are −

- Basic timestamp ordering algorithm.

- Conservative timestamp ordering algorithm.

- Multiversion algorithm based upon timestamp ordering.

Timestamp based ordering follow three rules to enforce serializability −

Access Rule − When two transactions try to access the same data item simultaneously, for conflicting operations, priority is given to the older transaction. This causes the younger transaction to wait for the older transaction to commit first.

Late Transaction Rule − If a younger transaction has written a data item, then an older transaction is not allowed to read or write that data item. This rule prevents the older transaction from committing after the younger transaction has already committed.

Younger Transaction Rule − A younger transaction can read or write a data item that has already been written by an older transaction.

Optimistic Concurrency Control Algorithm

In systems with low conflict rates, the task of validating every transaction for serializability may lower performance. In these cases, the test for serializability is postponed to just before commit. Since the conflict rate is low, the probability of aborting transactions which are not serializable is also low. This approach is called optimistic concurrency control technique.

In this approach, a transaction’s life cycle is divided into the following three phases −

Execution Phase − A transaction fetches data items to memory and performs operations upon them.

Validation Phase − A transaction performs checks to ensure that committing its changes to the database passes serializability test.

Commit Phase − A transaction writes back modified data item in memory to the disk.

This algorithm uses three rules to enforce serializability in validation phase −

Rule 1 − Given two transactions Ti and Tj, if Ti is reading the data item which Tj is writing, then Ti’s execution phase cannot overlap with Tj’s commit phase. Tj can commit only after Ti has finished execution.

Rule 2 − Given two transactions Ti and Tj, if Ti is writing the data item that Tj is reading, then Ti’s commit phase cannot overlap with Tj’s execution phase. Tj can start executing only after Ti has already committed.

Rule 3 − Given two transactions Ti and Tj, if Ti is writing the data item which Tj is also writing, then Ti’s commit phase cannot overlap with Tj’s commit phase. Tj can start to commit only after Ti has already committed.

Concurrency Control in Distributed Systems

In this section, we will see how the above techniques are implemented in a distributed database system.

Distributed Two-phase Locking Algorithm

The basic principle of distributed two-phase locking is same as the basic two-phase locking protocol. However, in a distributed system there are sites designated as lock managers. A lock manager controls lock acquisition requests from transaction monitors. In order to enforce co-ordination between the lock managers in various sites, at least one site is given the authority to see all transactions and detect lock conflicts.

Depending upon the number of sites who can detect lock conflicts, distributed two-phase locking approaches can be of three types −

Centralized two-phase locking − In this approach, one site is designated as the central lock manager. All the sites in the environment know the location of the central lock manager and obtain lock from it during transactions.

Primary copy two-phase locking − In this approach, a number of sites are designated as lock control centers. Each of these sites has the responsibility of managing a defined set of locks. All the sites know which lock control center is responsible for managing lock of which data table/fragment item.

Distributed two-phase locking − In this approach, there are a number of lock managers, where each lock manager controls locks of data items stored at its local site. The location of the lock manager is based upon data distribution and replication.

Distributed Timestamp Concurrency Control

In a centralized system, timestamp of any transaction is determined by the physical clock reading. But, in a distributed system, any site’s local physical/logical clock readings cannot be used as global timestamps, since they are not globally unique. So, a timestamp comprises of a combination of site ID and that site’s clock reading.

For implementing timestamp ordering algorithms, each site has a scheduler that maintains a separate queue for each transaction manager. During transaction, a transaction manager sends a lock request to the site’s scheduler. The scheduler puts the request to the corresponding queue in increasing timestamp order. Requests are processed from the front of the queues in the order of their timestamps, i.e. the oldest first.

Conflict Graphs

Another method is to create conflict graphs. For this transaction classes are defined. A transaction class contains two set of data items called read set and write set. A transaction belongs to a particular class if the transaction’s read set is a subset of the class’ read set and the transaction’s write set is a subset of the class’ write set. In the read phase, each transaction issues its read requests for the data items in its read set. In the write phase, each transaction issues its write requests.

A conflict graph is created for the classes to which active transactions belong. This contains a set of vertical, horizontal, and diagonal edges. A vertical edge connects two nodes within a class and denotes conflicts within the class. A horizontal edge connects two nodes across two classes and denotes a write-write conflict among different classes. A diagonal edge connects two nodes across two classes and denotes a write-read or a read-write conflict among two classes.

The conflict graphs are analyzed to ascertain whether two transactions within the same class or across two different classes can be run in parallel.

Distributed Optimistic Concurrency Control Algorithm

Distributed optimistic concurrency control algorithm extends optimistic concurrency control algorithm. For this extension, two rules are applied −

Rule 1 − According to this rule, a transaction must be validated locally at all sites when it executes. If a transaction is found to be invalid at any site, it is aborted. Local validation guarantees that the transaction maintains serializability at the sites where it has been executed. After a transaction passes local validation test, it is globally validated.

Rule 2 − According to this rule, after a transaction passes local validation test, it should be globally validated. Global validation ensures that if two conflicting transactions run together at more than one site, they should commit in the same relative order at all the sites they run together. This may require a transaction to wait for the other conflicting transaction, after validation before commit. This requirement makes the algorithm less optimistic since a transaction may not be able to commit as soon as it is validated at a site.

This chapter overviews deadlock handling mechanisms in database systems. We’ll study the deadlock handling mechanisms in both centralized and distributed database system.

What are Deadlocks?

Deadlock is a state of a database system having two or more transactions, when each transaction is waiting for a data item that is being locked by some other transaction. A deadlock can be indicated by a cycle in the wait-for-graph. This is a directed graph in which the vertices denote transactions and the edges denote waits for data items.

For example, in the following wait-for-graph, transaction T1 is waiting for data item X which is locked by T3. T3 is waiting for Y which is locked by T2 and T2 is waiting for Z which is locked by T1. Hence, a waiting cycle is formed, and none of the transactions can proceed executing.

Deadlock Handling in Centralized Systems

There are three classical approaches for deadlock handling, namely −

- Deadlock prevention.

- Deadlock avoidance.

- Deadlock detection and removal.

All of the three approaches can be incorporated in both a centralized and a distributed database system.

Deadlock Prevention

The deadlock prevention approach does not allow any transaction to acquire locks that will lead to deadlocks. The convention is that when more than one transactions request for locking the same data item, only one of them is granted the lock.

One of the most popular deadlock prevention methods is pre-acquisition of all the locks. In this method, a transaction acquires all the locks before starting to execute and retains the locks for the entire duration of transaction. If another transaction needs any of the already acquired locks, it has to wait until all the locks it needs are available. Using this approach, the system is prevented from being deadlocked since none of the waiting transactions are holding any lock.

Deadlock Avoidance

The deadlock avoidance approach handles deadlocks before they occur. It analyzes the transactions and the locks to determine whether or not waiting leads to a deadlock.

The method can be briefly stated as follows. Transactions start executing and request data items that they need to lock. The lock manager checks whether the lock is available. If it is available, the lock manager allocates the data item and the transaction acquires the lock. However, if the item is locked by some other transaction in incompatible mode, the lock manager runs an algorithm to test whether keeping the transaction in waiting state will cause a deadlock or not. Accordingly, the algorithm decides whether the transaction can wait or one of the transactions should be aborted.

There are two algorithms for this purpose, namely wait-die and wound-wait. Let us assume that there are two transactions, T1 and T2, where T1 tries to lock a data item which is already locked by T2. The algorithms are as follows −

Wait-Die − If T1 is older than T2, T1 is allowed to wait. Otherwise, if T1 is younger than T2, T1 is aborted and later restarted.

Wound-Wait − If T1 is older than T2, T2 is aborted and later restarted. Otherwise, if T1 is younger than T2, T1 is allowed to wait.

Deadlock Detection and Removal

The deadlock detection and removal approach runs a deadlock detection algorithm periodically and removes deadlock in case there is one. It does not check for deadlock when a transaction places a request for a lock. When a transaction requests a lock, the lock manager checks whether it is available. If it is available, the transaction is allowed to lock the data item; otherwise the transaction is allowed to wait.

Since there are no precautions while granting lock requests, some of the transactions may be deadlocked. To detect deadlocks, the lock manager periodically checks if the wait-forgraph has cycles. If the system is deadlocked, the lock manager chooses a victim transaction from each cycle. The victim is aborted and rolled back; and then restarted later. Some of the methods used for victim selection are −

- Choose the youngest transaction.

- Choose the transaction with fewest data items.

- Choose the transaction that has performed least number of updates.

- Choose the transaction having least restart overhead.

- Choose the transaction which is common to two or more cycles.

This approach is primarily suited for systems having transactions low and where fast response to lock requests is needed.

Deadlock Handling in Distributed Systems

Transaction processing in a distributed database system is also distributed, i.e. the same transaction may be processing at more than one site. The two main deadlock handling concerns in a distributed database system that are not present in a centralized system are transaction location and transaction control. Once these concerns are addressed, deadlocks are handled through any of deadlock prevention, deadlock avoidance or deadlock detection and removal.

Transaction Location

Transactions in a distributed database system are processed in multiple sites and use data items in multiple sites. The amount of data processing is not uniformly distributed among these sites. The time period of processing also varies. Thus the same transaction may be active at some sites and inactive at others. When two conflicting transactions are located in a site, it may happen that one of them is in inactive state. This condition does not arise in a centralized system. This concern is called transaction location issue.

This concern may be addressed by Daisy Chain model. In this model, a transaction carries certain details when it moves from one site to another. Some of the details are the list of tables required, the list of sites required, the list of visited tables and sites, the list of tables and sites that are yet to be visited and the list of acquired locks with types. After a transaction terminates by either commit or abort, the information should be sent to all the concerned sites.

Transaction Control