Hive - instalacja

Wszystkie podprojekty Hadoop, takie jak Hive, Pig i HBase, obsługują system operacyjny Linux. Dlatego musisz zainstalować dowolny system operacyjny o smaku Linux. Podczas instalacji programu Hive wykonywane są następujące proste kroki:

Krok 1: Weryfikacja instalacji JAVA

Java musi być zainstalowana w systemie przed zainstalowaniem Hive. Zweryfikujmy instalację Java za pomocą następującego polecenia:

$ java –versionJeśli Java jest już zainstalowana w twoim systemie, zobaczysz następującą odpowiedź:

java version "1.7.0_71"

Java(TM) SE Runtime Environment (build 1.7.0_71-b13)

Java HotSpot(TM) Client VM (build 25.0-b02, mixed mode)Jeśli java nie jest zainstalowana w twoim systemie, wykonaj poniższe kroki, aby zainstalować java.

Instalowanie Java

I krok:

Pobierz java (JDK <najnowsza wersja> - X64.tar.gz), odwiedzając poniższe łącze http://www.oracle.com/technetwork/java/javase/downloads/jdk7-downloads-1880260.html.

Następnie jdk-7u71-linux-x64.tar.gz zostanie pobrany do twojego systemu.

Etap II:

Pobrany plik java znajdziesz zwykle w folderze Pobrane. Sprawdź go i wyodrębnij plik jdk-7u71-linux-x64.gz, używając następujących poleceń.

$ cd Downloads/

$ ls

jdk-7u71-linux-x64.gz

$ tar zxf jdk-7u71-linux-x64.gz

$ ls

jdk1.7.0_71 jdk-7u71-linux-x64.gzKrok III:

Aby udostępnić Javę wszystkim użytkownikom, musisz przenieść ją do lokalizacji „/ usr / local /”. Otwórz root i wpisz następujące polecenia.

$ su

password:

# mv jdk1.7.0_71 /usr/local/

# exitKrok IV:

Aby ustawić zmienne PATH i JAVA_HOME, dodaj następujące polecenia do pliku ~ / .bashrc.

export JAVA_HOME=/usr/local/jdk1.7.0_71

export PATH=$PATH:$JAVA_HOME/binTeraz zastosuj wszystkie zmiany w aktualnie działającym systemie.

$ source ~/.bashrcKrok V:

Użyj następujących poleceń, aby skonfigurować alternatywy Java:

# alternatives --install /usr/bin/java/java/usr/local/java/bin/java 2

# alternatives --install /usr/bin/javac/javac/usr/local/java/bin/javac 2

# alternatives --install /usr/bin/jar/jar/usr/local/java/bin/jar 2

# alternatives --set java/usr/local/java/bin/java

# alternatives --set javac/usr/local/java/bin/javac

# alternatives --set jar/usr/local/java/bin/jarTeraz sprawdź instalację, używając polecenia java -version z terminala, jak wyjaśniono powyżej.

Krok 2: weryfikacja instalacji Hadoop

Hadoop należy zainstalować w systemie przed zainstalowaniem Hive. Zweryfikujmy instalację Hadoop za pomocą następującego polecenia:

$ hadoop versionJeśli Hadoop jest już zainstalowany w twoim systemie, otrzymasz następującą odpowiedź:

Hadoop 2.4.1 Subversion https://svn.apache.org/repos/asf/hadoop/common -r 1529768

Compiled by hortonmu on 2013-10-07T06:28Z

Compiled with protoc 2.5.0

From source with checksum 79e53ce7994d1628b240f09af91e1af4Jeśli Hadoop nie jest zainstalowany w Twoim systemie, wykonaj następujące czynności:

Pobieranie Hadoop

Pobierz i wyodrębnij Hadoop 2.4.1 z Apache Software Foundation, używając następujących poleceń.

$ su

password:

# cd /usr/local

# wget http://apache.claz.org/hadoop/common/hadoop-2.4.1/

hadoop-2.4.1.tar.gz

# tar xzf hadoop-2.4.1.tar.gz

# mv hadoop-2.4.1/* to hadoop/

# exitInstalowanie Hadoop w trybie pseudo rozproszonym

Poniższe kroki służą do instalowania Hadoop 2.4.1 w trybie pseudo rozproszonym.

Krok I: Konfigurowanie Hadoop

Możesz ustawić zmienne środowiskowe Hadoop, dołączając następujące polecenia do ~/.bashrc plik.

export HADOOP_HOME=/usr/local/hadoop

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export YARN_HOME=$HADOOP_HOME

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export

PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/binTeraz zastosuj wszystkie zmiany w aktualnie działającym systemie.

$ source ~/.bashrcKrok II: Konfiguracja Hadoop

Wszystkie pliki konfiguracyjne Hadoop można znaleźć w lokalizacji „$ HADOOP_HOME / etc / hadoop”. Musisz wprowadzić odpowiednie zmiany w tych plikach konfiguracyjnych zgodnie z infrastrukturą Hadoop.

$ cd $HADOOP_HOME/etc/hadoopAby tworzyć programy Hadoop przy użyciu języka Java, musisz zresetować zmienne środowiskowe Java w programie hadoop-env.sh plik, zastępując JAVA_HOME wartość wraz z lokalizacją Java w systemie.

export JAVA_HOME=/usr/local/jdk1.7.0_71Poniżej znajduje się lista plików, które należy edytować, aby skonfigurować Hadoop.

core-site.xml

Plik core-site.xml plik zawiera informacje, takie jak numer portu używanego dla wystąpienia Hadoop, pamięć przydzielona dla systemu plików, limit pamięci do przechowywania danych oraz rozmiar buforów do odczytu / zapisu.

Otwórz plik core-site.xml i dodaj następujące właściwości między tagami <configuration> i </configuration>.

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>hdfs-site.xml

Plik hdfs-site.xmlplik zawiera informacje, takie jak wartość danych replikacji, ścieżka do kodu nazwy i ścieżka do węzła danych lokalnych systemów plików. Oznacza to miejsce, w którym chcesz przechowywać Hadoop infra.

Przyjmijmy następujące dane.

dfs.replication (data replication value) = 1

(In the following path /hadoop/ is the user name.

hadoopinfra/hdfs/namenode is the directory created by hdfs file system.)

namenode path = //home/hadoop/hadoopinfra/hdfs/namenode

(hadoopinfra/hdfs/datanode is the directory created by hdfs file system.)

datanode path = //home/hadoop/hadoopinfra/hdfs/datanodeOtwórz ten plik i dodaj następujące właściwości między tagami <configuration>, </configuration> w tym pliku.

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.name.dir</name>

<value>file:///home/hadoop/hadoopinfra/hdfs/namenode </value>

</property>

<property>

<name>dfs.data.dir</name>

<value>file:///home/hadoop/hadoopinfra/hdfs/datanode </value >

</property>

</configuration>Note: W powyższym pliku wszystkie wartości właściwości są zdefiniowane przez użytkownika i można wprowadzać zmiany zgodnie z infrastrukturą Hadoop.

yarn-site.xml

Ten plik służy do konfigurowania przędzy w Hadoop. Otwórz plik yarn-site.xml i dodaj następujące właściwości między tagami <configuration>, </configuration> w tym pliku.

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>mapred-site.xml

Ten plik jest używany do określenia, której platformy MapReduce używamy. Domyślnie Hadoop zawiera szablon yarn-site.xml. Przede wszystkim musisz skopiować plik z mapred-site, xml.template do pliku mapred-site.xml za pomocą następującego polecenia.

$ cp mapred-site.xml.template mapred-site.xmlotwarty mapred-site.xml file i dodaj następujące właściwości między tagami <configuration>, </configuration> w tym pliku.

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>Weryfikacja instalacji Hadoop

Poniższe kroki służą do weryfikacji instalacji Hadoop.

Krok I: Konfiguracja nazwy węzła

Skonfiguruj namenode za pomocą polecenia „hdfs namenode -format” w następujący sposób.

$ cd ~

$ hdfs namenode -formatOczekiwany wynik jest następujący.

10/24/14 21:30:55 INFO namenode.NameNode: STARTUP_MSG:

/************************************************************

STARTUP_MSG: Starting NameNode

STARTUP_MSG: host = localhost/192.168.1.11

STARTUP_MSG: args = [-format]

STARTUP_MSG: version = 2.4.1

...

...

10/24/14 21:30:56 INFO common.Storage: Storage directory

/home/hadoop/hadoopinfra/hdfs/namenode has been successfully formatted.

10/24/14 21:30:56 INFO namenode.NNStorageRetentionManager: Going to

retain 1 images with txid >= 0

10/24/14 21:30:56 INFO util.ExitUtil: Exiting with status 0

10/24/14 21:30:56 INFO namenode.NameNode: SHUTDOWN_MSG:

/************************************************************

SHUTDOWN_MSG: Shutting down NameNode at localhost/192.168.1.11

************************************************************/Krok II: weryfikacja plików dfs na platformie Hadoop

Następujące polecenie służy do uruchamiania dfs. Wykonanie tego polecenia spowoduje uruchomienie systemu plików Hadoop.

$ start-dfs.shOczekiwany wynik jest następujący:

10/24/14 21:37:56

Starting namenodes on [localhost]

localhost: starting namenode, logging to /home/hadoop/hadoop-2.4.1/logs/hadoop-hadoop-namenode-localhost.out

localhost: starting datanode, logging to /home/hadoop/hadoop-2.4.1/logs/hadoop-hadoop-datanode-localhost.out

Starting secondary namenodes [0.0.0.0]Krok III: weryfikacja skryptu przędzy

Następujące polecenie służy do uruchamiania skryptu przędzy. Wykonanie tego polecenia spowoduje uruchomienie demonów przędzy.

$ start-yarn.shOczekiwany wynik jest następujący:

starting yarn daemons

starting resourcemanager, logging to /home/hadoop/hadoop-2.4.1/logs/yarn-hadoop-resourcemanager-localhost.out

localhost: starting nodemanager, logging to /home/hadoop/hadoop-2.4.1/logs/yarn-hadoop-nodemanager-localhost.outKrok IV: Dostęp do Hadoop w przeglądarce

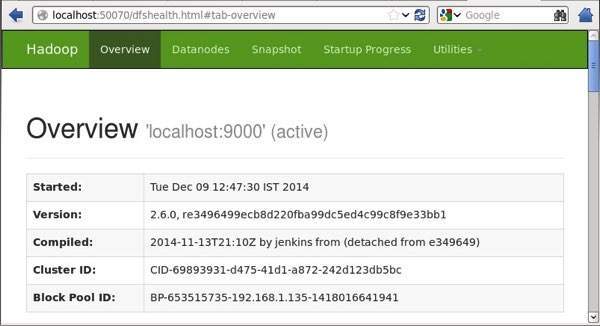

Domyślny numer portu dostępu do Hadoop to 50070. Użyj następującego adresu URL, aby pobrać usługi Hadoop w przeglądarce.

http://localhost:50070/

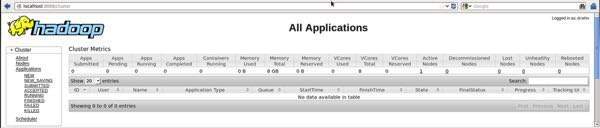

Krok V: Sprawdź wszystkie aplikacje dla klastra

Domyślny numer portu dostępu do wszystkich aplikacji klastra to 8088. Aby odwiedzić tę usługę, użyj następującego adresu URL.

http://localhost:8088/

Krok 3: Pobieranie Hive

W tym samouczku używamy hive-0.14.0. Możesz go pobrać, odwiedzając poniższy linkhttp://apache.petsads.us/hive/hive-0.14.0/.Załóżmy, że zostanie pobrany do katalogu / Downloads. Tutaj pobieramy archiwum Hive o nazwie „apache-hive-0.14.0-bin.tar.gz” na potrzeby tego samouczka. Poniższe polecenie służy do weryfikacji pobierania:

$ cd Downloads

$ lsPo pomyślnym pobraniu zobaczysz następującą odpowiedź:

apache-hive-0.14.0-bin.tar.gzKrok 4: Instalowanie gałęzi

Poniższe kroki są wymagane do zainstalowania Hive w systemie. Załóżmy, że archiwum Hive jest pobierane do katalogu / Downloads.

Wyodrębnianie i weryfikowanie archiwum Hive

Następujące polecenie służy do weryfikacji pobierania i wyodrębniania archiwum gałęzi:

$ tar zxvf apache-hive-0.14.0-bin.tar.gz

$ lsPo pomyślnym pobraniu zobaczysz następującą odpowiedź:

apache-hive-0.14.0-bin apache-hive-0.14.0-bin.tar.gzKopiowanie plików do katalogu / usr / local / hive

Musimy skopiować pliki od superużytkownika „su -”. Poniższe polecenia służą do kopiowania plików z wyodrębnionego katalogu do katalogu / usr / local / hive ”.

$ su -

passwd:

# cd /home/user/Download

# mv apache-hive-0.14.0-bin /usr/local/hive

# exitKonfigurowanie środowiska dla Hive

Możesz skonfigurować środowisko Hive, dołączając następujące wiersze do ~/.bashrc plik:

export HIVE_HOME=/usr/local/hive

export PATH=$PATH:$HIVE_HOME/bin

export CLASSPATH=$CLASSPATH:/usr/local/Hadoop/lib/*:.

export CLASSPATH=$CLASSPATH:/usr/local/hive/lib/*:.Następujące polecenie służy do wykonania pliku ~ / .bashrc.

$ source ~/.bashrcKrok 5: Konfigurowanie gałęzi

Aby skonfigurować Hive z Hadoop, musisz edytować plik hive-env.sh plik, który jest umieszczony w $HIVE_HOME/confinformator. Następujące polecenia przekierowują do Hiveconfig folder i skopiuj plik szablonu:

$ cd $HIVE_HOME/conf

$ cp hive-env.sh.template hive-env.shEdytuj plik hive-env.sh plik, dołączając następujący wiersz:

export HADOOP_HOME=/usr/local/hadoopInstalacja ula została zakończona pomyślnie. Teraz do skonfigurowania Metastore potrzebny jest zewnętrzny serwer bazy danych. Korzystamy z bazy danych Apache Derby.

Krok 6: Pobieranie i instalowanie Apache Derby

Wykonaj poniższe czynności, aby pobrać i zainstalować Apache Derby:

Pobieranie Apache Derby

Następujące polecenie służy do pobierania Apache Derby. Pobieranie zajmuje trochę czasu.

$ cd ~

$ wget http://archive.apache.org/dist/db/derby/db-derby-10.4.2.0/db-derby-10.4.2.0-bin.tar.gzPoniższe polecenie służy do weryfikacji pobierania:

$ lsPo pomyślnym pobraniu zobaczysz następującą odpowiedź:

db-derby-10.4.2.0-bin.tar.gzWyodrębnianie i weryfikacja archiwum Derby

Następujące polecenia służą do wyodrębniania i weryfikacji archiwum Derby:

$ tar zxvf db-derby-10.4.2.0-bin.tar.gz

$ lsPo pomyślnym pobraniu zobaczysz następującą odpowiedź:

db-derby-10.4.2.0-bin db-derby-10.4.2.0-bin.tar.gzKopiowanie plików do katalogu / usr / local / derby

Musimy skopiować od superużytkownika „su -”. Poniższe polecenia służą do kopiowania plików z wyodrębnionego katalogu do katalogu / usr / local / derby:

$ su -

passwd:

# cd /home/user

# mv db-derby-10.4.2.0-bin /usr/local/derby

# exitKonfigurowanie środowiska dla Derby

Środowisko Derby można skonfigurować, dołączając następujące wiersze do ~/.bashrc plik:

export DERBY_HOME=/usr/local/derby

export PATH=$PATH:$DERBY_HOME/bin

Apache Hive

18

export CLASSPATH=$CLASSPATH:$DERBY_HOME/lib/derby.jar:$DERBY_HOME/lib/derbytools.jarNastępujące polecenie służy do wykonania ~/.bashrc plik:

$ source ~/.bashrcUtwórz katalog do przechowywania Metastore

Utwórz katalog o nazwie data w katalogu $ DERBY_HOME do przechowywania danych Metastore.

$ mkdir $DERBY_HOME/dataInstalacja Derby i konfiguracja środowiska zostały zakończone.

Krok 7: Konfiguracja Metastore of Hive

Skonfigurowanie Metastore oznacza określenie w Hive, gdzie jest przechowywana baza danych. Możesz to zrobić, edytując plik hive-site.xml, który znajduje się w katalogu $ HIVE_HOME / conf. Przede wszystkim skopiuj plik szablonu za pomocą następującego polecenia:

$ cd $HIVE_HOME/conf

$ cp hive-default.xml.template hive-site.xmlEdytować hive-site.xml i dołącz następujące wiersze między tagami <configuration> i </configuration>:

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:derby://localhost:1527/metastore_db;create=true </value>

<description>JDBC connect string for a JDBC metastore </description>

</property>Utwórz plik o nazwie jpox.properties i dodaj do niego następujące wiersze:

javax.jdo.PersistenceManagerFactoryClass =

org.jpox.PersistenceManagerFactoryImpl

org.jpox.autoCreateSchema = false

org.jpox.validateTables = false

org.jpox.validateColumns = false

org.jpox.validateConstraints = false

org.jpox.storeManagerType = rdbms

org.jpox.autoCreateSchema = true

org.jpox.autoStartMechanismMode = checked

org.jpox.transactionIsolation = read_committed

javax.jdo.option.DetachAllOnCommit = true

javax.jdo.option.NontransactionalRead = true

javax.jdo.option.ConnectionDriverName = org.apache.derby.jdbc.ClientDriver

javax.jdo.option.ConnectionURL = jdbc:derby://hadoop1:1527/metastore_db;create = true

javax.jdo.option.ConnectionUserName = APP

javax.jdo.option.ConnectionPassword = mineKrok 8: weryfikacja instalacji gałęzi

Przed uruchomieniem Hive musisz utworzyć plik /tmpfolder i oddzielny folder Hive w HDFS. Tutaj używamy/user/hive/warehouseteczka. Musisz ustawić uprawnienia do zapisu dla tych nowo utworzonych folderów, jak pokazano poniżej:

chmod g+wTeraz ustaw je w HDFS przed zweryfikowaniem Hive. Użyj następujących poleceń:

$ $HADOOP_HOME/bin/hadoop fs -mkdir /tmp

$ $HADOOP_HOME/bin/hadoop fs -mkdir /user/hive/warehouse

$ $HADOOP_HOME/bin/hadoop fs -chmod g+w /tmp

$ $HADOOP_HOME/bin/hadoop fs -chmod g+w /user/hive/warehouseNastępujące polecenia służą do weryfikacji instalacji programu Hive:

$ cd $HIVE_HOME

$ bin/hivePo pomyślnej instalacji Hive zobaczysz następującą odpowiedź:

Logging initialized using configuration in jar:file:/home/hadoop/hive-0.9.0/lib/hive-common-0.9.0.jar!/hive-log4j.properties

Hive history file=/tmp/hadoop/hive_job_log_hadoop_201312121621_1494929084.txt

………………….

hive>Następujące przykładowe polecenie jest wykonywane w celu wyświetlenia wszystkich tabel:

hive> show tables;

OK

Time taken: 2.798 seconds

hive>