TensorFlow - Gradientenabstiegsoptimierung

Die Optimierung des Gradientenabstiegs wird als wichtiges Konzept in der Datenwissenschaft angesehen.

Betrachten Sie die unten gezeigten Schritte, um die Implementierung der Gradientenabstiegsoptimierung zu verstehen.

Schritt 1

Fügen Sie die erforderlichen Module und die Deklaration von x- und y-Variablen hinzu, mit denen wir die Optimierung des Gradientenabfalls definieren.

import tensorflow as tf

x = tf.Variable(2, name = 'x', dtype = tf.float32)

log_x = tf.log(x)

log_x_squared = tf.square(log_x)

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(log_x_squared)Schritt 2

Initialisieren Sie die erforderlichen Variablen und rufen Sie die Optimierer auf, um sie mit der entsprechenden Funktion zu definieren und aufzurufen.

init = tf.initialize_all_variables()

def optimize():

with tf.Session() as session:

session.run(init)

print("starting at", "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

for step in range(10):

session.run(train)

print("step", step, "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

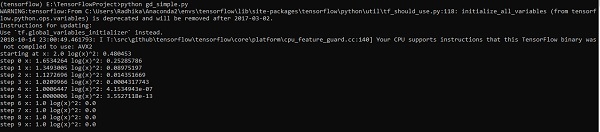

optimize()Die obige Codezeile generiert eine Ausgabe wie im folgenden Screenshot gezeigt -

Wir können sehen, dass die erforderlichen Epochen und Iterationen wie in der Ausgabe gezeigt berechnet werden.