TensorFlow - Ottimizzazione della discesa del gradiente

L'ottimizzazione della discesa del gradiente è considerata un concetto importante nella scienza dei dati.

Considera i passaggi mostrati di seguito per comprendere l'implementazione dell'ottimizzazione della discesa del gradiente:

Passo 1

Includere i moduli necessari e la dichiarazione delle variabili xey attraverso le quali definiremo l'ottimizzazione della discesa del gradiente.

import tensorflow as tf

x = tf.Variable(2, name = 'x', dtype = tf.float32)

log_x = tf.log(x)

log_x_squared = tf.square(log_x)

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(log_x_squared)Passo 2

Inizializza le variabili necessarie e chiama gli ottimizzatori per definirlo e chiamarlo con la rispettiva funzione.

init = tf.initialize_all_variables()

def optimize():

with tf.Session() as session:

session.run(init)

print("starting at", "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

for step in range(10):

session.run(train)

print("step", step, "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

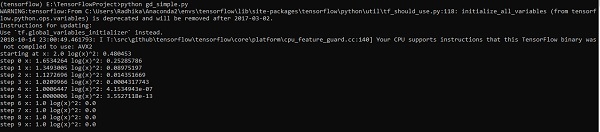

optimize()La riga di codice sopra genera un output come mostrato nello screenshot qui sotto -

Possiamo vedere che le epoche e le iterazioni necessarie vengono calcolate come mostrato nell'output.