Pythonを使用したAI–教師あり学習:回帰

回帰は、最も重要な統計および機械学習ツールの1つです。機械学習の旅は回帰から始まると言っても過言ではありません。これは、データに基づいて決定を下すことができる、言い換えれば、入力変数と出力変数の関係を学習することによってデータに基づいて予測を行うことができるパラメトリック手法として定義できます。ここで、入力変数に依存する出力変数は、連続値の実数です。回帰では、入力変数と出力変数の関係が重要であり、入力変数の変化に伴って出力変数の値がどのように変化するかを理解するのに役立ちます。回帰は、価格、経済、変動などの予測に頻繁に使用されます。

Pythonでリグレッサを構築する

このセクションでは、単一変数と多変数のリグレッサーを作成する方法を学習します。

線形リグレッサ/単一変数リグレッサ

いくつかの必要なパッケージを重要にしましょう-

import numpy as np

from sklearn import linear_model

import sklearn.metrics as sm

import matplotlib.pyplot as pltここで、入力データを提供する必要があり、linear.txtという名前のファイルにデータを保存しました。

input = 'D:/ProgramData/linear.txt'を使用してこのデータをロードする必要があります np.loadtxt 関数。

input_data = np.loadtxt(input, delimiter=',')

X, y = input_data[:, :-1], input_data[:, -1]次のステップは、モデルをトレーニングすることです。トレーニングとテストのサンプルを提供しましょう。

training_samples = int(0.6 * len(X))

testing_samples = len(X) - num_training

X_train, y_train = X[:training_samples], y[:training_samples]

X_test, y_test = X[training_samples:], y[training_samples:]次に、線形リグレッサオブジェクトを作成する必要があります。

reg_linear = linear_model.LinearRegression()トレーニングサンプルを使用してオブジェクトをトレーニングします。

reg_linear.fit(X_train, y_train)テストデータを使用して予測を行う必要があります。

y_test_pred = reg_linear.predict(X_test)次に、データをプロットして視覚化します。

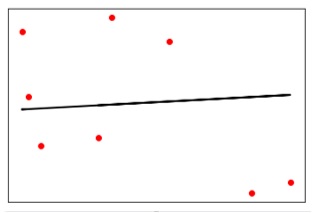

plt.scatter(X_test, y_test, color = 'red')

plt.plot(X_test, y_test_pred, color = 'black', linewidth = 2)

plt.xticks(())

plt.yticks(())

plt.show()出力

これで、線形回帰のパフォーマンスを次のように計算できます。

print("Performance of Linear regressor:")

print("Mean absolute error =", round(sm.mean_absolute_error(y_test, y_test_pred), 2))

print("Mean squared error =", round(sm.mean_squared_error(y_test, y_test_pred), 2))

print("Median absolute error =", round(sm.median_absolute_error(y_test, y_test_pred), 2))

print("Explain variance score =", round(sm.explained_variance_score(y_test, y_test_pred),

2))

print("R2 score =", round(sm.r2_score(y_test, y_test_pred), 2))出力

線形リグレッサのパフォーマンス-

Mean absolute error = 1.78

Mean squared error = 3.89

Median absolute error = 2.01

Explain variance score = -0.09

R2 score = -0.09上記のコードでは、この小さなデータを使用しています。大きなデータセットが必要な場合は、sklearn.datasetを使用して大きなデータセットをインポートできます。

2,4.82.9,4.72.5,53.2,5.56,57.6,43.2,0.92.9,1.92.4,

3.50.5,3.41,40.9,5.91.2,2.583.2,5.65.1,1.54.5,

1.22.3,6.32.1,2.8多変数リグレッサ

まず、いくつかの必要なパッケージをインポートしましょう-

import numpy as np

from sklearn import linear_model

import sklearn.metrics as sm

import matplotlib.pyplot as plt

from sklearn.preprocessing import PolynomialFeaturesここで、入力データを提供する必要があり、linear.txtという名前のファイルにデータを保存しました。

input = 'D:/ProgramData/Mul_linear.txt'を使用してこのデータをロードします np.loadtxt 関数。

input_data = np.loadtxt(input, delimiter=',')

X, y = input_data[:, :-1], input_data[:, -1]次のステップは、モデルをトレーニングすることです。トレーニングとテストのサンプルを提供します。

training_samples = int(0.6 * len(X))

testing_samples = len(X) - num_training

X_train, y_train = X[:training_samples], y[:training_samples]

X_test, y_test = X[training_samples:], y[training_samples:]次に、線形リグレッサオブジェクトを作成する必要があります。

reg_linear_mul = linear_model.LinearRegression()トレーニングサンプルを使用してオブジェクトをトレーニングします。

reg_linear_mul.fit(X_train, y_train)さて、最後に、テストデータを使用して予測を行う必要があります。

y_test_pred = reg_linear_mul.predict(X_test)

print("Performance of Linear regressor:")

print("Mean absolute error =", round(sm.mean_absolute_error(y_test, y_test_pred), 2))

print("Mean squared error =", round(sm.mean_squared_error(y_test, y_test_pred), 2))

print("Median absolute error =", round(sm.median_absolute_error(y_test, y_test_pred), 2))

print("Explain variance score =", round(sm.explained_variance_score(y_test, y_test_pred), 2))

print("R2 score =", round(sm.r2_score(y_test, y_test_pred), 2))出力

線形リグレッサのパフォーマンス-

Mean absolute error = 0.6

Mean squared error = 0.65

Median absolute error = 0.41

Explain variance score = 0.34

R2 score = 0.33ここで、次数10の多項式を作成し、リグレッサーをトレーニングします。サンプルデータポイントを提供します。

polynomial = PolynomialFeatures(degree = 10)

X_train_transformed = polynomial.fit_transform(X_train)

datapoint = [[2.23, 1.35, 1.12]]

poly_datapoint = polynomial.fit_transform(datapoint)

poly_linear_model = linear_model.LinearRegression()

poly_linear_model.fit(X_train_transformed, y_train)

print("\nLinear regression:\n", reg_linear_mul.predict(datapoint))

print("\nPolynomial regression:\n", poly_linear_model.predict(poly_datapoint))出力

線形回帰-

[2.40170462]多項式回帰-

[1.8697225]上記のコードでは、この小さなデータを使用しています。大きなデータセットが必要な場合は、sklearn.datasetを使用して大きなデータセットをインポートできます。

2,4.8,1.2,3.22.9,4.7,1.5,3.62.5,5,2.8,23.2,5.5,3.5,2.16,5,

2,3.27.6,4,1.2,3.23.2,0.9,2.3,1.42.9,1.9,2.3,1.22.4,3.5,

2.8,3.60.5,3.4,1.8,2.91,4,3,2.50.9,5.9,5.6,0.81.2,2.58,

3.45,1.233.2,5.6,2,3.25.1,1.5,1.2,1.34.5,1.2,4.1,2.32.3,

6.3,2.5,3.22.1,2.8,1.2,3.6