신경망 훈련을위한 권장 사항

이 장에서는 TensorFlow 프레임 워크를 사용하여 구현할 수있는 신경망 훈련의 다양한 측면을 이해합니다.

다음은 평가할 수있는 10 가지 권장 사항입니다.

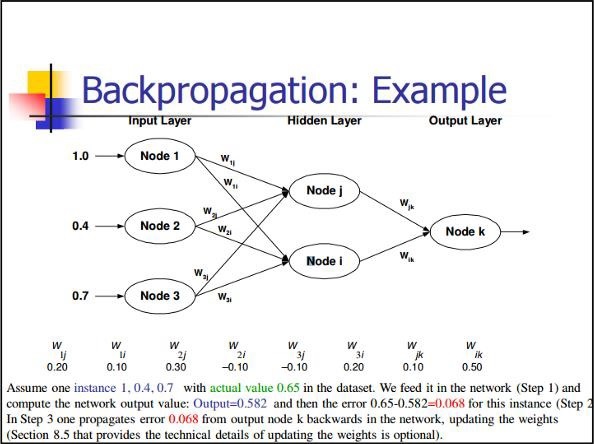

역 전파

역전 파는 편도 함수를 계산하는 간단한 방법으로, 신경망에 가장 적합한 구성의 기본 형태를 포함합니다.

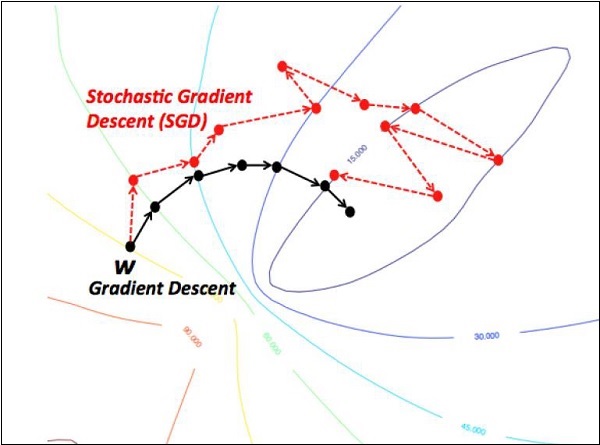

확률 적 경사 하강 법

확률 적 경사 하강 법에서 batch사용자가 단일 반복에서 기울기를 계산하는 데 사용하는 총 예제 수입니다. 지금까지 배치가 전체 데이터 세트라고 가정합니다. 최고의 일러스트레이션은 Google 규모로 작업하는 것입니다. 데이터 세트에는 종종 수십억 또는 수 천억 개의 예제가 포함됩니다.

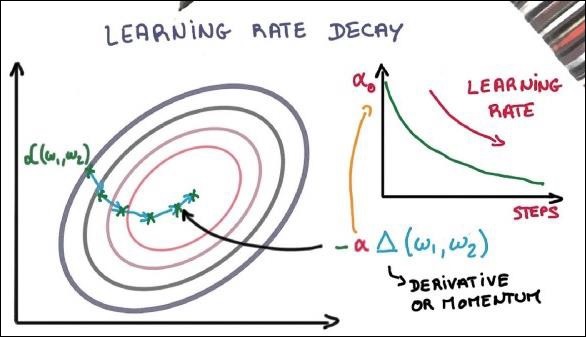

학습률 감소

학습률을 조정하는 것은 경사 하강 법 최적화의 가장 중요한 기능 중 하나입니다. 이것은 TensorFlow 구현에 중요합니다.

드롭 아웃

매개 변수가 많은 심층 신경망은 강력한 기계 학습 시스템을 형성합니다. 그러나 과도한 피팅은 이러한 네트워크에서 심각한 문제입니다.

최대 풀링

최대 풀링은 샘플 기반 이산화 프로세스입니다. 목표는 입력 표현을 다운 샘플링하여 필요한 가정으로 차원을 줄이는 것입니다.

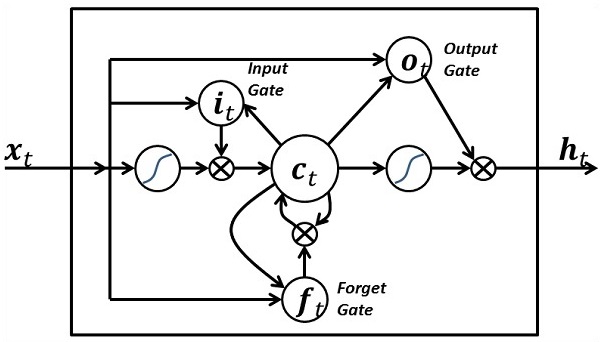

장단기 기억 (LSTM)

LSTM은 지정된 뉴런 내에서 취해야하는 입력에 대한 결정을 제어합니다. 여기에는 무엇을 계산해야하고 어떤 출력을 생성해야하는지 결정하는 제어가 포함됩니다.