กรมทรัพย์สินทางปัญญา - คู่มือฉบับย่อ

บทนำ

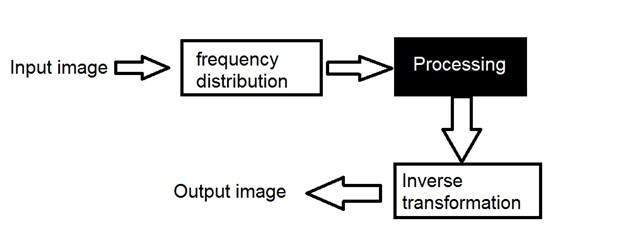

การประมวลผลสัญญาณเป็นระเบียบวินัยในวิศวกรรมไฟฟ้าและในคณิตศาสตร์ที่เกี่ยวข้องกับการวิเคราะห์และการประมวลผลสัญญาณแอนะล็อกและดิจิทัลและเกี่ยวข้องกับการจัดเก็บการกรองและการดำเนินการอื่น ๆ เกี่ยวกับสัญญาณ สัญญาณเหล่านี้รวมถึงสัญญาณส่งสัญญาณเสียงหรือเสียงสัญญาณภาพและสัญญาณอื่น ๆ เป็นต้น

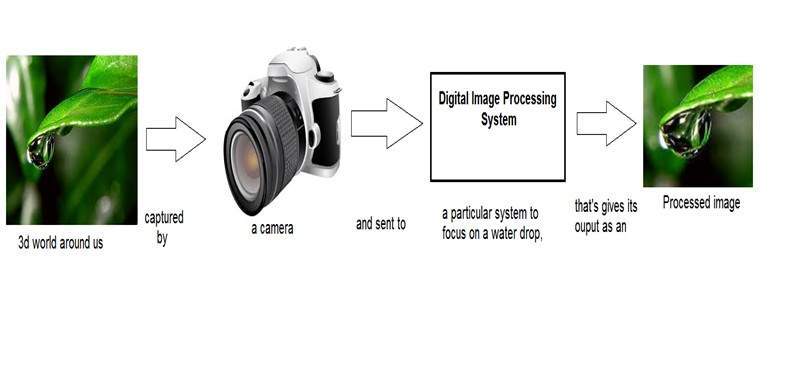

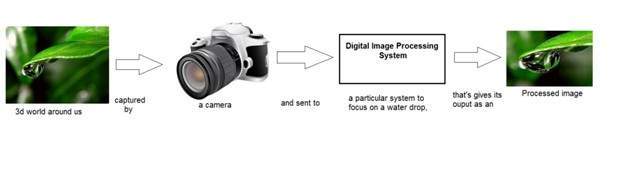

จากสัญญาณเหล่านี้ทั้งหมดฟิลด์ที่เกี่ยวข้องกับประเภทของสัญญาณที่อินพุตเป็นรูปภาพและเอาต์พุตยังเป็นรูปภาพในการประมวลผลภาพ ตามชื่อมันเกี่ยวข้องกับการประมวลผลภาพ

สามารถแบ่งออกได้อีกเป็นการประมวลผลภาพอนาล็อกและการประมวลผลภาพดิจิทัล

การประมวลผลภาพอนาล็อก

การประมวลผลภาพแบบอะนาล็อกทำบนสัญญาณอนาล็อก รวมถึงการประมวลผลสัญญาณอนาล็อกสองมิติ ในการประมวลผลประเภทนี้ภาพจะถูกจัดการด้วยวิธีการทางไฟฟ้าโดยเปลี่ยนสัญญาณไฟฟ้า ตัวอย่างทั่วไป ได้แก่ ภาพโทรทัศน์

การประมวลผลภาพดิจิทัลมีผลเหนือกว่าการประมวลผลภาพแบบอะนาล็อกเมื่อเวลาผ่านไปเนื่องจากมีการใช้งานที่หลากหลาย

การประมวลผลภาพดิจิตอล

การประมวลผลภาพดิจิทัลเกี่ยวข้องกับการพัฒนาระบบดิจิทัลที่ดำเนินการกับภาพดิจิทัล

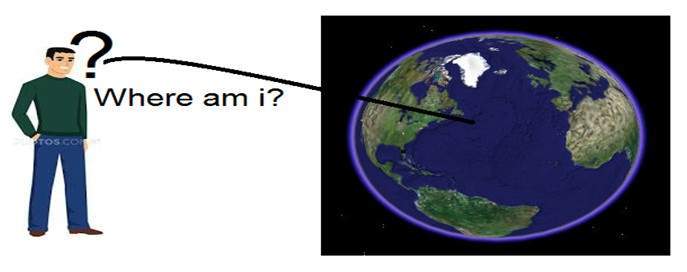

รูปภาพคืออะไร

ภาพไม่ได้เป็นเพียงสัญญาณสองมิติ มันถูกกำหนดโดยฟังก์ชันทางคณิตศาสตร์ f (x, y) โดยที่ x และ y เป็นสองพิกัดในแนวนอนและแนวตั้ง

ค่า f (x, y) ที่จุดใด ๆ จะให้ค่าพิกเซลที่จุดนั้นของภาพ

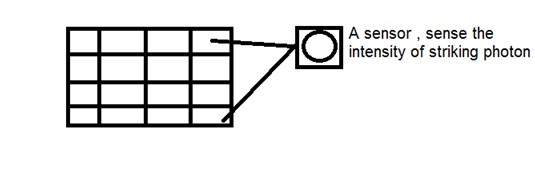

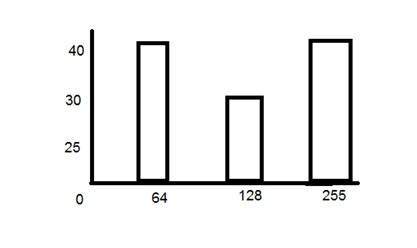

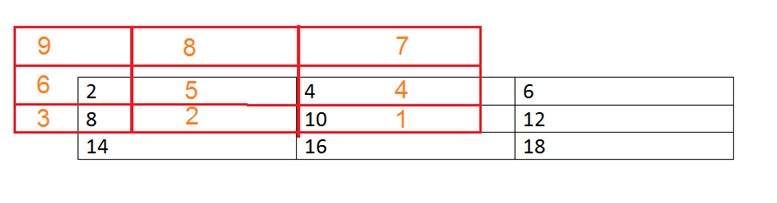

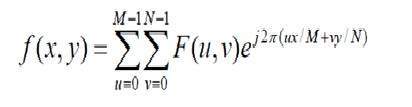

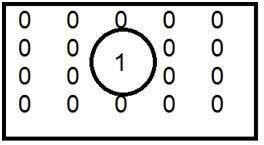

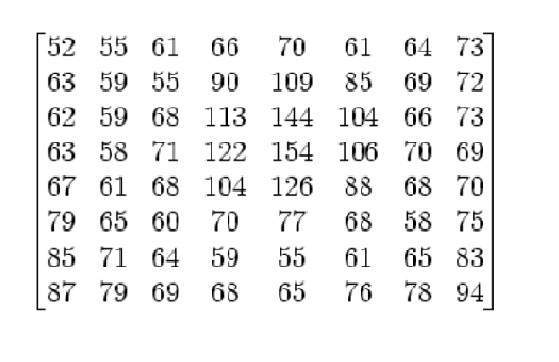

รูปด้านบนเป็นตัวอย่างของภาพดิจิทัลที่คุณกำลังดูอยู่บนหน้าจอคอมพิวเตอร์ของคุณ แต่จริงๆแล้วภาพนี้ไม่ใช่อะไรเลยนอกจากอาร์เรย์สองมิติของตัวเลขที่อยู่ระหว่าง 0 ถึง 255

| 128 | 30 | 123 |

| 232 | 123 | 321 |

| 123 | 77 | 89 |

| 80 | 255 | 255 |

ตัวเลขแต่ละตัวแทนค่าของฟังก์ชัน f (x, y) ณ จุดใดก็ได้ ในกรณีนี้ค่า 128, 230, 123 แต่ละค่าแทนค่าพิกเซลแต่ละรายการ ขนาดของรูปภาพเป็นขนาดของอาร์เรย์สองมิตินี้

ความสัมพันธ์ระหว่างภาพดิจิทัลและสัญญาณ

ถ้าภาพเป็นอาร์เรย์สองมิติแล้วสัญญาณจะทำอย่างไร? เพื่อที่จะเข้าใจว่าเราต้องเข้าใจก่อนว่าสัญญาณคืออะไร?

สัญญาณ

ในโลกทางกายภาพปริมาณใด ๆ ที่วัดได้ในช่วงเวลาเหนืออวกาศหรือมิติที่สูงกว่านั้นสามารถใช้เป็นสัญญาณได้ สัญญาณเป็นฟังก์ชันทางคณิตศาสตร์และสื่อถึงข้อมูลบางอย่าง สัญญาณอาจเป็นสัญญาณมิติเดียวหรือสองมิติหรือสูงกว่า สัญญาณมิติเดียวคือสัญญาณที่วัดตามช่วงเวลา ตัวอย่างทั่วไปคือสัญญาณเสียง สัญญาณสองมิติคือสัญญาณที่วัดได้จากปริมาณทางกายภาพอื่น ๆ ตัวอย่างของสัญญาณสองมิติคือภาพดิจิทัล เราจะดูรายละเอียดเพิ่มเติมในบทช่วยสอนถัดไปเกี่ยวกับวิธีการสร้างและตีความสัญญาณมิติเดียวหรือสองมิติและสัญญาณที่สูงกว่า

ความสัมพันธ์

เนื่องจากสิ่งใดก็ตามที่ถ่ายทอดข้อมูลหรือถ่ายทอดข้อความในโลกทางกายภาพระหว่างผู้สังเกตการณ์สองคนเป็นสัญญาณ ซึ่งรวมถึงเสียงพูดหรือ (เสียงของมนุษย์) หรือภาพเป็นสัญญาณ ตั้งแต่เมื่อเราพูดเสียงของเราจะถูกแปลงเป็นคลื่นเสียง / สัญญาณและเปลี่ยนไปตามเวลาที่เราพูดด้วย ไม่เพียงแค่นี้ แต่วิธีการทำงานของกล้องดิจิทัลด้วยในขณะที่การรับภาพจากกล้องดิจิทัลเกี่ยวข้องกับการถ่ายโอนสัญญาณจากส่วนหนึ่งของระบบไปยังอีกส่วนหนึ่ง

ภาพดิจิทัลเกิดขึ้นได้อย่างไร

เนื่องจากการจับภาพจากกล้องเป็นกระบวนการทางกายภาพ แสงแดดถูกใช้เป็นแหล่งพลังงาน อาร์เรย์เซ็นเซอร์ใช้สำหรับการได้มาของภาพ ดังนั้นเมื่อแสงแดดตกกระทบวัตถุปริมาณแสงที่สะท้อนจากวัตถุนั้นจะถูกตรวจจับโดยเซ็นเซอร์และสัญญาณแรงดันไฟฟ้าต่อเนื่องจะถูกสร้างขึ้นโดยปริมาณข้อมูลที่ตรวจจับได้ ในการสร้างภาพดิจิทัลเราจำเป็นต้องแปลงข้อมูลนี้ให้อยู่ในรูปแบบดิจิทัล สิ่งนี้เกี่ยวข้องกับการสุ่มตัวอย่างและการหาปริมาณ (จะกล่าวถึงในภายหลัง) ผลลัพธ์ของการสุ่มตัวอย่างและการหาปริมาณทำให้เกิดอาร์เรย์สองมิติหรือเมทริกซ์ของตัวเลขซึ่งไม่มีอะไรเลยนอกจากภาพดิจิทัล

เขตข้อมูลที่ทับซ้อนกัน

วิสัยทัศน์ของเครื่องจักร / คอมพิวเตอร์

วิชันซิสเต็มหรือการมองเห็นด้วยคอมพิวเตอร์เกี่ยวข้องกับการพัฒนาระบบที่อินพุตเป็นรูปภาพและเอาต์พุตเป็นข้อมูลบางส่วน ตัวอย่างเช่น: การพัฒนาระบบที่สแกนใบหน้ามนุษย์และเปิดล็อคทุกประเภท ระบบนี้จะเป็นแบบนี้

คอมพิวเตอร์กราฟิก

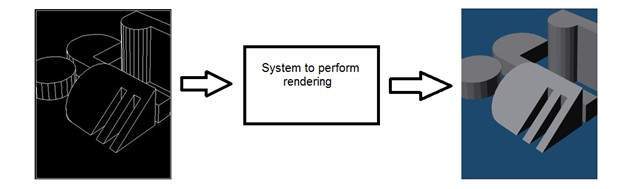

คอมพิวเตอร์กราฟิกเกี่ยวข้องกับการก่อตัวของภาพจากแบบจำลองวัตถุจากนั้นอุปกรณ์บางชนิดจะจับภาพ ตัวอย่างเช่น: การแสดงผลวัตถุ การสร้างภาพจากโมเดลวัตถุ ระบบดังกล่าวจะมีลักษณะเช่นนี้

ปัญญาประดิษฐ์

ปัญญาประดิษฐ์เป็นการศึกษาเกี่ยวกับการนำปัญญาของมนุษย์มาเป็นเครื่องจักรไม่มากก็น้อย ปัญญาประดิษฐ์มีแอพพลิเคชั่นมากมายในการประมวลผลภาพ ตัวอย่างเช่นการพัฒนาระบบคอมพิวเตอร์ช่วยในการวินิจฉัยที่ช่วยแพทย์ในการตีความภาพของ X-ray, MRI และอื่น ๆ จากนั้นจึงเน้นส่วนที่เด่นชัดเพื่อให้แพทย์ตรวจ

การประมวลผลสัญญาณ

การประมวลผลสัญญาณเป็นร่มและการประมวลผลภาพอยู่ข้างใต้ ปริมาณแสงที่สะท้อนจากวัตถุในโลกทางกายภาพ (โลก 3 มิติ) จะผ่านเลนส์ของกล้องและกลายเป็นสัญญาณ 2 มิติและส่งผลให้เกิดการสร้างภาพ จากนั้นภาพนี้จะถูกแปลงเป็นดิจิทัลโดยใช้วิธีการประมวลผลสัญญาณจากนั้นภาพดิจิทัลนี้จะถูกจัดการในการประมวลผลภาพดิจิทัล

บทช่วยสอนนี้ครอบคลุมพื้นฐานของสัญญาณและระบบที่จำเป็นสำหรับการทำความเข้าใจแนวคิดของการประมวลผลภาพดิจิทัล ก่อนที่จะเข้าสู่แนวคิดรายละเอียดก่อนอื่นให้กำหนดคำศัพท์ง่ายๆ

สัญญาณ

ในวิศวกรรมไฟฟ้าปริมาณพื้นฐานของการแสดงข้อมูลบางอย่างเรียกว่าสัญญาณ ไม่สำคัญว่าข้อมูลนั้นคืออะไร: ข้อมูลอนาล็อกหรือดิจิทัล ในทางคณิตศาสตร์สัญญาณเป็นฟังก์ชันที่ถ่ายทอดข้อมูลบางอย่าง ในความเป็นจริงปริมาณใด ๆ ที่วัดได้ตลอดเวลาในอวกาศหรือมิติที่สูงกว่านั้นสามารถนำมาเป็นสัญญาณได้ สัญญาณอาจมีขนาดใดก็ได้และอาจอยู่ในรูปแบบใดก็ได้

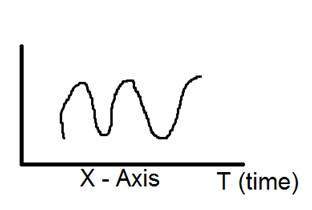

สัญญาณอนาล็อก

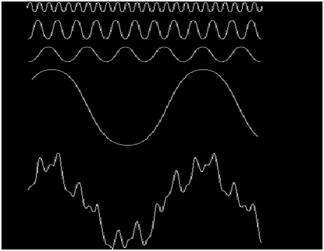

สัญญาณอาจเป็นปริมาณอะนาล็อกซึ่งหมายความว่ามีการกำหนดตามเวลา มันเป็นสัญญาณต่อเนื่อง สัญญาณเหล่านี้กำหนดไว้เหนือตัวแปรอิสระต่อเนื่อง วิเคราะห์ได้ยากเนื่องจากมีค่าเป็นจำนวนมาก มีความแม่นยำมากเนื่องจากมีตัวอย่างค่าจำนวนมาก ในการจัดเก็บสัญญาณเหล่านี้คุณต้องใช้หน่วยความจำที่ไม่มีที่สิ้นสุดเนื่องจากสามารถบรรลุค่าที่ไม่มีที่สิ้นสุดบนเส้นจริง สัญญาณแอนะล็อกแสดงโดยคลื่นบาป

ตัวอย่างเช่น:

เสียงของมนุษย์

เสียงของมนุษย์เป็นตัวอย่างของสัญญาณอนาล็อก เมื่อคุณพูดเสียงที่เกิดขึ้นจะเดินทางผ่านอากาศในรูปของคลื่นความดันดังนั้นจึงเป็นของฟังก์ชันทางคณิตศาสตร์โดยมีตัวแปรอิสระของพื้นที่และเวลาและค่าที่สอดคล้องกับความกดอากาศ

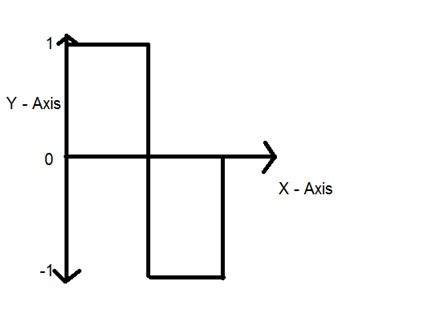

อีกตัวอย่างหนึ่งคือคลื่นบาปซึ่งแสดงในรูปด้านล่าง

Y = sin (x) โดยที่ x เป็นค่าไม่ระบุ

สัญญาณดิจิตอล

เมื่อเปรียบเทียบกับสัญญาณแอนะล็อกสัญญาณดิจิทัลนั้นวิเคราะห์ได้ง่ายมาก เป็นสัญญาณที่ไม่ต่อเนื่อง พวกเขาคือการจัดสรรสัญญาณอนาล็อก

คำว่าดิจิทัลย่อมาจากค่าที่ไม่ต่อเนื่องและด้วยเหตุนี้จึงหมายความว่าพวกเขาใช้ค่าเฉพาะเพื่อแสดงข้อมูลใด ๆ ในสัญญาณดิจิทัลจะใช้เพียงสองค่าเพื่อแสดงบางสิ่งเช่น: 1 และ 0 (ค่าไบนารี) สัญญาณดิจิทัลมีความแม่นยำน้อยกว่าเมื่อเทียบกับสัญญาณอนาล็อกเนื่องจากเป็นตัวอย่างที่ไม่ต่อเนื่องของสัญญาณแอนะล็อกในช่วงเวลาหนึ่ง อย่างไรก็ตามสัญญาณดิจิตอลจะไม่มีสัญญาณรบกวน ดังนั้นจึงอยู่ได้นานและง่ายต่อการตีความ สัญญาณดิจิทัลแสดงด้วยคลื่นสี่เหลี่ยม

ตัวอย่างเช่น:

แป้นพิมพ์คอมพิวเตอร์

เมื่อใดก็ตามที่กดปุ่มจากแป้นพิมพ์สัญญาณไฟฟ้าที่เหมาะสมจะถูกส่งไปยังตัวควบคุมแป้นพิมพ์ที่มีค่า ASCII คีย์นั้น ๆ ตัวอย่างเช่นสัญญาณไฟฟ้าที่สร้างขึ้นเมื่อกดปุ่มแป้นพิมพ์ a จะมีข้อมูลของตัวเลข 97 ในรูปแบบ 0 และ 1 ซึ่งเป็นค่า ASCII ของอักขระ a

ความแตกต่างระหว่างสัญญาณอนาล็อกและดิจิตอล

| องค์ประกอบการเปรียบเทียบ | สัญญาณอนาล็อก | สัญญาณดิจิตอล |

|---|---|---|

| การวิเคราะห์ | ยาก | วิเคราะห์ได้ |

| การเป็นตัวแทน | ต่อเนื่อง | ไม่ต่อเนื่อง |

| ความถูกต้อง | แม่นยำมากขึ้น | แม่นยำน้อยกว่า |

| การจัดเก็บ | หน่วยความจำไม่มีที่สิ้นสุด | จัดเก็บได้อย่างง่ายดาย |

| ขึ้นอยู่กับเสียงรบกวน | ใช่ | ไม่ |

| เทคนิคการบันทึก | สัญญาณดั้งเดิมจะถูกรักษาไว้ | ตัวอย่างของสัญญาณจะถูกถ่ายและเก็บรักษาไว้ |

| ตัวอย่าง | เสียงของมนุษย์เทอร์โมมิเตอร์โทรศัพท์อนาล็อก ฯลฯ | คอมพิวเตอร์โทรศัพท์ดิจิทัลปากกาดิจิทัล ฯลฯ |

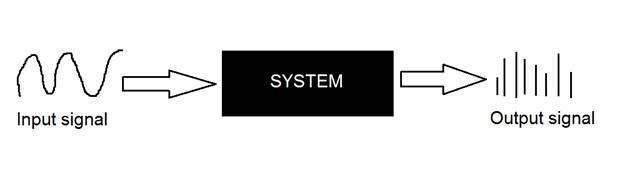

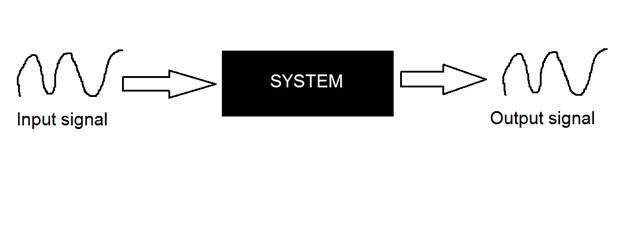

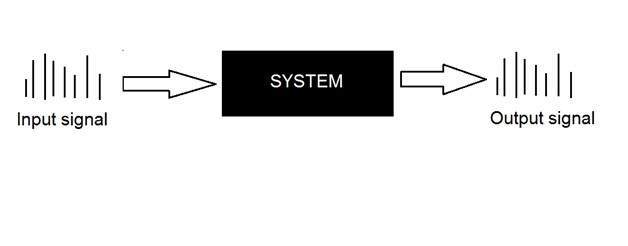

ระบบ

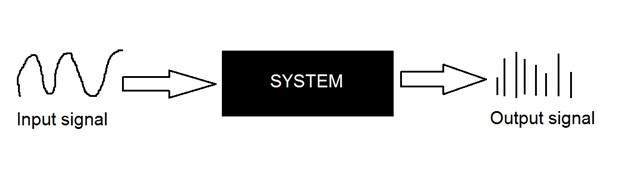

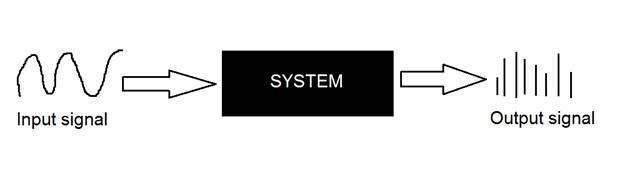

ระบบถูกกำหนดโดยประเภทของอินพุตและเอาต์พุตที่เกี่ยวข้อง เนื่องจากเรากำลังจัดการกับสัญญาณดังนั้นในกรณีของเราระบบของเราจะเป็นแบบจำลองทางคณิตศาสตร์ชิ้นส่วนของรหัส / ซอฟต์แวร์หรืออุปกรณ์ทางกายภาพหรือกล่องดำที่อินพุตเป็นสัญญาณและจะทำการประมวลผลบางอย่างกับสัญญาณนั้น และเอาต์พุตเป็นสัญญาณ อินพุตเรียกว่าการกระตุ้นและเอาต์พุตเรียกว่าการตอบสนอง

ในรูปด้านบนระบบได้แสดงให้เห็นว่าอินพุตและเอาต์พุตทั้งสองเป็นสัญญาณ แต่อินพุตเป็นสัญญาณอนาล็อก และเอาต์พุตเป็นสัญญาณดิจิตอล หมายความว่าระบบของเราเป็นระบบการแปลงที่แปลงสัญญาณแอนะล็อกเป็นสัญญาณดิจิทัล

มาดูด้านในของระบบกล่องดำนี้กัน

การแปลงสัญญาณอนาล็อกเป็นดิจิตอล

เนื่องจากมีแนวคิดมากมายที่เกี่ยวข้องกับการแปลงอนาล็อกเป็นดิจิทัลและในทางกลับกัน เราจะพูดถึงเฉพาะผู้ที่เกี่ยวข้องกับการประมวลผลภาพดิจิทัลเท่านั้น มีสองแนวคิดหลักที่เกี่ยวข้องกับการครอบคลุม

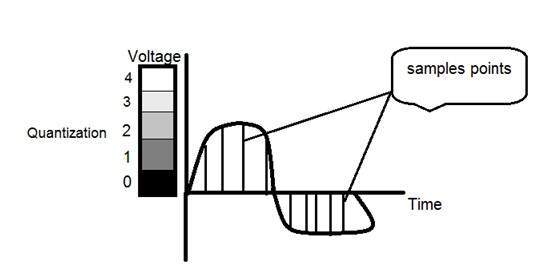

Sampling

Quantization

การสุ่มตัวอย่าง

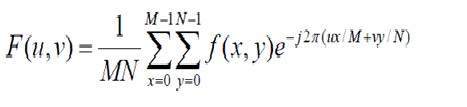

การสุ่มตัวอย่างตามชื่อที่แนะนำสามารถกำหนดได้ว่าเป็นตัวอย่าง เก็บตัวอย่างสัญญาณดิจิทัลบนแกน x การสุ่มตัวอย่างทำได้บนตัวแปรอิสระ ในกรณีของสมการทางคณิตศาสตร์นี้:

ทำการสุ่มตัวอย่างบนตัวแปร x นอกจากนี้เรายังสามารถกล่าวได้ว่าการแปลงแกน x (ค่าอนันต์) เป็นดิจิทัลทำได้ภายใต้การสุ่มตัวอย่าง

การสุ่มตัวอย่างแบ่งออกเป็นการสุ่มตัวอย่างขึ้นและการสุ่มตัวอย่างลง หากช่วงของค่าบนแกน x น้อยกว่าเราจะเพิ่มตัวอย่างของค่า สิ่งนี้เรียกว่าการสุ่มตัวอย่างขึ้นและในทางกลับกันเรียกว่าการสุ่มตัวอย่างลง

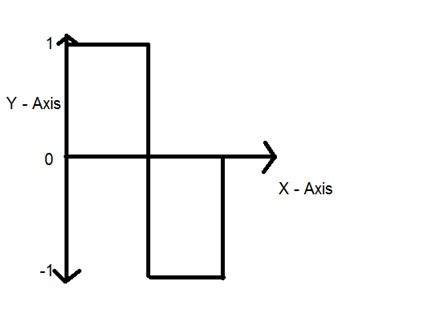

Quantization

Quantization ตามชื่อที่แนะนำสามารถกำหนดเป็นการแบ่งออกเป็น quanta (พาร์ติชัน) Quantization ทำโดยตัวแปรตาม มันตรงข้ามกับการสุ่มตัวอย่าง

ในกรณีของสมการทางคณิตศาสตร์นี้ y = sin (x)

Quantization ทำกับตัวแปร Y มันทำบนแกน y การแปลงค่าอนันต์แกน y เป็น 1, 0, -1 (หรือระดับอื่น ๆ ) เรียกว่า Quantization

ต่อไปนี้เป็นขั้นตอนพื้นฐานสองขั้นตอนที่เกี่ยวข้องในขณะที่แปลงสัญญาณแอนะล็อกเป็นสัญญาณดิจิทัล

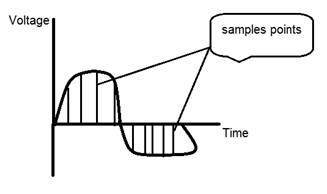

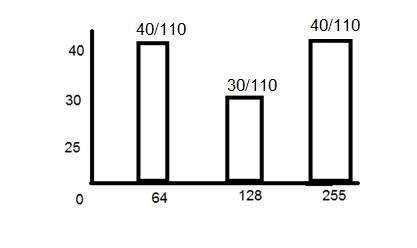

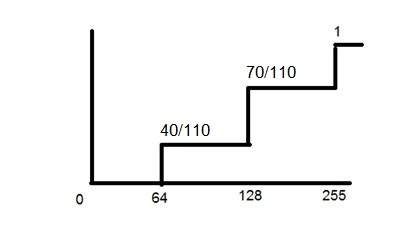

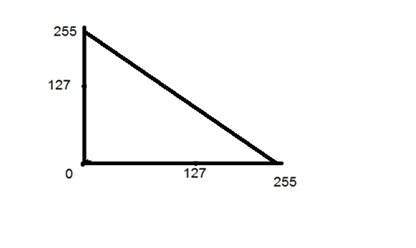

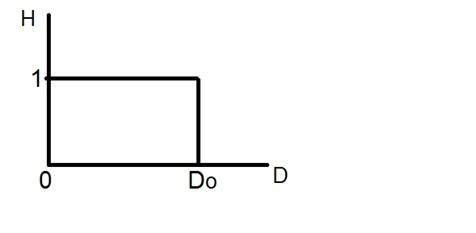

การหาปริมาณของสัญญาณแสดงไว้ในรูปด้านล่าง

ทำไมเราต้องแปลงสัญญาณอนาล็อกเป็นสัญญาณดิจิตอล

เหตุผลแรกและชัดเจนคือการประมวลผลภาพดิจิทัลเกี่ยวข้องกับภาพดิจิทัลนั่นคือสัญญาณดิจิทัล ดังนั้นเมื่อจับภาพได้ทุกครั้งภาพจะถูกแปลงเป็นรูปแบบดิจิทัลจากนั้นจึงประมวลผล

เหตุผลประการที่สองและสำคัญคือในการดำเนินการกับสัญญาณแอนะล็อกกับคอมพิวเตอร์ดิจิทัลคุณต้องเก็บสัญญาณแอนะล็อกนั้นไว้ในคอมพิวเตอร์ และในการจัดเก็บสัญญาณอะนาล็อกจำเป็นต้องใช้หน่วยความจำที่ไม่มีที่สิ้นสุดในการจัดเก็บ และเนื่องจากเป็นไปไม่ได้ดังนั้นเราจึงแปลงสัญญาณนั้นเป็นรูปแบบดิจิทัลแล้วเก็บไว้ในคอมพิวเตอร์ดิจิทัลจากนั้นจึงดำเนินการกับสัญญาณนั้น

ระบบต่อเนื่องกับระบบไม่ต่อเนื่อง

ระบบต่อเนื่อง

ประเภทของระบบที่อินพุตและเอาต์พุตทั้งสองเป็นสัญญาณต่อเนื่องหรือสัญญาณอะนาล็อกเรียกว่าระบบต่อเนื่อง

ระบบไม่ต่อเนื่อง

ประเภทของระบบที่อินพุตและเอาต์พุตทั้งสองเป็นสัญญาณไม่ต่อเนื่องหรือสัญญาณดิจิทัลเรียกว่าระบบดิจิทัล

ต้นกำเนิดของกล้องถ่ายรูป

ประวัติของกล้องและการถ่ายภาพไม่เหมือนกันอย่างแน่นอน แนวคิดของกล้องถูกนำมาใช้มากก่อนแนวคิดของการถ่ายภาพ

กล้อง Obscura

ประวัติของกล้องอยู่ในเอเชีย หลักการของกล้องถูกนำมาใช้ครั้งแรกโดยนักปรัชญาชาวจีน MOZI เป็นที่รู้จักกันในชื่อกล้องปิดบัง กล้องพัฒนามาจากหลักการนี้

คำว่า Camera Obscura พัฒนามาจากคำสองคำที่แตกต่างกัน กล้องและออบสคิวรา ความหมายของคำว่ากล้องคือห้องหรือห้องนิรภัยบางชนิดและ Obscura หมายถึงความมืด

แนวคิดที่ปราชญ์ชาวจีนนำมาใช้ประกอบด้วยอุปกรณ์ที่ฉายภาพโดยรอบบนผนัง อย่างไรก็ตามมันไม่ได้สร้างโดยชาวจีน

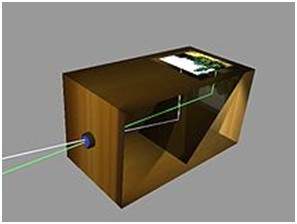

การสร้างกล้องปิดบัง

แนวคิดของภาษาจีนถูกนำมาสู่ความเป็นจริงโดยนักวิทยาศาสตร์มุสลิม Abu Ali Al-Hassan Ibn al-Haitham ที่รู้จักกันทั่วไปในชื่อ Ibn al-Haitham เขาสร้างกล้องถ่ายรูปตัวแรก กล้องของเขาเป็นไปตามหลักการของกล้องรูเข็ม เขาสร้างอุปกรณ์นี้ในที่ไหนสักแห่งประมาณ 1,000

กล้องพกพา

ในปี 1685 โยฮันน์ซาห์นสร้างกล้องแบบพกพาตัวแรก ก่อนการถือกำเนิดของอุปกรณ์นี้กล้องมีขนาดห้องและไม่สามารถพกพาได้ แม้ว่าอุปกรณ์จะถูกสร้างขึ้นโดยนักวิทยาศาสตร์ชาวไอริช Robert Boyle และ Robert Hooke ซึ่งเป็นกล้องที่สามารถพกพาได้ แต่อุปกรณ์นั้นก็ยังคงมีขนาดใหญ่มากในการพกพาจากที่หนึ่งไปอีกที่

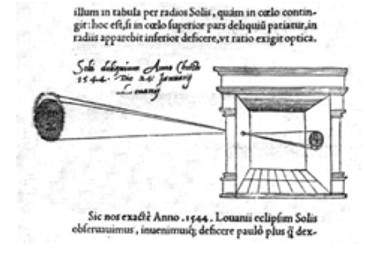

ที่มาของการถ่ายภาพ

แม้ว่ากล้องปิดบังจะสร้างขึ้นในปี 1000 โดยนักวิทยาศาสตร์มุสลิม แต่การใช้งานจริงครั้งแรกถูกอธิบายไว้ในศตวรรษที่ 13 โดยโรเจอร์เบคอนนักปรัชญาชาวอังกฤษ โรเจอร์แนะนำให้ใช้กล้องในการสังเกตสุริยุปราคา

ดาวินชี

แม้ว่าจะมีการปรับปรุงอย่างมากก่อนศตวรรษที่ 15 แต่การปรับปรุงและการค้นพบของ Leonardo di ser Piero da Vinci นั้นน่าทึ่งมาก ดาวินชีเป็นศิลปินนักดนตรีนักกายวิภาคศาสตร์และนักสงครามที่ยิ่งใหญ่ เขาได้รับเครดิตสำหรับสิ่งประดิษฐ์มากมาย ภาพวาดที่มีชื่อเสียงที่สุดชิ้นหนึ่งของเขา ได้แก่ ภาพวาดโมนาลิซา

Da Vinci ไม่เพียง แต่สร้างกล้องปิดบังตามหลักการของกล้องรูเข็มเท่านั้น แต่ยังใช้เป็นอุปกรณ์ช่วยในการวาดภาพสำหรับงานศิลปะของเขาด้วย ในผลงานของเขาซึ่งอธิบายไว้ใน Codex Atlanticus มีการกำหนดหลักการของกล้องถ่ายรูปมากมาย

กล้องของเขาเป็นไปตามหลักการของกล้องรูเข็มซึ่งสามารถอธิบายได้ว่า

เมื่อภาพของวัตถุที่ส่องสว่างทะลุผ่านรูเล็ก ๆ เข้าไปในห้องที่มืดมากคุณจะเห็น [บนผนังด้านตรงข้าม] วัตถุเหล่านี้ในรูปแบบและสีที่เหมาะสมลดขนาดลงในตำแหน่งที่กลับด้านเนื่องจากการตัดกันของรังสี

ภาพแรก

ภาพแรกถ่ายเมื่อปี พ.ศ. 2357 โดยนักประดิษฐ์ชาวฝรั่งเศส Joseph Nicephore Niepce เขาถ่ายภาพแรกของมุมมองจากหน้าต่างที่ Le Gras โดยการเคลือบแผ่นพิวเตอร์ด้วยน้ำมันดินและหลังจากนั้นให้แผ่นนั้นสัมผัสกับแสง

ภาพถ่ายใต้น้ำครั้งแรก

ภาพถ่ายใต้น้ำภาพแรกถ่ายโดยวิลเลียมทอมสันนักคณิตศาสตร์ชาวอังกฤษโดยใช้กล่องกันน้ำ สิ่งนี้ทำในปีพ. ศ. 2399

ที่มาของภาพยนตร์

ต้นกำเนิดของภาพยนตร์ได้รับการแนะนำโดยนักประดิษฐ์ชาวอเมริกันและผู้ใจบุญที่รู้จักกันในชื่อ George Eastman ซึ่งถือได้ว่าเป็นผู้บุกเบิกการถ่ายภาพ

เขาก่อตั้ง บริษัท ชื่อ Eastman Kodak ซึ่งมีชื่อเสียงในด้านการพัฒนาภาพยนตร์ บริษัท เริ่มผลิตฟิล์มกระดาษในปี พ.ศ. 2428 เขาสร้างกล้อง Kodak ขึ้นมาเป็นครั้งแรกจากนั้นจึงทำบราวนี่ Brownie เป็นกล้องถ่ายรูปแบบกล่องและได้รับความนิยมเนื่องจากคุณสมบัติของ Snapshot

หลังจากการถือกำเนิดของภาพยนตร์เรื่องนี้อุตสาหกรรมกล้องถ่ายรูปก็เติบโตขึ้นอีกครั้งและสิ่งประดิษฐ์หนึ่งก็นำไปสู่อีกสิ่งหนึ่ง

Leica และ Argus

Leica และ argus เป็นกล้องอนาล็อกสองตัวที่พัฒนาในปี 2468 และปี 2482 ตามลำดับ กล้อง Leica สร้างขึ้นโดยใช้ฟิล์มขนาด 35 มม.

Argus เป็นกล้องอะนาล็อกอีกตัวหนึ่งที่ใช้รูปแบบ 35 มม. และมีราคาค่อนข้างถูกเมื่อเทียบกับ Leica และได้รับความนิยมอย่างมาก

กล้องวงจรปิดแบบอนาล็อก

ในปีพ. ศ. 2485 วิศวกรชาวเยอรมัน Walter Bruch ได้พัฒนาและติดตั้งระบบแรกของกล้องวงจรปิดแบบอนาล็อก เขายังได้รับเครดิตจากการประดิษฐ์โทรทัศน์สีในปี 1960

ภาพ Pac

กล้องถ่ายรูปแบบใช้แล้วทิ้งตัวแรกเปิดตัวในปีพ. ศ. 2492 โดย Photo Pac กล้องนี้เป็นกล้องที่ใช้งานได้เพียงครั้งเดียวโดยมีม้วนฟิล์มอยู่แล้ว Photo pac รุ่นต่อมาสามารถกันน้ำได้และยังมีแฟลชอีกด้วย

กล้องดิจิตอล

Mavica โดย Sony

Mavica (กล้องวิดีโอแม่เหล็ก) เปิดตัวโดย Sony ในปี 1981 เป็นตัวเปลี่ยนเกมตัวแรกในโลกกล้องดิจิทัล ภาพถูกบันทึกลงในฟล็อปปี้ดิสก์และสามารถดูภาพได้ในภายหลังบนหน้าจอมอนิเตอร์ใด ๆ

ไม่ใช่กล้องดิจิตอลล้วน แต่เป็นกล้องอนาล็อก แต่ได้รับความนิยมเนื่องจากมีความสามารถในการจัดเก็บภาพบนฟล็อปปี้ดิสก์ หมายความว่าตอนนี้คุณสามารถจัดเก็บภาพได้เป็นระยะเวลานานและคุณสามารถบันทึกภาพจำนวนมากบนฟลอปปีซึ่งจะถูกแทนที่ด้วยแผ่นดิสก์เปล่าแผ่นใหม่เมื่อเต็ม Mavica มีความจุในการจัดเก็บภาพ 25 ภาพในดิสก์

สิ่งที่สำคัญอีกอย่างหนึ่งที่ mavica แนะนำคือความจุ 0.3 เมกะพิกเซลในการถ่ายภาพ

กล้องดิจิตอล

Fuji DS-1P camera โดยฟิล์มฟูจิปี 1988 เป็นกล้องดิจิทัลตัวแรกที่แท้จริง

Nikon D1 เป็นกล้อง 2.74 ล้านพิกเซลและเป็นกล้องดิจิตอล SLR เชิงพาณิชย์ตัวแรกที่พัฒนาโดย Nikon และมีราคาไม่แพงมากสำหรับมืออาชีพ

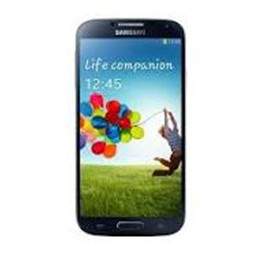

ปัจจุบันกล้องดิจิตอลรวมอยู่ในโทรศัพท์มือถือที่มีความละเอียดและคุณภาพสูงมาก

เนื่องจากการประมวลผลภาพดิจิทัลมีแอพพลิเคชั่นที่กว้างมากและเกือบทุกสาขาทางเทคนิคได้รับผลกระทบจาก DIP เราจะพูดถึงแอพพลิเคชั่นหลัก ๆ ของ DIP

การประมวลผลภาพดิจิทัลไม่ได้ จำกัด เพียงแค่การปรับความละเอียดเชิงพื้นที่ของภาพในชีวิตประจำวันที่กล้องถ่าย ไม่ได้ จำกัด เพียงแค่การเพิ่มความสว่างของภาพถ่ายเท่านั้น แต่ยังมีมากกว่านั้นอีกด้วย

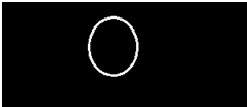

คลื่นแม่เหล็กไฟฟ้าสามารถคิดได้ว่าเป็นกระแสของอนุภาคที่อนุภาคแต่ละอนุภาคเคลื่อนที่ด้วยความเร็วแสง อนุภาคแต่ละตัวมีกลุ่มพลังงาน กลุ่มของพลังงานนี้เรียกว่าโฟตอน

สเปกตรัมแม่เหล็กไฟฟ้าตามพลังงานของโฟตอนแสดงไว้ด้านล่าง

ในสเปกตรัมแม่เหล็กไฟฟ้านี้เราสามารถมองเห็นได้เฉพาะสเปกตรัมที่มองเห็นได้ สเปกตรัมที่มองเห็นได้ส่วนใหญ่ประกอบด้วยสีที่แตกต่างกันเจ็ดสีซึ่งโดยทั่วไปเรียกว่า (VIBGOYR) VIBGOYR ย่อมาจากสีม่วงครามน้ำเงินเขียวส้มเหลืองและแดง

แต่นั่นไม่ได้ทำให้สิ่งอื่น ๆ ในสเปกตรัมเป็นโมฆะ ตามนุษย์ของเราสามารถมองเห็นได้เฉพาะส่วนที่มองเห็นได้ซึ่งเราเห็นวัตถุทั้งหมด แต่กล้องสามารถมองเห็นสิ่งอื่น ๆ ที่ตาเปล่าไม่สามารถมองเห็นได้ ตัวอย่างเช่นรังสีเอกซ์รังสีแกมมา ฯลฯ ดังนั้นการวิเคราะห์ทุกสิ่งนั้นก็ทำในการประมวลผลภาพดิจิทัลเช่นกัน

การสนทนานี้นำไปสู่คำถามอื่นซึ่งก็คือ

ทำไมเราต้องวิเคราะห์สิ่งอื่น ๆ ทั้งหมดในสเปกตรัม EM ด้วย?

คำตอบสำหรับคำถามนี้อยู่ในความจริงเนื่องจากสิ่งอื่น ๆ เช่น XRay ถูกนำมาใช้กันอย่างแพร่หลายในด้านการแพทย์ การวิเคราะห์รังสีแกมมามีความจำเป็นเนื่องจากมีการใช้กันอย่างแพร่หลายในเวชศาสตร์นิวเคลียร์และการสังเกตทางดาราศาสตร์ เช่นเดียวกันกับสิ่งที่เหลือในสเปกตรัม EM

การประยุกต์ใช้การประมวลผลภาพดิจิทัล

สาขาหลักบางสาขาที่ใช้กันอย่างแพร่หลายในการประมวลผลภาพดิจิทัลมีการกล่าวถึงด้านล่าง

การเพิ่มความคมชัดและการฟื้นฟูภาพ

ด้านการแพทย์

การสำรวจระยะไกล

การส่งและการเข้ารหัส

วิสัยทัศน์ของเครื่องจักร / หุ่นยนต์

การประมวลผลสี

การจดจำรูปแบบ

การประมวลผลวิดีโอ

การถ่ายภาพด้วยกล้องจุลทรรศน์

Others

การเพิ่มความคมชัดและการฟื้นฟูภาพ

การเพิ่มความคมชัดและการคืนค่าภาพหมายถึงการประมวลผลภาพที่ถ่ายจากกล้องสมัยใหม่เพื่อทำให้ได้ภาพที่ดีขึ้นหรือเพื่อปรับแต่งภาพเหล่านั้นเพื่อให้ได้ผลลัพธ์ที่ต้องการ หมายถึงการทำในสิ่งที่ Photoshop มักทำ

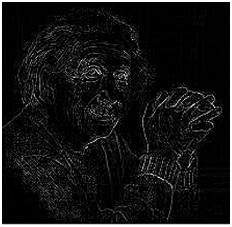

ซึ่งรวมถึงการซูมการเบลอการทำให้คมชัดระดับสีเทาเป็นการแปลงสีการตรวจจับขอบและในทางกลับกันการดึงภาพและการจดจำภาพ ตัวอย่างทั่วไป ได้แก่ :

ภาพต้นฉบับ

ภาพที่ซูม

ภาพเบลอ

ภาพคมชัด

ขอบ

ด้านการแพทย์

การใช้งานทั่วไปของ DIP ในด้านการแพทย์คือ

การถ่ายภาพรังสีแกมมา

สแกน PET

การถ่ายภาพเอ็กซ์เรย์

CT ทางการแพทย์

การถ่ายภาพ UV

การถ่ายภาพ UV

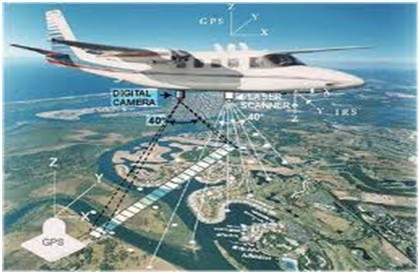

ในด้านการสำรวจระยะไกลพื้นที่ของโลกจะถูกสแกนโดยดาวเทียมหรือจากที่สูงมากจากนั้นจึงวิเคราะห์เพื่อให้ได้ข้อมูลเกี่ยวกับมัน การประยุกต์ใช้การประมวลผลภาพดิจิทัลโดยเฉพาะอย่างยิ่งในด้านการสำรวจระยะไกลคือการตรวจจับความเสียหายของโครงสร้างพื้นฐานที่เกิดจากแผ่นดินไหว

เนื่องจากต้องใช้เวลานานขึ้นในการทำความเข้าใจความเสียหายแม้ว่าจะเน้นที่ความเสียหายร้ายแรงก็ตาม เนื่องจากบางครั้งพื้นที่ที่ได้รับผลกระทบจากแผ่นดินไหวมีความกว้างมากจนไม่สามารถตรวจสอบด้วยตามนุษย์เพื่อประเมินความเสียหายได้ แม้ว่าจะเป็นอย่างนั้นก็เป็นขั้นตอนที่เร่งรีบและใช้เวลานานมาก ดังนั้นวิธีแก้ปัญหานี้จึงพบได้ในการประมวลผลภาพดิจิทัล ภาพของพื้นที่ที่ได้รับผลกระทบถูกจับจากพื้นดินด้านบนจากนั้นจึงวิเคราะห์เพื่อตรวจจับความเสียหายประเภทต่างๆที่เกิดจากแผ่นดินไหว

ขั้นตอนสำคัญในการวิเคราะห์ ได้แก่

การสกัดขอบ

การวิเคราะห์และการปรับปรุงขอบประเภทต่างๆ

การส่งและการเข้ารหัส

ภาพแรกที่ถูกส่งผ่านสายไฟคือจากลอนดอนไปนิวยอร์กผ่านเคเบิลใต้น้ำ รูปภาพที่ถูกส่งแสดงด้านล่าง

รูปภาพที่ถูกส่งใช้เวลาสามชั่วโมงในการเข้าถึงจากที่หนึ่งไปยังอีกที่หนึ่ง

ลองนึกภาพดูสิว่าวันนี้เราสามารถดูฟีดวิดีโอสดหรือภาพกล้องวงจรปิดสดจากทวีปหนึ่งไปยังอีกทวีปหนึ่งได้ด้วยความล่าช้าเพียงไม่กี่วินาที หมายความว่ามีการทำงานในสาขานี้มากเกินไป ฟิลด์นี้ไม่ได้เน้นเฉพาะการส่งเท่านั้น แต่ยังรวมถึงการเข้ารหัสด้วย มีการพัฒนารูปแบบต่างๆมากมายสำหรับแบนด์วิดท์สูงหรือต่ำเพื่อเข้ารหัสภาพถ่ายจากนั้นสตรีมผ่านอินเทอร์เน็ตหรืออื่น ๆ

วิสัยทัศน์ของเครื่องจักร / หุ่นยนต์

นอกเหนือจากความท้าทายมากมายที่หุ่นยนต์เผชิญอยู่ในปัจจุบันความท้าทายที่ยิ่งใหญ่ที่สุดอย่างหนึ่งก็คือการเพิ่มวิสัยทัศน์ของหุ่นยนต์ ทำให้หุ่นยนต์สามารถมองเห็นสิ่งต่างๆระบุสิ่งเหล่านั้นระบุสิ่งกีดขวาง ฯลฯ มีงานมากมายที่ได้รับการสนับสนุนจากสาขานี้และได้มีการนำสาขาการมองเห็นคอมพิวเตอร์อื่น ๆ มาใช้ในการทำงานกับมัน

การตรวจจับอุปสรรค์

การตรวจจับสิ่งกีดขวางเป็นหนึ่งในงานทั่วไปที่ทำผ่านการประมวลผลภาพโดยการระบุประเภทของวัตถุต่างๆในภาพจากนั้นคำนวณระยะห่างระหว่างหุ่นยนต์และสิ่งกีดขวาง

หุ่นยนต์สาวกไลน์

หุ่นยนต์ส่วนใหญ่ในปัจจุบันทำงานโดยทำตามเส้นจึงเรียกว่าหุ่นยนต์ผู้ติดตามสาย วิธีนี้ช่วยให้หุ่นยนต์เคลื่อนที่ไปตามเส้นทางและทำงานบางอย่างได้ สิ่งนี้สามารถทำได้โดยการประมวลผลภาพ

การประมวลผลสี

การประมวลผลสีรวมถึงการประมวลผลภาพสีและช่องว่างสีต่างๆที่ใช้ ตัวอย่างเช่นรุ่นสี RGB, YCbCr, HSV นอกจากนี้ยังเกี่ยวข้องกับการศึกษาการส่งการจัดเก็บและการเข้ารหัสภาพสีเหล่านี้

การจดจำรูปแบบ

การจดจำรูปแบบเกี่ยวข้องกับการศึกษาจากการประมวลผลภาพและจากสาขาอื่น ๆ ที่รวมถึงการเรียนรู้ของเครื่อง (สาขาหนึ่งของปัญญาประดิษฐ์) ในการจดจำรูปแบบจะใช้การประมวลผลภาพเพื่อระบุวัตถุในรูปภาพจากนั้นจะใช้การเรียนรู้ของเครื่องเพื่อฝึกระบบสำหรับการเปลี่ยนแปลงรูปแบบ การจดจำรูปแบบใช้ในการวินิจฉัยโดยใช้คอมพิวเตอร์ช่วยการจดจำลายมือการจดจำรูปภาพเป็นต้น

การประมวลผลวิดีโอ

วิดีโอไม่ได้เป็นเพียงแค่การเคลื่อนไหวที่รวดเร็วของรูปภาพเท่านั้น คุณภาพของวิดีโอขึ้นอยู่กับจำนวนเฟรม / รูปภาพต่อนาทีและคุณภาพของแต่ละเฟรมที่ใช้ การประมวลผลวิดีโอเกี่ยวข้องกับการลดสัญญาณรบกวนการเพิ่มรายละเอียดการตรวจจับการเคลื่อนไหวการแปลงอัตราเฟรมการแปลงอัตราส่วนการแปลงพื้นที่สีเป็นต้น

เราจะดูตัวอย่างนี้เพื่อทำความเข้าใจแนวคิดของมิติ

คิดว่าคุณมีเพื่อนที่อาศัยอยู่บนดวงจันทร์และเขาต้องการส่งของขวัญให้คุณเป็นของขวัญวันเกิด เขาถามคุณเกี่ยวกับที่อยู่อาศัยของคุณบนโลก ปัญหาเดียวคือบริการจัดส่งบนดวงจันทร์ไม่เข้าใจที่อยู่ตามตัวอักษร แต่จะเข้าใจเฉพาะพิกัดที่เป็นตัวเลขเท่านั้น แล้วคุณจะส่งตำแหน่งของคุณให้เขาบนโลกได้อย่างไร?

นั่นคือที่มาของแนวคิดเรื่องมิติ มิติกำหนดจำนวนจุดต่ำสุดที่ต้องใช้ในการชี้ตำแหน่งของวัตถุใด ๆ ภายในช่องว่าง

กลับไปที่ตัวอย่างของเราอีกครั้งที่คุณต้องส่งตำแหน่งบนโลกให้เพื่อนบนดวงจันทร์ คุณส่งพิกัดสามคู่ให้เขา อันแรกเรียกว่าลองจิจูดอันที่สองเรียกว่าละติจูดและอันที่สามเรียกว่าระดับความสูง

พิกัดทั้งสามนี้กำหนดตำแหน่งของคุณบนพื้นโลก สองตัวแรกกำหนดตำแหน่งของคุณและอันที่สามกำหนดความสูงของคุณเหนือระดับน้ำทะเล

นั่นหมายความว่าต้องมีเพียงสามพิกัดเท่านั้นที่จะกำหนดตำแหน่งของคุณบนโลกได้ นั่นหมายความว่าคุณอาศัยอยู่ในโลกที่เป็น 3 มิติ และด้วยเหตุนี้จึงไม่เพียงตอบคำถามเกี่ยวกับมิติ แต่ยังตอบเหตุผลว่าทำไมเราจึงอาศัยอยู่ในโลก 3 มิติ

เนื่องจากเรากำลังศึกษาแนวคิดนี้โดยอ้างอิงถึงการประมวลผลภาพดิจิทัลดังนั้นตอนนี้เราจะเชื่อมโยงแนวคิดเรื่องมิตินี้กับรูปภาพ

ขนาดของภาพ

ดังนั้นถ้าเราอยู่ในโลก 3 มิติหมายถึงโลก 3 มิติแล้วขนาดของภาพที่เราจับได้คืออะไร ภาพเป็นสองมิตินั่นคือเหตุผลที่เรากำหนดภาพเป็นสัญญาณ 2 มิติด้วย รูปภาพมีความสูงและความกว้างเท่านั้น ภาพไม่มีความลึก เพียงแค่ดูที่ภาพด้านล่างนี้

หากคุณจะดูรูปด้านบนแสดงว่ามีแกนเพียงสองแกนคือแกนความสูงและความกว้าง คุณไม่สามารถรับรู้ความลึกจากภาพนี้ นั่นคือเหตุผลที่เรากล่าวว่าภาพเป็นสัญญาณสองมิติ แต่ตาของเราสามารถรับรู้วัตถุสามมิติได้ แต่จะมีการอธิบายเพิ่มเติมในบทช่วยสอนถัดไปเกี่ยวกับวิธีการทำงานของกล้องและการรับรู้ภาพ

การสนทนานี้นำไปสู่คำถามอื่น ๆ ว่าระบบ 3 มิติเกิดขึ้นจาก 2 มิติได้อย่างไร

โทรทัศน์ทำงานอย่างไร?

ถ้าเราดูภาพด้านบนเราจะเห็นว่ามันเป็นภาพสองมิติ ในการแปลงเป็นสามมิติเราต้องการมิติอื่น ให้ใช้เวลาเป็นมิติที่สามในกรณีนี้เราจะย้ายภาพสองมิตินี้ในช่วงเวลาของมิติที่สาม แนวคิดเดียวกับที่เกิดขึ้นในโทรทัศน์ซึ่งช่วยให้เรารับรู้ความลึกของวัตถุต่างๆบนหน้าจอ นั่นหมายความว่าสิ่งที่มาในทีวีหรือสิ่งที่เราเห็นในจอโทรทัศน์นั้นเป็น 3d เราสามารถใช่ เหตุผลก็คือในกรณีของทีวีเราถ้าเราเล่นวิดีโอ จากนั้นวิดีโอก็ไม่ใช่สิ่งอื่นใดนอกจากรูปภาพสองมิติจะเคลื่อนไปตามมิติเวลา เนื่องจากวัตถุสองมิติกำลังเคลื่อนผ่านมิติที่สามซึ่งเป็นเวลาดังนั้นเราจึงสามารถพูดได้ว่าเป็น 3 มิติ

ขนาดสัญญาณต่างกัน

สัญญาณ 1 มิติ

ตัวอย่างทั่วไปของสัญญาณ 1 มิติคือรูปคลื่น สามารถแทนค่าทางคณิตศาสตร์เป็น

F (x) = รูปคลื่น

โดยที่ x เป็นตัวแปรอิสระ เนื่องจากเป็นสัญญาณมิติเดียวดังนั้นจึงมีการใช้ตัวแปร x เพียงตัวเดียว

การแสดงภาพของสัญญาณมิติเดียวได้รับด้านล่าง:

รูปด้านบนแสดงสัญญาณมิติเดียว

ตอนนี้นำไปสู่คำถามอื่นซึ่งก็คือแม้ว่ามันจะเป็นสัญญาณมิติเดียวแล้วทำไมมันถึงมีสองแกน? คำตอบสำหรับคำถามนี้คือแม้ว่ามันจะเป็นสัญญาณหนึ่งมิติ แต่เรากำลังวาดมันในพื้นที่สองมิติ หรือเราสามารถพูดได้ว่าช่องว่างที่เราใช้แทนสัญญาณนี้เป็นสองมิติ นั่นเป็นเหตุให้ดูเหมือนสัญญาณสองมิติ

บางทีคุณอาจเข้าใจแนวคิดของมิติเดียวได้ดีขึ้นโดยดูรูปด้านล่าง

ตอนนี้อ้างอิงกลับไปที่การสนทนาครั้งแรกของเราเกี่ยวกับมิติพิจารณารูปด้านบนเป็นเส้นจริงที่มีจำนวนบวกจากจุดหนึ่งไปยังอีกจุดหนึ่ง ทีนี้ถ้าเราต้องอธิบายตำแหน่งของจุดใด ๆ บนเส้นนี้เราก็แค่ต้องการตัวเลขเพียงตัวเดียวซึ่งหมายถึงมิติเดียว

สัญญาณ 2 มิติ

ตัวอย่างทั่วไปของสัญญาณสองมิติคือภาพซึ่งได้กล่าวไปแล้วข้างต้น

ดังที่เราได้เห็นแล้วว่าภาพเป็นสัญญาณสองมิติกล่าวคือมีสองมิติ สามารถแสดงทางคณิตศาสตร์เป็น:

F (x, y) = รูปภาพ

โดยที่ x และ y เป็นสองตัวแปร แนวคิดของสองมิติสามารถอธิบายได้ในแง่ของคณิตศาสตร์เช่น:

ตอนนี้ในรูปด้านบนให้ติดป้ายที่มุมทั้งสี่ของสี่เหลี่ยมเป็น A, B, C และ D ตามลำดับ ถ้าเราเรียกส่วนของเส้นตรงหนึ่งส่วนในรูป AB และอีกแผ่นซีดีเราจะเห็นว่าส่วนคู่ขนานทั้งสองนี้รวมกันและสร้างเป็นกำลังสอง แต่ละส่วนของเส้นตรงสอดคล้องกับมิติเดียวดังนั้นส่วนของเส้นตรงทั้งสองนี้จึงสอดคล้องกับ 2 มิติ

สัญญาณ 3 มิติ

สัญญาณสามมิติตามชื่อหมายถึงสัญญาณที่มีสามมิติ ตัวอย่างที่พบบ่อยที่สุดได้รับการกล่าวถึงในตอนต้นซึ่งเป็นของโลกของเรา เราอาศัยอยู่ในโลกสามมิติ ตัวอย่างนี้ได้รับการกล่าวถึงอย่างละเอียดมาก อีกตัวอย่างหนึ่งของสัญญาณสามมิติคือลูกบาศก์หรือข้อมูลเชิงปริมาตรหรือตัวอย่างที่พบบ่อยที่สุดคือตัวการ์ตูนเคลื่อนไหวหรือ 3 มิติ

การแสดงทางคณิตศาสตร์ของสัญญาณสามมิติคือ:

F (x, y, z) = ตัวละครที่เคลื่อนไหว

แกนหรือมิติอื่น Z เกี่ยวข้องกับสามมิติซึ่งให้ภาพลวงตาของความลึก ในระบบพิกัดคาร์ทีเซียนสามารถดูได้ดังนี้:

สัญญาณ 4 มิติ

ในสัญญาณสี่มิติสี่มิติเกี่ยวข้อง สามตัวแรกเหมือนกับสัญญาณสามมิติคือ (X, Y, Z) และอันที่สี่ที่เพิ่มเข้ามาคือ T (เวลา) เวลามักเรียกว่ามิติชั่วคราวซึ่งเป็นวิธีการวัดการเปลี่ยนแปลง ในทางคณิตศาสตร์สัญญาณสี่ d สามารถระบุได้ดังนี้:

F (x, y, z, t) = ภาพยนตร์การ์ตูน

ตัวอย่างทั่วไปของสัญญาณ 4 มิติอาจเป็นภาพเคลื่อนไหว 3 มิติ เนื่องจากตัวละครแต่ละตัวเป็นตัวละคร 3 มิติและจากนั้นพวกเขาก็เคลื่อนไหวตามเวลาเนื่องจากเราเห็นภาพลวงตาของภาพยนตร์สามมิติเหมือนโลกแห่งความจริงมากขึ้น

นั่นหมายความว่าในความเป็นจริงภาพยนตร์แอนิเมชั่นมี 4 มิติคือการเคลื่อนไหวของตัวละคร 3 มิติในช่วงเวลามิติที่สี่

ดวงตาของมนุษย์ทำงานอย่างไร?

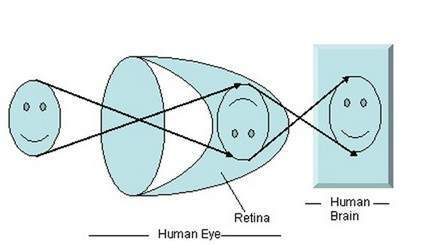

ก่อนที่เราจะพูดถึงการสร้างภาพในกล้องอะนาล็อกและดิจิตอลเราต้องหารือเกี่ยวกับการสร้างภาพบนดวงตาของมนุษย์ก่อน เนื่องจากหลักการพื้นฐานที่ตามมาด้วยกล้องนั้นถูกนำมาจากทางสายตามนุษย์จึงทำงานได้

เมื่อแสงตกกระทบกับวัตถุนั้นแสงจะสะท้อนกลับหลังจากกระทบกับวัตถุนั้น รังสีของแสงเมื่อผ่านเลนส์ตาก่อให้เกิดมุมเฉพาะและภาพจะเกิดขึ้นที่เรตินาซึ่งเป็นด้านหลังของผนัง ภาพที่เกิดขึ้นจะกลับหัว ภาพนี้ถูกตีความโดยสมองและนั่นทำให้เราสามารถเข้าใจสิ่งต่างๆ เนื่องจากการก่อตัวของมุมเราสามารถรับรู้ความสูงและความลึกของวัตถุที่เราเห็นได้ สิ่งนี้ได้รับการอธิบายเพิ่มเติมในบทช่วยสอนเรื่องการเปลี่ยนแปลงมุมมอง

ดังที่คุณเห็นในรูปด้านบนว่าเมื่อแสงดวงอาทิตย์ตกกระทบวัตถุ (ในกรณีนี้คือใบหน้าของวัตถุ) จะสะท้อนกลับและรังสีที่แตกต่างกันจะก่อให้เกิดมุมที่แตกต่างกันเมื่อส่งผ่านเลนส์และภาพกลับด้านของ วัตถุได้ถูกสร้างขึ้นที่ผนังด้านหลัง ส่วนสุดท้ายของรูปแสดงว่าวัตถุได้รับการตีความโดยสมองและกลับด้าน

ตอนนี้เรามาสนทนากันที่รูปแบบภาพในกล้องอนาล็อกและดิจิตอล

การสร้างภาพในกล้องอะนาล็อก

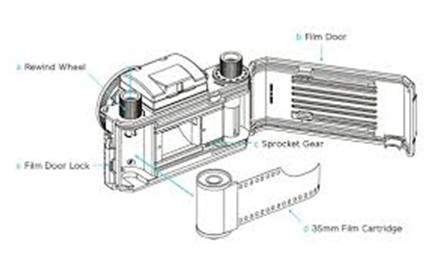

ในกล้องอะนาล็อกการสร้างภาพเกิดจากปฏิกิริยาทางเคมีที่เกิดขึ้นบนแถบที่ใช้ในการสร้างภาพ

ใช้แถบ 35 มม. ในกล้องอะนาล็อก แสดงในรูปด้วยตลับฟิล์ม 35 มม. แถบนี้เคลือบด้วยซิลเวอร์เฮไลด์ (สารเคมี)

ใช้แถบ 35 มม. ในกล้องอะนาล็อก แสดงในรูปด้วยตลับฟิล์ม 35 มม. แถบนี้เคลือบด้วยซิลเวอร์เฮไลด์ (สารเคมี)

แสงไม่ได้เป็นเพียงอนุภาคขนาดเล็กที่เรียกว่าอนุภาคโฟตอนดังนั้นเมื่ออนุภาคโฟตอนเหล่านี้ถูกส่งผ่านกล้องจะทำปฏิกิริยากับอนุภาคซิลเวอร์เฮไลด์บนแถบและส่งผลให้เงินซึ่งเป็นลบของภาพ

เพื่อให้เข้าใจได้ดีขึ้นลองดูสมการนี้

โฟตอน (อนุภาคแสง) + ซิลเวอร์เฮไลด์? สีเงิน? ภาพลบ

นี่เป็นเพียงพื้นฐานเท่านั้นแม้ว่าการสร้างภาพจะเกี่ยวข้องกับแนวคิดอื่น ๆ อีกมากมายเกี่ยวกับการผ่านของแสงภายในและแนวคิดของชัตเตอร์และความเร็วชัตเตอร์และรูรับแสงและการเปิด แต่สำหรับตอนนี้เราจะไปยังส่วนถัดไป แม้ว่าแนวคิดเหล่านี้ส่วนใหญ่จะได้รับการกล่าวถึงในบทแนะนำเรื่องชัตเตอร์และรูรับแสง

นี่เป็นเพียงพื้นฐานเท่านั้นแม้ว่าการสร้างภาพจะเกี่ยวข้องกับแนวคิดอื่น ๆ อีกมากมายเกี่ยวกับการผ่านของแสงภายในและแนวคิดของชัตเตอร์และความเร็วชัตเตอร์และรูรับแสงและการเปิด แต่สำหรับตอนนี้เราจะไปยังส่วนถัดไป แม้ว่าแนวคิดเหล่านี้ส่วนใหญ่จะได้รับการกล่าวถึงในบทแนะนำเรื่องชัตเตอร์และรูรับแสง

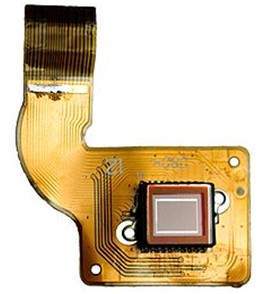

การสร้างภาพในกล้องดิจิทัล

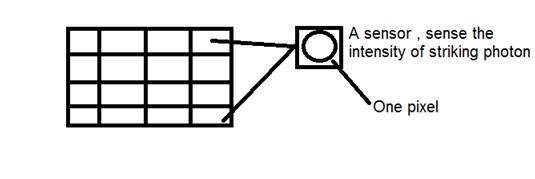

ในกล้องดิจิทัลการสร้างภาพไม่ได้เกิดจากปฏิกิริยาทางเคมีที่เกิดขึ้น แต่มันค่อนข้างซับซ้อนกว่านี้ ในกล้องดิจิทัลอาร์เรย์ CCD ใช้สำหรับการสร้างภาพ

การสร้างภาพผ่านอาร์เรย์ CCD

CCD ย่อมาจากอุปกรณ์ชาร์จคู่ เป็นเซ็นเซอร์ภาพและเช่นเดียวกับเซ็นเซอร์อื่น ๆ ที่ตรวจจับค่าและแปลงเป็นสัญญาณไฟฟ้า ในกรณีของ CCD จะตรวจจับภาพและแปลงเป็นสัญญาณไฟฟ้าเป็นต้น

CCD นี้อยู่ในรูปของอาร์เรย์หรือตารางสี่เหลี่ยม มันเหมือนกับเมทริกซ์ที่เซลล์แต่ละเซลล์ในเมทริกซ์มีเซ็นเซอร์ที่ตรวจจับความเข้มของโฟตอน

เช่นเดียวกับกล้องอะนาล็อกในกรณีของดิจิตอลเช่นกันเมื่อแสงตกกระทบวัตถุแสงจะสะท้อนกลับหลังจากกระทบวัตถุและอนุญาตให้เข้าไปในกล้องได้

เซ็นเซอร์แต่ละตัวของอาร์เรย์ CCD นั้นเป็นเซ็นเซอร์อนาล็อก เมื่อโฟตอนของแสงกระทบกับชิปจะมีประจุไฟฟ้าเพียงเล็กน้อยในเซ็นเซอร์ภาพถ่ายแต่ละตัว การตอบสนองของเซ็นเซอร์แต่ละตัวจะเท่ากับปริมาณแสงหรือพลังงาน (โฟตอน) ที่ขีดทับบนพื้นผิวของเซ็นเซอร์โดยตรง

เนื่องจากเราได้กำหนดภาพเป็นสัญญาณสองมิติแล้วและเนื่องจากการก่อตัวของอาร์เรย์ CCD สองมิติภาพที่สมบูรณ์จึงสามารถทำได้จากอาร์เรย์ CCD นี้

มีเซ็นเซอร์จำนวน จำกัด และหมายความว่าสามารถจับรายละเอียดได้อย่าง จำกัด นอกจากนี้เซ็นเซอร์แต่ละตัวยังสามารถมีค่าเดียวกับอนุภาคโฟตอนแต่ละตัวที่กระทบกับมัน

ดังนั้นจำนวนโฟตอนที่โดดเด่น (ปัจจุบัน) จึงถูกนับและจัดเก็บ เพื่อที่จะวัดสิ่งเหล่านี้ได้อย่างแม่นยำเซนเซอร์ CMOS ภายนอกจะติดมากับอาร์เรย์ CCD ด้วย

รู้เบื้องต้นเกี่ยวกับพิกเซล

ค่าของเซ็นเซอร์แต่ละตัวของอาร์เรย์ CCD หมายถึงค่าของแต่ละพิกเซล จำนวนเซ็นเซอร์ = จำนวนพิกเซล นอกจากนี้ยังหมายความว่าเซ็นเซอร์แต่ละตัวสามารถมีได้เพียงค่าเดียวเท่านั้น

กำลังจัดเก็บภาพ

ประจุที่จัดเก็บโดยอาร์เรย์ CCD จะถูกแปลงเป็นแรงดันไฟฟ้าทีละพิกเซล ด้วยความช่วยเหลือของวงจรเพิ่มเติมแรงดันไฟฟ้านี้จะถูกแปลงเป็นข้อมูลดิจิทัลจากนั้นจะถูกเก็บไว้

แต่ละ บริษัท ที่ผลิตกล้องดิจิทัลจะทำเซ็นเซอร์ CCD ของตัวเอง ซึ่งรวมถึง Sony, Mistubishi, Nikon, Samsung, Toshiba, FujiFilm, Canon เป็นต้น

นอกเหนือจากปัจจัยอื่น ๆ แล้วคุณภาพของภาพที่ถ่ายยังขึ้นอยู่กับประเภทและคุณภาพของอาร์เรย์ CCD ที่ใช้

ในบทช่วยสอนนี้เราจะพูดถึงแนวคิดพื้นฐานเกี่ยวกับกล้องเช่นรูรับแสงชัตเตอร์ความเร็วชัตเตอร์ ISO และเราจะพูดถึงการใช้แนวคิดเหล่านี้ร่วมกันเพื่อถ่ายภาพที่ดี

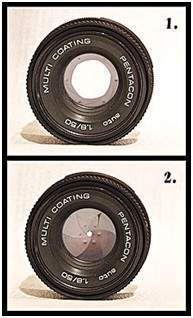

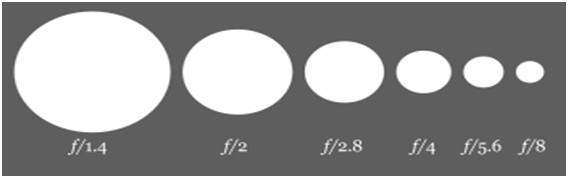

รูรับแสง

รูรับแสงคือช่องเล็ก ๆ ที่ช่วยให้แสงเดินทางเข้าไปในกล้องได้ นี่คือภาพของรูรับแสง

คุณจะเห็นใบมีดเล็ก ๆ เหมือนสิ่งของอยู่ในรูรับแสง ใบมีดเหล่านี้สร้างรูปทรงแปดเหลี่ยมที่สามารถเปิดปิดได้ ดังนั้นจึงสมเหตุสมผลที่ยิ่งใบพัดจะเปิดมากขึ้นช่องที่แสงจะต้องผ่านก็จะใหญ่ขึ้น ยิ่งรูใหญ่เท่าไหร่แสงก็ยิ่งเข้าได้มากขึ้นเท่านั้น

ผลกระทบ

เอฟเฟกต์ของรูรับแสงจะสัมพันธ์โดยตรงกับความสว่างและความมืดของภาพ หากช่องรับแสงกว้างก็จะทำให้แสงผ่านเข้าสู่กล้องได้มากขึ้น แสงที่มากขึ้นจะส่งผลให้มีโฟตอนมากขึ้นซึ่งจะส่งผลให้ภาพสว่างขึ้นในที่สุด

ตัวอย่างนี้แสดงไว้ด้านล่าง

พิจารณาภาพถ่ายสองภาพนี้

ด้านขวาจะดูสว่างกว่านั่นหมายความว่าเมื่อถ่ายด้วยกล้องรูรับแสงจะเปิดกว้าง เมื่อเปรียบเทียบกับภาพอื่นทางด้านซ้ายซึ่งมืดมากเมื่อเทียบกับภาพแรกนั่นแสดงให้เห็นว่าเมื่อถ่ายภาพนั้นรูรับแสงไม่ได้เปิดกว้าง

ขนาด

ตอนนี้ให้พูดคุยเกี่ยวกับคณิตศาสตร์ที่อยู่เบื้องหลังรูรับแสง ขนาดของรูรับแสงแสดงด้วยค่า af และมันแปรผกผันกับการเปิดรูรับแสง

นี่คือสองสมการที่อธิบายแนวคิดนี้ได้ดีที่สุด

ขนาดรูรับแสงกว้าง = ค่า f เล็ก

ขนาดรูรับแสงเล็ก = ค่า f มากกว่า

ในภาพสามารถแสดงเป็น:

ชัตเตอร์

หลังจากรูรับแสงแล้วจะมีชัตเตอร์ แสงเมื่อปล่อยให้ผ่านจากรูรับแสงจะตกกระทบกับชัตเตอร์โดยตรง ชัตเตอร์คือฝาปิดหน้าต่างที่ปิดสนิทหรืออาจคิดว่าเป็นม่านก็ได้ โปรดจำไว้ว่าเมื่อเราพูดถึงเซ็นเซอร์ CCD อาร์เรย์ที่สร้างภาพ ด้านหลังชัตเตอร์คือเซ็นเซอร์ ชัตเตอร์จึงเป็นเพียงสิ่งเดียวที่อยู่ระหว่างการสร้างภาพและแสงเมื่อผ่านรูรับแสง

ทันทีที่ชัตเตอร์เปิดขึ้นแสงจะตกที่เซ็นเซอร์ภาพและภาพจะเกิดขึ้นบนอาร์เรย์

ผลกระทบ

หากชัตเตอร์ปล่อยให้แสงผ่านไปนานกว่านี้ภาพจะสว่างขึ้น ในทำนองเดียวกันภาพที่มืดกว่าจะเกิดขึ้นเมื่อชัตเตอร์ได้รับอนุญาตให้เคลื่อนที่อย่างรวดเร็วดังนั้นแสงที่อนุญาตให้ผ่านจึงมีโฟตอนน้อยมากและภาพที่เกิดขึ้นบนเซ็นเซอร์อาร์เรย์ CCD จะมืดมาก

ชัตเตอร์มีแนวคิดหลักอีกสองประการ:

ความเร็วชัตเตอร์

เวลาชัตเตอร์

ความเร็วชัตเตอร์

ความเร็วชัตเตอร์สามารถเรียกได้ว่าเป็นจำนวนครั้งที่ชัตเตอร์เปิดหรือปิด จำไว้ว่าเราไม่ได้พูดถึงระยะเวลาที่ชัตเตอร์เปิดหรือปิด

เวลาชัตเตอร์

เวลาชัตเตอร์สามารถกำหนดเป็น

เมื่อชัตเตอร์เปิดขึ้นระยะเวลารอจนกว่าจะปิดเรียกว่าเวลาชัตเตอร์

ในกรณีนี้เราไม่ได้พูดถึงกี่ครั้งที่ชัตเตอร์เปิดหรือปิด แต่เรากำลังพูดถึงเวลาที่ยังคงเปิดกว้าง

ตัวอย่างเช่น:

เราสามารถเข้าใจแนวคิดทั้งสองนี้ได้ดีขึ้นด้วยวิธีนี้ นั่นหมายความว่าชัตเตอร์จะเปิด 15 ครั้งแล้วจึงปิดและแต่ละครั้งจะเปิดเป็นเวลา 1 วินาทีแล้วจึงปิด ในตัวอย่างนี้ 15 คือความเร็วชัตเตอร์และ 1 วินาทีคือเวลาชัตเตอร์

ความสัมพันธ์

ความสัมพันธ์ระหว่างความเร็วชัตเตอร์และเวลาชัตเตอร์คือทั้งคู่มีสัดส่วนผกผันซึ่งกันและกัน

ความสัมพันธ์นี้สามารถกำหนดได้ในสมการด้านล่าง

ความเร็วชัตเตอร์มากขึ้น = เวลาชัตเตอร์น้อยลง

ความเร็วชัตเตอร์น้อยลง = เวลาชัตเตอร์มากขึ้น

คำอธิบาย:

ยิ่งใช้เวลาน้อยเท่าไหร่ความเร็วก็ยิ่งมากขึ้นเท่านั้น และยิ่งต้องใช้เวลามากเท่าไหร่ความเร็วก็ยิ่งน้อยลงเท่านั้น

การใช้งาน

ทั้งสองแนวคิดร่วมกันทำให้เกิดการใช้งานที่หลากหลาย บางส่วนได้รับด้านล่าง

วัตถุที่เคลื่อนไหวเร็ว:

หากคุณต้องการถ่ายภาพของวัตถุที่เคลื่อนที่เร็วอาจเป็นรถยนต์หรืออะไรก็ได้ การปรับความเร็วชัตเตอร์และเวลาจะมีผลอย่างมาก

ดังนั้นในการจับภาพเช่นนี้เราจะทำการแก้ไขสองครั้ง:

เพิ่มความเร็วชัตเตอร์

ลดเวลาชัตเตอร์

สิ่งที่เกิดขึ้นคือเมื่อเราเพิ่มความเร็วชัตเตอร์จำนวนครั้งมากขึ้นชัตเตอร์จะเปิดหรือปิด หมายความว่าตัวอย่างแสงที่แตกต่างกันจะยอมให้ผ่านเข้ามาได้และเมื่อเราลดเวลาชัตเตอร์ลงนั่นหมายความว่าเราจะจับภาพฉากนั้นทันทีและปิดประตูชัตเตอร์

หากคุณทำเช่นนี้คุณจะได้ภาพที่คมชัดของวัตถุที่เคลื่อนไหวเร็ว

เพื่อที่จะเข้าใจเราจะดูตัวอย่างนี้ สมมติว่าคุณต้องการถ่ายภาพการตกน้ำที่เคลื่อนไหวอย่างรวดเร็ว

คุณตั้งค่าความเร็วชัตเตอร์เป็น 1 วินาทีและคุณถ่ายภาพ นี่คือสิ่งที่คุณจะได้รับ

จากนั้นตั้งค่าความเร็วชัตเตอร์ให้เร็วขึ้นเท่านี้คุณก็จะได้

จากนั้นอีกครั้งคุณตั้งค่าความเร็วชัตเตอร์ให้เร็วยิ่งขึ้นและคุณจะได้รับ

คุณจะเห็นในภาพสุดท้ายว่าเราเพิ่มความเร็วชัตเตอร์ให้เร็วมากนั่นหมายความว่าชัตเตอร์จะเปิดหรือปิดใน 200 วินาที 1 วินาทีและเราได้ภาพที่คมชัด

ISO

ค่า ISO ถูกวัดเป็นตัวเลข หมายถึงความไวของแสงต่อกล้อง หากค่า ISO ต่ำลงหมายความว่ากล้องของเรามีความไวต่อแสงน้อยลงและหากค่า ISO สูงแสดงว่ามีความไวแสงมากกว่า

ผลกระทบ

ยิ่ง ISO สูงเท่าไหร่ภาพก็จะยิ่งสว่างมากขึ้นเท่านั้น หากตั้งค่า ISO ไว้ที่ 1600 ภาพจะสว่างขึ้นมากและในทางกลับกัน

ผลข้างเคียง

หาก ISO เพิ่มขึ้นสัญญาณรบกวนในภาพจะเพิ่มขึ้นด้วย ปัจจุบัน บริษัท ผลิตกล้องส่วนใหญ่กำลังดำเนินการลบสัญญาณรบกวนออกจากภาพเมื่อตั้งค่า ISO ไว้ที่ความเร็วสูงขึ้น

พิกเซล

พิกเซลเป็นองค์ประกอบที่เล็กที่สุดของรูปภาพ แต่ละพิกเซลสอดคล้องกับค่าใดค่าหนึ่ง ในภาพขนาด 8 บิตสีเทาค่าของพิกเซลระหว่าง 0 ถึง 255 ค่าของพิกเซลที่จุดใด ๆ จะสอดคล้องกับความเข้มของโฟตอนแสงที่ตกกระทบ ณ จุดนั้น แต่ละพิกเซลจะจัดเก็บค่าตามสัดส่วนของความเข้มของแสง ณ ตำแหน่งนั้น ๆ

PEL

พิกเซลเรียกอีกอย่างว่า PEL คุณสามารถเข้าใจพิกเซลได้มากขึ้นจากรูปภาพด้านล่าง

ในภาพด้านบนอาจมีพิกเซลหลายพันพิกเซลซึ่งประกอบกันเป็นภาพนี้ เราจะซูมภาพนั้นให้เท่าที่จะเห็นการแบ่งพิกเซลบางส่วน ดังแสดงในภาพด้านล่าง

ในภาพด้านบนอาจมีพิกเซลหลายพันพิกเซลซึ่งประกอบกันเป็นภาพนี้ เราจะซูมภาพนั้นให้เท่าที่จะเห็นการแบ่งพิกเซลบางส่วน ดังแสดงในภาพด้านล่าง

ความสัมพันธ์จัดส่งด้วยอาร์เรย์ CCD

เราได้เห็นแล้วว่าภาพเกิดขึ้นในอาร์เรย์ CCD ได้อย่างไร ดังนั้นพิกเซลจึงสามารถกำหนดเป็น

การแบ่งอาร์เรย์ CCD ที่เล็กที่สุดเรียกอีกอย่างว่าพิกเซล

แต่ละส่วนของอาร์เรย์ CCD มีค่าเทียบกับความเข้มของโฟตอนที่กระทบกับมัน ค่านี้สามารถเรียกได้ว่าเป็นพิกเซล

การคำนวณจำนวนพิกเซลทั้งหมด

เราได้กำหนดภาพเป็นสัญญาณสองมิติหรือเมทริกซ์ จากนั้นในกรณีนั้นจำนวน PEL จะเท่ากับจำนวนแถวที่คูณด้วยจำนวนคอลัมน์

สิ่งนี้สามารถแสดงทางคณิตศาสตร์ได้ดังนี้:

จำนวนพิกเซลทั้งหมด = จำนวนแถว (X) จำนวนคอลัมน์

หรือเราสามารถพูดได้ว่าจำนวนคู่พิกัด (x, y) ประกอบขึ้นเป็นจำนวนพิกเซลทั้งหมด

เราจะดูรายละเอียดเพิ่มเติมในบทช่วยสอนเกี่ยวกับประเภทรูปภาพว่าเราจะคำนวณพิกเซลในภาพสีได้อย่างไร

ระดับสีเทา

ค่าของพิกเซล ณ จุดใด ๆ แสดงถึงความเข้มของภาพ ณ ตำแหน่งนั้นและเรียกอีกอย่างว่าระดับสีเทา

เราจะดูรายละเอียดเพิ่มเติมเกี่ยวกับค่าของพิกเซลในการจัดเก็บภาพและแบบฝึกหัดบิตต่อพิกเซล แต่สำหรับตอนนี้เราจะดูแนวคิดของค่าพิกเซลเพียงค่าเดียว

ค่าพิกเซล (0)

ดังที่ได้กำหนดไว้แล้วในตอนต้นของบทช่วยสอนนี้ว่าแต่ละพิกเซลสามารถมีได้เพียงค่าเดียวและแต่ละค่าจะแสดงถึงความเข้มของแสงที่จุดนั้นของภาพ

ตอนนี้เราจะดูที่ค่าเฉพาะ 0 ค่า 0 หมายถึงไม่มีแสง หมายความว่า 0 หมายถึงความมืดและยังหมายความว่าเมื่อใดก็ตามที่พิกเซลมีค่าเป็น 0 หมายความว่า ณ จุดนั้นจะเกิดสีดำขึ้น

ลองดูที่เมทริกซ์รูปภาพนี้

| 0 | 0 | 0 |

| 0 | 0 | 0 |

| 0 | 0 | 0 |

ตอนนี้เมทริกซ์รูปภาพนี้เต็มไปด้วย 0 พิกเซลทั้งหมดมีค่าเป็น 0 ถ้าเราจะคำนวณจำนวนพิกเซลทั้งหมดจากเมทริกซ์นี้นี่คือวิธีที่เราจะทำ

จำนวนพิกเซลทั้งหมด = จำนวนทั้งหมด ของแถว X ทั้งหมดไม่ ของคอลัมน์

= 3 X 3

= 9.

หมายความว่ารูปภาพจะถูกสร้างขึ้นโดยมี 9 พิกเซลและรูปภาพนั้นจะมีขนาด 3 แถวและ 3 คอลัมน์และที่สำคัญที่สุดคือรูปภาพจะเป็นสีดำ

ภาพที่ได้จะเป็นแบบนี้

ทำไมภาพนี้ถึงเป็นสีดำทั้งหมด เนื่องจากพิกเซลทั้งหมดในภาพมีค่าเป็น 0

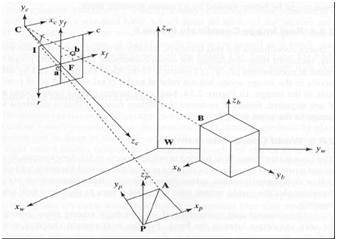

เมื่อดวงตาของมนุษย์มองเห็นสิ่งใกล้ตัวจะดูใหญ่กว่าเมื่อเปรียบเทียบกับคนที่อยู่ห่างไกล สิ่งนี้เรียกว่ามุมมองโดยทั่วไป ในขณะที่การแปลงเป็นการถ่ายโอนวัตถุ ฯลฯ จากสถานะหนึ่งไปยังอีกสถานะหนึ่ง

โดยรวมแล้วการแปลงมุมมองจะเกี่ยวข้องกับการแปลงโลก 3 มิติให้เป็นภาพ 2 มิติ หลักการเดียวกันกับที่การมองเห็นของมนุษย์ทำงานและหลักการเดียวกันกับที่กล้องทำงาน

เราจะดูรายละเอียดเกี่ยวกับสาเหตุที่สิ่งนี้เกิดขึ้นว่าวัตถุที่อยู่ใกล้คุณดูใหญ่ขึ้นในขณะที่วัตถุที่อยู่ห่างไกลจะดูเล็กลงแม้ว่าจะดูใหญ่ขึ้นเมื่อคุณเอื้อมถึงก็ตาม

เราจะเริ่มการสนทนานี้โดยใช้กรอบอ้างอิง:

กรอบอ้างอิง:

กรอบอ้างอิงเป็นชุดของค่าที่เกี่ยวข้องกับการที่เราวัดบางสิ่ง

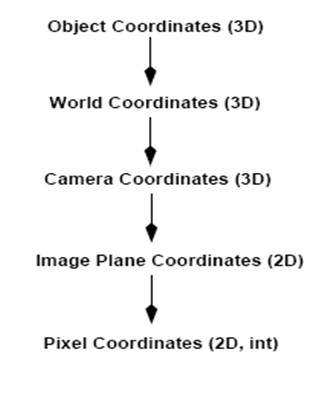

5 เฟรมอ้างอิง

ในการวิเคราะห์โลก 3 มิติ / ภาพ / ฉากจำเป็นต้องมีกรอบอ้างอิง 5 แบบ

Object

World

Camera

Image

Pixel

กรอบพิกัดวัตถุ

เฟรมพิกัดวัตถุใช้สำหรับการสร้างโมเดลวัตถุ ตัวอย่างเช่นการตรวจสอบว่าวัตถุหนึ่ง ๆ อยู่ในสถานที่ที่เหมาะสมหรือไม่เมื่อเทียบกับวัตถุอื่น เป็นระบบพิกัด 3 มิติ

กรอบพิกัดโลก

กรอบพิกัดโลกใช้สำหรับวัตถุที่เกี่ยวข้องร่วมกันในโลก 3 มิติ เป็นระบบพิกัด 3 มิติ

กรอบพิกัดของกล้อง

เฟรมประสานกล้องใช้เพื่อเชื่อมโยงวัตถุที่เกี่ยวข้องกับกล้อง เป็นระบบพิกัด 3 มิติ

กรอบพิกัดภาพ

ไม่ใช่ระบบพิกัด 3 มิติ แต่เป็นระบบ 2d ใช้เพื่ออธิบายวิธีการแมปจุด 3 มิติในระนาบภาพ 2 มิติ

กรอบพิกัดพิกเซล

นอกจากนี้ยังเป็นระบบพิกัด 2d แต่ละพิกเซลมีค่าพิกัดพิกเซล

การเปลี่ยนแปลงระหว่าง 5 เฟรมนี้

นั่นคือวิธีที่ฉาก 3 มิติเปลี่ยนเป็น 2 มิติด้วยภาพพิกเซล

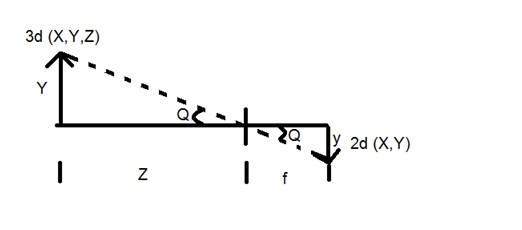

ตอนนี้เราจะอธิบายแนวคิดนี้ทางคณิตศาสตร์

Y = วัตถุ 3 มิติ

y = 2d รูปภาพ

f = ทางยาวโฟกัสของกล้อง

Z = ระยะห่างระหว่างภาพและกล้อง

ตอนนี้มีสองมุมที่แตกต่างกันที่เกิดขึ้นในการแปลงนี้ซึ่งแสดงโดย Q

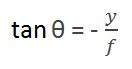

มุมแรกคือ

โดยที่เครื่องหมายลบหมายถึงภาพนั้นกลับด้าน มุมที่สองที่เกิดขึ้นคือ:

การเปรียบเทียบทั้งสองสมการที่เราได้รับ

จากสมการนี้เราจะเห็นว่าเมื่อรังสีของแสงสะท้อนกลับหลังจากที่ตกกระทบจากวัตถุผ่านจากกล้องจะเกิดภาพกลับด้าน

เราสามารถเข้าใจสิ่งนี้ได้ดีขึ้นด้วยตัวอย่างนี้

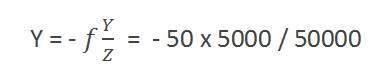

ตัวอย่างเช่น

การคำนวณขนาดของภาพที่เกิดขึ้น

สมมติว่ามีการถ่ายภาพบุคคลสูง 5 ม. และยืนอยู่ห่างจากกล้อง 50 ม. และเราต้องบอกให้ได้ว่าภาพบุคคลนั้นมีขนาดเท่าใดโดยกล้องทางยาวโฟกัสคือ 50 มม.

วิธีการแก้:

เนื่องจากทางยาวโฟกัสมีหน่วยเป็นมิลลิเมตรดังนั้นเราจึงต้องแปลงทุกสิ่งเป็นมิลลิเมตรเพื่อคำนวณ

ดังนั้น,

Y = 5000 มม.

f = 50 มม.

Z = 50000 มม.

เราได้รับการใส่ค่าในสูตร

= -5 มม.

อีกครั้งเครื่องหมายลบแสดงว่าภาพกลับด้าน

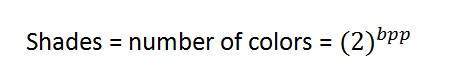

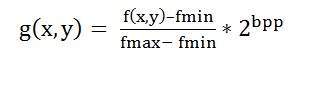

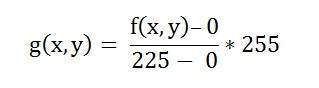

Bpp หรือบิตต่อพิกเซลแสดงถึงจำนวนบิตต่อพิกเซล จำนวนสีที่แตกต่างกันในภาพขึ้นอยู่กับความลึกของสีหรือบิตต่อพิกเซล

บิตในคณิตศาสตร์:

มันเหมือนกับการเล่นกับบิตไบนารี

หนึ่งบิตสามารถแทนค่าได้กี่ตัวเลข

0

1

สามารถสร้างชุดค่าผสมสองบิตได้กี่ชุด

00

01

10

11

หากเราคิดค้นสูตรคำนวณจำนวนชุดค่าผสมทั้งหมดที่สามารถสร้างจากบิตได้ก็จะเป็นเช่นนี้

โดย bpp หมายถึงบิตต่อพิกเซล ใส่ 1 ในสูตรที่คุณได้ 2 ใส่ 2 ในสูตรคุณจะได้ 4 มันจะเพิ่มขึ้นแบบทวีคูณ

จำนวนสีที่ต่างกัน:

ดังที่เราได้กล่าวไปแล้วในตอนต้นว่าจำนวนสีที่แตกต่างกันนั้นขึ้นอยู่กับจำนวนบิตต่อพิกเซล

ตารางสำหรับบิตและสีบางส่วนได้รับด้านล่าง

| บิตต่อพิกเซล | จำนวนสี |

|---|---|

| 1 bpp | 2 สี |

| 2 bpp | 4 สี |

| 3 bpp | 8 สี |

| 4 bpp | 16 สี |

| 5 bpp | 32 สี |

| 6 bpp | 64 สี |

| 7 bpp | 128 สี |

| 8 bpp | 256 สี |

| 10 bpp | 1024 สี |

| 16 bpp | 65536 สี |

| 24 bpp | 16777216 สี (16.7 ล้านสี) |

| 32 bpp | 4294967296 สี (4294 ล้านสี) |

ตารางนี้แสดงจำนวนบิตต่อพิกเซลและจำนวนสีที่แตกต่างกัน

เฉดสี

คุณสามารถสังเกตเห็นรูปแบบของการเติบโตแบบยกกำลังได้อย่างง่ายดาย ภาพสเกลสีเทาที่มีชื่อเสียงมีขนาด 8 bpp หมายความว่ามีสีที่แตกต่างกัน 256 สีหรือ 256 เฉดสี

เฉดสีสามารถแสดงเป็น:

ภาพสีมักอยู่ในรูปแบบ 24 bpp หรือ 16 bpp

เราจะดูเพิ่มเติมเกี่ยวกับรูปแบบสีและประเภทรูปภาพอื่น ๆ ในบทแนะนำเกี่ยวกับประเภทรูปภาพ

ค่าสี:

สีดำ:

สีขาว:

ค่าที่แสดงถึงสีขาวสามารถคำนวณได้ดังนี้:

ในกรณีของ 1 bpp, 0 หมายถึงสีดำและ 1 หมายถึงสีขาว

ในกรณีที่ 8 bpp, 0 หมายถึงสีดำและ 255 หมายถึงสีขาว

สีเทา:

เมื่อคุณคำนวณค่าสีขาวดำคุณจะคำนวณค่าพิกเซลของสีเทาได้

สีเทาเป็นจุดกึ่งกลางของสีดำและสีขาว ที่กล่าวว่า

ในกรณีของ 8bpp ค่าพิกเซลที่แสดงถึงสีเทาคือ 127 หรือ 128bpp (ถ้าคุณนับจาก 1 ไม่ใช่จาก 0)

ข้อกำหนดในการจัดเก็บรูปภาพ

หลังจากการอภิปรายของบิตต่อพิกเซลตอนนี้เรามีทุกสิ่งที่เราต้องการในการคำนวณขนาดของภาพ

ขนาดรูปภาพ

ขนาดของรูปภาพขึ้นอยู่กับสามสิ่ง

จำนวนแถว

จำนวนคอลัมน์

จำนวนบิตต่อพิกเซล

สูตรคำนวณขนาดได้รับด้านล่าง

ขนาดของรูปภาพ = แถว * cols * bpp

หมายความว่าถ้าคุณมีภาพให้พูดว่า:

สมมติว่ามี 1024 แถวและมี 1024 คอลัมน์ และเนื่องจากเป็นภาพระดับสีเทาจึงมีเฉดสีเทาที่แตกต่างกัน 256 เฉดหรือมีบิตต่อพิกเซล จากนั้นใส่ค่าเหล่านี้ในสูตรเราจะได้

ขนาดของรูปภาพ = แถว * cols * bpp

= 1024 * 1024 * 8

= 8388608 บิต

แต่เนื่องจากไม่ใช่คำตอบมาตรฐานที่เรารู้จักดังนั้นจะแปลงเป็นรูปแบบของเรา

การแปลงเป็นไบต์ = 8388608/8 = 1048576 ไบต์

การแปลงเป็นกิโลไบต์ = 1048576/1024 = 1024kb

การแปลงเป็นเมกะไบต์ = 1024/1024 = 1 Mb.

นั่นคือวิธีคำนวณขนาดภาพและจัดเก็บ ตอนนี้ในสูตรถ้าคุณได้รับขนาดของภาพและบิตต่อพิกเซลคุณยังสามารถคำนวณแถวและคอลัมน์ของรูปภาพได้โดยที่รูปภาพเป็นรูปสี่เหลี่ยมจัตุรัส (แถวเดียวกันและคอลัมน์เดียวกัน)

มีรูปภาพหลายประเภทและเราจะดูรายละเอียดเกี่ยวกับรูปภาพประเภทต่างๆและการกระจายของสี

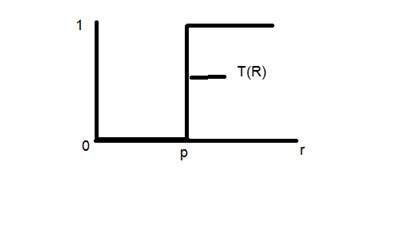

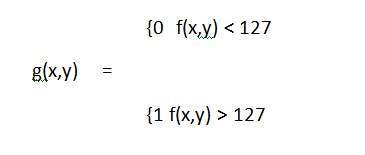

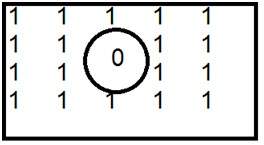

ภาพไบนารี

ภาพไบนารีตามชื่อมีค่าพิกเซลเพียงสองค่า

0 และ 1.

ในแบบฝึกหัดบิตต่อพิกเซลก่อนหน้านี้เราได้อธิบายรายละเอียดเกี่ยวกับการแสดงค่าพิกเซลเป็นสีตามลำดับ

ในที่นี้ 0 หมายถึงสีดำและ 1 หมายถึงสีขาว เป็นที่รู้จักกันในชื่อ Monochrome

ภาพขาวดำ:

ภาพที่เกิดขึ้นจึงประกอบด้วยสีดำและสีขาวเท่านั้นจึงสามารถเรียกได้ว่าเป็นภาพขาวดำ

ไม่มีระดับสีเทา

หนึ่งในสิ่งที่น่าสนใจเกี่ยวกับภาพไบนารีนี้คือไม่มีระดับสีเทาอยู่ในนั้น พบเพียงสองสีที่เป็นสีดำและสีขาว

รูปแบบ

ภาพไบนารีมีรูปแบบ PBM (แผนที่บิตแบบพกพา)

รูปแบบสี 2, 3, 4, 5, 6 บิต

ภาพที่มีรูปแบบสี 2, 3, 4, 5 และ 6 บิตยังไม่ถูกใช้อย่างแพร่หลายในปัจจุบัน พวกเขาถูกใช้ในสมัยก่อนสำหรับจอทีวีแบบเก่าหรือจอมอนิเตอร์

แต่แต่ละสีเหล่านี้มีระดับสีเทามากกว่าสองระดับและด้วยเหตุนี้จึงมีสีเทาซึ่งแตกต่างจากภาพไบนารี

ใน 2 บิต 4 ใน 3 บิต 8 ใน 4 บิต 16 ใน 5 บิต 32 ใน 6 บิต 64 สีที่แตกต่างกันมีอยู่

รูปแบบสี 8 บิต

รูปแบบสี 8 บิตเป็นรูปแบบภาพที่มีชื่อเสียงที่สุดรูปแบบหนึ่ง มีเฉดสีที่แตกต่างกันถึง 256 เฉดสี เป็นที่รู้จักกันทั่วไปในชื่อภาพระดับสีเทา

ช่วงของสีใน 8 บิตแตกต่างกันไปตั้งแต่ 0-255 โดย 0 หมายถึงสีดำและ 255 หมายถึงสีขาวและ 127 หมายถึงสีเทา

รูปแบบนี้เริ่มใช้โดยระบบปฏิบัติการ UNIX รุ่นแรก ๆ และ Macintoshes สีรุ่นแรก ๆ

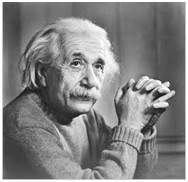

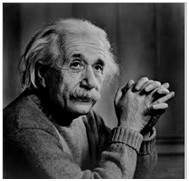

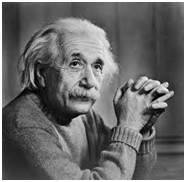

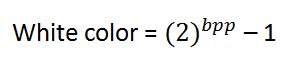

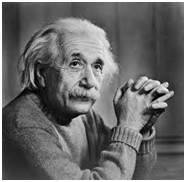

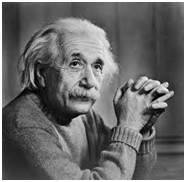

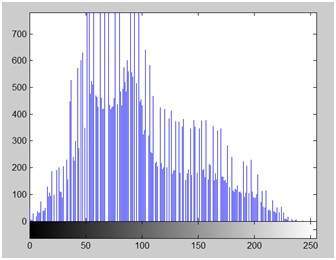

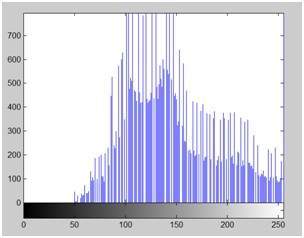

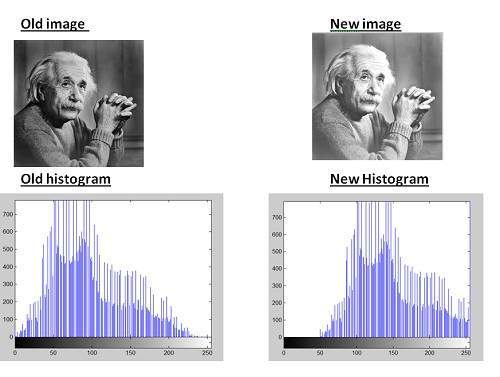

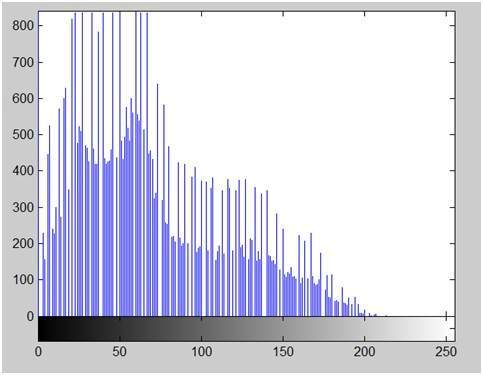

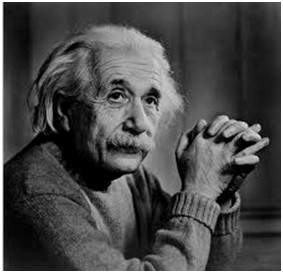

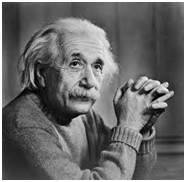

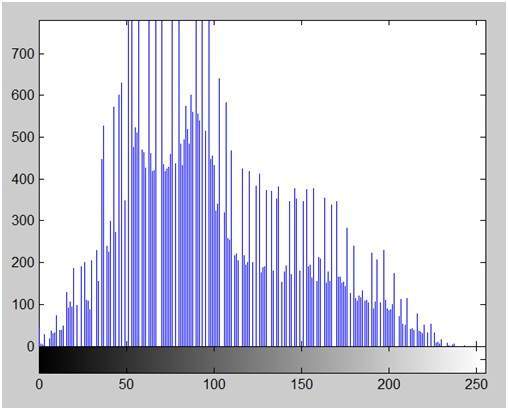

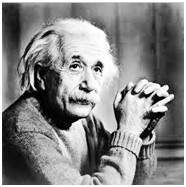

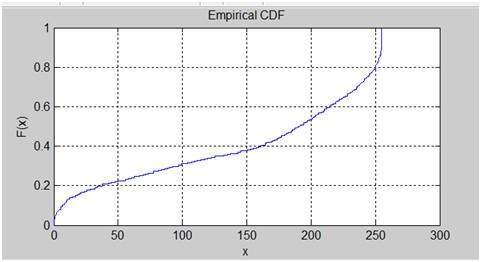

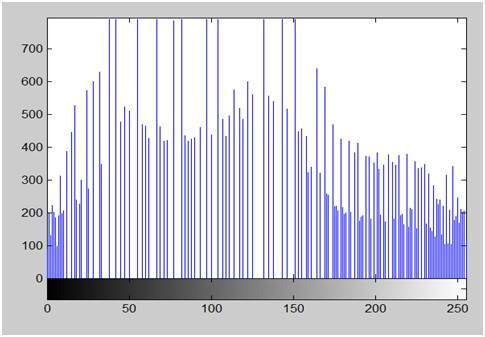

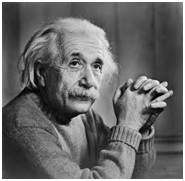

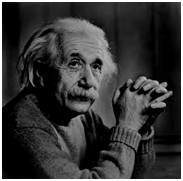

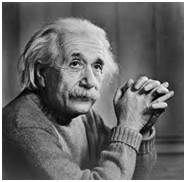

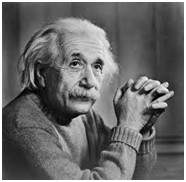

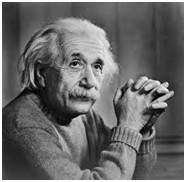

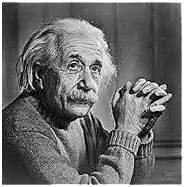

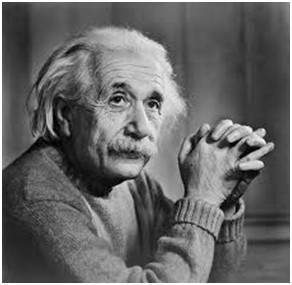

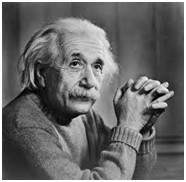

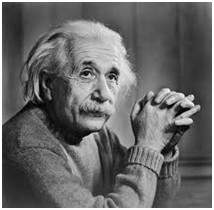

ภาพสีเทาของไอน์สไตน์แสดงอยู่ด้านล่าง:

รูปแบบ

รูปแบบของภาพเหล่านี้คือ PGM (Portable Gray Map)

รูปแบบนี้ไม่ได้รับการสนับสนุนโดยค่าเริ่มต้นจาก windows ในการดูภาพระดับสีเทาคุณต้องมีโปรแกรมดูรูปภาพหรือกล่องเครื่องมือประมวลผลภาพเช่น Matlab

ด้านหลังภาพสเกลสีเทา:

ดังที่เราได้อธิบายไปแล้วหลายครั้งในบทช่วยสอนก่อนหน้านี้ว่ารูปภาพไม่ใช่อะไรนอกจากฟังก์ชันสองมิติและสามารถแสดงด้วยอาร์เรย์หรือเมทริกซ์สองมิติได้ ดังนั้นในกรณีของภาพของไอน์สไตน์ที่แสดงด้านบนจะมีเมทริกซ์สองมิติอยู่ด้านหลังโดยมีค่าอยู่ระหว่าง 0 ถึง 255

แต่นั่นไม่ใช่กรณีของภาพสี

รูปแบบสี 16 บิต

เป็นรูปแบบภาพสี มีสีที่แตกต่างกัน 65,536 สี เรียกอีกอย่างว่ารูปแบบสีสูง

Microsoft ใช้ในระบบที่รองรับรูปแบบสี 8 บิตมากกว่า ตอนนี้ในรูปแบบ 16 บิตนี้และรูปแบบต่อไปเราจะพูดถึงซึ่งเป็นรูปแบบ 24 บิตเป็นทั้งรูปแบบสี

การกระจายของสีในภาพสีไม่ง่ายเหมือนในภาพสีเทา

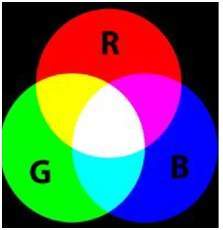

รูปแบบ 16 บิตจริง ๆ แล้วแบ่งออกเป็นสามรูปแบบเพิ่มเติม ได้แก่ แดงเขียวและน้ำเงิน รูปแบบ (RGB) ที่มีชื่อเสียง

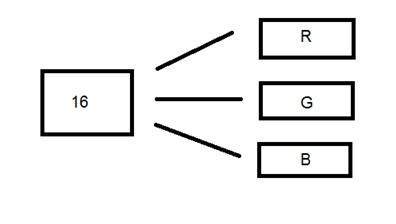

เป็นภาพที่แสดงในภาพด้านล่าง

ตอนนี้คำถามเกิดขึ้นว่าคุณจะแบ่ง 16 เป็นสามได้อย่างไร ถ้าคุณทำแบบนี้

5 บิตสำหรับ R, 5 บิตสำหรับ G, 5 บิตสำหรับ B

จากนั้นมีหนึ่งบิตที่เหลืออยู่ในท้ายที่สุด

ดังนั้นการกระจาย 16 บิตจึงเป็นแบบนี้

5 บิตสำหรับ R, 6 บิตสำหรับ G, 5 บิตสำหรับบี

บิตเพิ่มเติมที่ถูกทิ้งไว้จะถูกเพิ่มเข้าไปในบิตสีเขียว เนื่องจากสีเขียวเป็นสีที่สบายตาที่สุดในทั้งสามสีนี้

โปรดทราบว่านี่คือการแจกจ่ายไม่ได้เป็นไปตามระบบทั้งหมด มีบางคนแนะนำช่องอัลฟาใน 16 บิต

การแจกแจงอีกรูปแบบ 16 บิตเป็นดังนี้:

4 บิตสำหรับ R, 4 บิตสำหรับ G, 4 บิตสำหรับ B, 4 บิตสำหรับช่องอัลฟา

หรือบางส่วนแจกจ่ายแบบนี้

5 บิตสำหรับ R, 5 บิตสำหรับ G, 5 บิตสำหรับ B, 1 บิตสำหรับช่องอัลฟา

รูปแบบสี 24 บิต

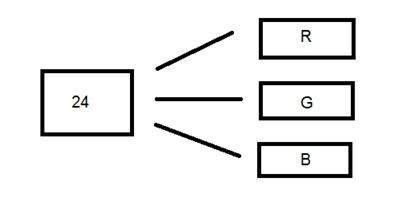

รูปแบบสี 24 บิตหรือที่เรียกว่ารูปแบบสีจริง เช่นเดียวกับรูปแบบสี 16 บิตในรูปแบบสี 24 บิต 24 บิตจะถูกแจกจ่ายอีกครั้งในสามรูปแบบที่แตกต่างกันคือสีแดงสีเขียวและสีน้ำเงิน

เนื่องจาก 24 ถูกหารด้วย 8 เท่า ๆ กันดังนั้นจึงมีการกระจายช่องสีที่ต่างกันสามช่องอย่างเท่าเทียมกัน

การกระจายของพวกเขาเป็นเช่นนี้

8 บิตสำหรับ R, 8 บิตสำหรับ G, 8 บิตสำหรับ B

เบื้องหลังภาพ 24 บิต

แตกต่างจากภาพสเกลสีเทา 8 บิตซึ่งมีหนึ่งเมทริกซ์อยู่ข้างหลังภาพ 24 บิตมีเมทริกซ์ที่แตกต่างกันสามเมทริกซ์ของ R, G, B

รูปแบบ

เป็นรูปแบบที่ใช้บ่อยที่สุด รูปแบบคือ PPM (Portable pixMap) ซึ่งรองรับโดยระบบปฏิบัติการ Linux หน้าต่างที่มีชื่อเสียงมีรูปแบบของตัวเองซึ่งก็คือ BMP (Bitmap)

ในบทช่วยสอนนี้เราจะมาดูกันว่ารหัสสีต่างๆสามารถรวมกันเพื่อสร้างสีอื่น ๆ ได้อย่างไรและเราจะซ่อนรหัสสี RGB เป็นฐานสิบหกและในทางกลับกันได้อย่างไร

รหัสสีที่แตกต่างกัน

สีทั้งหมดที่นี่เป็นรูปแบบ 24 บิตซึ่งหมายความว่าแต่ละสีจะมีสีแดง 8 บิตสีเขียว 8 บิตสีน้ำเงิน 8 บิตอยู่ในนั้น หรือเราสามารถพูดได้ว่าแต่ละสีมีสามส่วนที่แตกต่างกัน คุณต้องเปลี่ยนปริมาณของสามส่วนนี้เพื่อให้เป็นสีใดก็ได้

รูปแบบสีไบนารี

สีดำ

ภาพ:

รหัสทศนิยม:

(0,0,0)

คำอธิบาย:

ดังที่ได้อธิบายไปแล้วในบทเรียนก่อนหน้านี้ว่าในรูปแบบ 8 บิต 0 หมายถึงสีดำ ดังนั้นถ้าเราต้องทำสีดำล้วนเราต้องทำให้ R, G, B ทั้งสามส่วนเป็น 0

สี: ขาว

ภาพ:

รหัสทศนิยม:

(255,255,255)

คำอธิบาย:

เนื่องจากแต่ละส่วนของ R, G, B เป็นส่วน 8 บิต ดังนั้นใน 8 บิตสีขาวจะถูกสร้างขึ้นด้วย 255 อธิบายไว้ในบทช่วยสอนของพิกเซล ดังนั้นในการสร้างสีขาวเราตั้งค่าแต่ละส่วนเป็น 255 และนั่นคือวิธีที่เราได้สีขาว ด้วยการตั้งค่าแต่ละค่าเป็น 255 เราจะได้ค่ารวม 255 นั่นทำให้สีเป็นสีขาว

รุ่นสี RGB:

สี: แดง

ภาพ:

รหัสทศนิยม:

(255,0,0)

คำอธิบาย:

เนื่องจากเราต้องการเพียงสีแดงดังนั้นเราจึงนำส่วนที่เหลือของสองส่วนที่เหลือเป็นสีเขียวและสีน้ำเงินออกเป็นศูนย์และเราตั้งค่าส่วนสีแดงให้มากที่สุดคือ 255

สี: เขียว

ภาพ:

รหัสทศนิยม:

(0,255,0)

คำอธิบาย:

เนื่องจากเราต้องการเพียงสีเขียวดังนั้นเราจึงนำส่วนที่เหลือของสองส่วนที่เหลือเป็นสีแดงและสีน้ำเงินออกเป็นศูนย์และเราตั้งค่าส่วนสีเขียวเป็นค่าสูงสุดคือ 255

สี: น้ำเงิน

ภาพ:

รหัสทศนิยม:

(0,0,255)

คำอธิบาย:

เนื่องจากเราต้องการเพียงสีฟ้าดังนั้นเราจึงนำส่วนที่เหลือของสองส่วนที่เหลือเป็นสีแดงและสีเขียวออกเป็นศูนย์และเราตั้งค่าส่วนสีน้ำเงินไว้ที่ค่าสูงสุดคือ 255

สีเทา:

สี: เทา

ภาพ:

รหัสทศนิยม:

(128,128,128)

คำอธิบาย:

ตามที่เราได้กำหนดไว้แล้วในบทช่วยสอนเรื่องพิกเซลสีเทานั้นเป็นจุดกึ่งกลาง ในรูปแบบ 8 บิตจุดกึ่งกลางคือ 128 หรือ 127 ในกรณีนี้เราเลือก 128 ดังนั้นเราจึงตั้งค่าแต่ละส่วนเป็นจุดกึ่งกลางซึ่งเป็น 128 และส่งผลให้ค่ากลางโดยรวมและเราได้สีเทา

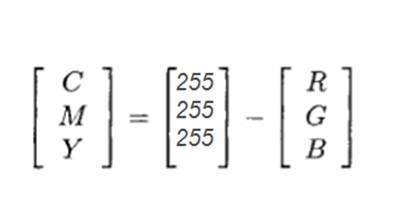

รุ่นสี CMYK:

CMYK เป็นรูปแบบสีอื่นที่ c ย่อมาจากสีฟ้า, m ย่อมาจาก magenta, y หมายถึงสีเหลืองและ k สำหรับสีดำ รุ่น CMYK มักใช้ในเครื่องพิมพ์สีซึ่งมีการใช้ตลับสีสองสี หนึ่งประกอบด้วย CMY และอื่น ๆ ประกอบด้วยสีดำ

สีของ CMY สามารถทำได้จากการเปลี่ยนปริมาณหรือส่วนของสีแดงสีเขียวและสีน้ำเงิน

สี: ฟ้า

ภาพ:

รหัสทศนิยม:

(0,255,255)

คำอธิบาย:

สีฟ้าเกิดจากการรวมกันของสองสีที่แตกต่างกันคือสีเขียวและสีน้ำเงิน เราจึงตั้งค่าสองค่านี้เป็นค่าสูงสุดและเราให้ส่วนของสีแดงเป็นศูนย์ และเราได้สีฟ้า

สี: Magenta

ภาพ:

รหัสทศนิยม:

(255,0,255)

คำอธิบาย:

สีม่วงแดงเกิดจากการผสมกันของสองสีที่แตกต่างกันคือสีแดงและสีน้ำเงิน เราจึงตั้งค่าสองค่านี้เป็นค่าสูงสุดและเราให้ส่วนของสีเขียวเป็นศูนย์ และเราได้สีม่วงแดง

สี: เหลือง

ภาพ:

รหัสทศนิยม:

(255,255,0)

คำอธิบาย:

สีเหลืองเกิดจากการรวมกันของสองสีที่แตกต่างกันคือสีแดงและสีเขียว เราจึงตั้งค่าสองตัวนี้เป็นค่าสูงสุดและเราให้ส่วนของสีน้ำเงินเป็นศูนย์ และเราได้สีเหลือง

การแปลง

ตอนนี้เราจะมาดูกันว่าการแปลงสีจากรูปแบบหนึ่งไปเป็นอีกรูปแบบหนึ่งอย่างไร

การแปลงจาก RGB เป็นรหัส Hex:

การแปลงจาก Hex เป็น rgb ทำได้ด้วยวิธีนี้:

ใช้สี เช่น: White = (255, 255, 255)

ใช้ส่วนแรกเช่น 255

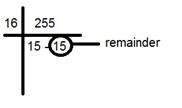

หารด้วย 16 ดังนี้:

ใช้ตัวเลขสองตัวด้านล่างบรรทัดตัวประกอบและส่วนที่เหลือ ในกรณีนี้คือ 15 15 ซึ่งเป็น FF

ทำซ้ำขั้นตอนที่ 2 สำหรับสองส่วนถัดไป

รวมรหัสฐานสิบหกทั้งหมดเป็นหนึ่งเดียว

คำตอบ: #FFFFFF

การแปลงจาก Hex เป็น RGB:

การแปลงจากรหัสฐานสิบหกเป็นรูปแบบทศนิยม rgb ทำได้ด้วยวิธีนี้

ใช้เลขฐานสิบหก เช่น #FFFFFF

แบ่งตัวเลขนี้ออกเป็น 3 ส่วน: FF FF FF

ใช้ส่วนแรกและแยกส่วนประกอบ: FF

แปลงแต่ละส่วนแยกกันเป็นไบนารี: (1111) (1111)

ตอนนี้รวมไบนารีแต่ละรายการเข้าด้วยกัน: 11111111

แปลงไบนารีนี้เป็นทศนิยม: 255

ทำซ้ำขั้นตอนที่ 2 อีกสองครั้ง

ค่ามาในขั้นตอนแรกคือ R ค่าที่สองคือ G และค่าที่สามเป็นของ B

ตอบ: (255, 255, 255)

สีทั่วไปและรหัส Hex ได้รับในตารางนี้

| สี | รหัส Hex |

|---|---|

| ดำ | # 000000 |

| สีขาว | #FFFFFF |

| สีเทา | # 808080 |

| แดง | # FF0000 |

| เขียว | # 00FF00 |

| สีน้ำเงิน | # 0000FF |

| สีฟ้า | # 00FFFF |

| ม่วงแดง | # FF00FF |

| สีเหลือง | # FFFF00 |

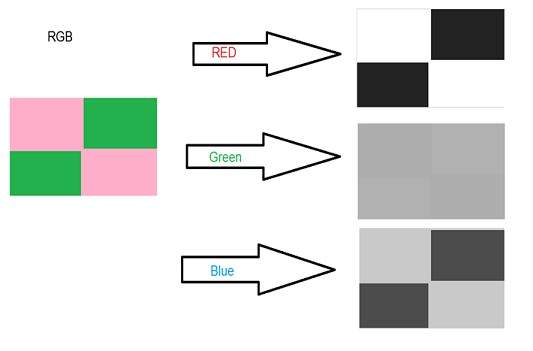

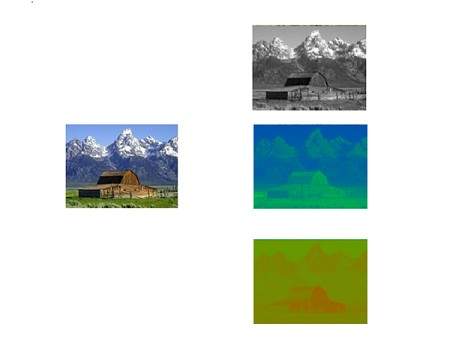

วิธีการเฉลี่ย

วิธีถ่วงน้ำหนักหรือวิธีการส่องสว่าง

วิธีการเฉลี่ย

วิธีการเฉลี่ยเป็นวิธีที่ง่ายที่สุด คุณต้องใช้ค่าเฉลี่ยของสามสี เนื่องจากเป็นภาพ RGB ดังนั้นจึงหมายความว่าคุณได้เพิ่ม r ด้วย g ด้วย b แล้วหารด้วย 3 เพื่อให้ได้ภาพระดับสีเทาที่คุณต้องการ

มันทำด้วยวิธีนี้

ระดับสีเทา = (R + G + B) / 3

ตัวอย่างเช่น:

หากคุณมีภาพสีเหมือนภาพที่แสดงด้านบนและต้องการแปลงเป็นสีเทาโดยใช้วิธีการเฉลี่ย ผลลัพธ์ต่อไปนี้จะปรากฏขึ้น

คำอธิบาย

มีสิ่งหนึ่งที่ต้องแน่ใจคือมีบางอย่างเกิดขึ้นกับผลงานต้นฉบับ หมายความว่าวิธีการเฉลี่ยของเราใช้ได้ผล แต่ผลลัพธ์ไม่เป็นไปตามที่คาดหวัง เราต้องการแปลงภาพเป็นโทนสีเทา แต่มันกลายเป็นภาพที่ค่อนข้างดำ

ปัญหา

ปัญหานี้เกิดขึ้นเนื่องจากเราใช้ค่าเฉลี่ยของสามสี เนื่องจากสีทั้งสามสีมีความยาวคลื่นที่แตกต่างกันสามสีและมีส่วนร่วมในการสร้างภาพดังนั้นเราจึงต้องหาค่าเฉลี่ยตามการมีส่วนร่วมของพวกเขาไม่ใช่ทำโดยเฉลี่ยโดยใช้วิธีการหาค่าเฉลี่ย ตอนนี้สิ่งที่เรากำลังทำคือสิ่งนี้

33% ของสีแดง 33% ของสีเขียว 33% ของสีน้ำเงิน

เรารับ 33% ของแต่ละส่วนนั่นหมายความว่าแต่ละส่วนมีส่วนสนับสนุนในภาพเหมือนกัน แต่ในความเป็นจริงนั้นไม่ใช่อย่างนั้น วิธีการแก้ปัญหานี้ได้รับโดยวิธีการส่องสว่าง

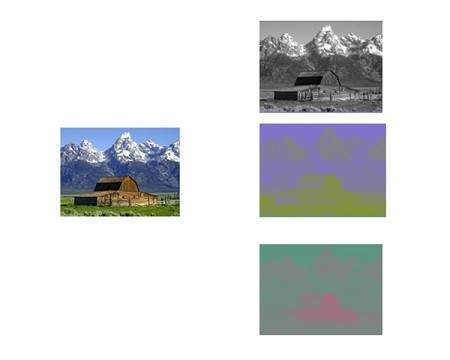

วิธีถ่วงน้ำหนักหรือวิธีการส่องสว่าง

คุณได้เห็นปัญหาที่เกิดขึ้นในวิธีการเฉลี่ย วิธีถ่วงน้ำหนักมีวิธีแก้ปัญหานั้น เนื่องจากสีแดงมีความยาวคลื่นมากกว่าของทั้งสามสีและสีเขียวเป็นสีที่ไม่เพียง แต่มีความยาวคลื่นน้อยกว่าสีแดง แต่ยังเป็นสีเขียวที่ให้เอฟเฟกต์ผ่อนคลายแก่ดวงตามากขึ้นด้วย

หมายความว่าเราต้องลดการมีส่วนร่วมของสีแดงและเพิ่มการมีส่วนร่วมของสีเขียวและใส่สีฟ้าระหว่างสองสีนี้

ดังนั้นสมการใหม่ในรูปแบบคือ:

ภาพสีเทาใหม่ = ((0.3 * R) + (0.59 * G) + (0.11 * B))

ตามสมการนี้สีแดงมีส่วนร่วม 30% สีเขียวมีส่วนทำให้ 59% ซึ่งมากกว่าในทั้งสามสีและสีน้ำเงินมีส่วน 11%

ใช้สมการนี้กับรูปภาพเราจะได้สิ่งนี้

ภาพต้นฉบับ:

ภาพระดับสีเทา:

คำอธิบาย

ดังที่คุณเห็นที่นี่ภาพได้ถูกแปลงเป็นสีเทาอย่างถูกต้องโดยใช้วิธีการถ่วงน้ำหนัก เมื่อเปรียบเทียบกับผลลัพธ์ของวิธีการเฉลี่ยภาพนี้จะสว่างกว่า

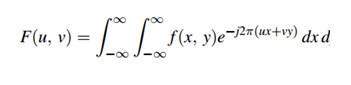

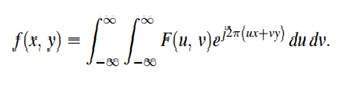

การแปลงสัญญาณแอนะล็อกเป็นสัญญาณดิจิตอล:

เอาต์พุตของเซ็นเซอร์ภาพส่วนใหญ่เป็นสัญญาณแอนะล็อกและเราไม่สามารถใช้การประมวลผลแบบดิจิทัลกับมันได้เนื่องจากเราไม่สามารถจัดเก็บได้ เราไม่สามารถจัดเก็บได้เนื่องจากต้องใช้หน่วยความจำที่ไม่มีที่สิ้นสุดในการจัดเก็บสัญญาณที่มีค่าไม่สิ้นสุด

ดังนั้นเราจึงต้องแปลงสัญญาณแอนะล็อกเป็นสัญญาณดิจิทัล

ในการสร้างภาพที่เป็นดิจิทัลเราจำเป็นต้องปกปิดข้อมูลต่อเนื่องให้อยู่ในรูปแบบดิจิทัล มีสองขั้นตอนที่ทำ

Sampling

Quantization

เราจะพูดคุยเกี่ยวกับการสุ่มตัวอย่างในตอนนี้และการหาปริมาณจะถูกกล่าวถึงในภายหลัง แต่สำหรับตอนนี้เราจะพูดถึงความแตกต่างระหว่างสองสิ่งนี้และความต้องการของสองขั้นตอนนี้

แนวคิดพื้นฐาน:

แนวคิดพื้นฐานเบื้องหลังการแปลงสัญญาณแอนะล็อกเป็นสัญญาณดิจิทัลคือ

เพื่อแปลงแกนทั้งสอง (x, y) เป็นรูปแบบดิจิทัล

เนื่องจากภาพไม่ต่อเนื่องไม่เพียง แต่ในพิกัด (แกน x) แต่ยังอยู่ในแอมพลิจูด (แกน y) ด้วยดังนั้นส่วนที่เกี่ยวข้องกับการกำหนดพิกัดเป็นดิจิทัลจึงเรียกว่าการสุ่มตัวอย่าง และส่วนที่เกี่ยวข้องกับการทำให้แอมพลิจูดเป็นดิจิทัลนั้นเรียกว่า quantization

การสุ่มตัวอย่าง

การสุ่มตัวอย่างได้รับการแนะนำในบทแนะนำเบื้องต้นเกี่ยวกับสัญญาณและระบบแล้ว แต่เราจะพูดถึงที่นี่เพิ่มเติม

นี่คือสิ่งที่เราได้พูดคุยเกี่ยวกับการสุ่มตัวอย่าง

คำว่าการสุ่มตัวอย่างหมายถึงการเก็บตัวอย่าง

เราแปลงแกน x เป็นดิจิทัลในการสุ่มตัวอย่าง

มันทำกับตัวแปรอิสระ

ในกรณีของสมการ y = sin (x) จะทำกับตัวแปร x

แบ่งออกเป็นสองส่วนเพิ่มเติมคือการสุ่มตัวอย่างและการสุ่มตัวอย่างลง

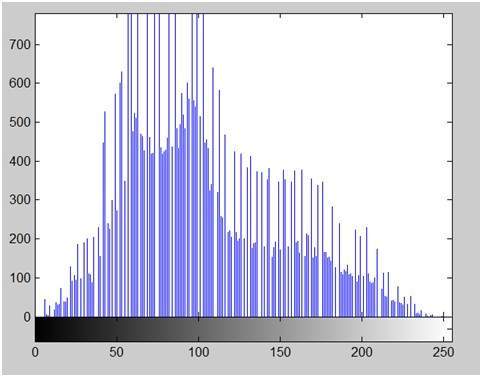

หากคุณดูรูปด้านบนคุณจะเห็นว่ามีรูปแบบสุ่มบางอย่างในสัญญาณ รูปแบบเหล่านี้เกิดจากเสียงรบกวน ในการสุ่มตัวอย่างเราลดเสียงดังกล่าวโดยการเก็บตัวอย่าง เห็นได้ชัดว่าเราใช้ตัวอย่างมากขึ้นคุณภาพของภาพจะดีขึ้นสัญญาณรบกวนจะถูกลบออกมากขึ้นและในทางกลับกันก็เกิดขึ้นเช่นเดียวกัน

อย่างไรก็ตามหากคุณทำการสุ่มตัวอย่างบนแกน x สัญญาณจะไม่ถูกแปลงเป็นรูปแบบดิจิทัลเว้นแต่คุณจะทำการสุ่มตัวอย่างแกน y ด้วยซึ่งเรียกว่า quantization ยิ่งในที่สุดตัวอย่างก็หมายความว่าคุณกำลังรวบรวมข้อมูลมากขึ้นและในกรณีของภาพก็หมายถึงพิกเซลที่มากขึ้น

ความสัมพันธ์มาพร้อมกับพิกเซล

เนื่องจากพิกเซลเป็นองค์ประกอบที่เล็กที่สุดในรูปภาพ จำนวนพิกเซลทั้งหมดในภาพสามารถคำนวณได้เป็น

Pixels = จำนวนแถวทั้งหมด * จำนวนคอลัมน์ทั้งหมด

สมมติว่าเรามีพิกเซลทั้งหมด 25 พิกเซลนั่นหมายความว่าเรามีภาพสี่เหลี่ยมจัตุรัสขนาด 5 X 5 จากนั้นเมื่อเราได้ทำการสุ่มตัวอย่างด้านบนแล้วตัวอย่างที่มากขึ้นจะทำให้ได้พิกเซลมากขึ้นในที่สุด นั่นหมายความว่าสัญญาณต่อเนื่องของเราเราได้ตัวอย่าง 25 ตัวอย่างบนแกน x นั่นหมายถึง 25 พิกเซลของภาพนี้

สิ่งนี้นำไปสู่ข้อสรุปอีกประการหนึ่งว่าเนื่องจากพิกเซลเป็นส่วนที่เล็กที่สุดของอาร์เรย์ CCD ดังนั้นมันหมายความว่ามันมีความสัมพันธ์กับอาร์เรย์ CCD ด้วยซึ่งสามารถอธิบายได้ดังนี้

ความสัมพันธ์กับอาร์เรย์ CCD

จำนวนเซ็นเซอร์บนอาร์เรย์ CCD จะเท่ากับจำนวนพิกเซลโดยตรง และเนื่องจากเราได้ข้อสรุปว่าจำนวนพิกเซลเท่ากับจำนวนตัวอย่างโดยตรงนั่นหมายความว่าตัวอย่างจำนวนนั้นเท่ากับจำนวนเซ็นเซอร์บนอาร์เรย์ CCD โดยตรง

การสุ่มตัวอย่างมากเกินไป

ในตอนแรกเราได้กำหนดว่าการสุ่มตัวอย่างแบ่งออกเป็นสองประเภทเพิ่มเติม ซึ่งขึ้นอยู่กับการสุ่มตัวอย่างและการสุ่มตัวอย่างลง การสุ่มตัวอย่างขึ้นเรียกอีกอย่างว่าการสุ่มตัวอย่างเกิน

การสุ่มตัวอย่างเกินขนาดมีแอปพลิเคชั่นที่ลึกมากในการประมวลผลภาพซึ่งเรียกว่าการซูม

การซูม

เราจะแนะนำการซูมอย่างเป็นทางการในบทช่วยสอนที่กำลังจะมาถึง แต่สำหรับตอนนี้เราจะอธิบายสั้น ๆ เกี่ยวกับการซูม

การซูมหมายถึงการเพิ่มจำนวนพิกเซลดังนั้นเมื่อคุณซูมภาพคุณจะเห็นรายละเอียดมากขึ้น

การเพิ่มจำนวนพิกเซลทำได้โดยการสุ่มตัวอย่างมากเกินไป วิธีหนึ่งในการซูมคือหรือเพื่อเพิ่มจำนวนตัวอย่างคือการซูมแบบออปติกผ่านการเคลื่อนไหวของมอเตอร์ของเลนส์แล้วจึงจับภาพ แต่เราต้องทำเมื่อจับภาพได้แล้ว

มีความแตกต่างระหว่างการซูมและการสุ่มตัวอย่าง

แนวคิดเหมือนกันคือเพิ่มกลุ่มตัวอย่าง แต่ความแตกต่างที่สำคัญคือในขณะที่ทำการสุ่มตัวอย่างสัญญาณการซูมจะกระทำบนภาพดิจิทัล

ก่อนที่เราจะกำหนดความละเอียดพิกเซลจำเป็นต้องกำหนดพิกเซล

พิกเซล

เราได้กำหนดพิกเซลไว้แล้วในบทแนะนำเกี่ยวกับแนวคิดของพิกเซลซึ่งเรากำหนดพิกเซลเป็นองค์ประกอบที่เล็กที่สุดของภาพ นอกจากนี้เรายังกำหนดให้พิกเซลสามารถจัดเก็บค่าตามสัดส่วนของความเข้มของแสง ณ ตำแหน่งนั้น ๆ

ตอนนี้เนื่องจากเราได้กำหนดพิกเซลแล้วเราจะกำหนดว่าอะไรคือความละเอียด

ความละเอียด

ความละเอียดสามารถกำหนดได้หลายวิธี เช่นความละเอียดพิกเซล, ความละเอียดเชิงพื้นที่, ความละเอียดชั่วคราว, ความละเอียดสเปกตรัม ซึ่งเราจะพูดถึงความละเอียดพิกเซล

คุณอาจเคยเห็นว่าในการตั้งค่าคอมพิวเตอร์ของคุณเองคุณมีความละเอียดจอภาพ 800 x 600, 640 x 480 เป็นต้น

ในความละเอียดพิกเซลคำว่าความละเอียดหมายถึงจำนวนพิกเซลทั้งหมดในภาพดิจิทัล ตัวอย่างเช่น. หากรูปภาพมีแถว M และ N คอลัมน์ความละเอียดสามารถกำหนดเป็น MX N ได้

หากเรากำหนดความละเอียดเป็นจำนวนพิกเซลทั้งหมดความละเอียดของพิกเซลสามารถกำหนดได้ด้วยชุดตัวเลขสองตัว ตัวเลขแรกคือความกว้างของรูปภาพหรือพิกเซลข้ามคอลัมน์และตัวเลขที่สองคือความสูงของรูปภาพหรือพิกเซลที่มีความกว้าง

เราสามารถพูดได้ว่ายิ่งความละเอียดของพิกเซลสูงเท่าใดคุณภาพของภาพก็ยิ่งสูงขึ้นเท่านั้น

เราสามารถกำหนดความละเอียดพิกเซลของภาพเป็น 4500 X 5500

ล้านพิกเซล

เราสามารถคำนวณเมกะพิกเซลของกล้องโดยใช้ความละเอียดพิกเซล

พิกเซลคอลัมน์ (กว้าง) X แถวพิกเซล (สูง) / 1 ล้าน

ขนาดของภาพสามารถกำหนดได้ด้วยความละเอียดพิกเซล

ขนาด = ความละเอียดพิกเซล X bpp (บิตต่อพิกเซล)

การคำนวณเมกะพิกเซลของกล้อง

สมมติว่าเรามีภาพขนาด 2500 X 3192

ความละเอียดพิกเซล = 2500 * 3192 = 7982350 ไบต์

หารด้วย 1 ล้าน = 7.9 = 8 เมกะพิกเซล (โดยประมาณ)

อัตราส่วนภาพ

อีกแนวคิดที่สำคัญเกี่ยวกับความละเอียดของพิกเซลคืออัตราส่วนภาพ

อัตราส่วนภาพคืออัตราส่วนระหว่างความกว้างของรูปภาพและความสูงของรูปภาพ โดยทั่วไปมักอธิบายว่าเป็นตัวเลขสองตัวคั่นด้วยเครื่องหมายจุดคู่ (8: 9) อัตราส่วนนี้แตกต่างกันในภาพที่แตกต่างกันและในหน้าจอที่แตกต่างกัน อัตราส่วนภาพทั่วไปคือ:

1.33: 1, 1.37: 1, 1.43: 1, 1.50: 1, 1.56: 1, 1.66: 1, 1.75: 1, 1.78: 1, 1.85: 1, 2.00: 1 ฯลฯ

ความได้เปรียบ:

อัตราส่วนภาพจะรักษาความสมดุลระหว่างลักษณะที่ปรากฏของภาพบนหน้าจอหมายความว่าจะรักษาอัตราส่วนระหว่างพิกเซลแนวนอนและแนวตั้ง ไม่ให้ภาพบิดเบี้ยวเมื่ออัตราส่วนกว้างยาวเพิ่มขึ้น

ตัวอย่างเช่น:

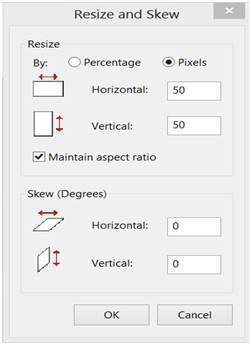

นี่คือภาพตัวอย่างซึ่งมี 100 แถวและ 100 คอลัมน์ หากเราต้องการให้มีขนาดเล็กลงและเงื่อนไขก็คือคุณภาพยังคงเหมือนเดิมหรือในลักษณะอื่น ๆ ที่ภาพไม่ผิดเพี้ยนนี่จะเกิดขึ้นได้อย่างไร

ภาพต้นฉบับ:

การเปลี่ยนแถวและคอลัมน์โดยรักษาอัตราส่วนใน MS Paint

ผลลัพธ์

ภาพเล็กลง แต่มีความสมดุลเท่ากัน

คุณอาจเคยเห็นอัตราส่วนภาพในโปรแกรมเล่นวิดีโอซึ่งคุณสามารถปรับวิดีโอตามความละเอียดหน้าจอของคุณได้

การค้นหาขนาดของภาพจากอัตราส่วนภาพ:

อัตราส่วนภาพบอกเราได้หลายอย่าง ด้วยอัตราส่วนภาพคุณสามารถคำนวณขนาดของภาพพร้อมกับขนาดของภาพได้

ตัวอย่างเช่น

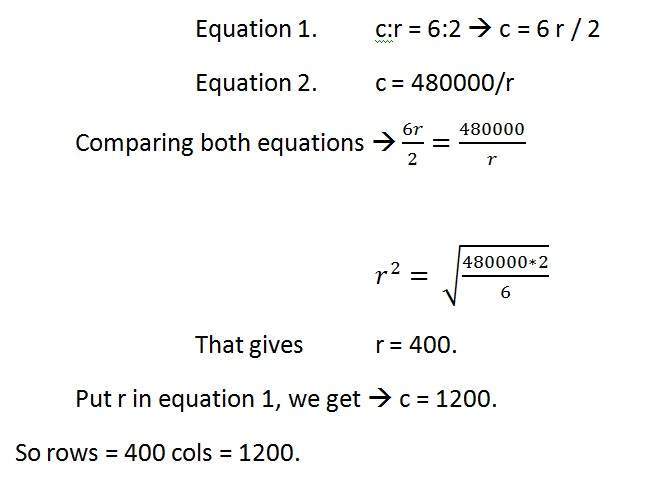

หากคุณได้รับรูปภาพที่มีอัตราส่วน 6: 2 ของรูปภาพที่มีความละเอียดพิกเซล 480000 พิกเซลเนื่องจากรูปภาพนั้นเป็นภาพสเกลสีเทา

และคุณจะถูกขอให้คำนวณสองสิ่ง

แก้ไขความละเอียดของพิกเซลเพื่อคำนวณขนาดของภาพ

คำนวณขนาดของภาพ

วิธีการแก้:

ให้:

อัตราส่วนภาพ: c: r = 6: 2

ความละเอียดพิกเซล: c * r = 480000

บิตต่อพิกเซล: ภาพระดับสีเทา = 8bpp

หา:

จำนวนแถว =?

จำนวน cols =?

การแก้ส่วนแรก:

การแก้ส่วนที่ 2:

ขนาด = แถว * cols * bpp

ขนาดของภาพเป็นบิต = 400 * 1200 * 8 = 3840000 บิต

ขนาดของภาพเป็นไบต์ = 480000 ไบต์

ขนาดของภาพเป็นกิโลไบต์ = 48 กิโลไบต์ (โดยประมาณ)

ในบทช่วยสอนนี้เราจะแนะนำแนวคิดเกี่ยวกับการซูมและเทคนิคทั่วไปที่ใช้ในการซูมภาพ

การซูม

การซูมหมายถึงการขยายภาพโดยให้รายละเอียดในภาพสามารถมองเห็นได้ชัดเจนขึ้น การซูมภาพมีแอพพลิเคชั่นมากมายตั้งแต่การซูมผ่านเลนส์กล้องไปจนถึงการซูมภาพบนอินเทอร์เน็ตเป็นต้น

ตัวอย่างเช่น

ถูกซูมเข้า

คุณสามารถซูมบางอย่างได้สองขั้นตอน

ขั้นตอนแรกรวมถึงการซูมก่อนที่จะถ่ายภาพใดภาพหนึ่ง สิ่งนี้เรียกว่าการซูมก่อนการประมวลผล การซูมนี้เกี่ยวข้องกับฮาร์ดแวร์และการเคลื่อนไหวของกลไก

ขั้นตอนที่สองคือการซูมเมื่อจับภาพได้แล้ว มันทำผ่านอัลกอริทึมต่างๆมากมายที่เราปรับแต่งพิกเซลเพื่อซูมเข้าไปในส่วนที่ต้องการ

เราจะพูดถึงรายละเอียดในบทช่วยสอนถัดไป

ซูมออปติคอลเทียบกับซูมดิจิตอล

กล้องรองรับการซูมสองประเภทนี้

ซูมออปติคอล:

การซูมแบบออปติคอลทำได้โดยใช้การเคลื่อนไหวของเลนส์กล้องของคุณ การซูมแบบออปติคอลคือการซูมที่แท้จริง ผลลัพธ์ของการซูมออปติคอลนั้นดีกว่าการซูมแบบดิจิตอลมาก ในการซูมแบบออปติคอลภาพจะถูกขยายโดยเลนส์ในลักษณะที่วัตถุในภาพดูเหมือนจะอยู่ใกล้กับกล้องมากขึ้น ในการซูมออปติคอลเลนส์จะขยายทางกายภาพเพื่อซูมหรือขยายวัตถุ

ซูมแบบดิจิตอล:

การซูมดิจิตอลโดยทั่วไปเป็นการประมวลผลภาพภายในกล้อง ในระหว่างการซูมดิจิตอลศูนย์กลางของภาพจะขยายและขอบของภาพจะถูกครอบตัดออก เนื่องจากศูนย์กลางขยายดูเหมือนว่าวัตถุจะอยู่ใกล้คุณมากขึ้น

ในระหว่างการซูมแบบดิจิทัลพิกเซลจะขยายออกเนื่องจากคุณภาพของภาพลดลง

ผลเช่นเดียวกันของการซูมดิจิตอลสามารถเห็นได้หลังจากถ่ายภาพผ่านคอมพิวเตอร์ของคุณโดยใช้กล่องเครื่องมือ / ซอฟต์แวร์ประมวลผลภาพเช่น Photoshop

ภาพต่อไปนี้เป็นผลมาจากการซูมแบบดิจิตอลโดยใช้วิธีใดวิธีหนึ่งต่อไปนี้ที่ระบุไว้ด้านล่างในวิธีการซูม

ตอนนี้เนื่องจากเรากำลังใช้การประมวลผลภาพดิจิทัลเราจึงไม่โฟกัสว่าจะซูมภาพได้อย่างไรโดยใช้เลนส์หรือสิ่งอื่น ๆ แต่เราจะมุ่งเน้นไปที่วิธีการซึ่งช่วยให้สามารถซูมภาพดิจิทัลได้

วิธีการซูม:

แม้ว่าจะมีหลายวิธีที่ใช้ได้ผล แต่เราจะพูดถึงวิธีการที่พบบ่อยที่สุดที่นี่

ตามรายการด้านล่าง

การจำลองพิกเซลหรือ (การแก้ไขเพื่อนบ้านที่ใกล้ที่สุด)

วิธีการระงับคำสั่งซื้อเป็นศูนย์

ซูม K ครั้ง

ทั้งสามวิธีนี้แนะนำอย่างเป็นทางการในบทช่วยสอนถัดไป

ในบทช่วยสอนนี้เราจะแนะนำวิธีการซูมสามวิธีอย่างเป็นทางการที่แนะนำในบทแนะนำเกี่ยวกับการซูมเบื้องต้น

วิธีการ

การจำลองพิกเซลหรือ (การแก้ไขเพื่อนบ้านที่ใกล้ที่สุด)

วิธีการระงับคำสั่งซื้อเป็นศูนย์

ซูม K ครั้ง

แต่ละวิธีมีข้อดีและข้อเสียของตัวเอง เราจะเริ่มต้นด้วยการพูดคุยเกี่ยวกับการจำลองแบบพิกเซล

วิธีที่ 1: การจำลองแบบพิกเซล:

บทนำ:

เรียกอีกอย่างว่าการแก้ไขเพื่อนบ้านที่ใกล้ที่สุด ตามชื่อของมันในวิธีนี้เราเพียงแค่จำลองพิกเซลข้างเคียง ดังที่เราได้กล่าวไปแล้วในบทช่วยสอนเรื่องการสุ่มตัวอย่างการซูมนั้นไม่ได้เป็นเพียงการเพิ่มจำนวนของตัวอย่างหรือพิกเซล อัลกอริทึมนี้ทำงานบนหลักการเดียวกัน

การทำงาน:

ในวิธีนี้เราสร้างพิกเซลใหม่จากพิกเซลที่กำหนดไว้แล้ว แต่ละพิกเซลจะจำลองแบบด้วยวิธีนี้ n เท่าของแถวที่ชาญฉลาดและคอลัมน์ที่ชาญฉลาดและคุณจะได้ภาพที่ซูม ง่ายๆแค่นั้นเอง

ตัวอย่างเช่น:

หากคุณมีรูปภาพ 2 แถวและ 2 คอลัมน์และคุณต้องการซูมสองครั้งหรือ 2 ครั้งโดยใช้การจำลองพิกเซลคุณสามารถทำได้ที่นี่

เพื่อความเข้าใจที่ดีขึ้นภาพจึงถูกถ่ายในรูปแบบของเมทริกซ์โดยมีค่าพิกเซลของภาพ

| 1 | 2 |

| 3 | 4 |

ภาพด้านบนมีสองแถวและสองคอลัมน์ก่อนอื่นเราจะซูมเข้าแถวอย่างชาญฉลาด

การซูมแถวที่ชาญฉลาด:

เมื่อเราซูมเข้าแถวอย่างชาญฉลาดเราก็แค่คัดลอกพิกเซลของแถวไปยังเซลล์ใหม่ที่อยู่ติดกัน

นี่คือวิธีการทำ

| 1 | 1 | 2 | 2 |

| 3 | 3 | 4 | 4 |

ดังที่คุณสามารถทำได้ในเมทริกซ์ด้านบนแต่ละพิกเซลจะถูกจำลองซ้ำสองครั้งในแถว

การซูมขนาดคอลัมน์:

ขั้นตอนต่อไปคือการจำลองคอลัมน์พิกเซลแต่ละคอลัมน์อย่างชาญฉลาดซึ่งเราจะคัดลอกพิกเซลของคอลัมน์ไปยังคอลัมน์ใหม่ที่อยู่ติดกันหรืออยู่ด้านล่าง

นี่คือวิธีการทำ

| 1 | 1 | 2 | 2 |

| 1 | 1 | 2 | 2 |

| 3 | 3 | 4 | 4 |

| 3 | 3 | 4 | 4 |

ขนาดภาพใหม่:

ดังที่เห็นได้จากตัวอย่างด้านบนภาพต้นฉบับ 2 แถวและ 2 คอลัมน์ถูกแปลงเป็น 4 แถวและ 4 คอลัมน์หลังจากการซูม นั่นหมายถึงภาพใหม่มีขนาด

(แถวภาพต้นฉบับ * ปัจจัยการซูม, ภาพต้นฉบับ * ปัจจัยการซูม)

ข้อดีและข้อเสีย:

ข้อดีอย่างหนึ่งของเทคนิคการซูมนี้คือมันง่ายมาก คุณต้องคัดลอกพิกเซลและไม่มีอะไรอื่น

ข้อเสียของเทคนิคนี้คือภาพถูกซูม แต่เอาต์พุตเบลอมาก และเมื่อปัจจัยการซูมเพิ่มขึ้นภาพก็เบลอมากขึ้นเรื่อย ๆ ซึ่งจะส่งผลให้ภาพเบลออย่างสมบูรณ์ในที่สุด

วิธีที่ 2: การระงับคำสั่งซื้อเป็นศูนย์

บทนำ

วิธีการระงับคำสั่งศูนย์เป็นอีกวิธีหนึ่งในการซูม เรียกอีกอย่างว่าซูมสองครั้ง เพราะซูมได้แค่สองครั้ง. เราจะเห็นในตัวอย่างด้านล่างว่าเหตุใดจึงทำเช่นนั้น

กำลังทำงาน

ในวิธีการระงับลำดับศูนย์เราเลือกองค์ประกอบที่อยู่ติดกันสองรายการจากแถวตามลำดับจากนั้นเราจึงเพิ่มและหารผลลัพธ์ด้วยสองและวางผลลัพธ์ไว้ระหว่างสององค์ประกอบนั้น ก่อนอื่นเราทำแถวนี้อย่างชาญฉลาดจากนั้นเราทำคอลัมน์นี้อย่างชาญฉลาด

ตัวอย่างเช่น

ให้ถ่ายภาพขนาด 2 แถวและ 2 คอลัมน์แล้วซูมสองครั้งโดยใช้การระงับลำดับศูนย์

| 1 | 2 |

| 3 | 4 |

ก่อนอื่นเราจะขยายแถวอย่างชาญฉลาดจากนั้นคอลัมน์ที่ชาญฉลาด

การซูมแถวอย่างชาญฉลาด

| 1 | 1 | 2 |

| 3 | 3 | 4 |

เมื่อเราหาตัวเลขสองตัวแรก: (2 + 1) = 3 แล้วเราหารด้วย 2 เราจะได้ 1.5 ซึ่งประมาณเป็น 1 วิธีเดียวกันนี้จะถูกนำไปใช้ในแถวที่ 2

การซูมคอลัมน์อย่างชาญฉลาด

| 1 | 1 | 2 |

| 2 | 2 | 3 |

| 3 | 3 | 4 |

เราเอาค่าพิกเซลของคอลัมน์ที่อยู่ติดกัน 2 ค่าซึ่งก็คือ 1 และ 3 เราบวกมันเข้าไปและได้ 4. 4 หารด้วย 2 และเราจะได้ 2 ซึ่งอยู่ระหว่างค่าเหล่านั้น ใช้วิธีการเดียวกันในทุกคอลัมน์

ขนาดภาพใหม่

ดังที่คุณเห็นว่าขนาดของรูปภาพใหม่คือ 3 x 3 โดยที่ขนาดของรูปภาพต้นฉบับคือ 2 x 2 ดังนั้นจึงหมายความว่าขนาดของรูปภาพใหม่จะขึ้นอยู่กับสูตรต่อไปนี้

(2 (จำนวนแถว) ลบ 1) X (2 (จำนวนคอลัมน์) ลบ 1)

ข้อดีและข้อเสีย

ข้อดีอย่างหนึ่งของเทคนิคการซูมนี้คือไม่ได้สร้างภาพเบลอเมื่อเทียบกับวิธีการแก้ไขเพื่อนบ้านที่ใกล้ที่สุด แต่มันก็มีข้อเสียตรงที่มันสามารถทำงานได้ด้วยพลังของ 2 เท่านั้นสามารถแสดงได้ที่นี่

เหตุผลเบื้องหลังการซูมสองครั้ง:

พิจารณารูปภาพ 2 แถวด้านบนและ 2 คอลัมน์ ถ้าเราต้องซูม 6 เท่าโดยใช้วิธี zero order hold ก็ไม่สามารถทำได้ ตามสูตรที่แสดงให้เราเห็นนี้

มันสามารถซูมได้เพียง 2 2,4,8,16,32 และอื่น ๆ

แม้ว่าคุณจะพยายามซูมก็ไม่สามารถทำได้ เนื่องจากในตอนแรกเมื่อคุณจะซูมสองครั้งและผลลัพธ์จะเหมือนกับที่แสดงในคอลัมน์การซูมที่ชาญฉลาดด้วยขนาดเท่ากับ 3x3 จากนั้นคุณจะซูมอีกครั้งและคุณจะได้ขนาดเท่ากับ 5 x 5 ตอนนี้ถ้าคุณจะทำอีกครั้งคุณจะได้ขนาดเท่ากับ 9 x 9

ในขณะที่ตามสูตรของคุณคำตอบควรเป็น 11x11 เป็น (6 (2) ลบ 1) X (6 (2) ลบ 1) ให้ 11 x 11

วิธีที่ 3: การซูม K-Times

บทนำ:

K times เป็นวิธีการซูมที่สามที่เราจะพูดถึง เป็นหนึ่งในอัลกอริทึมการซูมที่สมบูรณ์แบบที่สุดที่กล่าวถึง รองรับความท้าทายทั้งการซูมสองครั้งและการจำลองพิกเซล K ในอัลกอริทึมการซูมนี้หมายถึงปัจจัยการซูม

การทำงาน:

มันทำงานในลักษณะนี้

ก่อนอื่นคุณต้องใช้สองพิกเซลที่อยู่ติดกันเหมือนที่คุณทำในการซูมสองครั้ง จากนั้นคุณต้องลบสิ่งที่เล็กกว่าออกจากค่าที่มากกว่า เราเรียกผลลัพธ์นี้ว่า (OP)

แบ่งเอาต์พุต (OP) ด้วยปัจจัยการซูม (K) ตอนนี้คุณต้องเพิ่มผลลัพธ์ให้เป็นค่าที่น้อยลงและใส่ผลลัพธ์ไว้ระหว่างสองค่านั้น

เพิ่มค่า OP อีกครั้งให้กับค่าที่คุณเพิ่งใส่และวางอีกครั้งถัดจากค่าที่ใส่ก่อนหน้านี้ คุณต้องทำจนกว่าคุณจะวางค่า k-1 ลงไป

ทำซ้ำขั้นตอนเดียวกันสำหรับแถวและคอลัมน์ทั้งหมดและคุณจะได้ภาพที่ซูม

ตัวอย่างเช่น:

สมมติว่าคุณมีรูปภาพ 2 แถวและ 3 คอลัมน์ซึ่งได้รับด้านล่าง และคุณต้องซูมสามครั้งหรือสามครั้ง

| 15 | 30 | 15 |

| 30 | 15 | 30 |

K ในกรณีนี้คือ 3 K = 3

จำนวนค่าที่ควรแทรกคือ k-1 = 3-1 = 2

การซูมแถวอย่างชาญฉลาด

ใช้สองพิกเซลแรกที่อยู่ติดกัน ซึ่ง ได้แก่ 15 และ 30

ลบ 15 จาก 30 30-15 = 15

หาร 15 ด้วย k. 15 / k = 15/3 = 5 เราเรียกมันว่า OP (โดยที่ op เป็นเพียงชื่อ)

เพิ่ม OP ลงในตัวเลขที่ต่ำกว่า 15 + OP = 15 + 5 = 20

เพิ่ม OP เป็น 20 อีกครั้ง 20 + OP = 20 + 5 = 25

เราทำ 2 ครั้งเพราะเราต้องใส่ค่า k-1

ทำซ้ำขั้นตอนนี้สำหรับสองพิกเซลที่อยู่ติดกันถัดไป แสดงไว้ในตารางแรก

หลังจากแทรกค่าแล้วคุณต้องเรียงค่าที่แทรกตามลำดับจากน้อยไปมากดังนั้นจึงยังคงมีความสมมาตรระหว่างค่าเหล่านี้

จะแสดงในตารางที่สอง

ตารางที่ 1.

| 15 | 20 | 25 | 30 | 20 | 25 | 15 |

| 30 | 20 | 25 | 15 | 20 | 25 | 30 |

ตารางที่ 2.

การซูมคอลัมน์อย่างชาญฉลาด

ขั้นตอนเดียวกันจะต้องดำเนินการคอลัมน์อย่างชาญฉลาด ขั้นตอนนี้รวมถึงการรับค่าพิกเซลสองค่าที่อยู่ติดกันแล้วลบค่าที่เล็กกว่าออกจากค่าที่ใหญ่กว่า หลังจากนั้นคุณต้องหารด้วย k จัดเก็บผลลัพธ์เป็น OP เพิ่ม OP ให้เล็กลงจากนั้นเพิ่ม OP อีกครั้งในค่าที่มาจากการเพิ่มครั้งแรกของ OP แทรกค่าใหม่

นี่คือสิ่งที่คุณได้รับหลังจากนั้น

| 15 | 20 | 25 | 30 | 25 | 20 | 15 |

| 20 | 21 | 21 | 25 | 21 | 21 | 20 |

| 25 | 22 | 22 | 20 | 22 | 22 | 25 |

| 30 | 25 | 20 | 15 | 20 | 25 | 30 |

ขนาดภาพใหม่

วิธีที่ดีที่สุดในการคำนวณสูตรสำหรับขนาดของรูปภาพใหม่คือการเปรียบเทียบขนาดของรูปภาพต้นฉบับกับรูปภาพสุดท้าย ขนาดของรูปภาพต้นฉบับคือ 2 X 3 และขนาดของรูปภาพใหม่คือ 4 x 7

สูตรจึงเป็น:

(K (จำนวนแถวลบ 1) + 1) X (K (จำนวน cols ลบ 1) + 1)

ข้อดีและข้อเสีย

ข้อได้เปรียบที่ชัดเจนอย่างหนึ่งของอัลกอริทึมการซูมเวลา k คือสามารถคำนวณการซูมของปัจจัยใด ๆ ที่เป็นพลังของอัลกอริธึมการจำลองแบบพิกเซลและยังให้ผลลัพธ์ที่ดีขึ้น (เบลอน้อยลง) ซึ่งเป็นพลังของวิธีการระงับคำสั่งเป็นศูนย์ ดังนั้นจึงประกอบด้วยพลังของสองอัลกอริทึม

ความยากเพียงอย่างเดียวของอัลกอริทึมนี้คือต้องเรียงลำดับในตอนท้ายซึ่งเป็นขั้นตอนเพิ่มเติมและทำให้ต้นทุนในการคำนวณเพิ่มขึ้น

ความละเอียดของภาพ

ความละเอียดของภาพสามารถกำหนดได้หลายวิธี ประเภทหนึ่งซึ่งเป็นความละเอียดพิกเซลที่ได้รับการกล่าวถึงในบทช่วยสอนเกี่ยวกับความละเอียดพิกเซลและอัตราส่วนภาพ

ในบทช่วยสอนนี้เราจะกำหนดความละเอียดอีกประเภทหนึ่งซึ่งก็คือความละเอียดเชิงพื้นที่

ความละเอียดเชิงพื้นที่:

ความละเอียดเชิงพื้นที่ระบุว่าความคมชัดของภาพไม่สามารถกำหนดได้ด้วยความละเอียดของพิกเซล จำนวนพิกเซลในภาพไม่สำคัญ

ความละเอียดเชิงพื้นที่สามารถกำหนดเป็นไฟล์

รายละเอียดที่เล็กที่สุดในภาพที่มองเห็นได้ (การประมวลผลภาพดิจิทัล - Gonzalez, Woods - 2nd Edition)

หรือในทางอื่นเราสามารถกำหนดความละเอียดเชิงพื้นที่เป็นจำนวนพิกเซลอิสระต่อนิ้ว

ในระยะสั้นความละเอียดเชิงพื้นที่หมายถึงเราไม่สามารถเปรียบเทียบภาพสองประเภทที่แตกต่างกันเพื่อดูว่าภาพใดชัดเจนหรือภาพใดไม่ชัดเจน หากเราต้องเปรียบเทียบทั้งสองภาพเพื่อดูว่าภาพใดชัดเจนกว่าหรือมีความละเอียดเชิงพื้นที่มากกว่าเราจะต้องเปรียบเทียบภาพสองภาพที่มีขนาดเท่ากัน

ตัวอย่างเช่น:

คุณไม่สามารถเปรียบเทียบสองภาพนี้เพื่อดูความชัดเจนของภาพได้

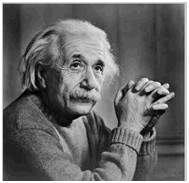

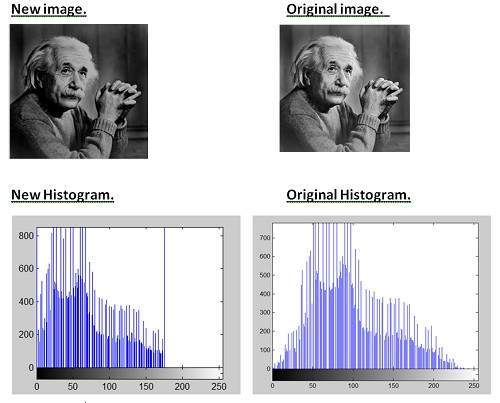

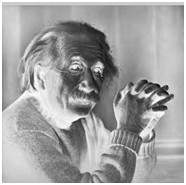

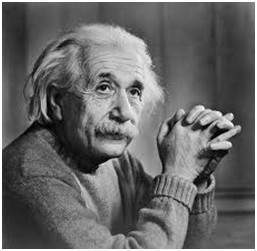

แม้ว่าทั้งสองภาพจะเป็นภาพคนเดียวกัน แต่นั่นไม่ใช่เงื่อนไขที่เรากำลังตัดสิน ภาพทางด้านซ้ายคือภาพของ Einstein ที่มีขนาด 227 x 222 ออกมาในขณะที่ภาพทางด้านขวามีขนาด 980 X 749 และยังเป็นภาพที่มีการซูม เราไม่สามารถเปรียบเทียบให้เห็นว่าอันไหนชัดเจนกว่ากัน โปรดจำไว้ว่าปัจจัยของการซูมไม่สำคัญในเงื่อนไขนี้สิ่งเดียวที่สำคัญคือสองภาพนี้ไม่เท่ากัน

ดังนั้นในการวัดความละเอียดเชิงพื้นที่รูปภาพด้านล่างจะแสดงวัตถุประสงค์

ตอนนี้คุณสามารถเปรียบเทียบสองภาพนี้ ทั้งสองภาพมีขนาดเท่ากันซึ่งมีขนาด 227 X 222 เมื่อเปรียบเทียบกันแล้วคุณจะเห็นว่าภาพทางด้านซ้ายมีความละเอียดเชิงพื้นที่มากกว่าหรือมีความชัดเจนมากกว่าภาพทางด้านขวา นั่นเป็นเพราะภาพทางขวามือเป็นภาพเบลอ

การวัดความละเอียดเชิงพื้นที่:

เนื่องจากความละเอียดเชิงพื้นที่หมายถึงความชัดเจนดังนั้นสำหรับอุปกรณ์ที่แตกต่างกันจึงมีการวัดที่แตกต่างกันเพื่อวัด

ตัวอย่างเช่น:

จุดต่อนิ้ว

เส้นต่อนิ้ว

พิกเซลต่อนิ้ว

พวกเขาจะกล่าวถึงรายละเอียดเพิ่มเติมในบทช่วยสอนถัดไป แต่มีการแนะนำสั้น ๆ ไว้ด้านล่าง

จุดต่อนิ้ว:

จุดต่อนิ้วหรือ DPI มักใช้ในจอภาพ

เส้นต่อนิ้ว:

เส้นต่อนิ้วหรือ LPI มักใช้ในเครื่องพิมพ์เลเซอร์

พิกเซลต่อนิ้ว:

พิกเซลต่อนิ้วหรือ PPI วัดได้สำหรับอุปกรณ์ต่างๆเช่นแท็บเล็ตโทรศัพท์มือถือเป็นต้น

ในบทแนะนำเกี่ยวกับการแก้ปัญหาเชิงพื้นที่ก่อนหน้านี้เราได้พูดถึงการแนะนำสั้น ๆ ของ PPI, DPI, LPI ตอนนี้เรากำลังจะหารืออย่างเป็นทางการทั้งหมด

พิกเซลต่อนิ้ว

ความหนาแน่นของพิกเซลหรือพิกเซลต่อนิ้วเป็นการวัดความละเอียดเชิงพื้นที่สำหรับอุปกรณ์ต่างๆซึ่งรวมถึงแท็บเล็ตโทรศัพท์มือถือ

ยิ่ง PPI สูงเท่าไหร่คุณภาพก็ยิ่งสูงขึ้นเท่านั้น เพื่อให้เข้าใจมากขึ้นว่ามันคำนวณอย่างไร ให้คำนวณ PPI ของโทรศัพท์มือถือ

การคำนวณพิกเซลต่อนิ้ว (PPI) ของ Samsung galaxy S4:

Samsung galaxy s4 มี PPI หรือความหนาแน่นของพิกเซล 441 แต่จะคำนวณอย่างไร?

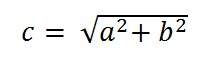

ก่อนอื่นเราจะใช้ทฤษฎีบท Pythagoras เพื่อคำนวณความละเอียดของเส้นทแยงมุมเป็นพิกเซล

สามารถกำหนดเป็น:

โดยที่ a และ b คือความละเอียดความสูงและความกว้างในพิกเซลและ c คือความละเอียดแนวทแยงเป็นพิกเซล

สำหรับ Samsung galaxy s4 มีขนาด 1080 x 1920 พิกเซล

ดังนั้นการใส่ค่าเหล่านั้นลงในสมการจะได้ผลลัพธ์

C = 2202.90717

ตอนนี้เราจะคำนวณ PPI

PPI = c / ขนาดเส้นทแยงมุมเป็นนิ้ว

ขนาดเส้นทแยงมุมเป็นนิ้วของ Samsun galaxy s4 คือ 5.0 นิ้วซึ่งสามารถยืนยันได้จากทุกที่

PPI = 2202.90717 / 5.0

PPI = 440.58

PPI = 441 (โดยประมาณ)

นั่นหมายความว่าความหนาแน่นของพิกเซลของ Samsung galaxy s4 คือ 441 PPI

จุดต่อนิ้ว.

dpi มักเกี่ยวข้องกับ PPI ในขณะที่ทั้งสองมีความแตกต่างกัน DPI หรือจุดต่อนิ้วเป็นการวัดความละเอียดเชิงพื้นที่ของเครื่องพิมพ์ ในกรณีของเครื่องพิมพ์ dpi หมายถึงจำนวนจุดหมึกที่พิมพ์ต่อนิ้วเมื่อพิมพ์ภาพออกจากเครื่องพิมพ์

อย่าลืมว่าแต่ละพิกเซลต่อนิ้วไม่จำเป็นต้องพิมพ์ทีละจุดต่อนิ้ว อาจมีหลายจุดต่อนิ้วที่ใช้สำหรับการพิมพ์หนึ่งพิกเซล สาเหตุที่เครื่องพิมพ์สีส่วนใหญ่ใช้รุ่น CMYK สีมีจำนวน จำกัด เครื่องพิมพ์มีให้เลือกจากสีเหล่านี้เพื่อสร้างสีของพิกเซลในขณะที่ในพีซีคุณมีสีหลายแสนสี

ยิ่งค่า dpi ของเครื่องพิมพ์สูงเท่าใดคุณภาพของเอกสารที่พิมพ์หรือภาพบนกระดาษก็จะยิ่งสูงขึ้นเท่านั้น

โดยปกติเครื่องพิมพ์เลเซอร์บางรุ่นจะมี dpi ที่ 300 และบางรุ่นมี 600 หรือมากกว่า

เส้นต่อนิ้ว

เมื่อ dpi หมายถึงจุดต่อนิ้วซับต่อนิ้วหมายถึงเส้นของจุดต่อนิ้ว ความละเอียดของหน้าจอ halftone วัดเป็นเส้นต่อนิ้ว

ตารางต่อไปนี้แสดงความจุบรรทัดต่อนิ้วของเครื่องพิมพ์

| เครื่องพิมพ์ | LPI |

|---|---|

| การพิมพ์สกรีน | 45-65 lpi |

| เครื่องพิมพ์เลเซอร์ (300 dpi) | 65 lpi |

| เครื่องพิมพ์เลเซอร์ (600 dpi) | 85-105 lpi |

| Offset Press (กระดาษหนังสือพิมพ์) | 85 lpi |

| Offset Press (กระดาษเคลือบ) | 85-185 lpi |

ความละเอียดของภาพ:

ความละเอียดระดับสีเทา:

ความละเอียดระดับสีเทาหมายถึงการเปลี่ยนแปลงที่คาดเดาได้หรือกำหนดได้ในเฉดสีหรือระดับสีเทาในรูปภาพ

ในความละเอียดระดับสีเทาสั้น ๆ จะเท่ากับจำนวนบิตต่อพิกเซล

เราได้พูดถึงบิตต่อพิกเซลแล้วในบทช่วยสอนเกี่ยวกับบิตต่อพิกเซลและข้อกำหนดในการจัดเก็บภาพ เราจะกำหนด bpp ที่นี่สั้น ๆ

BPP:

จำนวนสีที่แตกต่างกันในภาพขึ้นอยู่กับความลึกของสีหรือบิตต่อพิกเซล

ทางคณิตศาสตร์:

ความสัมพันธ์ทางคณิตศาสตร์ที่สามารถสร้างขึ้นระหว่างความละเอียดระดับสีเทาและบิตต่อพิกเซลสามารถกำหนดเป็น

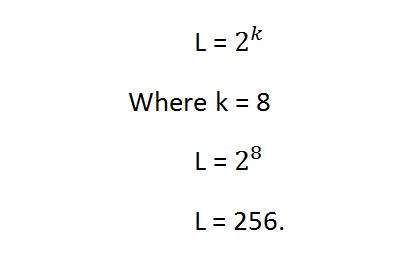

ในสมการนี้ L หมายถึงจำนวนระดับสีเทา นอกจากนี้ยังสามารถกำหนดเป็นเฉดสีเทา และ k หมายถึง bpp หรือบิตต่อพิกเซล ดังนั้น 2 ยกกำลังของบิตต่อพิกเซลเท่ากับความละเอียดระดับสีเทา

ตัวอย่างเช่น:

ภาพไอน์สไตน์ด้านบนนี้เป็นภาพสเกลสีเทา หมายถึงภาพที่มี 8 บิตต่อพิกเซลหรือ 8bpp

ตอนนี้ถ้าจะคำนวณความละเอียดระดับสีเทาเราจะทำอย่างไร

หมายความว่าความละเอียดระดับสีเทาคือ 256 หรืออีกนัยหนึ่งเราสามารถพูดได้ว่าภาพนี้มีเฉดสีเทาที่แตกต่างกัน 256 เฉด

ยิ่งมีจำนวนบิตต่อพิกเซลของภาพมากเท่าใดความละเอียดระดับสีเทาก็ยิ่งมากขึ้นเท่านั้น

การกำหนดความละเอียดระดับสีเทาในแง่ของ bpp:

ไม่จำเป็นว่าควรกำหนดความละเอียดระดับสีเทาในรูปของระดับเท่านั้น เรายังกำหนดเป็นบิตต่อพิกเซลได้อีกด้วย

ตัวอย่างเช่น:

หากคุณได้รับภาพ 4 bpp และระบบจะขอให้คุณคำนวณความละเอียดระดับสีเทา มีสองคำตอบสำหรับคำถามนั้น

คำตอบแรกคือ 16 ระดับ

คำตอบที่สองคือ 4 บิต

ค้นหา bpp จากความละเอียดระดับสีเทา:

คุณยังสามารถค้นหาบิตต่อพิกเซลได้จากความละเอียดระดับสีเทาที่กำหนด สำหรับสิ่งนี้เราต้องบิดสูตรเล็กน้อย

สมการ 1.

สูตรนี้ค้นหาระดับ ทีนี้ถ้าเราหาบิตต่อพิกเซลหรือในกรณีนี้ k เราก็จะเปลี่ยนเป็นแบบนี้

K = log ฐาน 2 (L) สมการ (2)

เนื่องจากในสมการแรกความสัมพันธ์ระหว่างระดับ (L) และบิตต่อพิกเซล (k) เป็นเลขชี้กำลัง ตอนนี้เราต้องเปลี่ยนกลับดังนั้นสิ่งที่ผกผันของเลขชี้กำลังคือ log

มาดูตัวอย่างเพื่อค้นหาบิตต่อพิกเซลจากความละเอียดระดับสีเทา

ตัวอย่างเช่น:

หากคุณได้รับภาพ 256 ระดับ บิตต่อพิกเซลที่จำเป็นสำหรับมันคืออะไร

เราใส่ 256 ในสมการ

K = ฐานบันทึก 2 (256)

K = 8.

ดังนั้นคำตอบคือ 8 บิตต่อพิกเซล

ความละเอียดระดับสีเทาและการหาปริมาณ:

การหาปริมาณจะถูกนำมาใช้อย่างเป็นทางการในบทช่วยสอนถัดไป แต่ในที่นี้เราจะอธิบายถึงความสัมพันธ์ระหว่างความละเอียดระดับสีเทาและการหาปริมาณ

พบความละเอียดระดับสีเทาบนแกน y ของสัญญาณ ในบทแนะนำเกี่ยวกับความรู้เบื้องต้นเกี่ยวกับสัญญาณและระบบเราได้ศึกษาว่าการแปลงสัญญาณอนาล็อกเป็นดิจิทัลต้องใช้สองขั้นตอน การสุ่มตัวอย่างและการหาปริมาณ

ทำการสุ่มตัวอย่างบนแกน x และการหาปริมาณจะทำในแกน Y

นั่นหมายถึงการแปลงความละเอียดระดับสีเทาของภาพให้เป็นดิจิทัลจะทำในการหาปริมาณ

เราได้แนะนำการหาปริมาณในการสอนสัญญาณและระบบของเรา เราจะเชื่อมโยงอย่างเป็นทางการกับภาพดิจิทัลในบทช่วยสอนนี้ มาพูดคุยกันก่อนเล็กน้อยเกี่ยวกับการหาปริมาณ

การแปลงสัญญาณเป็นดิจิทัล

ดังที่เราได้เห็นในบทช่วยสอนก่อนหน้านี้การแปลงสัญญาณแอนะล็อกให้เป็นดิจิทัลนั้นต้องใช้สองขั้นตอนพื้นฐาน การสุ่มตัวอย่างและการหาปริมาณ ทำการสุ่มตัวอย่างบนแกน x เป็นการแปลงแกน x (ค่าอนันต์) เป็นค่าดิจิทัล

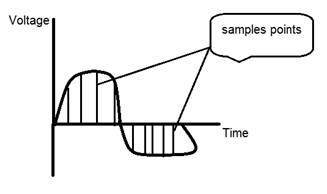

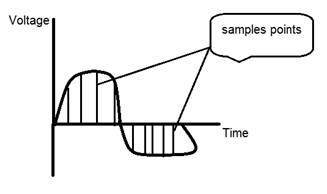

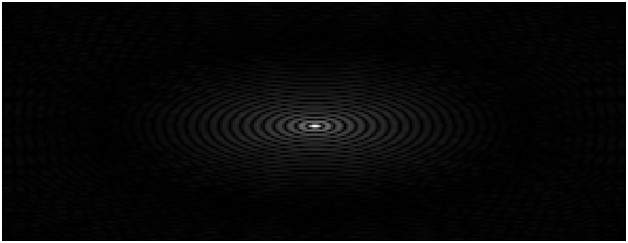

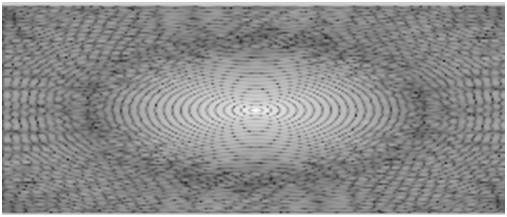

รูปด้านล่างแสดงการสุ่มตัวอย่างสัญญาณ

การสุ่มตัวอย่างที่สัมพันธ์กับภาพดิจิทัล:

แนวคิดของการสุ่มตัวอย่างเกี่ยวข้องโดยตรงกับการซูม ยิ่งคุณใช้ตัวอย่างมากเท่าไหร่คุณก็จะได้พิกเซลมากขึ้นเท่านั้น การสุ่มตัวอย่างเกินสามารถเรียกได้ว่าเป็นการซูม สิ่งนี้ได้รับการกล่าวถึงภายใต้การสอนการสุ่มตัวอย่างและการซูม

แต่เรื่องราวของการแปลงสัญญาณดิจิทัลไม่ได้จบลงที่การสุ่มตัวอย่างเช่นกันยังมีอีกขั้นตอนที่เกี่ยวข้องซึ่งเรียกว่า Quantization

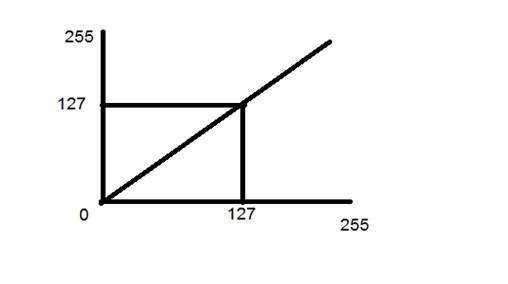

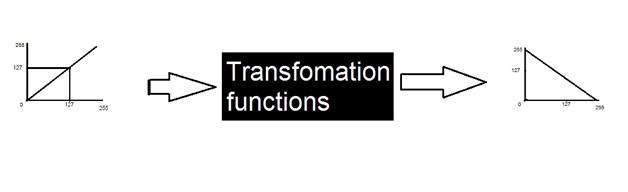

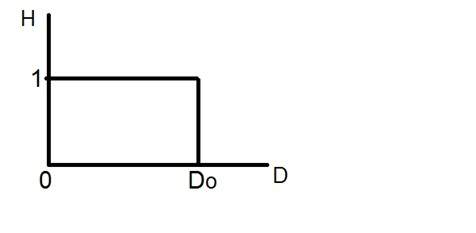

Quantization คืออะไร

Quantization ตรงข้ามกับการสุ่มตัวอย่าง มันทำบนแกน y เมื่อคุณกำลังปรับขนาดรูปภาพคุณกำลังแบ่งสัญญาณออกเป็นควอนต้า (พาร์ติชัน)

บนแกน x ของสัญญาณคือค่าพิกัดและบนแกน y เรามีแอมพลิจูด ดังนั้นการแปลงแอมพลิจูดให้เป็นดิจิทัลจึงเรียกว่า Quantization

นี่คือวิธีการทำ

คุณจะเห็นในภาพนี้ว่าสัญญาณได้รับการวัดปริมาณออกเป็นสามระดับที่แตกต่างกัน นั่นหมายความว่าเมื่อเราสุ่มตัวอย่างรูปภาพเรารวบรวมค่าต่างๆมากมายและในการหาปริมาณเราตั้งค่าระดับให้กับค่าเหล่านี้ สิ่งนี้สามารถชัดเจนมากขึ้นในภาพด้านล่าง

ในรูปที่แสดงในการสุ่มตัวอย่างแม้ว่าตัวอย่างจะถูกนำไปแล้ว แต่ก็ยังคงทอดในแนวตั้งไปยังช่วงของค่าระดับสีเทาอย่างต่อเนื่อง ในรูปที่แสดงด้านบนค่าที่เรียงตามแนวตั้งเหล่านี้ได้รับการวัดปริมาณออกเป็น 5 ระดับหรือพาร์ติชันที่แตกต่างกัน ตั้งแต่ 0 ดำไปจนถึง 4 ขาว ระดับนี้อาจแตกต่างกันไปตามประเภทของภาพที่คุณต้องการ

ความสัมพันธ์ของการหาปริมาณกับระดับสีเทาได้รับการกล่าวถึงเพิ่มเติมด้านล่าง

ความสัมพันธ์ของปริมาณที่มีความละเอียดระดับสีเทา:

ตัวเลขเชิงปริมาณที่แสดงด้านบนมีระดับสีเทา 5 ระดับ หมายความว่าภาพที่เกิดจากสัญญาณนี้จะมีสีต่างกันเพียง 5 สี มันจะเป็นภาพขาวดำไม่มากก็น้อยที่มีสีเทาบ้าง ตอนนี้ถ้าคุณต้องการปรับปรุงคุณภาพของภาพให้ดีขึ้นมีสิ่งหนึ่งที่คุณสามารถทำได้ที่นี่ ซึ่งก็คือการเพิ่มระดับหรือความละเอียดระดับสีเทาขึ้น หากคุณเพิ่มระดับนี้เป็น 256 แสดงว่าคุณมีภาพระดับสีเทา ซึ่งดีกว่ามากแล้วภาพขาวดำเรียบง่าย

ตอนนี้ 256 หรือ 5 หรือระดับที่คุณเคยเลือกเรียกว่าระดับสีเทา จำสูตรที่เราพูดถึงในบทช่วยสอนก่อนหน้าเกี่ยวกับความละเอียดระดับสีเทาซึ่งก็คือ

เราได้หารือกันว่าระดับสีเทาสามารถกำหนดได้สองวิธี ซึ่งเป็นสองคนนี้

ระดับสีเทา = จำนวนบิตต่อพิกเซล (BPP) (k ในสมการ)

ระดับสีเทา = จำนวนระดับต่อพิกเซล

ในกรณีนี้เรามีระดับสีเทาเท่ากับ 256 ถ้าเราต้องคำนวณจำนวนบิตเราก็ใส่ค่าลงในสมการ ในกรณีของ 256 ระดับเรามีเฉดสีเทา 256 เฉดและ 8 บิตต่อพิกเซลดังนั้นภาพจึงเป็นภาพระดับสีเทา

ลดระดับสีเทา

ตอนนี้เราจะลดระดับสีเทาของภาพเพื่อดูเอฟเฟกต์บนภาพ

ตัวอย่างเช่น:

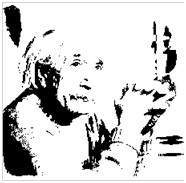

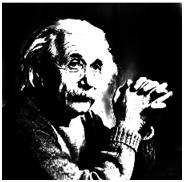

สมมติว่าคุณมีรูปภาพของ 8bpp ซึ่งมีระดับที่แตกต่างกัน 256 ระดับ มันเป็นภาพโทนสีเทาและภาพจะมีลักษณะประมาณนี้

256 ระดับสีเทา

ตอนนี้เราจะเริ่มลดระดับสีเทา ก่อนอื่นเราจะลดระดับสีเทาจาก 256 เป็น 128

128 ระดับสีเทา

ไม่มีผลต่อภาพมากนักหลังจากลดระดับสีเทาลงเหลือครึ่งหนึ่ง ให้ลดลงบ้าง

64 ระดับสีเทา

ยังไม่มีผลมากนักจากนั้นให้ลดระดับมากขึ้น

32 ระดับสีเทา

ประหลาดใจที่เห็นว่ายังมีผลเล็กน้อย อาจเป็นเพราะเหตุผลนั่นคือภาพของไอน์สไตน์ แต่ช่วยลดระดับให้มากขึ้น

16 ระดับสีเทา

บูมที่นี่เราไปในที่สุดภาพก็เผยให้เห็นว่ามันได้รับผลกระทบจากระดับ

8 ระดับสีเทา

4 ระดับสีเทา

ตอนนี้ก่อนที่จะลดลงอีก 2 ระดับคุณจะเห็นได้อย่างง่ายดายว่าภาพบิดเบี้ยวไม่ดีโดยการลดระดับสีเทา ตอนนี้เราจะลดเป็น 2 ระดับซึ่งไม่มีอะไรนอกจากระดับขาวดำธรรมดา หมายความว่าภาพจะเป็นภาพขาวดำธรรมดา ๆ

2 ระดับสีเทา

นั่นคือระดับสุดท้ายที่เราทำได้เพราะถ้าลดลงไปอีกมันจะเป็นเพียงภาพสีดำซึ่งไม่สามารถตีความได้

Contouring:

มีข้อสังเกตที่น่าสนใจคือเมื่อเราลดจำนวนระดับสีเทาจะมีเอฟเฟกต์พิเศษปรากฏขึ้นในภาพซึ่งสามารถมองเห็นได้ชัดเจนในภาพระดับสีเทา 16 ภาพ เอฟเฟกต์นี้เรียกว่า Contouring

เส้นโค้งการตั้งค่า ISO:

คำตอบของเอฟเฟกต์นี้ว่าเหตุใดจึงปรากฏอยู่ในเส้นโค้งการตั้งค่า Iso พวกเขาจะกล่าวถึงในบทแนะนำต่อไปของเส้นโค้งการตั้งค่า Contouring และ Iso

Contouring คืออะไร?

เมื่อเราลดจำนวนระดับสีเทาในภาพสีหรือขอบที่ผิดพลาดบางส่วนจะเริ่มปรากฏบนภาพ สิ่งนี้ได้แสดงไว้ในบทช่วยสอนสุดท้ายของ Quantization

มาดูกันเลย

ลองพิจารณาเรามีภาพ 8bpp (ภาพระดับสีเทา) ที่มีระดับสีเทาหรือสีเทา 256 เฉด

ภาพด้านบนนี้มีเฉดสีเทาที่แตกต่างกัน 256 เฉด ตอนนี้เมื่อเราลดเป็น 128 และลดอีก 64 ภาพจะมากหรือน้อยเท่ากัน แต่เมื่อลดระดับลงไปอีก 32 ระดับเราได้ภาพแบบนี้