Yapay Sinir Ağı - Temel Kavramlar

Sinir ağları, temelde beynin bir bilgisayar modelini yapma girişimi olan paralel bilgi işlem cihazlarıdır. Temel amaç, çeşitli hesaplama görevlerini geleneksel sistemlerden daha hızlı gerçekleştirmek için bir sistem geliştirmektir. Bu görevler, örüntü tanıma ve sınıflandırmayı, yaklaştırmayı, optimizasyonu ve veri kümelemeyi içerir.

Yapay Sinir Ağı nedir?

Yapay Sinir Ağı (YSA), ana teması biyolojik sinir ağları analojisinden ödünç alınan verimli bir bilgi işlem sistemidir. YSA'lar aynı zamanda "yapay sinir sistemleri" veya "paralel dağıtılmış işlem sistemleri" veya "bağlantısal sistemler" olarak da adlandırılır. YSA, birimler arasında iletişime izin vermek için bazı modellerde birbirine bağlı geniş bir birim koleksiyonu elde eder. Düğümler veya nöronlar olarak da adlandırılan bu birimler, paralel olarak çalışan basit işlemcilerdir.

Her nöron, bir bağlantı bağı aracılığıyla diğer nöronla bağlantılıdır. Her bağlantı bağlantısı, giriş sinyali hakkında bilgi içeren bir ağırlık ile ilişkilidir. Bu, nöronların belirli bir sorunu çözmesi için en yararlı bilgidir çünkü ağırlık genellikle iletilen sinyali uyarır veya engeller. Her nöronun aktivasyon sinyali adı verilen bir iç durumu vardır. Giriş sinyalleri ve aktivasyon kuralı birleştirildikten sonra üretilen çıkış sinyalleri diğer birimlere gönderilebilir.

YSA'nın Kısa Tarihi

YSA geçmişi aşağıdaki üç döneme ayrılabilir:

1940'lardan 1960'lara kadar YSA

Bu dönemin bazı önemli gelişmeleri şu şekildedir:

1943 - Sinir ağı kavramının, 1943'te beyindeki nöronların nasıl çalışabileceğini açıklamak için elektrik devrelerini kullanarak basit bir sinir ağını modellediklerinde, fizyolog Warren McCulloch ve matematikçi Walter Pitts'in çalışmaları ile başladığı varsayılmıştır. .

1949- Donald Hebb'in The Organization of Behavior adlı kitabı, bir nöronun bir başkası tarafından tekrar tekrar etkinleştirilmesinin, her kullanıldığında gücünü artırdığını ortaya koyuyor.

1956 - Bir ilişkisel bellek ağı Taylor tarafından tanıtıldı.

1958 - McCulloch ve Pitts nöron modeli için Perceptron adlı bir öğrenme yöntemi Rosenblatt tarafından icat edildi.

1960 - Bernard Widrow ve Marcian Hoff, "ADALINE" ve "MADALINE" adlı modeller geliştirdi.

1960'lardan 1980'lere kadar YSA

Bu dönemin bazı önemli gelişmeleri şu şekildedir:

1961 - Rosenblatt başarısız bir girişimde bulundu ancak çok katmanlı ağlar için “geri yayılım” şemasını önerdi.

1964 - Taylor, çıkış birimleri arasında engellemelerle kazanan her şeyi alan bir devre kurdu.

1969 - Çok katmanlı algılayıcı (MLP), Minsky ve Papert tarafından icat edildi.

1971 - Kohonen, İlişkisel anılar geliştirdi.

1976 - Stephen Grossberg ve Gail Carpenter Uyarlamalı rezonans teorisini geliştirdi.

1980'lerden Günümüze YSA

Bu dönemin bazı önemli gelişmeleri şu şekildedir:

1982 - En önemli gelişme Hopfield'ın Enerji yaklaşımı oldu.

1985 - Boltzmann makinesi Ackley, Hinton ve Sejnowski tarafından geliştirildi.

1986 - Rumelhart, Hinton ve Williams, Genelleştirilmiş Delta Kuralını tanıttı.

1988 - Kosko, Binary Associative Memory'yi (BAM) geliştirdi ve YSA'da Bulanık Mantık kavramını verdi.

Tarihsel inceleme, bu alanda önemli ilerlemeler kaydedildiğini göstermektedir. Sinir ağı tabanlı çipler ortaya çıkıyor ve karmaşık sorunlara uygulamalar geliştiriliyor. Elbette bugün sinir ağı teknolojisi için bir geçiş dönemi.

Biyolojik Nöron

Sinir hücresi (nöron), bilgiyi işleyen özel bir biyolojik hücredir. Bir tahmine göre , çok sayıda ara bağlantıya sahip yaklaşık 10 11 , yaklaşık 10 15 olmak üzere çok sayıda nöron vardır .

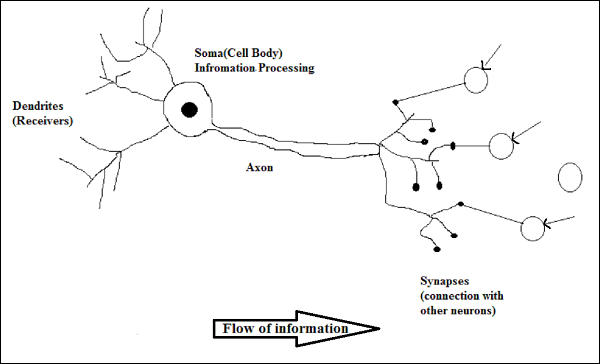

Şematik diyagram

Biyolojik Nöronun Çalışması

Yukarıdaki diyagramda gösterildiği gibi, tipik bir nöron, çalışmasını açıklayabileceğimiz aşağıdaki dört bölümden oluşur -

Dendrites- Bağlı oldukları diğer nöronlardan bilgi almaktan sorumlu ağaç benzeri dallardır. Diğer bir anlamda nöronun kulakları gibi olduklarını söyleyebiliriz.

Soma - Nöronun hücre gövdesidir ve dendritlerden aldıkları bilgilerin işlenmesinden sorumludur.

Axon - Tıpkı nöronların bilgiyi gönderdiği bir kablo gibidir.

Synapses - Akson ile diğer nöron dendritleri arasındaki bağlantıdır.

YSA ve BNN

Yapay Sinir Ağı (YSA) ve Biyolojik Sinir Ağı (BNN) arasındaki farklara bakmadan önce, bu ikisi arasındaki terminolojiye dayalı benzerliklere bir göz atalım.

| Biyolojik Sinir Ağı (BNN) | Yapay Sinir Ağı (YSA) |

|---|---|

| Soma | Düğüm |

| Dendritler | Giriş |

| Sinaps | Ağırlıklar veya Ara Bağlantılar |

| Akson | Çıktı |

Aşağıdaki tablo, bahsedilen bazı kriterlere göre YSA ve BNN arasındaki karşılaştırmayı göstermektedir.

| Kriterler | BNN | YSA |

|---|---|---|

| Processing | Büyük ölçüde paralel, yavaş ama YSA'dan üstün | Büyük ölçüde paralel, hızlı ancak BNN'den daha düşük |

| Size | 10 11 nöron ve 10 15 ara bağlantı | 10 2 ila 10 4 düğüm (esas olarak uygulama türüne ve ağ tasarımcısına bağlıdır) |

| Learning | Belirsizliği tolere edebilirler | Belirsizliği tolere etmek için çok kesin, yapılandırılmış ve biçimlendirilmiş veriler gereklidir |

| Fault tolerance | Kısmi hasarla bile performans düşer | Sağlam performansa sahiptir, dolayısıyla hataya dayanıklı olma potansiyeline sahiptir |

| Storage capacity | Bilgileri sinapsta depolar | Bilgileri sürekli bellek konumlarında saklar |

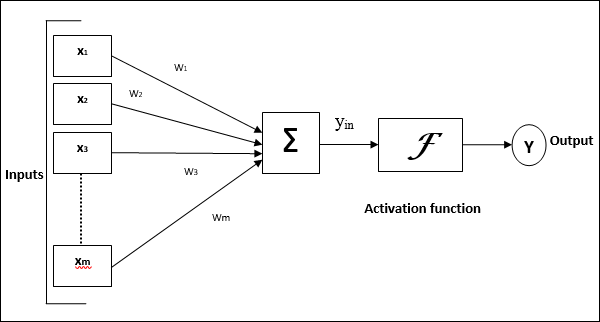

Yapay Sinir Ağı Modeli

Aşağıdaki diyagram, YSA'nın genel modelini ve ardından işlenmesini temsil etmektedir.

Yapay sinir ağının yukarıdaki genel modeli için, net girdi şu şekilde hesaplanabilir -

$$ y_ {in} \: = \: x_ {1} .w_ {1} \: + \: x_ {2} .w_ {2} \: + \: x_ {3} .w_ {3} \: \ dotso \: x_ {m} .w_ {m} $$

yani, Net girdi $ y_ {in} \: = \: \ sum_i ^ m \: x_ {i} .w_ {i} $

Çıktı, etkinleştirme işlevi net girdinin üzerine uygulanarak hesaplanabilir.

$$ Y \: = \: F (y_ {inç}) $$

Çıktı = işlev (hesaplanan net girdi)