TensorFlow - Optymalizacja zejścia gradientowego

Optymalizacja zstępowania gradientu jest uważana za ważną koncepcję w nauce o danych.

Rozważ kroki przedstawione poniżej, aby zrozumieć implementację optymalizacji zejścia gradientowego -

Krok 1

Dołącz niezbędne moduły i deklarację zmiennych x i y, za pomocą których zdefiniujemy optymalizację zstępowania gradientu.

import tensorflow as tf

x = tf.Variable(2, name = 'x', dtype = tf.float32)

log_x = tf.log(x)

log_x_squared = tf.square(log_x)

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(log_x_squared)Krok 2

Zainicjuj niezbędne zmienne i wywołaj optymalizatory w celu zdefiniowania i wywołania ich za pomocą odpowiedniej funkcji.

init = tf.initialize_all_variables()

def optimize():

with tf.Session() as session:

session.run(init)

print("starting at", "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

for step in range(10):

session.run(train)

print("step", step, "x:", session.run(x), "log(x)^2:", session.run(log_x_squared))

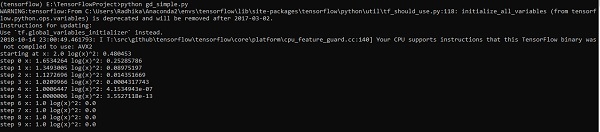

optimize()Powyższa linia kodu generuje dane wyjściowe, jak pokazano na poniższym zrzucie ekranu -

Widzimy, że niezbędne epoki i iteracje są obliczane zgodnie z danymi wyjściowymi.