Cos'è una NPU e perché la Big Tech è improvvisamente ossessionata?

C'è una CPU. C'è una GPU . Nell’ultimo anno, ogni azienda tecnologica ha parlato di “NPU”. Se non conoscevi i primi due, probabilmente sei sconcertato riguardo al terzo e al motivo per cui ogni settore tecnologico esalta i vantaggi di un'unità di elaborazione neurale. Come avrai intuito, tutto è dovuto al ciclo di hype in corso attorno all'intelligenza artificiale. Eppure, le aziende tecnologiche sono state piuttosto pessime nello spiegare cosa fanno queste NPU o perché dovresti preoccupartene.

Contenuto relativo

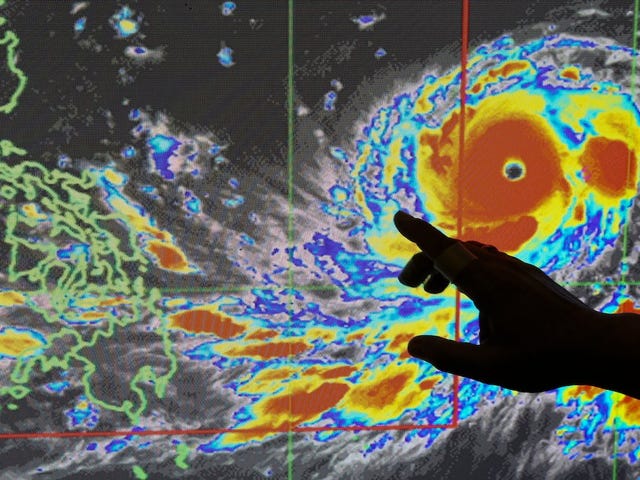

Tutti vogliono una fetta della torta dell'intelligenza artificiale. Google ha parlato di "AI" più di 120 volte durante la conferenza degli sviluppatori I/O di questo mese , dove le possibilità delle nuove app e assistenti AI hanno praticamente estasiato i suoi host. Durante la sua recente conferenza Build, Microsoft si è concentrata sui suoi nuovi PC Copilot+ basati su ARM che utilizzano Qualcomm Snapdragon X Elite e X Plus. Entrambe le CPU offriranno comunque una NPU con 45 TOPS. Che cosa significa? Bene, i nuovi PC dovrebbero essere in grado di supportare l'intelligenza artificiale sul dispositivo. Tuttavia, a pensarci bene, è esattamente ciò che Microsoft e Intel hanno promesso alla fine dell'anno scorso con il cosiddetto " PC AI ".

Contenuto relativo

- Spento

- Inglese

Se quest'anno hai acquistato un nuovo laptop con un chip Intel Core Ultra con la promessa dell'intelligenza artificiale integrata sul dispositivo, probabilmente non sarai molto contento di essere lasciato indietro. Microsoft ha detto a Gizmodo che solo i PC Copilot+ avranno accesso a funzionalità basate sull'intelligenza artificiale come Recall "grazie ai chip che li gestiscono".

Tuttavia, ci sono state alcune controversie quando il noto leaker Albacore ha affermato di poter eseguire Recall su un altro PC basato su ARM64 senza fare affidamento sulla NPU. I nuovi laptop non sono ancora disponibili, ma dovremo aspettare e vedere quanta pressione le nuove funzionalità di intelligenza artificiale esercitano sui processori neurali.

Ma se sei veramente curioso di sapere cosa sta succedendo con le NPU e perché tutti, da Apple a Intel alle piccole startup di PC, ne parlano, abbiamo inventato una spiegazione per tenerti aggiornato.

Spiegare NPU e 'TOPS'

Quindi, per prima cosa, dovremmo offrire alle persone in background un rapido riepilogo delle capacità di elaborazione del normale PC. La CPU, o “unità di elaborazione centrale”, è, essenzialmente, il “cervello” del computer che elabora la maggior parte delle attività dell'utente. La GPU, o “unità di elaborazione grafica”, è più specializzata per la gestione di attività che richiedono grandi quantità di dati, come il rendering di un oggetto 3D o la riproduzione di un videogioco. Le GPU possono essere un'unità discreta all'interno del PC oppure possono essere integrate nella CPU stessa.

In questo modo, la NPU è più vicina alla GPU in termini di natura specializzata, ma non troverete un processore neurale separato al di fuori dell'unità centrale o di elaborazione grafica, almeno per ora. È un tipo di processore progettato per gestire i calcoli matematici specifici degli algoritmi di apprendimento automatico. Queste attività vengono elaborate "in parallelo", il che significa che suddividerà le richieste in attività più piccole e quindi le elaborerà simultaneamente. È specificamente progettato per gestire le intense richieste delle reti neurali senza sfruttare nessuno dei processori degli altri sistemi.

Lo standard per giudicare la velocità della NPU è in TOPS, o “trilioni di operazioni al secondo”. Attualmente, è l'unico modo in cui le grandi aziende tecnologiche confrontano tra loro le loro capacità di elaborazione neurale. È anche un modo incredibilmente riduttivo per confrontare le velocità di elaborazione. CPU e GPU offrono molti punti di confronto diversi, dal numero e dal tipo di core alle velocità di clock generali o ai teraflop, e anche questo non scalfisce la superficie delle complicazioni legate all'architettura dei chip. Qualcomm spiega che TOPS è solo un'equazione matematica veloce e sporca che combina la velocità e la precisione dei processori neurali.

Forse un giorno esamineremo le NPU con la stessa granularità delle CPU o delle GPU, ma ciò potrebbe avvenire solo dopo aver superato l'attuale ciclo di hype dell'IA. E anche in questo caso, nessuna di queste descrizioni dei processori è scolpita nella pietra. C'è anche l'idea delle GPNPU, che sono fondamentalmente un piatto combinato di funzionalità GPU e NPU. Ben presto, dovremo suddividere le capacità dei PC più piccoli dotati di intelligenza artificiale con quelli più grandi in grado di gestire centinaia o addirittura migliaia di TOPS.

Le NPU esistono da diversi anni sia su telefoni che su PC

Anche i telefoni utilizzavano le NPU molto prima che la maggior parte delle persone o delle aziende se ne preoccupassero. Google ha parlato di NPU e funzionalità AI già dal Pixel 2 . Huawei e Asus, incentrati sulla Cina, hanno debuttato con le NPU su telefoni come Mate 10 del 2017 e Zenphone 5 del 2018 . All'epoca entrambe le aziende tentarono di spingere le funzionalità di intelligenza artificiale su entrambi i dispositivi, sebbene i clienti e i revisori fossero molto più scettici riguardo alle loro capacità rispetto a oggi.

In effetti, le NPU di oggi sono molto più potenti di quanto lo fossero sei o otto anni fa, ma se non avessi prestato attenzione, la capacità neurale della maggior parte di questi dispositivi ti sarebbe sfuggita.

I chip per computer erano già dotati di processori neurali da anni prima del 2023. Ad esempio, le CPU della serie M di Apple, i chip proprietari basati su ARC dell'azienda, supportavano già capacità neurali nel 2020. Il chip M1 aveva 11 TOPS, mentre M2 e M3 ne avevano 15,8. e 19 TOPS, rispettivamente. È solo con il chip M4 all'interno del nuovo iPad Pro 2024 che Apple ha deciso di poter vantare la velocità di 38 TOPS del suo ultimo motore neurale. E quali applicazioni AI di iPad Pro sfruttano davvero questa nuova funzionalità? Non molti, a dire il vero. Forse ne vedremo di più tra qualche settimana al WWDC 2024 , ma dovremo aspettare e vedere .

L’attuale ossessione per le NPU è in parte hardware e in parte pubblicità

L'idea alla base della NPU è che dovrebbe essere in grado di alleggerire l'onere di eseguire l'intelligenza artificiale sul dispositivo dalla CPU o dalla GPU, consentendo agli utenti di eseguire programmi di intelligenza artificiale, siano essi generatori di arte AI o chatbot, senza rallentare i loro PC. Il problema è che stiamo tutti ancora cercando quell'unico vero programma di intelligenza artificiale in grado di utilizzare le maggiori capacità dell'intelligenza artificiale.

Gizmodo ha avuto conversazioni con i principali produttori di chip nell'ultimo anno e l'unica cosa che continuiamo a sentire è che i produttori di hardware ritengono che, per una volta, hanno superato la domanda di software. Per molto tempo è stato il contrario. I produttori di software spingerebbero i confini di ciò che è disponibile sull'hardware di fascia consumer, costringendo i produttori di chip a recuperare terreno.

Ma dal 2023 abbiamo visto solo alcune applicazioni AI marginali in grado di funzionare sul dispositivo. La maggior parte delle demo delle funzionalità AI dei chip Qualcomm o Intel di solito implica l'esecuzione della funzione di sfocatura dello sfondo Zoom. Ultimamente, abbiamo visto aziende confrontare le proprie NPU con il modello di generatore musicale AI Riffusion in applicazioni esistenti come Audacity o con sottotitoli live su OBS Studio. Certo, puoi trovare alcune app che eseguono chatbot in grado di funzionare sul dispositivo, ma un LLM meno capace e meno sfumato non sembra l'app killer gigante che farà correre tutti ad acquistare l'ultimo nuovo smartphone o "PC AI". "

Ci siamo invece limitati ad applicazioni relativamente semplici con Gemini Nano sui telefoni Pixel , come riepiloghi testuali e audio . La versione più piccola della sua intelligenza artificiale di Google arriverà su Pixel 8 e Pixel 8a . Le funzionalità AI di Samsung che una volta erano esclusive del Galaxy S24 sono già arrivate ai telefoni più vecchi e dovrebbero presto arrivare anche ai dispositivi indossabili dell'azienda . Non abbiamo confrontato la velocità di queste funzionalità di intelligenza artificiale sui dispositivi più vecchi, ma indica come i dispositivi più vecchi già nel 2021 avessero già molta capacità di elaborazione neurale.

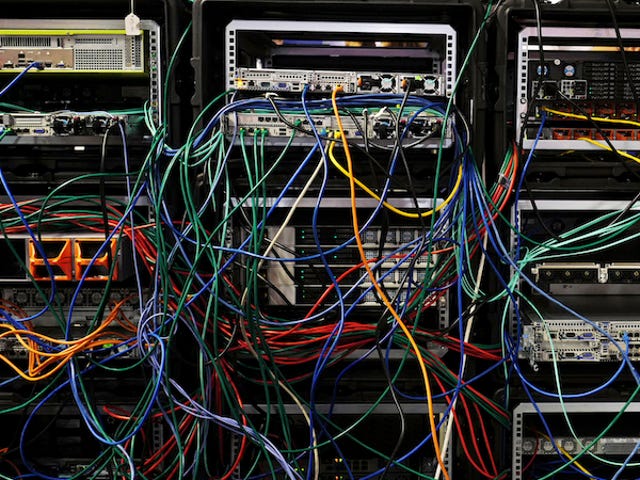

L’intelligenza artificiale on-device è ancora ostacolata dalla mancanza di potenza di elaborazione per i prodotti finali di consumo. Microsoft, OpenAi e Google devono gestire importanti data center dotati di centinaia di GPU AI avanzate di Nvidia , come l'H100 (Microsoft e altri stanno lavorando sui propri chip AI ), per elaborare alcuni dei LLM o chatbot più avanzati con modelli come Gemini Advanced o GPT 4o . Questo non è economico in termini di denaro o di risorse come energia e acqua , ma è per questo che gran parte dei consumatori di IA più avanzati possono pagare perché funzioni nel cloud. Avere l’intelligenza artificiale in esecuzione sul dispositivo avvantaggia gli utenti e l’ambiente. Se le aziende pensano che i consumatori richiedano i modelli di intelligenza artificiale più recenti e migliori, il software continuerà a superare ciò che è possibile su un dispositivo di consumo.