साहचर्य स्मृति को लागू करना

शाशता सौम्या और हरवीर सिंह द्वारा लिखित

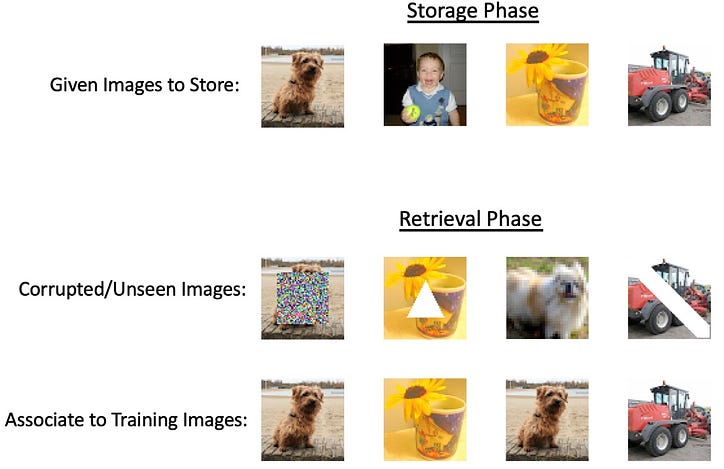

बड़े तंत्रिका नेटवर्क के आगमन और लगातार बढ़ती तकनीकी प्रगति के साथ जो वर्तमान विधियों को उनकी पूर्ण सीमा तक धकेलती है, फोकस एक कैच-ऑल टूल बना रहा है जिसका उद्देश्य सब कुछ करना है। हालाँकि, अधिकांश कार्यों को अविश्वसनीय रूप से गहन गहरे नेटवर्क की आवश्यकता नहीं होगी, लेकिन फिर भी बुनियादी गणितीय मॉडल की तुलना में कुछ अधिक बहुमुखी होगा। एक संभावित कार्य जिसे गहरे तंत्रिका जाल की तीव्रता की आवश्यकता नहीं होगी, वह होगा सूचना भंडारण और पुनर्प्राप्ति जिसे साहचर्य यादें कहा जाता है। यहाँ विचार यह है कि कुछ इनपुट दिए जाने पर हम एक संबंधित आउटपुट को एक सिस्टम से पुनः प्राप्त करने में सक्षम होना चाहते हैं जो उन दोनों को एक साथ जोड़ता है और इसे "मेमोरी" में रखता है। साहचर्य स्मृति नाम हमारे दिमाग की एक स्मृति भंडारण प्रणाली होने की मनोवैज्ञानिक अवधारणा से उपजा है जो अवधारणाओं को एक साथ जोड़ने में सक्षम है। एक प्रकार की साहचर्य स्मृति स्व-सहयोगी स्मृति है जहां हम इनपुट के रूप में अपने वांछित आउटपुट का आंशिक प्रतिनिधित्व करते हैं, यह या तो अतिरिक्त शोर के साथ आउटपुट हो सकता है या आउटपुट के कुछ हिस्सों को नकाबपोश कर सकता है। कार्रवाई में इस प्रकार की स्मृति का एक उदाहरण एक रिश्तेदार की आंशिक छवि को देखना होगा और आपका मस्तिष्क मानसिक रूप से शेष छवि को स्वचालित रूप से भरने में सक्षम होगा। एक अन्य प्रकार हेटेरोएसोसिएटिव मेमोरी है जहां आउटपुट दिए गए इनपुट की विभिन्न श्रेणियों के हो सकते हैं लेकिन मॉडल उन्हें एक साथ जोड़ना याद रखता है। "कुत्ते" शब्द को सुनने की कल्पना करें, आपका मस्तिष्क इसे "बिल्ली" या "पट्टा" [1] जैसी अन्य अवधारणाओं के साथ स्वचालित रूप से जोड़ने में सक्षम है। कार्रवाई में इस प्रकार की स्मृति का एक उदाहरण एक रिश्तेदार की आंशिक छवि को देखना होगा और आपका मस्तिष्क मानसिक रूप से शेष छवि को स्वचालित रूप से भरने में सक्षम होगा। एक अन्य प्रकार हेटेरोएसोसिएटिव मेमोरी है जहां आउटपुट दिए गए इनपुट की विभिन्न श्रेणियों के हो सकते हैं लेकिन मॉडल उन्हें एक साथ जोड़ना याद रखता है। "कुत्ते" शब्द को सुनने की कल्पना करें, आपका मस्तिष्क इसे "बिल्ली" या "पट्टा" [1] जैसी अन्य अवधारणाओं के साथ स्वचालित रूप से जोड़ने में सक्षम है। कार्रवाई में इस प्रकार की स्मृति का एक उदाहरण एक रिश्तेदार की आंशिक छवि को देखना होगा और आपका मस्तिष्क मानसिक रूप से शेष छवि को स्वचालित रूप से भरने में सक्षम होगा। एक अन्य प्रकार हेटेरोएसोसिएटिव मेमोरी है जहां आउटपुट दिए गए इनपुट की विभिन्न श्रेणियों के हो सकते हैं लेकिन मॉडल उन्हें एक साथ जोड़ना याद रखता है। "कुत्ते" शब्द को सुनने की कल्पना करें, आपका मस्तिष्क इसे "बिल्ली" या "पट्टा" [1] जैसी अन्य अवधारणाओं के साथ स्वचालित रूप से जोड़ने में सक्षम है।

एएम (एसोसिएटिव मेमोरी) सिस्टम का एक समृद्ध इतिहास है, लेकिन प्रमुख अनुसंधान मील के पत्थर हैं जो तकनीकी प्रगति का अवलोकन कर सकते हैं:

- विलशॉ नेट (विलशॉ एट अल, 1969)

- हॉपफील्ड नेटवर्क (हॉपफील्ड, 1982)

होलोग्राम के "मेमोरी-लाइक" गुणों से प्रेरित होकर, 1969 में डीजे विलशॉ ने कोरेलोग्राफ, या कोरेलोग्राम, और सहयोगी स्मृति के लिए एक मात्रात्मक दृष्टिकोण प्रस्तावित किया।

ऊपर दिया गया आंकड़ा C पर एक नया पैटर्न बनाने के लिए पैटर्न A और B के कनवल्शन को प्रदर्शित करता है, विशेष रूप से A और B में पिनहोल होते हैं जिससे एक प्रकाश स्रोत (A के पीछे) C पर एक पैटर्न बनाने के लिए गुजरता है जिसमें दोनों पैटर्न के बारे में जानकारी होती है। पिनहोल। इससे, नीचे चित्र 2 देखें, C पर अनुमानित पैटर्न से पिन होल बनाना और C के पीछे और B के माध्यम से उत्सर्जित होने वाले प्रकाश को पास करना ठीक उसी पैटर्न को उत्पन्न करता है जहाँ A के पिनहोल स्थित हैं।

कोरेलोग्राफ के निर्माण के दौरान, विलशॉ ने देखा कि यदि ए और बी दोनों में एन पिनहोल होते हैं तो सी पर पैटर्न का आकार N² होगा। इसने साहचर्य जाल के प्रस्ताव का नेतृत्व किया, एन समानांतर रेखाओं (ए का प्रतिनिधित्व) और एन समानांतर रेखाओं (बी का प्रतिनिधित्व) का एक प्रतिच्छेदन।

नेट का निर्माण इस प्रकार होता है कि N² स्थान में प्रत्येक अर्धवृत्त चालू होता है यदि बायाँ इनपुट और दायाँ इनपुट दोनों एक दूसरे के साथ उनके जुड़ाव का प्रतिनिधित्व करते हैं। फिर आप बाईं ओर से मंडलियों का अनुसरण करके बी से पैटर्न ए को पुनः प्राप्त कर सकते हैं और देख सकते हैं कि ऊपर से कौन से मंडलियों से संबंधित हैं, यह देखकर कि कौन से एन² बिंदु चालू हैं। यह देखना स्पष्ट है कि यह केवल एक जोड़ी संघ के साथ आसानी से काम करेगा लेकिन एक ही नेट में कई पैटर्न सीखना भी संभव है। विलशॉ दिखाता है कि नेटवर्क की सैद्धांतिक अधिकतम दक्षता तब होती है जब N² बिंदुओं का 50% चालू होता है, इससे "नकली हिट" की संभावना कम हो जाती है - A में एक बिंदु का सुझाव देना जो मूल रूप से B पैटर्न [2] से जुड़ा नहीं था ]।

हॉपफील्ड नेटवर्क

स्वाभाविक रूप से साहचर्य नेटवर्क का अनुसरण करते हुए, आधुनिक एएम डिजाइन को प्रेरित करने वाला प्रमुख नवाचार 1982 में हुआ जहां जॉन हॉपफील्ड, जिसे अक्सर तंत्रिका नेटवर्क के गॉडफादर के रूप में संदर्भित किया जाता है, ने अपने हॉपफील्ड नेटवर्क का प्रस्ताव रखा। नेटवर्क एक आवर्तक है जो प्रत्येक न्यूरॉन के साथ एक द्विआधारी स्थिति (0 या 1) में पूरी तरह से जुड़ा हुआ है और इनपुट मूल्य और वांछित आउटपुट मूल्य के बीच दिए गए वजन को वजन मैट्रिक्स में दर्शाया गया है।

यदि Tij संबंधित भार मैट्रिक्स है तो संघ द्वारा प्राप्त किया जाता है:

जहां यू एक कटऑफ राशि में सटीकता में सुधार के लिए चतुराई से चुना गया।

एकाधिक एसोसिएशन राज्यों को संग्रहीत करने के लिए, निम्न एल्गोरिथम दिया गया है:

हम प्रतिबंध लगाते हैं कि i = j के लिए, वजन T में 0 है। यह छद्म ऑर्थोगोनलिटी की ओर जाता है:

इससे पता चलता है कि यदि वीआई 1 है, तो जे के लिए अनुमानित मूल्य सकारात्मक है और यदि यह 0 है तो नकारात्मक है। यह पिछले एसोसिएशन नियम का पालन करता है जहां यू 0 है।

यह लर्निंग एल्गोरिथम अनिवार्य रूप से प्रत्येक पैटर्न के लिए स्थिर अवस्थाओं का औसत निकालता है लेकिन यह इस बात पर जोर देता है कि किसी दिए गए नेटवर्क को कितने पैटर्न याद हो सकते हैं। ईज़िंग मॉडल और ऊर्जा न्यूनीकरण से प्रेरित होकर, हॉपफील्ड ने इस अद्यतन तंत्र को ऊर्जा न्यूनीकरण के रूप में व्याख्या करने का प्रस्ताव दिया है। एन नोड आवर्तक नेटवर्क के लिए, सभी नोड एक दूसरे से जुड़े हुए हैं, हम एक समय में एक यादृच्छिक नोड लेते हैं और उस नोड को अपडेट करने के लिए वेट मैट्रिक्स का उपयोग करते हैं।

जहाँ s नोड संख्या है और कोष्ठक के अंदर का मान टाइमस्टेप है।

स्थिर बिंदुओं का अध्ययन करने में, अद्यतन एल्गोरिथ्म को इस ऊर्जा नियम द्वारा परिभाषित किया गया है:

इससे पता चलता है कि Vi में कोई भी परिवर्तन नेटवर्क की ऊर्जा को कम करता है जब तक कि Vi (+ या -) में परिवर्तन मैट्रिक्स गुणन से आउटपुट के चिह्न से मेल खाता है।

दिए गए ऊर्जा नियम और सीमा का पालन करते हुए नोड्स को अतुल्यकालिक और बेतरतीब ढंग से अपडेट किया जाता है। एक स्थिर ऊर्जा स्थिति तक पहुँचने की गारंटी है क्योंकि अद्यतन नियम केवल एक न्यूरॉन को बदलता है यदि यह हर बार चरण में ऊर्जा को कम करता है। यह निर्धारित करते समय कि कितने स्थिर राज्य मौजूद हो सकते हैं, यह दिखाया गया था कि मॉडल में N न्यूरॉन्स के लिए लगभग .15N अवस्थाएँ मौजूद हैं, एक सख्ती से o(N) स्केलिंग [3]। यह नोट करना भी महत्वपूर्ण है कि इस प्रकार के नेटवर्क की संरचना ऑटोएसोसिएटिव कार्यों में सफल होने के लिए अनुकूल है, लेकिन "वेक्टर-मैट्रिक्स-वेक्टर" एनकोडिंग जैसी विविधताएं हैं जो हेटेरोएसोसिएटिव मेमोरी को भी लागू कर सकती हैं [4]।

जैविक सिद्धांत

एक महत्वपूर्ण विचार जो ऊपर उल्लिखित सभी मॉडलों को संचालित करता है, एक कनेक्शन को बढ़ावा दे रहा है यदि एक न्यूरॉन मिलान किए जा रहे पैटर्न में एक से मेल खाता है। सीखने की इस शैली को "हेब्बियन लर्निंग" के रूप में जाना जाता है जो दो न्यूरॉन्स एक साथ आग लगने पर सिनैप्स में एक संबंध को बढ़ावा देता है। यद्यपि मस्तिष्क में स्मृति गठन अभी भी एक अज्ञात घटना है, यह प्रयोगशाला में दिखाया गया है कि "आग एक साथ तार एक साथ" का यह विचार जैविक रूप से सटीक है [5]।

सिलिको में साहचर्य स्मृति को लागू करना

साहचर्य स्मृति एक प्रकार की स्मृति है जो डेटा के विभिन्न टुकड़ों के बीच संबंधों या संघों के आधार पर सूचना के भंडारण और पुनर्प्राप्ति की अनुमति देती है। ऐसी प्रणाली के लिए कम्प्यूटेशनल मॉडल विकसित करना तंत्रिका विज्ञान और कृत्रिम बुद्धि के चौराहे पर एक अच्छी तरह से स्थापित समस्या है। हॉपफील्ड नेटवर्क जैसे अच्छी तरह से अध्ययन किए गए तरीके केवल बाइनरी पैटर्न को स्टोर कर सकते हैं; हालाँकि, जटिल डेटा (जैसे चित्र और पाठ) को समस्या को हल करने के लिए जटिल प्रणालियों की आवश्यकता होती है।

सहयोगी स्मृति के लिए ऊर्जा आधारित विधियां अच्छे कम्प्यूटेशनल मॉडल हैं?

लगभग सभी ऊर्जा-आधारित साहचर्य स्मृति मॉडल एक ऊर्जा कार्य के स्थानीय मिनीमा में पैटर्न संग्रहीत करते हैं। इन मॉडलों के पीछे मुख्य विचार एक ऊर्जा परिदृश्य को परिभाषित करना है, जहां संग्रहीत पैटर्न कम ऊर्जा वाले स्थिर राज्यों के अनुरूप होते हैं। ऊर्जा समारोह को कई स्थानीय मिनीमाओं के लिए डिज़ाइन किया गया है, प्रत्येक संग्रहीत पैटर्न का प्रतिनिधित्व करता है। जब सिस्टम एक इनपुट प्राप्त करता है, तो यह ऊर्जा फ़ंक्शन को कम करने के लिए अपनी स्थिति को पुनरावृत्त रूप से अपडेट करता है, अंततः निकटतम संग्रहीत पैटर्न पर परिवर्तित होता है, जो कि इनपुट के निकटतम स्थानीय न्यूनतम है। कुछ ऊर्जा आधारित मॉडल हैं -

हॉपफील्ड नेटवर्क [2]: हॉपफील्ड नेटवर्क में ऊर्जा कार्य को नेटवर्क की स्थिति के द्विघात कार्य के रूप में परिभाषित किया गया है। प्रत्येक संग्रहीत पैटर्न इस ऊर्जा समारोह के स्थानीय न्यूनतम से मेल खाता है। नेटवर्क डायनेमिक्स यह सुनिश्चित करता है कि सिस्टम संबंधित पैटर्न को प्रभावी ढंग से पुनर्प्राप्त करते हुए इनमें से किसी एक स्थानीय मिनिमा में परिवर्तित हो जाएगा।

बोल्ट्जमैन मशीनें [6]: बोल्ट्जमैन मशीनों में, ऊर्जा कार्य को नोड्स की स्थिति और उनके बीच के कनेक्शन के भार के संदर्भ में परिभाषित किया गया है। सीखने की प्रक्रिया स्थानीय मिनिमा के साथ एक ऊर्जा परिदृश्य बनाने के लिए वजन को समायोजित करती है जो संग्रहीत पैटर्न के अनुरूप होती है। सिस्टम तब ऊर्जा परिदृश्य का पता लगाने के लिए स्टोचैस्टिक गतिशीलता का उपयोग करता है और संबंधित पैटर्न को पुनर्प्राप्त करते हुए स्थानीय न्यूनतम में व्यवस्थित होता है।

मीन-फील्ड थ्योरी-बेस्ड एप्रोच [7]: ये एप्रोच पैटर्न को एक एनर्जी फंक्शन के लोकल मिनीमा में भी स्टोर करते हैं। माध्य-क्षेत्र सिद्धांत के साथ एक जटिल प्रणाली की गतिशीलता का अनुमान लगाकर, सीखने और पुनर्प्राप्ति प्रक्रियाओं का विश्लेषण किया जा सकता है और अधिक कुशलता से अनुकूलित किया जा सकता है।

ये पारंपरिक मॉडल छोटे पैमाने के छवि डेटा को संभाल सकते हैं लेकिन क्षमता, मापनीयता और कम्प्यूटेशनल जटिलता में उनकी सीमाओं के कारण बड़ी और अधिक जटिल छवियों के साथ संघर्ष कर सकते हैं।

क्या प्रक्षेप अकेले साहचर्य स्मृति को लागू कर सकता है?

याद रखने के लिए प्रशिक्षण डेटा को पुनः प्राप्त करने के लिए मॉडल की आवश्यकता होती है, जबकि प्रक्षेप प्रशिक्षण डेटा को पूरी तरह से फिट करने की क्षमता है। इसलिए, प्रक्षेप अकेले साहचर्य स्मृति को लागू नहीं कर सकता। इंटरपोलेशन ज्ञात डेटा बिंदुओं के बीच मूल्यों का अनुमान लगाने के लिए एक उपयोगी तकनीक हो सकती है, लेकिन यह एक पूर्ण साहचर्य स्मृति प्रणाली को लागू करने के लिए पर्याप्त नहीं है। साहचर्य मेमोरी मॉडल को उनके संघों के आधार पर पैटर्न को संग्रहीत करने और पुनः प्राप्त करने के लिए डिज़ाइन किया गया है, अक्सर किसी दिए गए इनपुट के निकटतम संग्रहीत पैटर्न की पहचान करके, भले ही इनपुट शोर या अधूरा हो।

जबकि प्रक्षेप का उपयोग ज्ञात डेटा बिंदुओं के बीच मूल्यों का अनुमान लगाने के लिए किया जा सकता है, यह मूल रूप से शोर, अधूरी जानकारी या पैटर्न पहचान से निपटने के लिए डिज़ाइन नहीं किया गया है। इंटरपोलेशन के तरीके, जैसे रैखिक या बहुपद इंटरपोलेशन, इस धारणा पर भरोसा करते हैं कि अंतर्निहित फ़ंक्शन सुचारू है या इसका एक विशिष्ट रूप है, जो कई वास्तविक दुनिया की साहचर्य स्मृति समस्याओं के लिए सही नहीं हो सकता है।

साहचर्य स्मृति के लिए एक वैकल्पिक विधि — overparameterization?

ओवरपैरामीटराइजेशन एक ऐसी स्थिति को संदर्भित करता है जहां प्रशिक्षण डेटासेट के आकार की तुलना में मशीन लर्निंग मॉडल में बड़ी संख्या में पैरामीटर (वजन और पूर्वाग्रह) होते हैं। दूसरे शब्दों में, डेटा में अंतर्निहित पैटर्न को समझाने या कैप्चर करने के लिए मॉडल आवश्यकता से अधिक जटिल है। यह पहले देखा गया था कि अतिपरिमाकृत मॉडल डेटा को प्रक्षेपित कर सकते हैं; राधाकृष्णन एट अल द्वारा एक हालिया अध्ययन। 2020 [8] ने दिखाया कि प्रशिक्षण के उदाहरणों को याद करने और पुनः प्राप्त करने के लिए ओवरपैरामीटराइज़्ड ऑटोएन्कोडर का भी उपयोग किया जा सकता है। तंत्र उल्लेखनीय रूप से सरल है; - उदाहरण हो सकते हैं

केवल सीखे हुए मानचित्र को पुनरावृत्त करके पुनर्प्राप्त किया गया।

ऑटोएन्कोडर! इसके अलावा अतिव्याप्ति! यह क्या हैं?

एक ऑटोएन्कोडर एक प्रकार का कृत्रिम तंत्रिका नेटवर्क है जिसका उपयोग कुशल डेटा अभ्यावेदन के अप्रशिक्षित सीखने के लिए किया जाता है, जो अक्सर आयामीता में कमी, सुविधा सीखने या डेटा संपीड़न के उद्देश्य से होता है। इसमें दो मुख्य भाग होते हैं: एनकोडर और डिकोडर।

एक ऑटोएन्कोडर का प्रशिक्षण उद्देश्य इनपुट डेटा और पुनर्निर्मित डेटा के बीच पुनर्निर्माण त्रुटि को कम करना है, जो एन्कोडर और फिर डिकोडर के माध्यम से इनपुट पास करके उत्पन्न होता है।

सीधे शब्दों में कहें, एक overparameterized autoencoder बड़ी संख्या में मापदंडों के साथ एक autoencoder है। एडिट एट। अल। दिखाया गया है कि overparameterized autoencoders प्रशिक्षण उदाहरणों को निश्चित बिंदुओं या एक्ट्यूएटर्स के रूप में संग्रहीत करता है। हालाँकि, यह पहचान मानचित्र f (x) = x भी सीखता है

यह साहचर्य के लिए एक शंकु है क्योंकि इसकी एक पूर्व शर्त यह है कि उदाहरणों में व्युत्पन्न 1 से कम होना चाहिए। एडिट एट। अल। 2020इस आधार पर काम किया कि अतिपरिमाकृत ऑटोएन्कोडर्स साहचर्य स्मृति को लागू करने के लिए पर्याप्त शक्तिशाली हैं। उन्होंने अपने काम में दिखाया कि ओवरपैरामीटराइज्ड ऑटोएन्कोडर्स को "अट्रैक्टर-बेस्ड एसोसिएटिव मेमोरी" के रूप में इस्तेमाल किया जा सकता है। अट्रैक्टर-आधारित सिस्टम के पीछे मुख्य विचार यह है कि नेटवर्क को उस पैटर्न का अधूरा या शोर संस्करण दिए जाने पर संग्रहीत पैटर्न को पुनः प्राप्त करने में सक्षम होना चाहिए। इनपुट पैटर्न एक क्यू के रूप में कार्य करता है, और नेटवर्क डायनेमिक्स सिस्टम को निकटतम अट्रैक्टर की ओर निर्देशित करता है, प्रभावी रूप से शोर को "सफाई" करता है या लापता जानकारी को भरता है - सीधे शब्दों में कहें तो OPA सहयोगी मेमोरी को लागू कर सकता है। आकर्षण-आधारित साहचर्य स्मृति होने के लिए गणितीय शर्तें हैं -

- उदाहरण निश्चित बिंदु होने चाहिए।

- उदाहरणों में डेरिवेटिव 1 से कम होना चाहिए।

क्या सच में ऐसा होता है?

पेपर व्यापक अनुभवजन्य साक्ष्य प्रदान करता है कि आकर्षित करने वाले विभिन्न आर्किटेक्चर और अनुकूलन तकनीकों में ऑटोएन्कोडर में पाए जा सकते हैं। लेखकों ने छविनेट -64 डेटासेट से 500 छवियों को आकर्षित करने वाले के रूप में संग्रहीत करने में सक्षम एक अतिपरमाकृत ऑटोएन्कोडर का सफलतापूर्वक प्रदर्शन किया। उन्होंने पुष्टि की कि प्रत्येक उदाहरण के लिए जेकोबियन मैट्रिक्स के eigenvalues की जांच करके सभी 500 प्रशिक्षण छवियों को वास्तव में आकर्षित करने वालों के रूप में संग्रहीत किया गया था। अध्ययन ने उस दर का भी विश्लेषण किया जिस पर भ्रष्टाचार के विभिन्न रूपों के तहत प्रशिक्षण के उदाहरणों को पुनर्प्राप्त किया जा सकता है, जिससे एक प्रभावशाली उच्च वसूली दर का पता चलता है।

आगे के प्रयोगों से पता चला है कि MNIST डेटासेट से 2,000 छवियों और CIFAR10 डेटासेट से 1,000 श्वेत-श्याम छवियों के साथ प्रशिक्षित होने पर ऑटोएन्कोडर भी प्रशिक्षण उदाहरणों को आकर्षित करने वाले के रूप में संग्रहीत कर सकते हैं। हालांकि नकली अट्रैक्टर (प्रशिक्षण उदाहरणों के अलावा अन्य अट्रैक्टर) संभावित रूप से ओवरपैरामीटराइज्ड ऑटोएन्कोडर में मौजूद हो सकते हैं, लेकिन शोधकर्ता अपने इमेजनेट-64 उदाहरण में ऐसे किसी नकली अट्रैक्टर की पहचान करने में असमर्थ थे।

लेखकों ने आकर्षित करने वाली घटना का व्यापक विश्लेषण किया, विभिन्न सामान्य आर्किटेक्चर, अनुकूलन विधियों और प्रारंभिक योजनाओं की जांच की। इनमें कई प्रकार की गैर-रैखिकताएँ, अनुकूलन विधियाँ और आरंभीकरण योजनाएँ शामिल थीं। उनके निष्कर्षों से पता चला कि आकर्षित करने वाले हर परिदृश्य में उभरे जहां प्रशिक्षण 1,000,000 युगों के भीतर पर्याप्त रूप से कम नुकसान में परिवर्तित हो गया। गौरतलब है कि यह घटना पूरी तरह से जुड़े नेटवर्क तक ही सीमित नहीं थी, यह व्यापक रूप से उपयोग किए जाने वाले नेटवर्क आर्किटेक्चर, जैसे दृढ़ और आवर्तक नेटवर्क में भी देखी गई थी।

गौरतलब है कि यह घटना पूरी तरह से जुड़े नेटवर्क तक ही सीमित नहीं थी, जैसा कि व्यापक रूप से उपयोग किए जाने वाले नेटवर्क आर्किटेक्चर में भी देखा गया था, जैसे कि दृढ़ और आवर्तक नेटवर्क। 2डी आकर्षित करने वालों की कल्पना करने के लिए, उन्होंने छह प्रशिक्षण उदाहरणों को आकर्षित करने वालों के रूप में संग्रहीत करने के लिए एक ऑटोएन्कोडर को प्रशिक्षित किया और प्रशिक्षित ऑटोएन्कोडर मानचित्र को पुनरावृत्त करके 10,000 ग्रिड बिंदुओं से अभिसरण तक अपने आकर्षण के आधारों की कल्पना की। प्रयोग में सदिश क्षेत्र पुनरावृत्ति द्वारा दी गई गति की दिशा को इंगित करता है। प्रत्येक प्रशिक्षण उदाहरण और उसके अनुरूप आकर्षण का आधार अलग-अलग रंगों द्वारा दर्शाया जाता है। दिलचस्प बात यह है कि अध्ययन से पता चला है कि आकर्षण के घाटियों को अलग करने के लिए ऑटोएन्कोडर द्वारा सीखी गई मीट्रिक यूक्लिडियन दूरी नहीं है, जिसे वोरोनोई आरेख द्वारा इंगित किया जाएगा।

अनुक्रम एन्कोडिंग ऑटोएन्कोडिंग से बेहतर परिणाम दिखाता है।

Autoencoders से वस्तुनिष्ठ फ़ंक्शन को थोड़ा बदलने से साहचर्य यादों का कार्यान्वयन होता है। शोधकर्ताओं ने दिखाया कि एक छोटे से पर्याप्त और स्थिर सीमा के लिए हानि समारोह को कम करना प्रशिक्षण अनुक्रमों को नेटवर्क के सीमा चक्र (एक प्रकार का आकर्षण जो स्थिर, आवधिक व्यवहार प्रदर्शित करता है) के रूप में एन्कोड करता है।

अंत नोट

अंत में, साहचर्य स्मृति मानव अनुभूति का एक आकर्षक पहलू है जिसका अध्ययन विभिन्न संदर्भों में किया गया है, जिसमें जैविक प्रणाली, होपफील्ड नेटवर्क और अतिपरिमाकृत तंत्रिका नेटवर्क शामिल हैं। जीवित जीवों में साहचर्य स्मृति की हमारी समझ ने हॉपफील्ड नेटवर्क जैसे कम्प्यूटेशनल मॉडल के विकास को प्रेरित किया है, जिसने बदले में कृत्रिम बुद्धि और मशीन सीखने के क्षेत्र को उन्नत किया है।

अति-पैरामीटरीकृत तंत्रिका नेटवर्क में हाल के शोध ने आर्किटेक्चर और अनुकूलन तकनीकों की एक श्रृंखला में, साहचर्य स्मृति से संबंधित एक घटना, आकर्षण के उद्भव की खोज की है। यह रोमांचक विकास न केवल जैविक और कृत्रिम तंत्रिका तंत्र के बीच संबंध को मजबूत करता है, बल्कि स्मृति भंडारण और पुनर्प्राप्ति के लिए अधिक कुशल और मजबूत मॉडल तलाशने के नए अवसर भी खोलता है।

जैसा कि हम साहचर्य स्मृति के अंतर्निहित जटिल तंत्र को उजागर करना जारी रखते हैं, हमारे निष्कर्ष कृत्रिम बुद्धिमत्ता में और नवाचारों को बढ़ावा देंगे, उन्नत, जैविक रूप से प्रेरित मॉडल के लिए मार्ग प्रशस्त करेंगे जो मानव संज्ञानात्मक क्षमताओं का अनुकरण कर सकते हैं। यह चल रही खोज जीव विज्ञान और संगणना के बीच के जटिल संबंधों की हमारी समझ को बढ़ाने का वादा करती है, जो अंततः उन सफलताओं की ओर ले जाती है जो दोनों क्षेत्रों को लाभान्वित कर सकती हैं।

उनके मार्गदर्शन और उपयोगी चर्चा के लिए निर एन शवित का विशेष धन्यवाद। मशीन लर्निंग, स्प्रिंग 2023 में MIT क्लास 6.S978 — टिश्यू बनाम सिलिकॉन के हिस्से के रूप में बनाया गया।

संदर्भ

- स्मिथ, जे। (2022)। साहचर्य स्मृति क्या है? वेरीवेल माइंड।https://www.verywellmind.com/what-is-associative-memory-5198601

- विलशॉ, डीजे, बुनमैन, ओपी, और लॉन्गेट-हिगिंस, एचसी (1969)। गैर-होलोग्राफिक साहचर्य स्मृति। नेचर , 222 (5197), 960–962। यानेज़-मार्केज़, सी।, लोपेज़-यानेज़, आई।, एल्डेप-पेरेज़, एम।, कैमाचो-नीटो, ओ।, आर्गुलेस-क्रूज़, एजे, और विलुएंडास-रे, वाई। (2018)। अल्फा-बीटा साहचर्य यादों के लिए सैद्धांतिक नींव: 10 साल के व्युत्पन्न विस्तार, मॉडल और अनुप्रयोग। तंत्रिका प्रसंस्करण पत्र , 48 (2), 811-847।

- होपफील्ड, जेजे (1982)। आकस्मिक सामूहिक कम्प्यूटेशनल क्षमताओं के साथ तंत्रिका नेटवर्क और भौतिक प्रणालियां। राष्ट्रीय विज्ञान अकादमी की कार्यवाही , 79 (8), 2554-2558।

- कोस्को, बी (1988)। द्विदिश साहचर्य यादें। सिस्टम्स, मैन और साइबरनेटिक्स पर आईईईई लेनदेन, 18(1), 49-60।

- मैकक्लेलैंड, जेएल (2006)। आप हेब्बियन सीखने के साथ कितनी दूर जा सकते हैं, और यह आपको कब भटकाता है। मस्तिष्क और संज्ञानात्मक विकास में परिवर्तन की प्रक्रियाएं: ध्यान और प्रदर्शन xxi, 21, 33-69।

- एक्ले, डेविड एच., जेफ्री ई. हिंटन, और टेरेंस जे. सेजनोवस्की। "बोल्ट्ज़मैन मशीनों के लिए एक लर्निंग एल्गोरिथम।" संज्ञानात्मक विज्ञान 9.1 (1985): 147-169।

- बाराबासी, अल्बर्ट-लेस्ज़्लो, रेका अल्बर्ट और हॉवॉन्ग जियोंग। "स्केल-फ्री रैंडम नेटवर्क के लिए मीन-फील्ड थ्योरी।" फिजिका ए: सांख्यिकीय यांत्रिकी और इसके अनुप्रयोग 272.1-2 (1999): 173-187।

- राधाकृष्णन, आदित्यनारायणन, मिखाइल बेल्किन और कैरोलिन उहलर। "Overparameterized तंत्रिका नेटवर्क साहचर्य स्मृति को लागू करते हैं।" राष्ट्रीय विज्ञान अकादमी की कार्यवाही 117.44 (2020): 27162–27170

![क्या एक लिंक्ड सूची है, वैसे भी? [भाग 1]](https://post.nghiatu.com/assets/images/m/max/724/1*Xokk6XOjWyIGCBujkJsCzQ.jpeg)