Forscher sagen, dass Social-Media-Verbote wissenschaftlicher Fehlinformationen nicht hilfreich sind

Lassen Sie die Impfgegner, Klimaleugner und 5G-Verschwörungstheoretiker einfach ohne die ständige Bedrohung durch das Entfernen von Inhalten und Verbote leben, damit sie nicht zu noch radikaleren Knotenpunkten auf Nischenseiten und anderen obskuren Teilen des Internets fliehen, ist die Royal Society zu dem Schluss gekommen.

Die Royal Society ist die nationale Akademie der Wissenschaften des Vereinigten Königreichs. Am Mittwoch veröffentlichte sie einen Bericht über das sogenannte „Online-Informationsumfeld“, in dem einige Schlüsselannahmen hinter der Bewegung in Frage gestellt werden, Verschwörungstheoretiker von der Plattform zu drängen, die falsche Informationen zu Themen wie Klimawandel, 5G und dem Coronavirus verbreiten.

Auf der Grundlage von Literaturrecherchen, Workshops und Diskussionsrunden mit akademischen Experten und Faktenprüfungsgruppen sowie zweier Umfragen in Großbritannien gelangte die Royal Society zu mehreren Schlussfolgerungen. Die erste ist, dass Online-Fehlinformationen zwar weit verbreitet sind, ihr Einfluss jedoch übertrieben sein könnte , zumindest was das Vereinigte Königreich betrifft: „Die überwiegende Mehrheit der Befragten glaubt, dass die COVID-19-Impfstoffe sicher sind, dass menschliche Aktivitäten für den Klimawandel verantwortlich sind, und dass die 5G-Technologie nicht schädlich ist.“ Die zweite ist, dass die Auswirkungen sogenannter Echokammern ähnlich übertrieben sein könnten und es kaum Beweise gibt, die die Hypothese der „Filterblase“ stützen (im Grunde algorithmisch betriebene extremistische Kaninchenlöcher ). Die Forscher hoben auch hervor, dass viele Debatten darüber, was Fehlinformationen ausmacht, in Streitigkeiten mit der wissenschaftlichen Gemeinschaft verwurzelt sind und dass die Anti-Vax-Bewegung viel breiter ist als irgendeine Reihe von Überzeugungen oder Motivationen.

Eine der wichtigsten Erkenntnisse: Die Regierung und Social-Media-Unternehmen sollten sich nicht darauf verlassen, dass irreführende Inhalte „ständig entfernt“ werden, die keine „Lösung für wissenschaftliche Fehlinformationen im Internet“ sind. Es warnt auch davor, dass Verschwörungstheoretiker, wenn sie von Orten wie Facebook vertrieben werden, sich in Teile des Internets zurückziehen könnten, wo sie unerreichbar sind. Wichtig ist, dass der Bericht zwischen dem Entfernen wissenschaftlicher Fehlinformationen und anderen Inhalten wie Hassreden oder illegalen Medien unterscheidet, bei denen das Entfernen effektiver sein kann:

(Befürworter des Verbots von Neonazis und Hassgruppen sind daher vor den Schlussfolgerungen der Royal Society in diesem Bericht sicher.)

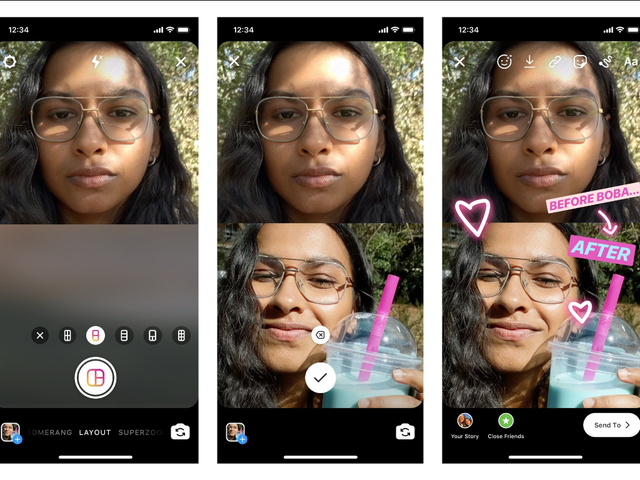

Anstelle der Entfernung plädieren die Forscher der Royal Society dafür, das zu entwickeln, was sie „kollektive Resilienz“ nennen. Die Zurückdrängung wissenschaftlicher Desinformation kann durch andere Taktiken effektiver sein, wie z. B. Demonetarisierung, Systeme zur Verhinderung der Verstärkung solcher Inhalte und Kennzeichnungen zur Überprüfung von Fakten. Der Bericht ermutigt die britische Regierung, sich weiterhin gegen wissenschaftliche Fehlinformationen zu wehren

sondern um gesellschaftsweite Schäden zu betonen, die sich aus Themen wie dem Klimawandel ergeben können, und nicht das potenzielle Risiko für Einzelpersonen, wenn sie den Köder schlucken. Andere Strategien, die die Royal Society vorschlägt, sind die Fortsetzung der Entwicklung unabhängiger, gut finanzierter Organisationen zur Überprüfung von Fakten; Bekämpfung von Fehlinformationen „über risikoreiche, reichweitenstarke Social-Media-Plattformen hinaus“; und Förderung von Transparenz und Zusammenarbeit zwischen Plattformen und Wissenschaftlern. Schließlich erwähnt der Bericht, dass die Regulierung von Empfehlungsalgorithmen wirksam sein kann .

„Das Eindämmen von Behauptungen außerhalb des Konsenses mag wünschenswert erscheinen, aber es kann den wissenschaftlichen Prozess behindern und wirklich böswillige Inhalte in den Untergrund drängen“, sagte Frank Kelly, Professor für Systemmathematik und Berichtsvorsitzender des Statistical Laboratory an der University of Cambridge, gegenüber Politico Europe .

„Die Wissenschaft steht am Rande des Irrtums, und die Natur der wissenschaftlichen Bemühungen an den Grenzen bedeutet, dass es immer Unsicherheit gibt“, sagte Kelly separat gegenüber Computer Weekly . „In den frühen Tagen der Pandemie wurde die Wissenschaft zu oft als absolut und irgendwie nicht vertrauenswürdig dargestellt, wenn sie sich selbst korrigiert, aber dieses Anstoßen und Testen der erhaltenen Weisheit ist ein wesentlicher Bestandteil des Fortschritts von Wissenschaft und Gesellschaft.“

„Unsere Umfrage hat gezeigt, dass Menschen komplexe Gründe haben, Fehlinformationen zu teilen, und wir werden dies nicht ändern, indem wir ihnen mehr Fakten geben“, sagte Gina Neff, Professorin für Technologie und Gesellschaft am Oxford Internet Institute, die zu dem Bericht beigetragen hat, gegenüber Computer Weekly. „... Wir brauchen neue Strategien, um sicherzustellen, dass qualitativ hochwertige Informationen in der Online-Aufmerksamkeitsökonomie wettbewerbsfähig sind. Das bedeutet, in lebenslange Programme zur Informationskompetenz, Technologien zur Verbesserung der Provenienz und Mechanismen für den Datenaustausch zwischen Plattformen und Forschern zu investieren.“

Die Idee, Verschwörungstheoretiker von Mainstream-Plattformen und tiefer ins Web zu vertreiben, mache sie nur stärker, wurde in einigen Fällen auch von Bullshit-Künstlern selbst verbreitet, um ihren Zugang zu lukrativen Zuschauern auf Facebook, Twitter und YouTube zu verteidigen . Oft haben sie sich geirrt. Alex Jones, Kingpin von InfoWars, behauptete zum Beispiel, dass die Welle von Verboten, die ihn auf praktisch allen großen Social-Media-Sites traf, den Verfolgungswahn seines Publikums nur anheizen würde. Stattdessen brach sein Web-Traffic ein , er verlor den Zugang zu wichtigen Einnahmequellen und er hat scheinbar einen Großteil seiner schwindenden Ressourcen ausgegeben, um eine vernichtende Reihe von Gerichtsverfahren wegen Verleumdung zu bekämpfen . Donald Trump stand vor einer ähnlichen Situation, zumindest was seine Fähigkeit anging, Verschwörungen über die Wahlen 2020 zu verbreiten.

Die Forschung hat gezeigt , dass De-Platforming zwar keine langfristige Lösung für Fehlinformationen und Hassreden ist, aber für die relativ kleinen, aber unverhältnismäßig einflussreichen Einzelpersonen und Gruppen, die sich am meisten für ihre Verbreitung einsetzen – wie die Handvoll Anti- Vaxxers , die für einen Großteil der Flut von falschen Impfstoffansprüchen auf den größten Social-Media-Websites verantwortlich sind. Einige der im Bericht der Royal Society befürworteten Lösungen sind durch Beweise untermauert, wie

z.

Der Bericht der Royal Society befasst sich nur kurz mit der Demonetarisierung und bezieht sich auf direkte Methoden wie das Entfernen der Fähigkeit von Promotoren von Fehlinformationen, Werbeeinnahmen zu sammeln. Aber es gibt viele Möglichkeiten

für diejenigen, die über Mainstream-Social-Media-Websites ein großes Publikum gewinnen, um außerhalb des Standorts Geld zu verdienen, wie z . Irreführende wissenschaftliche Behauptungen zuzulassen, obwohl sie demonstriert sind, beseitigt daher nicht den finanziellen Anreiz, sie überhaupt zu veröffentlichen.

Es ist jedoch wahr, dass Verbote von Mainstream-Sites eine große Anzahl von Gläubigen zu alternativen Plattformen getrieben haben, auf denen offener extreme Überzeugungen gedeihen, wie die Messaging-App Telegram . Bis zu einem gewissen Grad läuft der Streit darauf hinaus, ob diese Art von selbst auferlegter Online-Quarantäne vorzuziehen ist, diesen Webbenutzern Zugang zu Zuschauern auf großen Plattformen zu verschaffen, oder ob sie überhaupt funktioniert; Der Bericht warnt davor, dass diese Nischen-Veranstaltungsorte einer „schärferen Prüfung“ unterzogen werden müssen.

“

Die im Bericht der Royal Society zum Ausdruck gebrachte Angst scheint ähnlich zu sein, was mit Apps wie WhatsApp passiert ist, die größtenteils unmoderiert sind und in Ländern wie Indien und Brasilien zu einem Hauptvehikel für Hassreden und Verschwörungstheorien geworden sind .

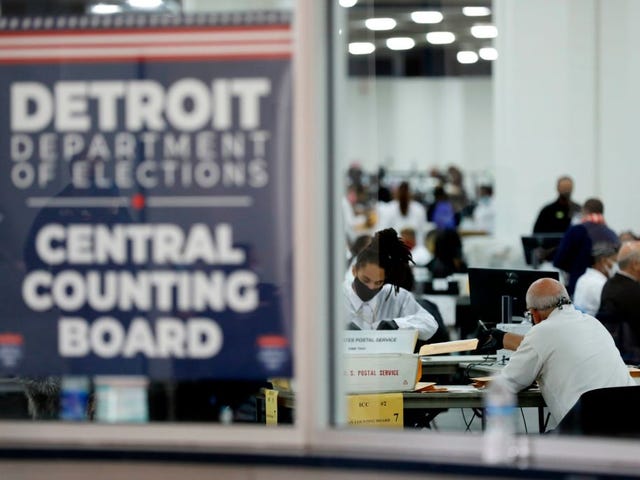

Der Kontext ist ebenfalls wichtig – die Ergebnisse des Berichts, insbesondere die mit Umfragen verbundenen, konzentrieren sich auf das Vereinigte Königreich und sind möglicherweise nicht universell anwendbar. Beispielsweise sind die Impfraten in Großbritannien viel höher als in den USA, und ein Mob von Verschwörungstheoretikern hat kürzlich nicht das Parlament gestürmt.

Wie Computer Weekly feststellte, kamen Forscher der Election Integrity Partnership zu ähnlichen Schlussfolgerungen wie der Bericht der Royal Society über die separate Ausgabe von Falschmeldungen über die Wahlen 2020 in den USA und stellten fest, dass eine „weit verbreitete Unterdrückung“ nicht notwendig war, um ihre Verbreitung zu verringern. Diese Forscher befürworteten jedoch auch strengere Sanktionen gegen Social-Media-Konten und Medienorganisationen, die „Wiederholungstäter“ sind, einschließlich Verboten.