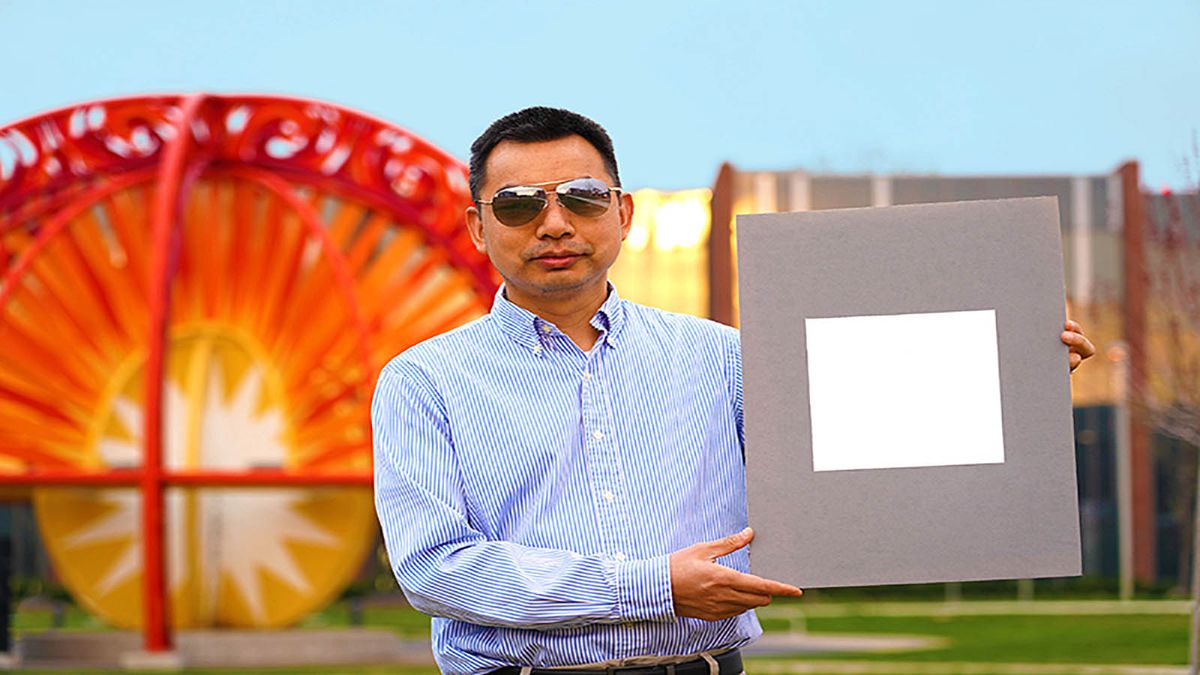

En 2022, una obra de arte generada por IA ganó el concurso de arte de la Feria Estatal de Colorado. El artista, Jason Allen, había utilizado Midjourney, un sistema de IA generativo entrenado en arte extraído de Internet , para crear la pieza. El proceso estuvo lejos de estar completamente automatizado: Allen pasó por unas 900 iteraciones durante 80 horas para crear y refinar su presentación.

Sin embargo, su uso de la IA para ganar el concurso de arte provocó una acalorada reacción en línea, con un usuario de Twitter que afirmó : "Estamos viendo cómo se desarrolla la muerte del arte ante nuestros ojos".

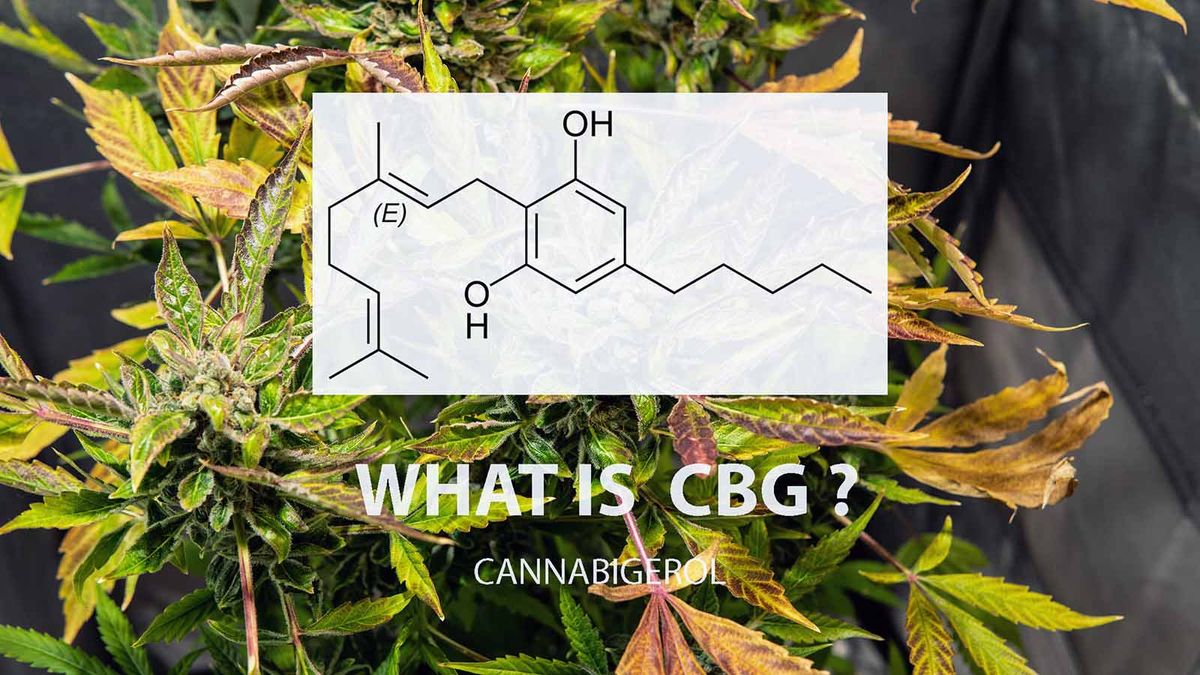

A medida que las herramientas de arte generativo de IA como Midjourney y Stable Diffusion se han convertido en el centro de atención, también lo han hecho las preguntas sobre la propiedad y la autoría.

La capacidad generativa de estas herramientas es el resultado de entrenarlas con decenas de obras de arte anteriores, a partir de las cuales la IA aprende a crear resultados artísticos.

¿Deberían ser compensados los artistas cuyo arte fue raspado para entrenar a los modelos? ¿Quién es el propietario de las imágenes que producen los sistemas de IA? ¿Es el proceso de ajuste fino de las indicaciones para la IA generativa una forma de expresión creativa auténtica ?

Por un lado, los tecnófilos se entusiasman con trabajos como el de Allen. Pero, por otro lado, muchos artistas en activo consideran que el uso de su arte para entrenar a la IA es una explotación .

Somos parte de un equipo de 14 expertos en todas las disciplinas que acaba de publicar un artículo sobre IA generativa en la revista Science. En él, exploramos cómo los avances en IA afectarán el trabajo creativo, la estética y los medios . Una de las preguntas clave que surgieron tiene que ver con las leyes de derechos de autor de EE. UU . y si pueden abordar adecuadamente los desafíos únicos de la IA generativa.

Las leyes de derechos de autor se crearon para promover las artes y el pensamiento creativo. Pero el auge de la IA generativa ha complicado las nociones existentes de autoría.

- La fotografía sirve como lente útil

- AI no puede poseer salidas

- ¿Infracción o uso justo?

- Propiedad confusa

La fotografía sirve como lente útil

La IA generativa puede parecer sin precedentes, pero la historia puede actuar como guía.

Tomemos el surgimiento de la fotografía en el siglo XIX . Antes de su invención, los artistas solo podían intentar retratar el mundo a través del dibujo, la pintura o la escultura. De repente, la realidad podía capturarse en un instante usando una cámara y productos químicos.

Al igual que con la IA generativa, muchos argumentaron que la fotografía carecía de mérito artístico. En 1884, la Corte Suprema de los EE. UU. intervino en el tema y descubrió que las cámaras servían como herramientas que un artista podía usar para dar forma visible a una idea; los "autores intelectuales" detrás de las cámaras, dictaminó el tribunal, deberían ser dueños de las fotografías que crean.

A partir de entonces, la fotografía evolucionó hacia su propia forma de arte e incluso provocó nuevos movimientos artísticos abstractos .

AI no puede poseer salidas

A diferencia de las cámaras inanimadas, la IA posee capacidades, como la capacidad de convertir instrucciones básicas en obras artísticas impresionantes, que la hacen propensa a la antropomorfización . Incluso el término "inteligencia artificial" alienta a las personas a pensar que estos sistemas tienen una intención similar a la humana o incluso autoconciencia.

Esto llevó a algunas personas a preguntarse si los sistemas de IA pueden ser "propietarios". Pero la Oficina de Derechos de Autor de EE.UU. ha declarado inequívocamente que sólo los seres humanos pueden tener derechos de autor .

Entonces, ¿quién puede reclamar la propiedad de las imágenes producidas por IA? ¿Son los artistas cuyas imágenes se usaron para entrenar los sistemas? ¿Los usuarios que escriben indicaciones para crear imágenes? ¿O las personas que construyen los sistemas de IA?

¿Infracción o uso justo?

Mientras que los artistas se inspiran oblicuamente en trabajos anteriores que los han educado e inspirado para crear, la IA generativa se basa en datos de entrenamiento para producir resultados.

Estos datos de capacitación consisten en obras de arte anteriores, muchas de las cuales están protegidas por la ley de derechos de autor y que se recopilaron sin el conocimiento o consentimiento de los artistas. Usar el arte de esta manera podría violar la ley de derechos de autor incluso antes de que la IA genere un nuevo trabajo.

Para que Jason Allen creara su arte premiado, Midjourney se formó en 100 millones de obras anteriores.

¿Fue eso una forma de infracción? ¿O fue una nueva forma de " uso justo ", una doctrina legal que permite el uso sin licencia de obras protegidas si se transforman lo suficiente en algo nuevo?

Si bien los sistemas de IA no contienen copias literales de los datos de entrenamiento, a veces logran recrear obras a partir de los datos de entrenamiento, lo que complica este análisis legal.

¿La ley de derechos de autor contemporánea favorecerá a los usuarios finales y las empresas sobre los artistas cuyo contenido se encuentra en los datos de capacitación?

Para mitigar esta preocupación, algunos estudiosos proponen nuevas regulaciones para proteger y compensar a los artistas cuyo trabajo se utiliza para la formación. Estas propuestas incluyen el derecho de los artistas a optar por que sus datos no se utilicen para la IA generativa o una forma de compensar automáticamente a los artistas cuando su trabajo se utiliza para entrenar una IA.

Propiedad confusa

Training data, however, is only part of the process. Frequently, artists who use generative AI tools go through many rounds of revision to refine their prompts, which suggests a degree of originality.

Answering the question of who should own the outputs requires looking into the contributions of all those involved in the generative AI supply chain.

The legal analysis is easier when an output is different from works in the training data. In this case, whoever prompted the AI to produce the output appears to be the default owner.

However, copyright law requires meaningful creative input — a standard satisfied by clicking the shutter button on a camera. It remains unclear how courts will decide what this means for the use of generative AI. Is composing and refining a prompt enough?

Matters are more complicated when outputs resemble works in the training data. If the resemblance is based only on general style or content, it is unlikely to violate copyright, because style is not copyrightable.

The illustrator Hollie Mengert encountered this issue firsthand when her unique style was mimicked by generative AI engines in a way that did not capture what, in her eyes, made her work unique. Meanwhile, the singer Grimes embraced the tech, "open-sourcing" her voice and encouraging fans to create songs in her style using generative AI.

If an output contains major elements from a work in the training data, it might infringe on that work's copyright. Recently, the Supreme Court ruled that Andy Warhol's drawing of a photograph was not permitted by fair use. That means that using AI to just change the style of a work — say, from a photo to an illustration — is not enough to claim ownership over the modified output.

While copyright law tends to favor an all-or-nothing approach, scholars at Harvard Law School have proposed new models of joint ownership that allow artists to gain some rights in outputs that resemble their works.

In many ways, generative AI is yet another creative tool that allows a new group of people access to image-making, just like cameras, paintbrushes or Adobe Photoshop. But a key difference is this new set of tools relies explicitly on training data, and therefore creative contributions cannot easily be traced back to a single artist.

The ways in which existing laws are interpreted or reformed — and whether generative AI is appropriately treated as the tool it is — will have real consequences for the future of creative expression.

This article is republished from The Conversation under a Creative Commons license. You can find the original article here.

Robert Mahari es un JD-Ph.D. estudiante del MIT Media Lab y de la Facultad de Derecho de Harvard. Estudia cómo la tecnología puede y debe afectar la práctica del derecho con un enfoque en aumentar el acceso a la justicia y la eficacia judicial.

Jessica Fjeld es profesora de derecho y subdirectora de la Clínica de Derecho Cibernético en el Centro Berkman Klein para Internet y Sociedad. También es miembro de la junta de Global Network Initiative.

Ziv Epstein es un Ph.D. estudiante del grupo Human Dynamics del Instituto Tecnológico de Massachusetts (MIT). Epstein recibió una compensación de OpenAI por probar negativamente DALL-E 2 en la primavera de 2022.