Les modes de conduite de la bêta FSD de Tesla soulèvent des questions éthiques intéressantes dont nous devrions parler

Avez-vous déjà traversé un panneau d'arrêt ? Bien sûr que vous avez. Je crois que je l'ai fait ce matin, en fait. Si vous êtes un conducteur qui ne l'a pas fait, j'espère que le fait d'être un menteur fonctionne pour vous, car je parie que vous l'avez fait. En ce qui concerne les choses illégales, rouler à travers un panneau d'arrêt est à peu près aussi mineur que possible, bien que ce soit techniquement illégal et je suppose pour une raison décente, car les panneaux d'arrêt sont généralement placés à des endroits où s'arrêter complètement est à tout le moins une assez bonne idée. Donc, avec cela à l'esprit, devrions-nous programmer l'IA des voitures autonomes pour commettre ce crime certes mineur ? Tesla semble avoir déjà décidé que tout allait bien.

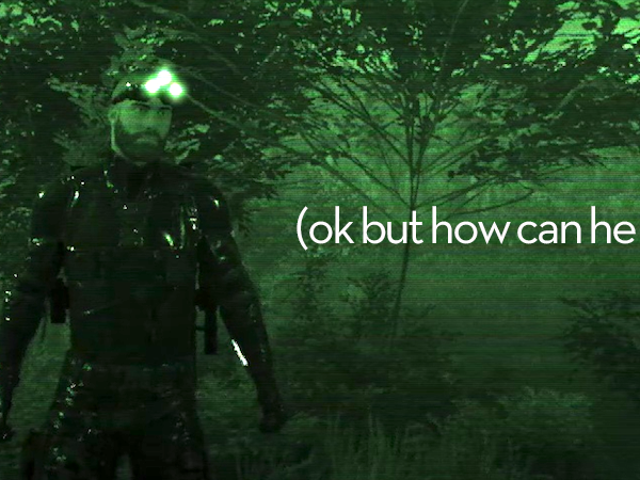

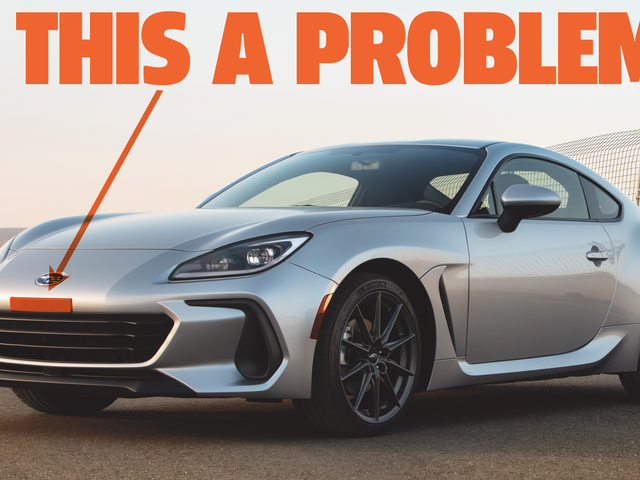

La version actuelle de Tesla de son logiciel bêta Full Self-Driving (FSD) contient une fonctionnalité connue sous le nom de «profils FSD», qui a commencé avec la version 10.3 publiée en octobre 2021 (mais a ensuite été retirée pour des problèmes et est revenue très bientôt avec 10.3.1 ).

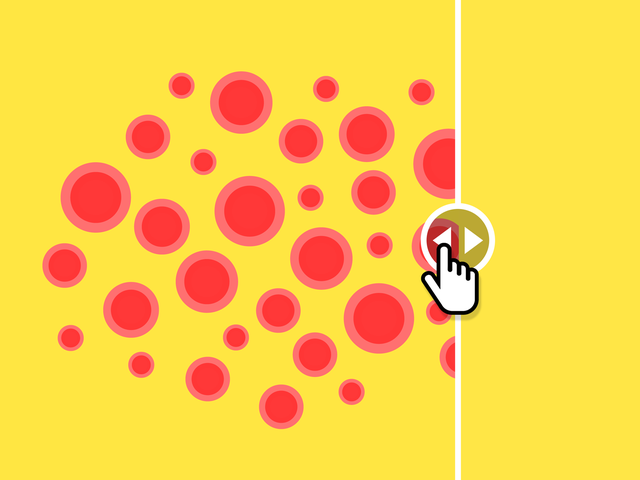

Comme indiqué dans d'autres articles sur ces mises à jour, une grande fonctionnalité a été l'introduction de trois "profils" pour le comportement de FSD, qui incluent Chill, Average et Assertive.

Dans les modes Moyen et Assertif, le petit texte de description révèle un peu comment le logiciel va faire se comporter la voiture, et révèle quelques détails :

Dans ces deux modes, la description indique que la voiture peut effectuer un arrêt roulant. Soyons absolument clairs sur ce que c'est : oui , c'est incroyablement mineur et peut-être même trivial, mais c'est la voiture qui vous dit que sa programmation peut l'amener à décider d'accomplir un acte illégal.

La raison pour laquelle j'en fais une grande chose est que nous sommes encore assez tôt dans le développement de l'humanité de ce que nous espérons être un jour des voitures entièrement autonomes que nous pouvons encore regarder ce que nous sommes capables de faire et nous demander vraiment si c'est le chemin que nous voulons prendre.

Est-ce? Je ne suis honnêtement pas certain.

L'acte spécifique - rouler à travers un panneau d'arrêt - est moins important que les implications plus importantes ici. Ces implications sont le fait que nous avons des lois sur la circulation dans nos livres qui sont régulièrement enfreintes, parce que nous sommes des êtres humains et que l'expérience globale de la conduite peut, selon nous, être améliorée d'une manière ou d'une autre par l'ignorance délibérée de certaines de ces lois.

Presque tous nous accélérons parfois aussi. Et bien que vous puissiez également accélérer les systèmes d'assistance à la conduite de Tesla (et d'autres, bien sûr), cela a toujours été la décision de l'homme de le faire. Si vous réglez la limite supérieure de vitesse de votre régulateur de vitesse ou de votre système de conduite semi-automatique de niveau 2 à 95 mph, c'est ce que la voiture fera, mais c'était votre choix, pas celui de la voiture.

Cette situation est différente, car le conducteur ne fait pas partie du processus de prise de décision qui pourrait amener la Tesla à franchir un panneau d'arrêt, enfreignant une loi. Si un flic vous voit faire ça et vous arrête, qui est à blâmer ?

Est-ce la faute du conducteur, car il a été informé que la voiture pourrait commettre un tel crime lorsqu'il a sélectionné le mode de conduite ? Ou le flic devrait-il envoyer le ticket au siège de Tesla, puisque c'est leur logiciel qui a délibérément décidé de franchir le panneau d'arrêt ?

Voulons-nous que nos éventuelles voitures autonomes soient prêtes à enfreindre les lois ? Cela signifie-t-il que nous devons jeter un regard réaliste sur notre code de la route et peut-être l'adapter un peu mieux aux comportements et aux situations réelles et réelles ? Devrions-nous simplement légaliser un arrêt lent à certaines intersections et conditions, et peut-être avoir des lois de vitesse plus flexibles ?

Ou devrions-nous simplement programmer nos voitures pour qu'elles respectent la loi ? Cela ne fait pas partie de ce qui rend la possibilité d'une conduite contrôlée par ordinateur si attrayante pour les gens, c'est que les ordinateurs peuvent toujours faire ce qui est sûr et ne seront jamais tentés d'enfreindre les lois ou d'exécuter des panneaux d'arrêt ou de vitesse parce qu'ils ne sont pas surchargés de nos cerveaux humains imparfaits, impulsifs, excités et affamés ?

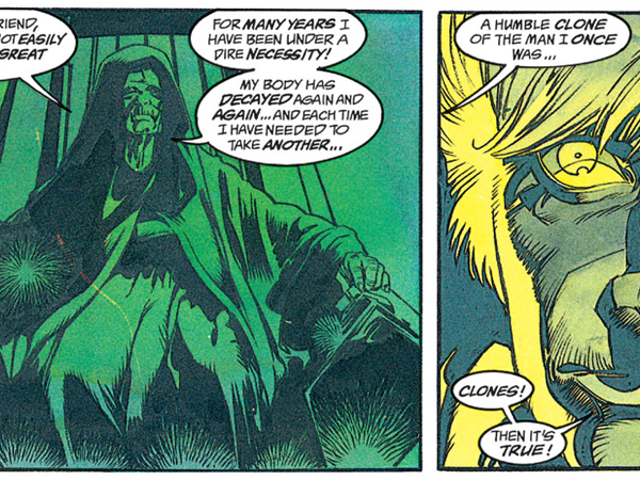

Cela peut sembler mineur, mais la ligne de pensée montrée dans ces profils de conduite n'est pas conceptuellement différente de si, disons, Tesla parvient à développer et à vendre son robot humanoïde (arrêtez de rire, c'est une expérience de pensée), et il comprend un Mode vol à l'étalage qui lui permettrait de tenter de voler des objets s'il pensait pouvoir s'en tirer.

Bien sûr, cela n'existe pas, mais ce n'est pas vraiment différent d'un curseur qui laisse la voiture décider d'enfreindre le code de la route.

Nous devons réfléchir à tout cela maintenant et décider de ce que nous voulons pour notre avenir. Voulons-nous un respect total de la loi et de la règle ? Voulons-nous certaines exceptions? La possibilité de passer outre au besoin et de permettre un comportement qui enfreint la loi ? Laisser la décision à la machine, éventuellement avec un ensemble glissant de paramètres acceptables ?

Honnêtement, je ne sais pas exactement comment cela devrait se dérouler. Ce dont je suis sûr, c'est que nous, collectivement, en tant que société, devons prendre le temps et faire le travail certes difficile pour décider d'un ensemble de règles standard , avant de commencer à essayer de la merde et de voir jusqu'où nous pouvons le pousser .

Parce que, rappelez-vous, nous sommes des humains, et une partie de cet accord signifie que nous allons toujours le pousser, peut-être trop loin.