Menerapkan Memori Asosiatif

Ditulis oleh Shashata Sawmya dan Harveer Singh

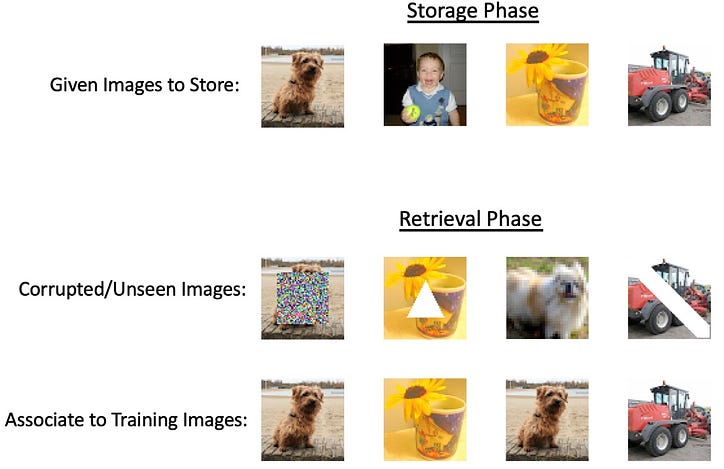

Dengan munculnya jaringan saraf yang besar dan kemajuan teknologi yang terus meningkat yang mendorong metode saat ini ke batas absolutnya, fokusnya adalah menciptakan alat penampung-semua yang bertujuan untuk melakukan segalanya. Namun, sebagian besar tugas tidak memerlukan jaringan dalam yang sangat intensif tetapi masih sesuatu yang lebih fleksibel daripada model matematika dasar. Tugas potensial yang tidak membutuhkan intensitas jaring saraf yang dalam adalah penyimpanan dan pengambilan informasi yang disebut memori asosiatif. Idenya di sini adalah bahwa dengan memberikan beberapa masukan, kami ingin dapat mengambil keluaran terkait dari sistem yang menghubungkan keduanya bersama-sama dan menyimpannya dalam "memori". Nama memori asosiatif berasal dari konsep psikologis otak kita sebagai sistem penyimpanan memori yang mampu menghubungkan konsep bersama. Salah satu jenis memori asosiatif adalah memori asosiatif otomatis di mana kami memberikan representasi parsial dari output yang kami inginkan sebagai input, ini bisa berupa output dengan noise tambahan atau bagian dari output yang ditutup-tutupi. Contoh dari jenis ingatan ini yang beraksi adalah melihat sebagian gambar kerabat dan otak Anda dapat secara otomatis mengisi sisa gambar secara mental. Jenis lain adalah memori heteroasosiatif di mana output dapat berupa kategori berbeda dari input yang diberikan tetapi model ingat untuk menghubungkannya bersama. Bayangkan mendengar kata “anjing”, otak Anda dapat secara otomatis mengasosiasikannya dengan konsep lain seperti “kucing” atau “tali” [1]. Contoh dari jenis ingatan ini yang beraksi adalah melihat sebagian gambar kerabat dan otak Anda dapat secara otomatis mengisi sisa gambar secara mental. Jenis lain adalah memori heteroasosiatif di mana output dapat berupa kategori berbeda dari input yang diberikan tetapi model ingat untuk menghubungkannya bersama. Bayangkan mendengar kata “anjing”, otak Anda dapat secara otomatis mengasosiasikannya dengan konsep lain seperti “kucing” atau “tali” [1]. Contoh dari jenis ingatan ini yang beraksi adalah melihat sebagian gambar kerabat dan otak Anda dapat secara otomatis mengisi sisa gambar secara mental. Jenis lain adalah memori heteroasosiatif di mana output dapat berupa kategori berbeda dari input yang diberikan tetapi model ingat untuk menghubungkannya bersama. Bayangkan mendengar kata “anjing”, otak Anda dapat secara otomatis mengasosiasikannya dengan konsep lain seperti “kucing” atau “tali” [1].

Sistem AM (memori asosiatif) memiliki sejarah yang kaya tetapi ada tonggak penelitian utama yang dapat memberikan gambaran tentang kemajuan teknis:

- Jaring Willshaw (Willshaw et al, 1969)

- Jaringan Hopfield (Hopfield, 1982)

Terinspirasi oleh sifat hologram yang "memori-mirip", pada tahun 1969 DJ Willshaw mengusulkan correlelograph, atau correlogram, dan pendekatan kuantitatif untuk memori asosiatif.

Gambar di atas menunjukkan konvolusi pola A dan B untuk membuat pola baru di C, lebih khusus lagi A dan B berisi lubang kecil tempat sumber cahaya (di belakang A) melewatinya untuk membuat pola di C yang berisi informasi tentang kedua pola tersebut. lubang kecil. Dari sini, lihat gambar 2 di bawah, membuat lubang pin dari pola yang diproyeksikan pada C dan meneruskan cahaya yang memancar di belakang C dan melalui B menghasilkan pola yang persis sama di mana lubang kecil A berada.

Selama pembuatan correlograph, Willshaw memperhatikan bahwa jika A dan B memiliki N lubang kecil maka pola pada C akan berukuran N². Ini mengarah pada usulan jaring asosiatif, perpotongan N garis sejajar (mewakili A) dan N garis sejajar (mewakili B).

Konstruksi jaring mengikuti bahwa setiap setengah lingkaran di ruang N² dihidupkan jika input kiri dan input kanan juga aktif, yang mewakili hubungan mereka satu sama lain. Anda kemudian dapat mengambil pola A dari B dengan mengikuti lingkaran di sisi kiri dan melihat lingkaran mana dari atas yang terkait dengannya dengan melihat titik N² mana yang aktif. Jelas untuk melihat ini akan bekerja dengan mudah hanya dengan satu asosiasi pasangan tetapi juga memungkinkan untuk mempelajari banyak pola di jaringan yang sama. Willshaw menunjukkan bahwa efisiensi jaringan maksimum teoretis adalah ketika 50% dari titik N² dihidupkan, ini mengurangi kemungkinan "pukulan palsu" — menunjukkan titik di A yang awalnya tidak terkait dengan pola B [2 ].

Jaringan Hopfield

Secara alami mengikuti jaringan asosiatif, inovasi besar yang memacu desain AM modern terjadi pada tahun 1982 di mana John Hopfield, sering disebut sebagai ayah baptis jaringan saraf, mengusulkan jaringan hopfieldnya. Jaringan adalah pengulangan yang sepenuhnya terhubung dengan setiap neuron dalam keadaan biner (0 atau 1) dan bobot yang diberikan antara nilai input dan nilai output yang diinginkan direpresentasikan dalam matriks bobot.

Jika Tij adalah matriks bobot yang sesuai maka asosiasi dicapai dengan:

Di mana U dalam jumlah cutoff dipilih dengan cerdik untuk meningkatkan akurasi.

Untuk menyimpan beberapa status asosiasi, algoritma berikut diberikan:

Kami memberlakukan batasan bahwa untuk i=j, bobotnya adalah 0 dalam T. Ini mengarah pada ortogonalitas semu dari:

Hal ini menunjukkan bahwa jika Vi adalah 1, nilai prediksi untuk J adalah positif dan negatif jika adalah 0. Hal ini mengikuti aturan asosiasi sebelumnya dimana U adalah 0.

Algoritme pembelajaran ini pada dasarnya merata-rata keadaan stabil untuk setiap pola, tetapi ini membatasi berapa banyak pola yang dapat diingat oleh jaringan tertentu. Terinspirasi oleh model Ising dan minimisasi energi, Hopfield mengusulkan mekanisme pembaruan ini untuk ditafsirkan sebagai minimisasi energi. Untuk jaringan berulang N node, semua node terhubung satu sama lain, kami mengambil satu node acak pada satu waktu dan menggunakan matriks bobot untuk memperbarui node itu.

Di mana s adalah nomor simpul dan nilai di dalam tanda kurung adalah langkah waktu.

Dalam mempelajari titik stabil, algoritme pembaruan ditentukan oleh aturan energi berikut:

Ini menunjukkan bahwa setiap perubahan Vi mengurangi energi jaringan selama perubahan Vi (+ atau -) cocok dengan tanda output dari perkalian matriks.

Node diperbarui secara asinkron dan acak mengikuti aturan energi dan ambang batas yang diberikan. Keadaan energi yang stabil dijamin tercapai karena aturan pembaruan hanya mengubah neuron jika energinya berkurang pada setiap langkah waktu. Saat menentukan berapa banyak keadaan stabil yang dapat muncul, ditunjukkan bahwa sekitar 0,15N keadaan ada untuk N neuron dalam model, penskalaan o(N) yang ketat [3]. Penting juga untuk dicatat bahwa struktur jaringan jenis ini kondusif untuk berhasil dalam tugas autoasosiatif, tetapi ada variasi seperti pengkodean "vektor-matriks-vektor" yang dapat mengimplementasikan memori heteroasosiatif juga [4].

teori biologi

Ide kunci yang mendorong semua model yang disebutkan di atas adalah mempromosikan koneksi jika neuron cocok dengan pola yang dicocokkan. Gaya pembelajaran ini dikenal sebagai “Pembelajaran Hebbian” yang mempromosikan koneksi sinapsis jika dua neuron menyala bersamaan. Meskipun pembentukan memori di otak masih merupakan fenomena yang tidak diketahui, telah ditunjukkan di laboratorium bahwa gagasan "api bersama kawat bersama" telah akurat secara biologis [5].

Menerapkan memori asosiatif in-silico

Memori asosiatif adalah jenis memori yang memungkinkan penyimpanan dan pengambilan informasi berdasarkan hubungan atau asosiasi antara bagian data yang berbeda. Mengembangkan model komputasi untuk sistem seperti itu adalah masalah mapan di persimpangan ilmu saraf dan kecerdasan buatan. Metode yang dipelajari dengan baik seperti jaringan Hopfield hanya dapat menyimpan pola biner; namun, data yang kompleks (seperti gambar, dan teks) membutuhkan sistem yang kompleks untuk memecahkan masalah tersebut.

Apakah metode berbasis energi model komputasi yang baik untuk memori asosiatif?

Hampir semua model memori asosiatif berbasis energi menyimpan pola dalam minima lokal dari fungsi energi. Gagasan utama di balik model ini adalah untuk menentukan lanskap energi, di mana pola yang disimpan sesuai dengan keadaan stabil dengan energi rendah. Fungsi energi dirancang untuk memiliki beberapa minima lokal, masing-masing mewakili pola yang tersimpan. Ketika sistem menerima input, secara iteratif memperbarui statusnya untuk meminimalkan fungsi energi, yang pada akhirnya konvergen pada pola tersimpan terdekat, yang merupakan minimum lokal yang paling dekat dengan input. Beberapa model berbasis energi adalah -

Jaringan Hopfield [2]: Fungsi energi dalam jaringan Hopfield didefinisikan sebagai fungsi kuadrat dari keadaan jaringan. Setiap pola yang tersimpan sesuai dengan minimum lokal dari fungsi energi ini. Dinamika jaringan memastikan bahwa sistem akan menyatu ke salah satu minima lokal ini, secara efektif mengambil pola terkait.

Mesin Boltzmann [6]: Pada mesin Boltzmann, fungsi energi didefinisikan dalam hal status node dan bobot koneksi di antara mereka. Proses pembelajaran menyesuaikan bobot untuk membuat lanskap energi dengan minima lokal yang sesuai dengan pola yang tersimpan. Sistem kemudian menggunakan dinamika stokastik untuk mengeksplorasi lanskap energi dan menetapkan ke minimum lokal, mengambil pola yang sesuai.

Pendekatan berbasis teori medan rata-rata [7]: Pendekatan ini juga menyimpan pola dalam minima lokal dari fungsi energi. Dengan mendekati dinamika sistem yang kompleks dengan mean-field theory, proses pembelajaran dan pengambilan dapat dianalisis dan dioptimalkan dengan lebih efisien.

Model tradisional ini dapat menangani data gambar berskala kecil tetapi mungkin berjuang dengan gambar yang lebih besar dan lebih kompleks karena keterbatasan kapasitas, skalabilitas, dan kompleksitas komputasi.

Bisakah interpolasi sendiri mengimplementasikan memori asosiatif?

Menghafal membutuhkan model untuk mengambil data pelatihan, sedangkan interpolasi adalah kemampuan untuk menyesuaikan data pelatihan dengan sempurna. Jadi, interpolasi saja tidak dapat mengimplementasikan memori asosiatif. Interpolasi dapat menjadi teknik yang berguna untuk memperkirakan nilai antara titik data yang diketahui, tetapi tidak cukup untuk mengimplementasikan sistem memori asosiatif penuh. Model memori asosiatif dirancang untuk menyimpan dan mengambil pola berdasarkan asosiasinya, seringkali dengan mengidentifikasi pola tersimpan terdekat dengan input yang diberikan, bahkan jika inputnya berisik atau tidak lengkap.

Meskipun interpolasi dapat digunakan untuk memperkirakan nilai antara titik data yang diketahui, interpolasi tidak secara inheren dirancang untuk menangani derau, informasi tidak lengkap, atau pengenalan pola. Metode interpolasi, seperti interpolasi linier atau polinomial, bergantung pada asumsi bahwa fungsi yang mendasarinya halus atau memiliki bentuk tertentu, yang mungkin tidak berlaku untuk banyak masalah memori asosiatif dunia nyata.

Metode alternatif untuk memori asosiatif — overparameterisasi?

Overparameterisasi mengacu pada situasi di mana model pembelajaran mesin memiliki sejumlah besar parameter (bobot dan bias) dibandingkan dengan ukuran dataset pelatihan. Dengan kata lain, model lebih kompleks dari yang diperlukan untuk menjelaskan atau menangkap pola yang mendasari data. Diamati sebelumnya bahwa model overparameterized dapat menginterpolasi data; studi terbaru oleh Radhakrishnan et al. 2020 [8] menunjukkan bahwa autoencoder dengan parameter berlebih juga dapat digunakan untuk menghafal dan mengambil contoh pelatihan. Mekanismenya sangat sederhana; - contohnya bisa

dipulihkan hanya dengan mengulangi peta yang dipelajari.

Pembuat enkode otomatis! Juga dilebih-lebihkan! Apa ini?

Autoencoder adalah jenis jaringan syaraf tiruan yang digunakan untuk pembelajaran representasi data yang efisien tanpa pengawasan, seringkali dengan tujuan pengurangan dimensi, pembelajaran fitur, atau kompresi data. Ini terdiri dari dua bagian utama: encoder dan decoder.

Tujuan pelatihan autoencoder adalah untuk meminimalkan kesalahan rekonstruksi antara data input dan data yang direkonstruksi, yang dihasilkan dengan melewatkan input melalui encoder dan kemudian decoder.

Sederhananya, autoencoder dengan parameter berlebih adalah autoencoder dengan sejumlah besar parameter. Adi et. Al. menunjukkan bahwa autoencoder dengan parameter berlebih menyimpan contoh pelatihan sebagai titik tetap atau aktuator. Namun, ia juga mempelajari peta identitas f(x) = x

Ini adalah kontra untuk asosiatif karena prasyaratnya adalah bahwa turunan pada contoh harus kurang dari 1. Adit et. Al. 2020bekerja pada premis bahwa autoencoder dengan parameter berlebih cukup kuat untuk mengimplementasikan memori asosiatif. Mereka menunjukkan dalam pekerjaan mereka bahwa autoencoder dengan parameter berlebih dapat digunakan sebagai "Memori Asosiatif Berbasis Penarik". Ide inti di balik sistem berbasis penarik adalah bahwa jaringan harus dapat mengambil pola yang disimpan ketika diberi versi pola yang tidak lengkap atau berisik. Pola input berfungsi sebagai isyarat, dan dinamika jaringan memandu sistem menuju penarik terdekat, secara efektif "membersihkan" kebisingan atau mengisi informasi yang hilang — sederhananya OPA dapat mengimplementasikan memori asosiatif. Kondisi matematis untuk menjadi memori asosiatif berbasis penarik adalah –

- Contoh harus titik tetap.

- Turunan dalam contoh harus kurang dari 1.

Apakah ini benar-benar terjadi?

Makalah ini memberikan bukti empiris yang luas bahwa penarik dapat ditemukan di autoencoder di berbagai arsitektur dan teknik pengoptimalan. Penulis berhasil mendemonstrasikan autoencoder dengan parameter berlebih yang mampu menyimpan 500 gambar dari kumpulan data ImageNet-64 sebagai penarik. Mereka mengkonfirmasi bahwa semua 500 gambar pelatihan memang disimpan sebagai penarik dengan memeriksa nilai eigen dari matriks Jacobian untuk setiap contoh. Studi ini juga menganalisis tingkat pemulihan contoh pelatihan di bawah berbagai bentuk korupsi, mengungkapkan tingkat pemulihan yang sangat tinggi.

Eksperimen lebih lanjut menunjukkan bahwa autoencoder juga dapat menyimpan contoh pelatihan sebagai penarik saat dilatih dengan 2.000 gambar dari kumpulan data MNIST dan 1.000 gambar hitam-putih dari kumpulan data CIFAR10. Meskipun penarik palsu (penarik selain contoh pelatihan) berpotensi ada dalam autoencoder dengan parameter berlebih, para peneliti tidak dapat mengidentifikasi penarik palsu seperti itu dalam contoh ImageNet-64 mereka.

Penulis melakukan analisis komprehensif terhadap fenomena penarik, memeriksa berbagai arsitektur umum, metode pengoptimalan, dan skema inisialisasi. Ini termasuk berbagai nonlinier, metode optimisasi, dan skema inisialisasi. Temuan mereka mengungkapkan bahwa penarik muncul dalam setiap skenario di mana pelatihan menyatu dengan kerugian yang cukup rendah dalam 1.000.000 zaman. Secara signifikan, fenomena ini tidak terbatas pada jaringan yang terhubung sepenuhnya, tetapi juga diamati pada arsitektur jaringan yang banyak digunakan, seperti jaringan konvolusional dan berulang.

Secara signifikan, fenomena ini tidak terbatas pada jaringan yang terhubung sepenuhnya, seperti yang juga diamati pada arsitektur jaringan yang banyak digunakan, seperti jaringan konvolusional dan berulang. Untuk memvisualisasikan atraktor 2D, mereka melatih autoencoder untuk menyimpan enam contoh pelatihan sebagai atraktor dan memvisualisasikan cekungan ketertarikan mereka dengan mengulang peta autoencoder terlatih, mulai dari 10.000 titik grid hingga konvergensi. Medan vektor dalam percobaan menunjukkan arah gerak yang diberikan oleh iterasi. Setiap contoh pelatihan dan cekungan daya tarik yang sesuai diwakili oleh warna yang berbeda. Menariknya, penelitian tersebut mengungkapkan bahwa metrik yang dipelajari oleh autoencoder untuk memisahkan cekungan daya tarik bukanlah jarak Euclidean, yang akan ditunjukkan oleh diagram Voronoi.

Encoding urutan menunjukkan hasil yang lebih baik daripada autoencoding.

Mengubah sedikit fungsi objektif dari autoencoder menghasilkan penerapan memori asosiatif. Para peneliti menunjukkan bahwa meminimalkan fungsi kerugian untuk ambang batas yang cukup kecil dan stabil mengkodekan urutan pelatihan sebagai siklus batas jaringan (sejenis penarik yang menunjukkan perilaku periodik yang stabil).

Catatan Akhir

Sebagai kesimpulan, memori asosiatif adalah aspek menarik dari kognisi manusia yang telah dipelajari dalam berbagai konteks, termasuk sistem biologis, jaringan Hopfield, dan jaringan saraf dengan parameter berlebih. Pemahaman kita tentang memori asosiatif dalam organisme hidup telah mengilhami pengembangan model komputasi, seperti jaringan Hopfield, yang pada gilirannya telah memajukan bidang kecerdasan buatan dan pembelajaran mesin.

Penelitian baru-baru ini tentang jaringan saraf dengan parameter berlebih telah menemukan munculnya atraktor, sebuah fenomena yang terkait dengan memori asosiatif, di berbagai arsitektur dan teknik pengoptimalan. Perkembangan yang menarik ini tidak hanya memperkuat hubungan antara sistem saraf biologis dan buatan, tetapi juga membuka peluang baru untuk mengeksplorasi model yang lebih efisien dan kuat untuk penyimpanan dan pengambilan memori.

Saat kami terus mengungkap mekanisme rumit yang mendasari memori asosiatif, temuan kami akan memicu inovasi lebih lanjut dalam kecerdasan buatan, membuka jalan bagi model canggih yang diilhami secara biologis yang dapat mensimulasikan kemampuan kognitif manusia. Eksplorasi berkelanjutan ini menjanjikan untuk meningkatkan pemahaman kita tentang hubungan kompleks antara biologi dan komputasi, yang pada akhirnya mengarah pada terobosan yang dapat menguntungkan kedua bidang tersebut.

Terima kasih khusus kepada Nir N. Shavit atas bimbingan dan diskusinya yang bermanfaat. Dibuat sebagai bagian dari kelas MIT 6.S978 — Jaringan vs. Silikon dalam Pembelajaran Mesin, Musim Semi 2023.

Referensi

- Smith, J. (2022). Apa itu Memori Asosiatif? Sangat baik Pikiran.https://www.verywellmind.com/what-is-associative-memory-5198601

- Willshaw, DJ, Buneman, OP, & Longuet-Higgins, HC (1969). Memori asosiatif non-holografik. Alam , 222 (5197), 960–962.Yáñez-Márquez, C., López-Yáñez, I., Aldape-Pérez, M., Camacho-Nieto, O., Argüelles-Cruz, AJ, & Villuendas-Rey, Y. (2018). Fondasi Teoretis untuk Kenangan Asosiatif Alfa-Beta: 10 Tahun Ekstensi, Model, dan Aplikasi Turunan. Surat Pemrosesan Neural , 48 (2), 811–847.

- Hopfield, JJ (1982). Jaringan saraf dan sistem fisik dengan kemampuan komputasi kolektif yang muncul. Prosiding akademi sains nasional , 79 (8), 2554–2558.

- Kosko, B. (1988). Ingatan asosiatif dua arah. Transaksi IEEE pada Sistem, manusia, dan Sibernetika, 18(1), 49–60.

- McClelland, JL (2006). Seberapa jauh Anda bisa pergi dengan pembelajaran Hebbian, dan kapan hal itu menyesatkan Anda. Proses perubahan otak dan perkembangan kognitif: Perhatian dan kinerja xxi, 21, 33–69.

- Ackley, David H., Geoffrey E. Hinton, dan Terrence J. Sejnowski. "Algoritma pembelajaran untuk mesin Boltzmann." Ilmu kognitif 9.1 (1985): 147–169.

- Barabási, Albert-László, Réka Albert, and Hawoong Jeong. "Teori medan rata-rata untuk jaringan acak bebas skala." Physica A: Mekanika Statistik dan Aplikasinya 272.1–2 (1999): 173–187.

- Radhakrishnan, Adityanarayanan, Mikhail Belkin, and Caroline Uhler. “Jaringan saraf dengan parameter berlebih mengimplementasikan memori asosiatif.” Prosiding National Academy of Sciences 117.44 (2020): 27162–27170

![Apa itu Linked List? [Bagian 1]](https://post.nghiatu.com/assets/images/m/max/724/1*Xokk6XOjWyIGCBujkJsCzQ.jpeg)