Você não pode colocar facilmente a pasta de dente de volta no tubo. Você não pode esperar que as moléculas de vapor migrem espontaneamente de volta para formar uma bola de água . Se você soltar um monte de cachorros corgi em um campo, é muito improvável que você consiga colocá-los todos juntos novamente em uma caixa sem fazer uma tonelada de trabalho. Esses são os problemas associados à Segunda Lei da Termodinâmica, também conhecida como Lei da Entropia.

A Segunda Lei da Termodinâmica

A termodinâmica é importante para várias disciplinas científicas, da engenharia às ciências naturais à química, física e até economia. Um sistema termodinâmico é um espaço confinado, que não deixa a energia entrar ou sair dele.

A primeira lei da termodinâmica tem a ver com a conservação de energia - você provavelmente se lembra de ter ouvido antes que a energia em um sistema fechado permanece constante ("a energia não pode ser criada nem destruída"), a menos que seja adulterada de fora. No entanto, a energia muda constantemente de forma - um incêndio pode transformar a energia química de uma planta em energia térmica e eletromagnética. Uma bateria transforma energia química em energia elétrica. O mundo gira e a energia se torna menos organizada.

"A segunda lei da termodinâmica é chamada de lei da entropia", disse Marko Popovic, pesquisador de pós-doutorado em Biotermodinâmica na Escola de Ciências da Vida da Universidade Técnica de Munique, por e-mail. "É uma das leis mais importantes da natureza."

Entropia é uma medida da desordem em um sistema fechado. De acordo com a segunda lei, a entropia em um sistema quase sempre aumenta com o tempo - você pode trabalhar para criar ordem em um sistema, mas mesmo o trabalho que é colocado em reorganização aumenta a desordem como um subproduto - geralmente na forma de calor. Como a medida de entropia é baseada em probabilidades, é claro que é possível que a entropia diminua em um sistema ocasionalmente, mas isso é estatisticamente muito improvável.

A Definição de Desordem

É mais difícil do que você pensa encontrar um sistema que não deixe a energia entrar ou sair - nosso universo é um exemplo tão bom quanto nós - mas a entropia descreve como a desordem acontece em um sistema tão grande quanto o universo ou tão pequeno como uma garrafa térmica cheia de café.

No entanto, a entropia não tem a ver com o tipo de desordem em que você pensa quando tranca um bando de chimpanzés em uma cozinha. Tem mais a ver com quantas combinações possíveis de bagunça podem ser feitas naquela cozinha do que com o tamanho da bagunça possível. Claro, a entropia depende de muitos fatores: quantos chimpanzés existem, quanta coisa está sendo armazenada na cozinha e quão grande é a cozinha. Então, se você olhar para duas cozinhas - uma muito grande e cheia até as guelras, mas meticulosamente limpa, e outra que é menor com menos coisas, mas já bastante destruída por chimpanzés - é tentador dizer que o quarto mais bagunçado tem mais entropia, mas não é necessariamente o caso. A entropia se preocupa mais com quantos estados diferentes são possíveisdo que o quão desordenado está no momento; um sistema, portanto, tem mais entropia se houver mais moléculas e átomos nele, e se for maior. E se houver mais chimpanzés.

Entropia é confusa

A entropia pode ser o conceito científico mais verdadeiro que poucas pessoas realmente entendem. O conceito de entropia pode ser muito confuso - em parte porque existem tipos diferentes . O matemático húngaro John von Neumann lamentou a situação da seguinte maneira: "Quem quer que use o termo 'entropia' em uma discussão sempre vence, já que ninguém sabe o que realmente é a entropia, então em um debate sempre leva vantagem."

“É um pouco difícil definir entropia”, diz Popovic. "Talvez seja melhor definida como uma propriedade termodinâmica não negativa, que representa uma parte da energia de um sistema que não pode ser convertida em trabalho útil. Assim, qualquer adição de energia a um sistema implica que uma parte da energia será transformada em entropia, aumentando a desordem no sistema. Assim, a entropia é uma medida de desordem de um sistema. "

Mas não se sinta mal se você estiver confuso: a definição pode variar dependendo de qual disciplina a está exercendo no momento:

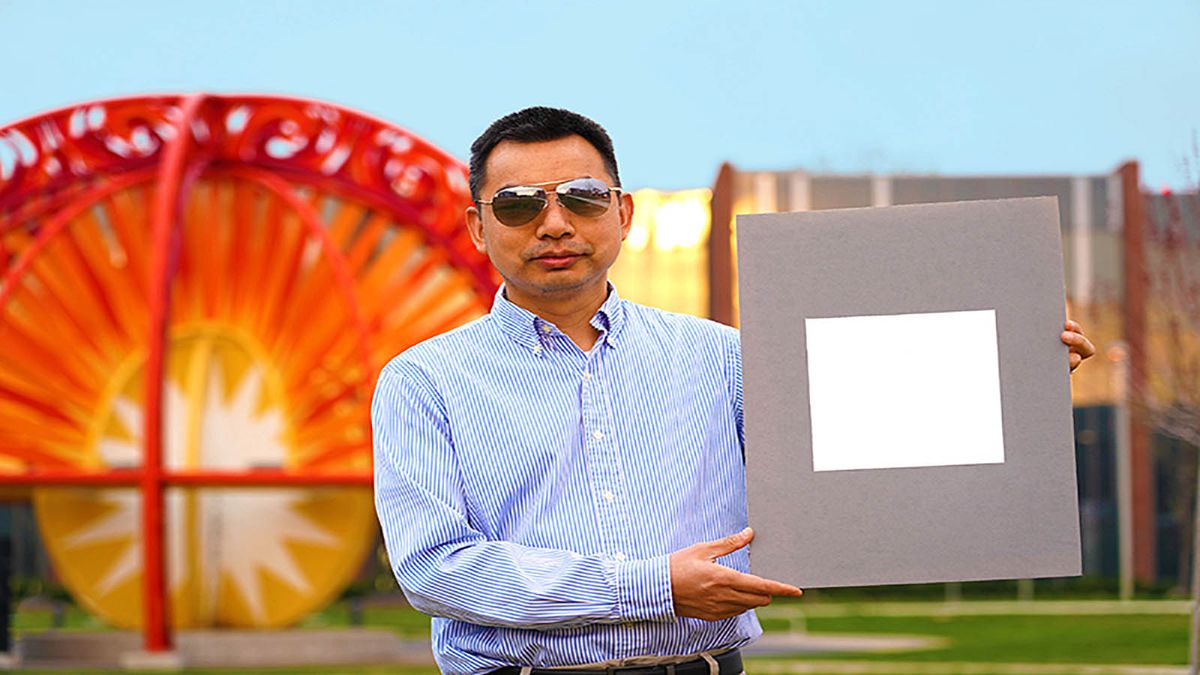

Em meados do século 19, um físico alemão chamado Rudolph Clausius , um dos fundadores do conceito de termodinâmica, estava trabalhando em um problema de eficiência em motores a vapor e inventou o conceito de entropia para ajudar a medir a energia inútil que não pode ser convertida em trabalho útil. Algumas décadas depois, Ludwig Boltzmann (o outro "fundador" da entropia) usou o conceito para explicar o comportamento de um número imenso de átomos: embora seja impossível descrever o comportamento de cada partícula em um copo d'água, ainda é possível prever seu comportamento coletivo quando são aquecidos usando uma fórmula para entropia.

“Na década de 1960, o físico americano ET Jaynes interpretou a entropia como uma informação que perdemos para especificar o movimento de todas as partículas em um sistema”, diz Popovic. "Por exemplo, um mol de gás consiste em 6 x 10 23 partículas. Assim, para nós, é impossível descrever o movimento de cada partícula, então, em vez disso, fazemos a próxima melhor coisa, definindo o gás não através do movimento de cada partícula, mas através das propriedades de todas as partículas combinadas: temperatura, pressão, energia total. A informação que perdemos quando fazemos isso é chamada de entropia. "

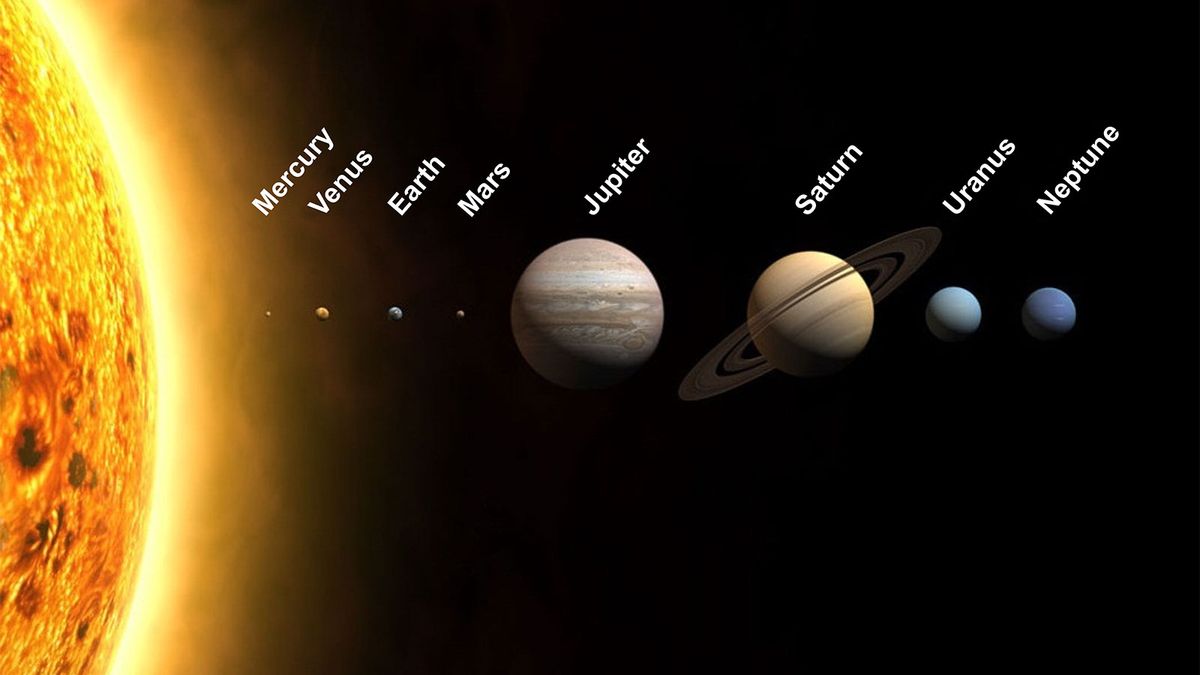

E o aterrorizante conceito de "morte térmica do universo" não seria possível sem a entropia. Como nosso universo provavelmente começou como uma singularidade - um ponto de energia infinitesimalmente pequeno e ordenado - que cresceu e continua se expandindo o tempo todo, a entropia está crescendo constantemente em nosso universo porque há mais espaço e, portanto, mais estados potenciais de desordem para os átomos aqui para adotar. Os cientistas levantaram a hipótese de que, muito depois de você e eu partirmos, o universo acabará atingindo algum ponto de desordem máxima, ponto no qual tudo estará na mesma temperatura, sem bolsões de ordem (como estrelas e chimpanzés) para serem encontrados.

E se acontecer, teremos que agradecer à entropia.

Agora isso é interessante

O cientista do século XX, Sir Arthur Eddington, achava que o conceito de entropia era tão importante para a ciência que escreveu em The Nature of the Physical World em 1928: "A lei de que a entropia sempre aumenta detém, penso eu, a posição suprema entre as leis da Natureza. ... Se sua teoria for contra a Segunda Lei da Termodinâmica, não posso lhe dar esperança; não há nada para que ela desabe na mais profunda humilhação. "