การใช้หน่วยความจำเชื่อมโยง

เขียนโดย Shashata Sawmya และ Harveer Singh

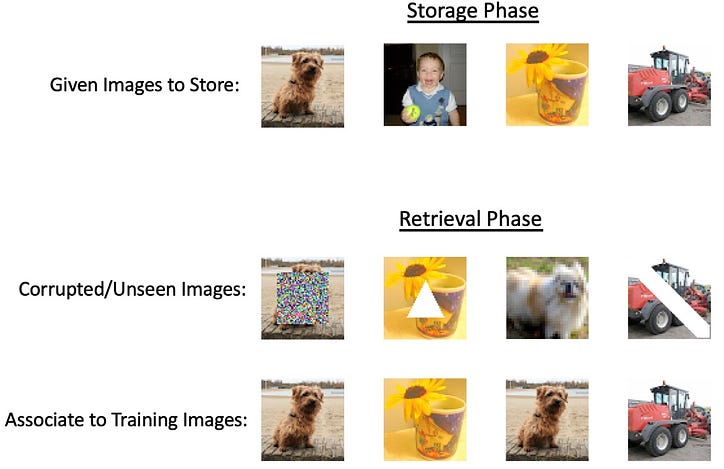

ด้วยการกำเนิดของโครงข่ายประสาทเทียมขนาดใหญ่และความก้าวหน้าทางเทคโนโลยีที่เพิ่มขึ้นเรื่อย ๆ ซึ่งผลักดันวิธีการปัจจุบันไปสู่ขีดจำกัดสัมบูรณ์ โฟกัสจึงได้สร้างเครื่องมือจับทั้งหมดที่มีจุดมุ่งหมายเพื่อทำทุกสิ่ง อย่างไรก็ตาม งานส่วนใหญ่จะไม่ต้องการเครือข่ายเชิงลึกที่เข้มข้นอย่างเหลือเชื่อ แต่ก็ยังมีบางอย่างที่หลากหลายกว่าแบบจำลองทางคณิตศาสตร์พื้นฐาน งานที่มีศักยภาพที่ไม่ต้องการความเข้มของเครือข่ายประสาทลึกคือการจัดเก็บและดึงข้อมูลที่เรียกว่าความทรงจำที่เชื่อมโยง แนวคิดในที่นี้คือการให้อินพุตบางอย่างเราต้องการดึงเอาต์พุตที่เกี่ยวข้องจากระบบที่เชื่อมโยงทั้งสองเข้าด้วยกันและเก็บไว้ใน "หน่วยความจำ" ชื่อความสัมพันธ์ของหน่วยความจำเกิดจากแนวคิดทางจิตวิทยาของสมองของเราซึ่งเป็นระบบจัดเก็บหน่วยความจำที่สามารถเชื่อมโยงแนวคิดต่างๆ เข้าด้วยกัน หน่วยความจำแบบเชื่อมโยงประเภทหนึ่งคือหน่วยความจำแบบเชื่อมโยงอัตโนมัติซึ่งเราให้เอาต์พุตบางส่วนที่เราต้องการเป็นอินพุต ซึ่งอาจเป็นเอาต์พุตที่มีสัญญาณรบกวนเพิ่มหรือบางส่วนของเอาต์พุตปิดบัง ตัวอย่างของการใช้งานหน่วยความจำประเภทนี้คือการเห็นภาพบางส่วนของญาติและสมองของคุณสามารถเติมเต็มภาพที่เหลือโดยอัตโนมัติทางจิตใจ อีกประเภทหนึ่งคือหน่วยความจำ heteroassociative ซึ่งเอาต์พุตสามารถเป็นประเภทต่างๆ ของอินพุตที่กำหนด แต่โมเดลจะจดจำการเชื่อมโยงเข้าด้วยกัน ลองนึกภาพว่าได้ยินคำว่า "สุนัข" สมองของคุณสามารถเชื่อมโยงกับแนวคิดอื่นๆ เช่น "แมว" หรือ "สายจูง" ได้โดยอัตโนมัติ [1] ตัวอย่างของการใช้งานหน่วยความจำประเภทนี้คือการเห็นภาพบางส่วนของญาติและสมองของคุณสามารถเติมเต็มภาพที่เหลือโดยอัตโนมัติทางจิตใจ อีกประเภทหนึ่งคือหน่วยความจำ heteroassociative ซึ่งเอาต์พุตสามารถเป็นประเภทต่างๆ ของอินพุตที่กำหนด แต่โมเดลจะจดจำการเชื่อมโยงเข้าด้วยกัน ลองนึกภาพว่าได้ยินคำว่า "สุนัข" สมองของคุณสามารถเชื่อมโยงกับแนวคิดอื่นๆ เช่น "แมว" หรือ "สายจูง" ได้โดยอัตโนมัติ [1] ตัวอย่างของการใช้งานหน่วยความจำประเภทนี้คือการเห็นภาพบางส่วนของญาติและสมองของคุณสามารถเติมเต็มภาพที่เหลือโดยอัตโนมัติทางจิตใจ อีกประเภทหนึ่งคือหน่วยความจำ heteroassociative ซึ่งเอาต์พุตสามารถเป็นประเภทต่างๆ ของอินพุตที่กำหนด แต่โมเดลจะจดจำการเชื่อมโยงเข้าด้วยกัน ลองนึกภาพว่าได้ยินคำว่า "สุนัข" สมองของคุณสามารถเชื่อมโยงกับแนวคิดอื่นๆ เช่น "แมว" หรือ "สายจูง" ได้โดยอัตโนมัติ [1]

ระบบ AM (หน่วยความจำเชื่อมโยง) มีประวัติอันยาวนาน แต่มีเหตุการณ์สำคัญในการวิจัยที่สามารถให้ภาพรวมของความก้าวหน้าทางเทคนิค:

- Willshaw สุทธิ (Willshaw et al, 1969)

- เครือข่ายฮอปฟิลด์ (Hopfield, 1982)

ได้รับแรงบันดาลใจจากคุณสมบัติ "คล้ายหน่วยความจำ" ของโฮโลแกรม ในปี 1969 DJ Willshaw ได้เสนอคอร์เรเลโลกกราฟหรือคอร์เรโลแกรม และวิธีการเชิงปริมาณเพื่อเชื่อมโยงหน่วยความจำ

รูปด้านบนแสดงการบิดของรูปแบบ A และ B เพื่อสร้างรูปแบบใหม่บน C โดยเฉพาะอย่างยิ่ง A และ B มีรูเข็มที่แหล่งกำเนิดแสง (ด้านหลัง A) ผ่านเพื่อสร้างรูปแบบบน C ซึ่งมีข้อมูลเกี่ยวกับรูปแบบทั้งสองของ รูเข็ม จากนี้ ดูรูปที่ 2 ด้านล่าง การสร้างรูเข็มจากรูปแบบที่ฉายบน C และการส่งผ่านแสงที่เปล่งออกมาด้านหลัง C และผ่าน B จะสร้างรูปแบบเดียวกันทุกประการซึ่งรูเข็มของ A อยู่

ระหว่างการสร้างคอร์เรโลกราฟ Willshaw สังเกตเห็นว่าหากทั้ง A และ B มีรูเข็ม N รู ดังนั้นรูปแบบบน C จะมีขนาด N² สิ่งนี้นำไปสู่ข้อเสนอของตาข่ายเชื่อมโยง จุดตัดของเส้นคู่ขนาน N (แทน A) และเส้นขนาน N (แทน B)

การสร้างตาข่ายเป็นไปตามที่แต่ละครึ่งวงกลมในพื้นที่ N² จะเปิดขึ้นหากเปิดทั้งอินพุตซ้ายและอินพุตขวา ซึ่งแสดงถึงความสัมพันธ์ซึ่งกันและกัน จากนั้นคุณสามารถดึงรูปแบบ A จาก B ได้โดยติดตามวงกลมบนจากด้านซ้าย และดูว่าวงกลมใดเชื่อมโยงกับวงกลมด้านบนโดยดูว่าจุด N² ใดอยู่บน เห็นได้ชัดว่าสิ่งนี้จะทำงานได้ง่ายด้วยการเชื่อมโยงเพียงคู่เดียว แต่ก็เป็นไปได้ที่จะเรียนรู้หลายรูปแบบในตาข่ายเดียวกัน Willshaw แสดงให้เห็นว่าประสิทธิภาพสูงสุดตามทฤษฎีของเครือข่ายคือเมื่อ 50% ของจุด N² เปิดอยู่ ซึ่งจะลดโอกาสที่จะเกิด "การโจมตีปลอม" ซึ่งเป็นการบอกจุดใน A ที่ไม่เกี่ยวข้องกับรูปแบบ B ในตอนแรก [2 ].

เครือข่ายฮอปฟิลด์

ตามเครือข่ายที่เชื่อมโยงตามธรรมชาติ นวัตกรรมสำคัญที่กระตุ้นการออกแบบ AM สมัยใหม่เกิดขึ้นในปี 1982 ซึ่ง John Hopfield ซึ่งมักเรียกกันว่าเจ้าพ่อของโครงข่ายประสาทเทียมได้เสนอเครือข่ายฮอปฟิลด์ของเขา เครือข่ายเป็นวงจรที่เชื่อมต่ออย่างสมบูรณ์โดยแต่ละนิวรอนอยู่ในสถานะเลขฐานสอง (0 หรือ 1) และน้ำหนักที่กำหนดระหว่างค่าอินพุตและค่าเอาต์พุตที่ต้องการจะแสดงในเมทริกซ์น้ำหนัก

ถ้า Tij เป็นเมทริกซ์น้ำหนักที่สอดคล้องกัน การเชื่อมโยงจะทำได้โดย:

โดยเลือก U ในจำนวนเงินที่ตัดออกอย่างชาญฉลาดเพื่อปรับปรุงความแม่นยำ

สำหรับการจัดเก็บหลายสถานะการเชื่อมโยง จะได้รับอัลกอริทึมต่อไปนี้:

เรากำหนดข้อจำกัดว่าสำหรับ i=j น้ำหนักคือ 0 ใน T สิ่งนี้นำไปสู่การตั้งฉากหลอกของ:

สิ่งนี้ชี้ให้เห็นว่าถ้า Vi เป็น 1 ค่าที่ทำนายไว้สำหรับ J จะเป็นค่าบวกและค่าลบหากมีค่าเป็น 0 ซึ่งเป็นไปตามกฎการเชื่อมโยงก่อนหน้านี้โดยที่ U เป็น 0

อัลกอริทึมการเรียนรู้นี้โดยพื้นฐานแล้วจะหาค่าเฉลี่ยของสถานะที่เสถียรสำหรับแต่ละรูปแบบ แต่จะจำกัดจำนวนรูปแบบที่เครือข่ายหนึ่งๆ สามารถจดจำได้ ได้รับแรงบันดาลใจจากแบบจำลอง Ising และการลดพลังงานให้เหลือน้อยที่สุด Hopfield เสนอกลไกการอัพเดทนี้เพื่อตีความว่าเป็นการลดพลังงานให้เหลือน้อยที่สุด สำหรับเครือข่ายการเกิดซ้ำของโหนด N โหนดทั้งหมดจะเชื่อมต่อกัน เราจะสุ่มทีละโหนดและใช้เมทริกซ์น้ำหนักเพื่ออัปเดตโหนดนั้น

โดยที่ s คือหมายเลขโหนดและค่าในวงเล็บคือขั้นตอนเวลา

ในการศึกษาจุดที่เสถียร อัลกอริทึมการอัพเดทถูกกำหนดโดยกฎพลังงานนี้:

สิ่งนี้ชี้ให้เห็นว่าการเปลี่ยนแปลงใด ๆ ต่อ Vi จะลดพลังงานของเครือข่าย ตราบใดที่การเปลี่ยนแปลงใน Vi (+ หรือ -) ตรงกับเครื่องหมายของเอาต์พุตจากการคูณเมทริกซ์

โหนดจะได้รับการอัปเดตแบบอะซิงโครนัสและสุ่มตามกฎพลังงานและเกณฑ์ที่กำหนด สถานะของพลังงานที่เสถียรได้รับการรับประกันว่าจะเข้าถึงได้ เนื่องจากกฎการอัปเดตจะเปลี่ยนเซลล์ประสาทก็ต่อเมื่อกฎนั้นลดพลังงานลงในแต่ละขั้นตอนของเวลา เมื่อพิจารณาว่าสามารถมีสถานะเสถียรได้กี่สถานะ แสดงว่ามีสถานะประมาณ .15N สำหรับเซลล์ประสาท N ในแบบจำลอง ซึ่งเป็นมาตราส่วน o(N) อย่างเคร่งครัด [3] นอกจากนี้ยังควรทราบว่าโครงสร้างของเครือข่ายประเภทนี้เอื้อต่อการประสบความสำเร็จในงานเชื่อมโยงอัตโนมัติ แต่ก็มีรูปแบบต่างๆ เช่น การเข้ารหัส "เวกเตอร์-เมทริกซ์-เวกเตอร์" ที่สามารถใช้หน่วยความจำเฮเทอโรแอสโซซิเอทีฟได้เช่นกัน [4]

ทฤษฎีทางชีววิทยา

แนวคิดหลักที่ขับเคลื่อนแบบจำลองทั้งหมดที่กล่าวถึงข้างต้นคือการส่งเสริมการเชื่อมต่อหากเซลล์ประสาทตรงกับรูปแบบที่ตรงกัน รูปแบบการเรียนรู้นี้เรียกว่า “การเรียนรู้แบบเฮบเบียน” ซึ่งส่งเสริมการเชื่อมต่อในไซแนปส์หากเซลล์ประสาททั้งสองทำงานพร้อมกัน แม้ว่าการสร้างความทรงจำในสมองจะยังเป็นปรากฏการณ์ที่ไม่ทราบแน่ชัด แต่ก็มีการแสดงในห้องแล็บว่าแนวคิดเรื่อง "การจุดไฟเข้าด้วยกัน" มีความแม่นยำทางชีวภาพ [5]

การใช้หน่วยความจำเชื่อมโยงในซิลิโค

หน่วยความจำแบบเชื่อมโยงเป็นหน่วยความจำประเภทหนึ่งที่อนุญาตให้จัดเก็บและเรียกใช้ข้อมูลตามความสัมพันธ์หรือการเชื่อมโยงระหว่างข้อมูลต่างๆ การพัฒนาแบบจำลองทางคอมพิวเตอร์สำหรับระบบดังกล่าวเป็นปัญหาที่ได้รับการยอมรับอย่างดีที่จุดตัดระหว่างประสาทวิทยาศาสตร์และปัญญาประดิษฐ์ วิธีการที่ได้รับการศึกษาอย่างดีเช่นเครือข่าย Hopfield สามารถจัดเก็บรูปแบบไบนารีได้เท่านั้น อย่างไรก็ตาม ข้อมูลที่ซับซ้อน (เช่น รูปภาพและข้อความ) ต้องการระบบที่ซับซ้อนในการแก้ปัญหา

วิธีการที่ใช้พลังงานเป็นแบบจำลองการคำนวณที่ดีสำหรับหน่วยความจำเชื่อมโยงหรือไม่

โมเดลหน่วยความจำเชื่อมโยงที่ใช้พลังงานเกือบทั้งหมดเก็บรูปแบบไว้ในค่าต่ำสุดของฟังก์ชันพลังงาน แนวคิดหลักที่อยู่เบื้องหลังแบบจำลองเหล่านี้คือการกำหนดภูมิทัศน์ของพลังงาน ซึ่งรูปแบบที่เก็บไว้จะสอดคล้องกับสถานะที่เสถียรและมีพลังงานต่ำ ฟังก์ชันพลังงานได้รับการออกแบบให้มีมินิมาเฉพาะที่หลายค่า โดยแต่ละค่าจะแสดงรูปแบบที่เก็บไว้ เมื่อระบบได้รับอินพุต ระบบจะอัปเดตสถานะซ้ำๆ เพื่อลดฟังก์ชันพลังงานให้เหลือน้อยที่สุด สุดท้ายจะรวมเข้ากับรูปแบบที่จัดเก็บไว้ซึ่งใกล้เคียงที่สุด ซึ่งเป็นค่าต่ำสุดในพื้นที่ที่ใกล้เคียงกับอินพุตมากที่สุด โมเดลที่ใช้พลังงานบางรุ่นคือ -

Hopfield Networks [2]:ฟังก์ชันพลังงานในเครือข่าย Hopfield ถูกกำหนดให้เป็นฟังก์ชันกำลังสองของสถานะของเครือข่าย แต่ละรูปแบบที่เก็บไว้สอดคล้องกับค่าต่ำสุดของฟังก์ชันพลังงานนี้ ไดนามิกของเครือข่ายทำให้มั่นใจได้ว่าระบบจะรวมเข้ากับหนึ่งใน minima โลคัลเหล่านี้ โดยเรียกรูปแบบที่เกี่ยวข้องได้อย่างมีประสิทธิภาพ

เครื่องจักร Boltzmann [6]:ในเครื่องจักร Boltzmann ฟังก์ชันพลังงานถูกกำหนดในแง่ของสถานะของโหนดและน้ำหนักของการเชื่อมต่อระหว่างกัน กระบวนการเรียนรู้จะปรับน้ำหนักเพื่อสร้างภูมิทัศน์พลังงานด้วยค่าต่ำสุดในท้องถิ่นที่สอดคล้องกับรูปแบบที่เก็บไว้ จากนั้นระบบจะใช้สโทแคสติกไดนามิกส์เพื่อสำรวจแนวพลังงานและปรับให้อยู่ในจุดต่ำสุดในท้องถิ่น ดึงรูปแบบที่สอดคล้องกัน

แนวทางตามทฤษฎีสนามค่าเฉลี่ย [7]:แนวทางเหล่านี้ยังจัดเก็บรูปแบบในค่าต่ำสุดของฟังก์ชันพลังงาน โดยการประมาณไดนามิกของระบบที่ซับซ้อนด้วยทฤษฎีสนามค่าเฉลี่ย กระบวนการเรียนรู้และดึงข้อมูลสามารถวิเคราะห์และปรับให้เหมาะสมได้อย่างมีประสิทธิภาพมากขึ้น

โมเดลดั้งเดิมเหล่านี้สามารถจัดการข้อมูลภาพขนาดเล็กได้ แต่อาจมีปัญหากับภาพขนาดใหญ่และซับซ้อนกว่า เนื่องจากข้อจำกัดด้านความจุ ความสามารถในการปรับขนาด และความซับซ้อนในการคำนวณ

การแก้ไขเพียงอย่างเดียวสามารถใช้หน่วยความจำเชื่อมโยงได้หรือไม่

การท่องจำต้องใช้แบบจำลองเพื่อดึงข้อมูลการฝึกอบรม ในขณะที่การแก้ไขคือความสามารถในการปรับให้พอดีกับข้อมูลการฝึกอบรมอย่างสมบูรณ์ ดังนั้นการแก้ไขเพียงอย่างเดียวไม่สามารถใช้หน่วยความจำที่เชื่อมโยงได้ การแก้ไขอาจเป็นเทคนิคที่มีประโยชน์สำหรับการประมาณค่าระหว่างจุดข้อมูลที่รู้จัก แต่ไม่เพียงพอที่จะนำระบบหน่วยความจำเชื่อมโยงที่เต็มเปี่ยมมาใช้ โมเดลหน่วยความจำแบบเชื่อมโยงได้รับการออกแบบเพื่อจัดเก็บและดึงรูปแบบตามการเชื่อมโยง โดยมักจะระบุรูปแบบที่เก็บไว้ที่ใกล้เคียงที่สุดกับอินพุตที่กำหนด แม้ว่าอินพุตจะมีเสียงดังหรือไม่สมบูรณ์ก็ตาม

แม้ว่าการแก้ไขจะใช้เพื่อประเมินค่าระหว่างจุดข้อมูลที่ทราบ แต่ก็ไม่ได้ออกแบบมาเพื่อจัดการกับสัญญาณรบกวน ข้อมูลที่ไม่ครบถ้วน หรือการจดจำรูปแบบ วิธีการแก้ไข เช่น การประมาณค่าเชิงเส้นหรือพหุนาม อาศัยสมมติฐานที่ว่าฟังก์ชันพื้นฐานนั้นราบรื่นหรือมีรูปแบบเฉพาะ ซึ่งอาจไม่เป็นความจริงสำหรับปัญหาหน่วยความจำเชื่อมโยงในโลกแห่งความเป็นจริง

วิธีอื่นสำหรับหน่วยความจำที่เชื่อมโยง - การกำหนดพารามิเตอร์มากเกินไป?

การกำหนดพารามิเตอร์มากเกินไปหมายถึงสถานการณ์ที่โมเดลแมชชีนเลิร์นนิงมีพารามิเตอร์จำนวนมาก (น้ำหนักและอคติ) เมื่อเทียบกับขนาดของชุดข้อมูลการฝึกอบรม กล่าวอีกนัยหนึ่ง แบบจำลองมีความซับซ้อนเกินความจำเป็นในการอธิบายหรือจับรูปแบบพื้นฐานในข้อมูล ก่อนหน้านี้มีการสังเกตพบว่าแบบจำลองที่มีพารามิเตอร์มากเกินไปสามารถแก้ไขข้อมูลได้ การศึกษาล่าสุดโดย Radhakrishnan et al. 2020 [8] แสดงให้เห็นว่าตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์มากเกินไปสามารถใช้เพื่อจดจำและเรียกค้นตัวอย่างการฝึกอบรมได้ กลไกนี้เรียบง่ายอย่างน่าทึ่ง - สามารถยกตัวอย่างได้

กู้คืนได้ง่ายๆโดยการวนซ้ำแผนที่ที่เรียนรู้

ตัวเข้ารหัสอัตโนมัติ! ยัง overparameterized! เหล่านี้คืออะไร?

ตัวเข้ารหัสอัตโนมัติเป็นเครือข่ายประสาทเทียมประเภทหนึ่งที่ใช้สำหรับการเรียนรู้แบบไม่มีผู้ดูแลเกี่ยวกับการแสดงข้อมูลอย่างมีประสิทธิภาพ โดยมักจะมีจุดประสงค์เพื่อลดขนาด การเรียนรู้คุณลักษณะ หรือการบีบอัดข้อมูล ประกอบด้วยสองส่วนหลัก: ตัวเข้ารหัสและตัวถอดรหัส

วัตถุประสงค์การฝึกอบรมของตัวเข้ารหัสอัตโนมัติคือเพื่อลดข้อผิดพลาดในการสร้างใหม่ระหว่างข้อมูลอินพุตและข้อมูลที่สร้างใหม่ ซึ่งสร้างขึ้นโดยการส่งผ่านอินพุตผ่านตัวเข้ารหัสและตัวถอดรหัส

พูดง่ายๆ ก็คือ ตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์มากเกินไปคือตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์จำนวนมาก Adit เอต อัล แสดงให้เห็นว่าตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์มากเกินไปจะเก็บตัวอย่างการฝึกอบรมไว้เป็นจุดคงที่หรือตัวกระตุ้น อย่างไรก็ตาม มันยังเรียนรู้แผนที่ประจำตัวf(x) = x

นี่เป็นข้อโต้แย้งสำหรับการเชื่อมโยงเนื่องจากเงื่อนไขเบื้องต้นคืออนุพันธ์ในตัวอย่างต้องน้อยกว่า 1 Adit et อัล 2563ทำงานบนสมมติฐานว่าตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์เกินนั้นมีประสิทธิภาพเพียงพอที่จะใช้หน่วยความจำที่เชื่อมโยง พวกเขาแสดงให้เห็นในงานของพวกเขาว่าตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์มากเกินไปสามารถใช้เป็น "หน่วยความจำเชื่อมโยงที่ยึดตามตัวดึงดูด" แนวคิดหลักที่อยู่เบื้องหลังระบบที่อิงกับตัวดึงดูดคือเครือข่ายควรสามารถดึงรูปแบบที่เก็บไว้ได้เมื่อได้รับรูปแบบนั้นที่ไม่สมบูรณ์หรือมีสัญญาณรบกวน รูปแบบการป้อนข้อมูลทำหน้าที่เป็นสัญญาณ และไดนามิกของเครือข่ายจะนำทางระบบไปยังตัวดึงดูดที่ใกล้เคียงที่สุด เพื่อ "กำจัด" สัญญาณรบกวนหรือเติมข้อมูลที่ขาดหายไปได้อย่างมีประสิทธิภาพ - พูดง่ายๆ ว่า OPA สามารถใช้หน่วยความจำเชื่อมโยงได้ เงื่อนไขทางคณิตศาสตร์สำหรับการเป็นหน่วยความจำเชื่อมโยงที่ใช้แรงดึงดูดคือ -

- ตัวอย่างต้องมีจุดตายตัว

- อนุพันธ์ในตัวอย่างต้องน้อยกว่า 1

สิ่งนี้เกิดขึ้นจริงหรือ?

บทความนี้แสดงหลักฐานเชิงประจักษ์ที่กว้างขวางว่าสามารถพบตัวดึงดูดในตัวเข้ารหัสอัตโนมัติในสถาปัตยกรรมต่างๆ และเทคนิคการเพิ่มประสิทธิภาพต่างๆ ผู้เขียนประสบความสำเร็จในการสาธิตตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์เกินที่สามารถจัดเก็บรูปภาพ 500 ภาพจากชุดข้อมูล ImageNet-64 เป็นตัวดึงดูด พวกเขายืนยันว่าภาพการฝึกอบรมทั้งหมด 500 ภาพถูกจัดเก็บไว้เป็นตัวดึงดูดโดยการตรวจสอบค่าลักษณะเฉพาะของ Jacobian matrix สำหรับแต่ละตัวอย่าง การศึกษายังวิเคราะห์อัตราที่ตัวอย่างการฝึกอบรมสามารถกู้คืนได้ภายใต้การทุจริตรูปแบบต่างๆ ซึ่งเผยให้เห็นอัตราการกู้คืนที่สูงอย่างน่าประทับใจ

การทดลองเพิ่มเติมแสดงให้เห็นว่าตัวเข้ารหัสอัตโนมัติยังสามารถเก็บตัวอย่างการฝึกเป็นตัวดึงดูดเมื่อฝึกด้วยรูปภาพ 2,000 รูปจากชุดข้อมูล MNIST และรูปภาพขาวดำ 1,000 รูปจากชุดข้อมูล CIFAR10 แม้ว่าตัวดึงดูดปลอม (ตัวดึงดูดนอกเหนือจากตัวอย่างการฝึกอบรม) อาจมีอยู่ในตัวเข้ารหัสอัตโนมัติที่มีพารามิเตอร์เกิน แต่นักวิจัยก็ไม่สามารถระบุตัวดึงดูดปลอมดังกล่าวในตัวอย่าง ImageNet-64 ได้

ผู้เขียนได้ทำการวิเคราะห์อย่างครอบคลุมเกี่ยวกับปรากฏการณ์ดึงดูด โดยตรวจสอบสถาปัตยกรรมทั่วไป วิธีการเพิ่มประสิทธิภาพ และแผนการเริ่มต้น สิ่งเหล่านี้รวมถึงความไม่เป็นเชิงเส้น วิธีการเพิ่มประสิทธิภาพ และโครงร่างการเริ่มต้น การค้นพบของพวกเขาเผยให้เห็นว่าสิ่งดึงดูดเกิดขึ้นในทุกสถานการณ์ที่การฝึกอบรมมาบรรจบกับการสูญเสียที่ต่ำพอสมควรภายใน 1,000,000 ยุค นัยสำคัญ ปรากฏการณ์นี้ไม่ได้จำกัดเฉพาะเครือข่ายที่เชื่อมต่ออย่างสมบูรณ์เท่านั้น แต่ยังพบในสถาปัตยกรรมเครือข่ายที่ใช้กันอย่างแพร่หลาย เช่น เครือข่ายแบบหมุนวนและเครือข่ายที่เกิดซ้ำ

นัยสำคัญ ปรากฏการณ์นี้ไม่ได้จำกัดเฉพาะเครือข่ายที่เชื่อมต่ออย่างสมบูรณ์ เนื่องจากยังพบในสถาปัตยกรรมเครือข่ายที่ใช้กันอย่างแพร่หลาย เช่น เครือข่ายแบบหมุนวนและเครือข่ายที่เกิดซ้ำ เพื่อให้เห็นภาพตัวดึงดูดแบบ 2 มิติ พวกเขาฝึกตัวเข้ารหัสอัตโนมัติเพื่อเก็บตัวอย่างการฝึก 6 ตัวเป็นตัวดึงดูด และแสดงภาพจุดดึงดูดโดยทำซ้ำแผนที่ตัวเข้ารหัสอัตโนมัติที่ผ่านการฝึกอบรม เริ่มจากจุดกริด 10,000 จุดจนกระทั่งบรรจบกัน สนามเวกเตอร์ในการทดลองระบุทิศทางการเคลื่อนที่ของการวนซ้ำ แต่ละตัวอย่างการฝึกอบรมและแหล่งดึงดูดที่สอดคล้องกันจะแสดงด้วยสีที่ต่างกัน ที่น่าสนใจคือ การศึกษาพบว่าเมตริกที่เรียนรู้โดยตัวเข้ารหัสอัตโนมัติเพื่อแยกแอ่งของแรงดึงดูดนั้นไม่ใช่ระยะทางแบบยุคลิด ซึ่งจะระบุด้วยแผนภาพโวโรนอย

การเข้ารหัสตามลำดับแสดงผลลัพธ์ที่ดีกว่าการเข้ารหัสอัตโนมัติ

การเปลี่ยนฟังก์ชันวัตถุประสงค์เล็กน้อยจากตัวเข้ารหัสอัตโนมัติจะส่งผลให้เกิดการใช้งานความทรงจำที่เชื่อมโยง นักวิจัยแสดงให้เห็นว่าการลดฟังก์ชันการสูญเสียให้น้อยที่สุดสำหรับเกณฑ์ที่เล็กเพียงพอและเสถียรจะเข้ารหัสลำดับการฝึกอบรมเป็นวงจรจำกัดของเครือข่าย (ตัวดึงดูดประเภทหนึ่งที่แสดงพฤติกรรมที่คงที่และเป็นระยะ)

หมายเหตุท้าย

โดยสรุป ความจำเชื่อมโยงเป็นส่วนที่น่าสนใจของการรับรู้ของมนุษย์ ซึ่งได้รับการศึกษาในบริบทต่างๆ รวมถึงระบบทางชีววิทยา เครือข่ายฮอปฟิลด์ และโครงข่ายประสาทเทียมที่มีพารามิเตอร์เกิน ความเข้าใจของเราเกี่ยวกับหน่วยความจำเชื่อมโยงในสิ่งมีชีวิตเป็นแรงบันดาลใจในการพัฒนาแบบจำลองการคำนวณ เช่น เครือข่ายฮอปฟิลด์ ซึ่งได้พัฒนาด้านปัญญาประดิษฐ์และการเรียนรู้ของเครื่อง

การวิจัยเมื่อเร็วๆ นี้เกี่ยวกับโครงข่ายประสาทเทียมที่มีพารามิเตอร์มากเกินไปได้ค้นพบการเกิดขึ้นของตัวดึงดูด ซึ่งเป็นปรากฏการณ์ที่เกี่ยวข้องกับหน่วยความจำเชื่อมโยง ทั่วทั้งสถาปัตยกรรมและเทคนิคการเพิ่มประสิทธิภาพที่หลากหลาย การพัฒนาที่น่าตื่นเต้นนี้ไม่เพียงแต่ทำให้การเชื่อมต่อระหว่างระบบประสาทชีวภาพและระบบประสาทเทียมแน่นขึ้นเท่านั้น แต่ยังเปิดโอกาสใหม่ๆ สำหรับการสำรวจแบบจำลองที่มีประสิทธิภาพและแข็งแกร่งยิ่งขึ้นสำหรับการจัดเก็บและเรียกคืนหน่วยความจำ

ในขณะที่เรายังคงเปิดเผยกลไกที่ซับซ้อนซึ่งอยู่ภายใต้ความทรงจำเชื่อมโยง การค้นพบของเราจะเป็นตัวขับเคลื่อนนวัตกรรมเพิ่มเติมในด้านปัญญาประดิษฐ์ ปูทางไปสู่แบบจำลองขั้นสูงที่ได้รับแรงบันดาลใจจากชีวภาพที่สามารถจำลองความสามารถทางปัญญาของมนุษย์ การสำรวจอย่างต่อเนื่องนี้สัญญาว่าจะเพิ่มพูนความเข้าใจของเราเกี่ยวกับความสัมพันธ์ที่ซับซ้อนระหว่างชีววิทยาและการคำนวณ ซึ่งท้ายที่สุดจะนำไปสู่ความก้าวหน้าที่จะเป็นประโยชน์ต่อทั้งสองสาขา

ขอขอบคุณเป็นพิเศษสำหรับ Nir N. Shavit สำหรับคำแนะนำและการสนทนาที่เป็นประโยชน์ สร้างขึ้นโดยเป็นส่วนหนึ่งของ MIT class 6.S978 — Tissue vs. Silicon ใน Machine Learning ฤดูใบไม้ผลิ 2023

อ้างอิง

- สมิธ เจ. (2565). หน่วยความจำเชื่อมโยงคืออะไร? เวรี่เวลล์มายด์.https://www.verywellmind.com/what-is-associative-memory-5198601

- Willshaw, DJ, Buneman, OP และ Longuet-Higgins, HC (1969) หน่วยความจำเชื่อมโยงที่ไม่ใช่โฮโลแกรม ธรรมชาติ , 222 (5197), 960–962.Yáñez-Márquez, C., López-Yáñez, I., Aldape-Pérez, M., Camacho-Nieto, O., Argüelles-Cruz, AJ, & Villuendas-Rey, ย. (2561). รากฐานทางทฤษฎีสำหรับความทรงจำที่สัมพันธ์กันระหว่างอัลฟ่า-เบต้า: 10 ปีของส่วนขยาย แบบจำลอง และการประยุกต์ใช้ที่ได้รับมา จดหมายประมวลผลประสาท , 48 (2), 811–847.

- ฮอปฟิลด์, เจเจ (1982). เครือข่ายประสาทและระบบกายภาพที่มีความสามารถในการคำนวณแบบรวมที่เกิดขึ้นใหม่ ราชบัณฑิตยสภา , 79 (8), 2554–2558.

- คอสโก, บี. (1988). ความทรงจำเชื่อมโยงแบบสองทิศทาง ธุรกรรม IEEE บนระบบ มนุษย์ และไซเบอร์เนติกส์ 18(1), 49–60

- แมคเคลลแลนด์, JL (2549) คุณจะไปได้ไกลแค่ไหนกับการเรียนรู้แบบเฮบเบียน และเมื่อไหร่ที่จะทำให้คุณหลงผิด กระบวนการเปลี่ยนแปลงของสมองและพัฒนาการทางความคิด: ความสนใจและประสิทธิภาพ xxi, 21, 33–69

- แอ็คลีย์, เดวิด เอช., เจฟฟรีย์ อี. ฮินตัน และเทอเรนซ์ เจ. เซย์นาวสกี้ “อัลกอริธึมการเรียนรู้สำหรับเครื่องจักร Boltzmann” พุทธิปัญญา 9.1 (1985): 147–169.

- Barabási, Albert-László, Réka Albert และ Hawoong Jeong “ทฤษฎีฟิลด์ค่าเฉลี่ยสำหรับเครือข่ายสุ่มแบบไม่มีสเกล” Physica A: กลศาสตร์ทางสถิติและการประยุกต์ใช้ 272.1–2 (1999): 173–187

- Radhakrishnan, Adityanarayanan, Mikhail Belkin และ Caroline Uhler “โครงข่ายประสาทเทียมที่มีพารามิเตอร์มากเกินไปใช้หน่วยความจำเชื่อมโยง” การดำเนินการของ National Academy of Sciences 117.44 (2020): 27162–27170

![รายการที่เชื่อมโยงคืออะไร? [ส่วนที่ 1]](https://post.nghiatu.com/assets/images/m/max/724/1*Xokk6XOjWyIGCBujkJsCzQ.jpeg)