Plugin ChatGPT: carico cognitivo e i due percorsi della piattaforma

Il mio ultimo saggio sul potenziale degli effetti di rete nell'IA generativa (sul blog Speedinvest) ha tentato di separare l'hype AI dalla realtà. Nonostante le discussioni senza fiato su un "cambio di piattaforma", i modelli fondamentali come GPT-4 e Stable Diffusion non avevano le caratteristiche di una piattaforma. Nemmeno ChatGPT. Tuttavia, il lancio dei plug-in ChatGPT cambia questo: ora è, infatti, una piattaforma. Ma che tipo di piattaforma?

Prima di rispondere a questa domanda, un breve riepilogo aiuterebbe. Sono necessari quattro componenti per creare una piattaforma : un prodotto sottostante , un framework di sviluppo , corrispondenza e un vantaggio economico . I modelli di linguaggio di grandi dimensioni (LLM) come GPT-4 soddisfano solo uno dei quattro requisiti: forniscono un framework di sviluppo per gli sviluppatori per creare nuove app. Tuttavia, gli LLM non possiedono utenti finali e quindi non hanno un prodotto sottostante. Di conseguenza, non possono "abbinare" gli utenti alle app giuste o aiutare quegli sviluppatori a migliorare le loro attività.

Allo stesso modo, ChatGPT non era nemmeno una piattaforma prima di lanciare i plugin. In questo caso, possedeva utenti e aveva un prodotto sottostante: ChatGPT lanciato come prodotto di consumo, anche se doveva essere una prova di concetto. Ma non aveva un framework di sviluppo e quindi non poteva "abbinare" gli utenti alle app o fornire un vantaggio economico. I plugin aggiungono una dimensione completamente nuova a questo.

Plugin ChatGPT: la piattaforma

I plugin introducono un framework di sviluppo in ChatGPT. Ancora più importante, ChatGPT "abbina" anche gli utenti alle app: gli utenti devono installare i plug-in pertinenti dal Plugin Store prima che ChatGPT possa accedervi. Infine, ChatGPT può fornirti un link di prenotazione a un plug-in come Expedia o OpenTable per completare una richiesta: un chiaro vantaggio economico per gli sviluppatori di plug-in. Ciò significa che ChatGPT è ora una piattaforma a tutti gli effetti .

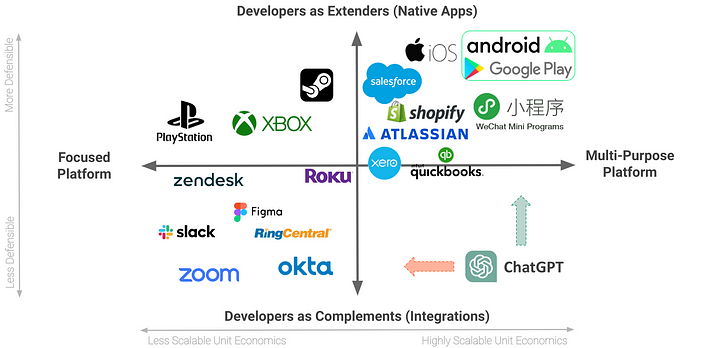

Questa non è la fine della storia. Come ho spiegato in precedenza, non tutte le piattaforme sono uguali . Le differenze tra i loro effetti di rete dipendono da un paio di fattori:

- Le piattaforme con un'ampia varietà di casi d'uso sono più scalabili (ad es. sistemi operativi di mobile computing come iOS e Android). Ad oggi, ChatGPT sembra soddisfare questi criteri. La sua vertiginosa gamma di funzionalità è stata ampiamente discussa, tra cui la generazione di codice o contenuto, l'aiuto con i compiti, la prenotazione di viaggi, la prenotazione di ristoranti, l'essere un'alternativa di ricerca, ecc.

- Le piattaforme con app native sono più difendibili di quelle che si integrano o si connettono principalmente con quelle esistenti. Ad oggi, i plug-in ChatGPT sono gli ultimi, cioè meno difendibili, principalmente perché questi sviluppatori di plug-in sono motivati a integrarsi con qualsiasi piattaforma con cui interagiscono i loro utenti (ciò potrebbe significare un Google Bard migliorato, un frenetico come Bing Chat, ecc.).

Casi d'uso mirati + Plugin/Integrazioni

La prima possibilità è che ChatGPT si sposti a sinistra su questa matrice, ovvero diventi più focalizzato nel tempo su una manciata di casi d'uso (ad es. generazione di codice/contenuto, compiti a casa , ecc.). Di conseguenza, gli sviluppatori che dispongono di app preesistenti destinate a questi casi d'uso creano sempre più integrazioni con ChatGPT e le nuove app native non si materializzano.

Questa versione del futuro potrebbe sembrare fantascienza distopica, ma c'è un argomento chiave a suo favore. C'è una ragione per cui le interfacce di chat e voce hanno faticato a decollare finora nell'informatica: il carico cognitivo . Per dirla semplicemente, pensa alla quantità di sforzo mentale richiesto da un utente per elaborare una chat o un messaggio vocale efficace e confrontalo con il tocco di un pulsante su un'interfaccia utente grafica (GUI).

Per gli utenti esperti di tecnologia come gli sviluppatori di software, l'utilizzo di ChatGPT (o GitHub Copilot, del resto) riduce effettivamente il carico cognitivo durante la codifica (che a sua volta richiede uno sforzo mentale molto elevato). Allo stesso modo, ChatGPT riduce anche il carico cognitivo per la scrittura di contenuti. Tuttavia, per il consumatore medio, la digitazione di un prompt efficace richiede uno sforzo mentale di un ordine di grandezza maggiore rispetto al tocco di un pulsante sulla GUI di un'app per smartphone o persino all'inserimento di una frase di ricerca di 1-3 parole su Google (la lunghezza tipica delle parole chiave di ricerca popolari ). Se vuoi ulteriori prove, dai un'occhiata alla fiorente industria dei cottage per suggerimenti di intelligenza artificiale pre-scritti , non qualcosa di cui avresti bisogno se fossero facili da inventare per le persone.

Naturalmente, ChatGPT è molto più capace delle precedenti iterazioni di chatbot e assistenti AI (ciao Alexa) che non sono riusciti a superare il problema del carico cognitivo. Ma solo perché può fare di più non significa che verrà utilizzato in questo modo da tutti. I limiti sono umani, non legati alla tecnologia.

Computing multiuso + App native

La seconda possibilità è che ChatGPT salga su questa matrice, ovvero mantenga il suo attuale status di coltellino svizzero, anche se l'adozione aumenta. Inoltre, gli sviluppatori hobbisti escogitano nuovi casi d'uso e creano nuove app native sulla piattaforma ChatGPT.

Per percorrere questa strada, ChatGPT dovrebbe superare il problema del carico cognitivo, ma come? Ciò richiede alcune speculazioni. È del tutto possibile che ChatGPT segua un percorso dirompente , ovvero migliorando l'accessibilità della sua interfaccia utente (ciò su cui attualmente ha prestazioni inferiori). Forse ChatGPT potrebbe incorporare più elementi della GUI o passare a un paradigma dell'interfaccia utente completamente diverso con la stessa intelligenza che lo alimenta. O forse potrebbe avanzare al punto in cui i prompt richiedono solo 1-3 parole (come quante persone usano Google oggi).

Se il problema del carico cognitivo viene risolto, l'unica cosa che manca è l'ingegnosità dello sviluppatore. Nuovi modelli informatici e modi per interagire con essi tendono a generare un'ondata completamente nuova di app native: abbiamo già visto questa storia svolgersi con PC e smartphone. Modello abbinato.

Una terza possibilità è che la piattaforma ChatGPT possa finire nel mezzo a causa di queste forze contrastanti. Se dovessi indovinare, direi che finisce nel quadrante in basso a sinistra del framework (da qualche parte tra gli scenari "spostamento a sinistra" e "medio") - con l'IA vista come la catena di montaggio, piuttosto che la Ford Model T di questa era (ChatGPT è una delle prime grandi implementazioni). Naturalmente, questo è solo un altro schema di corrispondenza. Il tempo lo dirà.

Cosa dovresti fare dopo...

1. Proponimi : non sono richieste introduzioni calorose

Investo in startup pre-seed/seed come Venture Partner presso Speedinvest e anche tramite il programma Atomico Angel. Se la tua startup è costruita su effetti di rete e ha sede in Europa, proponimi qui .

2. Eseguire la valutazione degli effetti di rete

Confronta i tuoi effetti di rete rispondendo a un quiz di 1 minuto sulla tua startup o su un potenziale investimento di startup. Provalo qui .

3. Fai domanda per il mio corso basato sulla coorte

Vuoi saperne di più sugli effetti di rete? Tengo un corso in stile workshop di 3 settimane sulla creazione, valutazione, ridimensionamento e monetizzazione degli effetti di rete. Registrati ora per assicurarti un posto o guarda questo corso intensivo gratuito sugli effetti di rete per avere un assaggio di cosa aspettarti.

4. Prenota una consulenza

Hai una domanda specifica sulla creazione, il ridimensionamento o la monetizzazione degli effetti di rete? Prenota una consulenza o iscriviti al mio orario d'ufficio settimanale gratuito (tendono a esaurirsi rapidamente).

![Che cos'è un elenco collegato, comunque? [Parte 1]](https://post.nghiatu.com/assets/images/m/max/724/1*Xokk6XOjWyIGCBujkJsCzQ.jpeg)