Detektory AI mylą się. Pisarze i tak są zwalniani

Kimberly Gasuras nie używa sztucznej inteligencji. „Nie potrzebuję tego” – powiedziała. „Jestem reporterem wiadomości od 24 lat. Jak myślisz, jak udało mi się to wszystko zrobić?” Ta logika nie wystarczyła, by uratować jej pracę.

powiązana zawartość

Jako lokalny dziennikarz w Bucyrus w stanie Ohio Gasuras w opłaceniu rachunków korzysta z pobocznych usług. Przez pewien czas nieźle zarabiała na niezależnej platformie do pisania o nazwie WritersAccess, gdzie pisała blogi i inne treści dla małych i średnich firm. Jednak w połowie 2023 r. dochody gwałtownie spadły, ponieważ niektórzy klienci przeszli na ChatGPT w celu zaspokojenia swoich potrzeb związanych z pisaniem. To był już trudny czas. Potem przyszedł e-mail.

powiązana zawartość

- Wyłączony

- język angielski

„Dostałem tylko jedno ostrzeżenie” – powiedział Gasuras. „Dostałam wiadomość, że oznaczyli moją pracę jako sztuczną inteligencję za pomocą narzędzia o nazwie „Oryginalność”. Była oszołomiona. Gasuras odpisała, broniąc swojej niewinności, ale nigdy nie otrzymała odpowiedzi. Oryginalność kosztuje, ale Gasuras zaczęła sprawdzać swoją pracę przez inne detektory sztucznej inteligencji, zanim zgłosiła się, aby upewnić się, że nie została przez pomyłkę oszukana. Kilka miesięcy później WritersAccess i tak wyrzuciło ją z platformy. „Powiedzieli, że moje konto zostało zawieszone z powodu nadmiernego wykorzystania sztucznej inteligencji. Nie mogłem w to uwierzyć” – powiedział Gasuras. WritersAccess nie odpowiedział na prośbę o komentarz.

Kiedy półtora roku temu ChatGPT podpaliło świat, zapoczątkowano gorączkowe poszukiwania sposobów na przyłapanie ludzi próbujących podawać tekst AI jako swój własny tekst. Powstało wiele startupów, które miały wypełnić lukę za pomocą narzędzi do wykrywania sztucznej inteligencji, pod nazwami takimi jak Copyleaks, GPTZero, Originality.AI i Winston AI. Zapewnia to schludny biznes w krajobrazie pełnym straszydeł AI.

Firmy te reklamują spokój ducha, sposób na odzyskanie kontroli poprzez „dowód” i „odpowiedzialność”. Niektórzy reklamują dokładność na poziomie 99,98%. Jednak rosnąca grupa ekspertów, badaczy i znawców branży twierdzi, że narzędzia te są znacznie mniej niezawodne, niż obiecują ich twórcy. Nie ma wątpliwości, że detektory AI popełniają częste błędy, a niewinni przechodnie wpadają w krzyżowy ogień. Niezliczona liczba studentów została oskarżona o plagiat sztucznej inteligencji , ale w świecie zawodowym ma miejsce spokojniejsza epidemia. Niektóre prace związane z pisaniem wygasają z powodu chatbotów . W miarę jak ludzie walczą o kurczące się pole pracy, pisarze tracą pracę z powodu fałszywych oskarżeń ze strony detektorów sztucznej inteligencji.

„Ta technologia nie działa tak, jak ludzie ją reklamują” – powiedział Bars Juhasz, współzałożyciel firmy Undetectable AI, która tworzy narzędzia pomagające ludziom humanizować tekst sztucznej inteligencji i przemycać go przez oprogramowanie wykrywające. „Mamy wiele wątpliwości co do niezawodności procesu uczenia wykorzystywanego przez te detektory AI. Ci goście twierdzą, że mają 99% dokładności, a na podstawie naszej pracy uważam, że to niemożliwe. Ale nawet jeśli to prawda, oznacza to, że na każde 100 osób przypada jedna fałszywa flaga. Mówimy o źródłach utrzymania ludzi i ich reputacji”.

Zabezpieczenie czy olej wężowy?

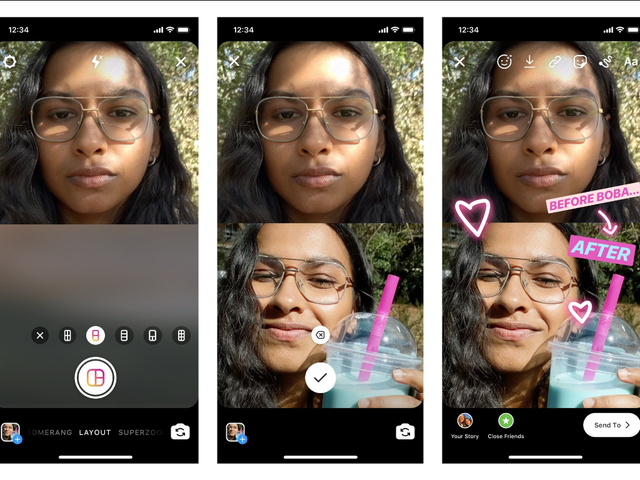

Ogólnie rzecz biorąc, detektory AI działają poprzez wykrywanie cech charakterystycznych pisma AI, takich jak doskonała gramatyka i interpunkcja. Tak naprawdę jednym z najłatwiejszych sposobów oznaczenia swojej pracy jest użycie Gramatyki – narzędzia sprawdzającego błędy ortograficzne i gramatyczne. Sugeruje nawet sposoby przepisania zdań dla przejrzystości przy użyciu, jak się domyślacie, sztucznej inteligencji. Dodając zniewagę do obrażeń, Gizmodo rozmawiał z pisarzami, którzy powiedzieli, że zostali zwolnieni przez platformy wymagające od nich używania gramatyki. (Gizmodo potwierdził szczegóły tych historii, ale wykluczamy nazwy niektórych platform niezależnych, ponieważ autorzy podpisali umowy o zachowaniu poufności.)

Detektory szukają również bardziej wymownych czynników, takich jak „wybuch”. Pisarze-ludzi chętniej ponownie wykorzystują określone słowa w skupiskach lub seriach, podczas gdy sztuczna inteligencja częściej rozprowadza słowa równomiernie w dokumencie. Detektory sztucznej inteligencji mogą również oceniać „zakłopotanie”, co zasadniczo wymaga od sztucznej inteligencji zmierzenia prawdopodobieństwa, że wygenerowałaby fragment tekstu, biorąc pod uwagę dane szkoleniowe modelu. Niektóre firmy, takie jak lider branży Originaility.AI, szkolą własne modele językowe AI stworzone specjalnie do wykrywania pracy innych AI, które mają wykrywać wzorce, które są zbyt złożone dla ludzkiego umysłu.

Żadna z tych technik nie jest jednak niezawodna i wiele dużych instytucji wycofało się z tej klasy narzędzi. OpenAI wypuściło w 2023 r. własny detektor sztucznej inteligencji, aby rozwiać obawy dotyczące swoich produktów, ale kilka miesięcy później wycofało to narzędzie z rynku „ze względu na niski współczynnik dokładności ”. Świat akademicki jako pierwszy zastosował detektory sztucznej inteligencji, ale fałszywe oskarżenia popchnęły długą listę uniwersytetów, w tym Vanderbilt w stanie Michigan w Northwestern i Uniwersytet Teksasu w Austin, do wprowadzenia zakazu używania oprogramowania do wykrywania sztucznej inteligencji .

Firmy zajmujące się wykrywaniem sztucznej inteligencji „zajmują się sprzedażą oleju wężowego” – stwierdziła Debora Weber-Wulff, profesor na Uniwersytecie Nauk Stosowanych Inżynierii i Ekonomii w Berlinie, która jest współautorką niedawnego artykułu na temat skuteczności wykrywania sztucznej inteligencji. Według Webera-Wulffa badania pokazują, że detektory AI są niedokładne, zawodne i łatwe do oszukania. „Ludzie chcą wierzyć, że może istnieć magiczne oprogramowanie, które rozwiąże ich problemy” – stwierdziła. Ale „oprogramowanie komputerowe nie może rozwiązać problemów społecznych. Musimy znaleźć inne rozwiązania.”

Firmy produkujące detektory AI twierdzą, że są one niezbędnym, ale niedoskonałym narzędziem w świecie zalewanym tekstem generowanym przez roboty. Istnieje znaczny popyt na te usługi, niezależnie od tego, czy są one skuteczne, czy nie.

Alex Cui, dyrektor ds. technologii w firmie GPTZero zajmującej się wykrywaniem sztucznej inteligencji, powiedział, że detektory mają znaczące wady, ale korzyści przeważają nad wadami. „Widzimy przyszłość, w której, jeśli nic się nie zmieni, Internet będzie w coraz większym stopniu podyktowany sztuczną inteligencją, niezależnie od tego, czy będą to wiadomości, artykuły recenzowane, czy marketing. Nie wiesz nawet, czy osoba, z którą rozmawiasz w mediach społecznościowych, jest prawdziwa” – powiedział Cui. „Potrzebujemy rozwiązania, które pozwoli na masowe potwierdzenie wiedzy i określenie, czy treść jest wysokiej jakości, autentyczna i ma legalne autorstwo”.

Zło konieczne?

Mark, inny copywriter z Ohio, który poprosił o zatajenie jego nazwiska, aby uniknąć konsekwencji zawodowych, powiedział, że musiał podjąć pracę przy konserwacji w lokalnym sklepie po tym, jak detektor sztucznej inteligencji kosztował go pracę.

„Dostałem e-maila z informacją, że w moim najnowszym artykule prawdopodobieństwo wygenerowania sztucznej inteligencji wynosi 95%” – powiedział Mark. "Byłem w szoku. To było śmieszne, że oskarżali mnie po trzech latach wspólnej pracy, na długo przed udostępnieniem ChatGPT.”

Spróbował odepchnąć się. Mark wysłał swojemu klientowi kopię Dokumentu Google, w którym napisał artykuł, zawierającą sygnatury czasowe świadczące o tym, że dokument napisał odręcznie. To nie wystarczyło. Relacja Marka z platformą pisarską rozpadła się. Powiedział, że utrata pracy kosztuje go 90% jego dochodów.

„Słyszymy te historie częściej, niż byśmy tego chcieli, i rozumiemy ból, jaki sprawiają pisarzom fałszywe pozytywne wyniki, gdy praca, w którą włożyli swoje serce i duszę, zostaje fałszywie oskarżona” – powiedział Jonathan Gillham, dyrektor generalny Originality.AI. „Mamy wrażenie, że budujemy narzędzie, które pomoże pisarzom, ale wiemy, że czasami ma to pewne konsekwencje”.

Jednak według Gillhama problem polega na czymś więcej niż tylko pomaganiu autorom czy zapewnianiu odpowiedzialności. „Google agresywnie walczy ze spamem opartym na sztucznej inteligencji” – powiedział. „Słyszeliśmy od firm, których cała witryna została zdeindeksowana przez Google, że nawet nie wiedziały, że ich autorzy korzystają ze sztucznej inteligencji”.

Prawdą jest, że Internet jest zalewany przez niewymagające dużego wysiłku farmy treści , które publikują śmieciowe artykuły oparte na sztucznej inteligencji, próbując wykorzystać wyniki wyszukiwania, uzyskać kliknięcia i zarobić na reklamach dzięki tym gałkom ocznym. Google atakuje te witryny , co prowadzi niektóre firmy do przekonania, że ich witryny zostaną obniżone w rankingu, jeśli Google wykryje jakikolwiek zapis oparty na sztucznej inteligencji. Stanowi to problem firm internetowych i coraz częściej jest to główny argument sprzedażowy detektorów sztucznej inteligencji. Oryginalność reklamuje się jako sposób na „przyszłościowe zabezpieczenie witryny w Google” i umieszcza ją na górze listy korzyści na swojej stronie głównej.

Rzecznik Google powiedział, że jest to całkowicie błędna interpretacja polityki firmy. Google, firma dostarczająca sztuczną inteligencję, stwierdziła, że nie ma problemu z zawartością AI samą w sobie. „Nieprawdziwe jest twierdzenie, że Google karze witryny internetowe tylko dlatego, że mogą wykorzystywać treści generowane przez sztuczną inteligencję” – stwierdził rzecznik. „Jak wyraźnie stwierdziliśmy, treści o niskiej wartości tworzone na dużą skalę w celu manipulowania rankingami wyszukiwania są spamem, niezależnie od tego, jak powstają. Nasze zautomatyzowane systemy określają, co pojawia się w najlepszych wynikach wyszukiwania, na podstawie sygnałów wskazujących, czy treść jest pomocna i wysokiej jakości.

Mieszane wiadomości

Nikt nie twierdzi, że detektory AI są idealne, łącznie z firmami, które je produkują. Ale oryginalność i inne detektory sztucznej inteligencji wysyłają mieszane komunikaty na temat tego, jak należy używać ich narzędzi. Na przykład Gillham powiedział: „odradzamy wykorzystywanie tego narzędzia w środowisku akademickim i zdecydowanie odradzamy wykorzystywanie go do celów działań dyscyplinarnych”. Wyjaśnił, że ryzyko fałszywie pozytywnych wyników jest dla uczniów zbyt wysokie, ponieważ w ciągu roku szkolnego przesyłają niewielką liczbę esejów, ale ilość pracy wykonanej przez zawodowego pisarza oznacza, że algorytm ma większe szanse na poprawne wykonanie zadania. Jednak w jednym z wpisów na blogu firmy Originality stwierdza, że wykrywanie sztucznej inteligencji jest „niezbędne” w klasie.

Następnie pojawiają się pytania dotyczące sposobu prezentacji wyników. Wielu autorów, z którymi rozmawiał Gizmodo, stwierdziło, że ich klienci nie rozumieją ograniczeń detektorów AI ani nawet tego, co tak naprawdę mówią wyniki. Łatwo zobaczyć, jak ktoś może być zdezorientowany: przepuściłem jeden ze swoich artykułów przez detektor sztucznej inteligencji Originality. Wyniki to „70% oryginału” i „30% sztucznej inteligencji”. Można założyć, że oznacza to, że Oryginał ustalił, że 30% artykułu zostało napisane przez chatbota, zwłaszcza że narzędzie wyróżnia konkretne zdania, które uzna za podejrzane. Jednak w rzeczywistości jest to wynik pewności; Oryginalność to 70% pewności, że tekst napisał człowiek. (Napisałem całość sam, ale musisz mi wierzyć na słowo.)

Następnie jest sposób, w jaki firma opisuje swój algorytm. Według Originality najnowsza wersja tego narzędzia ma współczynnik dokładności na poziomie 98,8%, ale Originality twierdzi również, że wskaźnik wyników fałszywie dodatnich wynosi 2,8%. Jeśli masz pod ręką kalkulator, zauważysz, że suma ta wynosi ponad 100%. Gillham powiedział, że dzieje się tak dlatego, że liczby te pochodzą z dwóch różnych testów.

W obronie Oryginalności firma podaje szczegółowe wyjaśnienie, w jaki sposób należy interpretować informacje tuż pod wynikami, wraz z linkami do bardziej szczegółowych opisów korzystania z narzędzia. Wydaje się jednak, że to nie wystarczy. Gizmodo rozmawiał z wieloma autorami, którzy stwierdzili, że muszą kłócić się z klientami, którzy źle zrozumieli narzędzie Oryginalność.

Firma Originality opublikowała liczne wpisy na blogu i badania dotyczące dokładności i innych kwestii, w tym zbioru danych i metodologii stosowanej do opracowywania i pomiaru własnych narzędzi. Jednak Weber-Wulff z Uniwersytetu Nauk Stosowanych Inżynierii i Ekonomii w Berlinie stwierdził, że szczegóły dotyczące metodologii Originality „nie są aż tak jasne”.

Wielu ekspertów, z którymi rozmawiał Gizmodo, np. Juhasz z Undetectable AI, wyraziło obawy, że firmy z branży wykrywania sztucznej inteligencji zawyżają wskaźniki dokładności i wprowadzają w błąd swoich klientów. Przedstawiciele GPTZero i Originality AI oświadczyli, że ich firmy dbają o otwartość i przejrzystość. Obie firmy stwierdziły, że dokładają wszelkich starań, aby zapewnić jasne informacje na temat ograniczeń i wad swoich narzędzi.

Może się wydawać, że sprzeciw wobec detektorów sztucznej inteligencji oznacza bycie po stronie pisarzy, ale według Gillhama jest odwrotnie. „Jeśli nie ma wykrywaczy, wzrasta konkurencja w pisaniu ofert pracy, a w rezultacie spadają płace” – stwierdził. „Detektory odróżniają możliwość, że autor może wykonać swoją pracę, przesłać treść i otrzymać za to wynagrodzenie, a możliwość po prostu skopiowania i wklejenia czegoś z ChatGPT”.

Z drugiej strony wszyscy copywriterzy, z którymi rozmawiał Gizmodo, stwierdzili, że problemem są detektory AI.

„Sztuczna inteligencja to przyszłość. Nie możemy nic zrobić, aby temu zapobiec, ale moim zdaniem nie w tym tkwi problem. Widzę wiele sposobów, w jakie sztuczna inteligencja może być użyteczna” – powiedział Mark. „To te detektory. To oni mówią z całą pewnością, że potrafią wykryć pisma AI, i to oni wpędzają naszych klientów w stany nerwowe i paranoiczne, a nas pozbawiają pracy”.