Sztuczna inteligencja Google jest naprawdę tak głupia, jak podaje ludziom odpowiedzi z The Onion

Jako mieszkańcy Internetu często widzieliśmy wiadomości tak absurdalne, że pomyśleliśmy: „To wygląda jak nagłówek w Onionie ”. Jednak jako prawdziwi ludzie większość z nas potrafi odróżnić rzeczywistość od satyry. Niestety, nowo uruchomionemu przez Google „Przeglądowi sztucznej inteligencji” brakuje tej kluczowej możliwości. Funkcja, która została uruchomiona niecałe dwa tygodnie temu (bez możliwości rezygnacji przez użytkowników), zapewnia odpowiedzi na określone zapytania na górze strony, nad innymi zasobami online. Sztuczna inteligencja tworzy odpowiedzi na podstawie wiedzy, którą zsyntetyzowała z Internetu, co byłoby świetne, gdyby nie wszystko w Internecie było prawdziwe i dokładne. Oczywiście .

powiązana zawartość

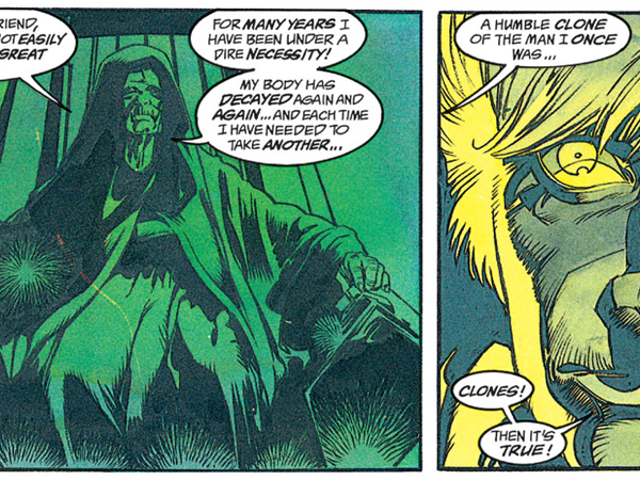

Ben Collins, jeden z nowych właścicieli naszej dawnej siostrzanej witryny, wskazał w swoich mediach społecznościowych niektóre z najbardziej rażących błędów AI Review. Na pytanie „ile kamieni powinienem jeść każdego dnia” Przegląd odpowiedział, że geolodzy zalecają jedzenie „co najmniej jednego małego kamienia dziennie”. Sformułowanie to zostało oczywiście niemal dosłownie zaczerpnięte z nagłówka „Onion” z 2021 r . Kolejne zapytanie „jakiego koloru zakreślaczy używa CIA” skłoniło Przegląd do odpowiedzi „czarny”, co było żartem Onion z 2005 roku.

powiązana zawartość

- Wyłączony

- język angielski

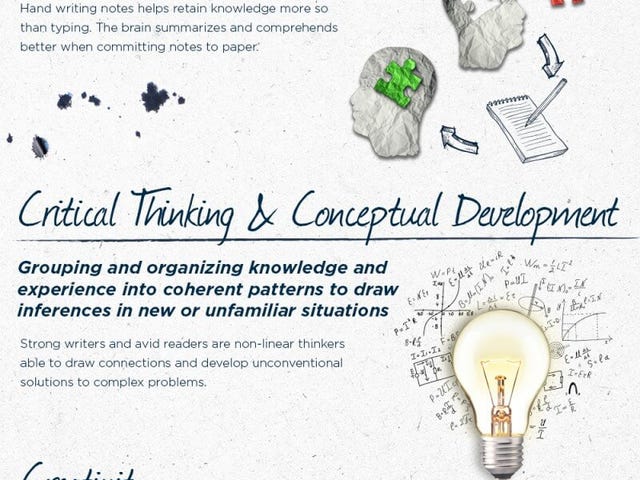

Pisarz Parker Molloy przeprowadził dalsze testy , które wykazały, że sztuczna inteligencja Google po prostu nie potrafi odróżnić wiadomości od satyry. Ale inne przykłady sugerują, że narzędzie nie wie, jak odsiać złe informacje i kropka. Jedno z wirusowych wyszukiwań na temat tego, jak zapobiec zsuwaniu się sera z pizzy, spotkało się z odpowiedzią polegającą na użyciu nietoksycznego kleju, najwyraźniej zaczerpniętą z komentarza na Reddicie sprzed dziesięciu lat. (Katie Notopoulos z Business Insider faktycznie zrobiła i zjadła pizzę z klejem – możesz śledzić jej podróż tutaj .) Niektóre odpowiedzi są, jak można było przewidzieć, bardziej złowrogie. Na przykład jeden z użytkowników wyszukał hasło „Ilu muzułmańskich prezydentów miało USA?” i uzyskał wynik: „Stany Zjednoczone miały jednego muzułmańskiego prezydenta, Baracka Husseina Obamę”.

W oświadczeniu dla CNBC rzecznik Google bronił produktu. „Zdecydowana większość przeglądów AI zapewnia wysokiej jakości informacje wraz z linkami umożliwiającymi głębsze przeglądanie sieci” – stwierdzili. „Wiele przykładów, które widzieliśmy, dotyczyło nietypowych zapytań, widzieliśmy też przykłady, które zostały sfałszowane lub których nie mogliśmy odtworzyć”. Firma zapewniła, że AI Review przeszło szeroko zakrojone testy i że Google podejmie „szybkie działania, jeśli to konieczne, zgodnie z naszą polityką treści”.

Innymi słowy, głupie wyszukiwania wirusowe, które widzisz w mediach społecznościowych, prawdopodobnie zostały już usunięte. Jednak w miarę kontynuacji „eksperymentu” nie zdziwimy się, gdy pojawi się coraz więcej niepokojąco niedokładnych wyników wyszukiwania. Jasne, sztuczna inteligencja powinna się uczyć i doskonalić, im częściej z niej korzystasz, ale jeśli Internet jest coraz bardziej wypełniony śmieciami i nonsensami, czego nauczy się Przegląd AI? Cała sytuacja wydaje się wyrwana z pierwszych stron gazet – to znaczy z nagłówka The Onion . Czasem rzeczywistość jest głupsza od satyry.